감성 ICT 기술 및 산업동향

Trends of Emotional Information & Communication Technology

- 저자

- 신현순, 함찬영, 엄남경, 김미경, 이석희, 김용선 / 사물감성융합연구실

- 권호

- 29권 5호 (통권 149)

- 논문구분

- IT 융합기술 특집

- 페이지

- 30-39

- 발행일자

- 2014.10.01

- DOI

- 10.22648/ETRI.2014.J.290504

- 초록

- 감성 ICT 기술은 인간의 감성을 자동으로 인지하여 사용자 환경에 맞게 감성정보를 처리하여 제품이나 서비스로 제공해주는 기술로, 일상생활에서 이용하는 제품이나 서비스에 인간의 감성을 융합함으로써 고부가가치를 창출할 수 있는 핵심기술로 주목 받고 있다. 또한, 감성 ICT 산업은 정보가전, PC, 통신 기기 등 전통적인 ICT 산업뿐 아니라, 의료기기, 신변보호, 의류, 자동차, 항공, 건설 및 인테리어 등 다양한 비(非I)ICT 산업에 융합되어 글로벌 IT 융합 신시장을 창출할 것으로 기대된다. 본고에서는 센서 및 감성신호처리 기술동향, 감성인지기술 동향, 감성서비스 기술동향 및 감성 ICT 산업동향에 대해 기술한다.

Share

I. 서론

감성 ICT 기술은 일상생활에서 인간의 감성변화에 의한 자율신경계의 활동에 의해 나타나는 생체신호 및 환경/상황신호, 영상신호, 음성신호 등을 센싱할 수 있는 초소형/초정밀 센서 기술과 센싱된 생체신호 및 환경신호를 처리 및 분석하여 이를 기반으로 인간의 감성을 인식, 검증, 규격화하여 정보화하고 사용 상황에 맞게 정보를 처리하고 감성맞춤형 제품 및 서비스를 제공하는 기술이다. 감성인지 및 처리기술은 이제 막 성장기에 진입한 기술이지만, 세부 기술분야별로는 개발기, 도입기에 막 들어선 기술이 있는가 하면, 이미 성숙기에 진입한 기술도 있다. 세계 최고 수준은 미국으로 유럽, 일본, 한국 등이 미국의 기술수준에 근접해 있으나, 대부분의 기초 연구분야에서 미국이 상대적으로 우위를 점유하고 있다. Microsoft의 컴퓨터에 부착된 무선 센서를 통해 생체신호 등을 측정하여 스트레스를 추정하는 기술, MIT의 인간의 감성을 측정하기 위한 웨어러블 컴퓨팅 기술, ETH(스위스)의 감성인식 디바이스 기술 등 관련 연구가 활발히 진행되고 있다. 또한 MIT, MS, NTT Docomo, 어펙티브미디어사 등 글로벌 연구기관은 감성융합기술을 차세대 프로젝트로 선정하여 적극적으로 기술개발을 추진하고 있다. 감성인식 및 처리기술은 인간중심의 스마트 모바일 기술 및 웨어러블 기술의 핵심기술로 제품의 경쟁력을 좌우하는 기술로 발전하고 있다.

II장에서는 감성 ICT 기술을 구현하기 위해 필요한 요소 기술 동향으로 센서 및 감성신호처리 기술, 감성인지기술 동향을 기술하고, III장에서는 이러한 감성 ICT의 요소기술이 적용되어 제품 및 서비스화된 사례를 위주로 하는 감성서비스 기술동향에 대해 다룬다. IV장에서는 감성 ICT 산업의 전통적인 ICT 분야와 非ICT에의 감성 산업동향에 대해 기술하고 V장에서 결론을 맺는다.

II. 감성 ICT 기술동향

1. 센서 및 감성신호처리 기술

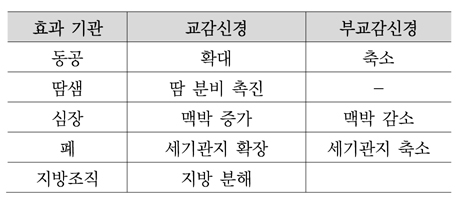

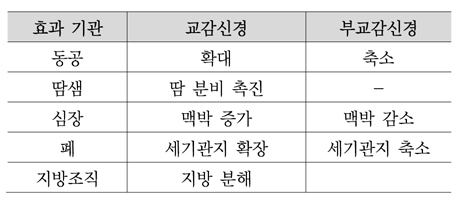

일상에서 우리는 빠르거나 느린 심장박동 또는 온 몸에서 땀이 나거나 체온이 높아지는 경험을 하게 된다. 이러한 신체적 변화는 심장근육, 민무늬근(smooth muscle) 또는 우리 몸의 외분비선을 조절하는 교감신경과 부교감 신경으로 구성된 자율신경계에 의해 조절이 되고 있으며, 자율신경계는 다양한 상황(위급,평상 등)에 따라 우리 몸의 안정된 상황을 유지할 수 있도록 교감신경과 부교감신경의 균형을 조정하고 있다(<표 1> 참조). 교감신경계는 흥분/긴장된 상태에서 크게 작용하며, 부교감신경계는 심적인 안정상태에서 반응을 한다.

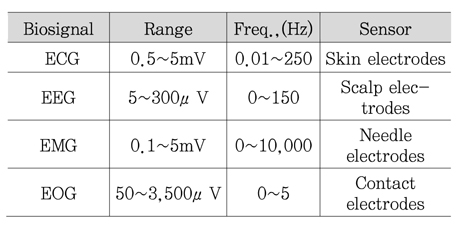

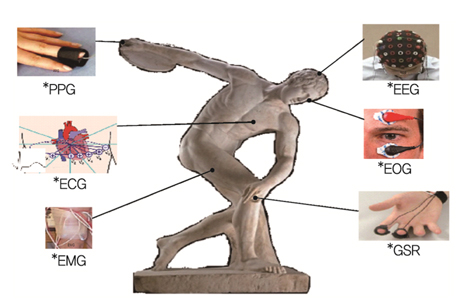

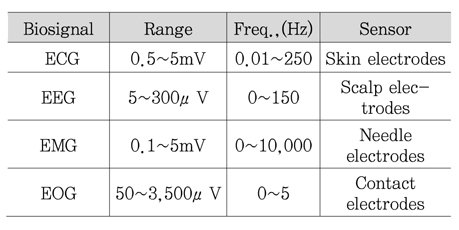

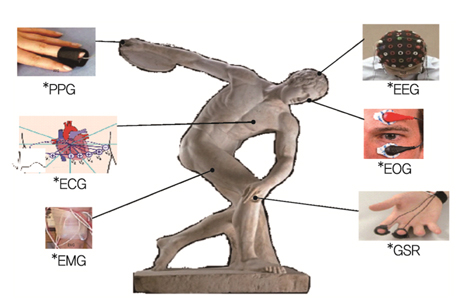

정상인의 상황에 따른 자율신경계의 조절에 의한 생체 항상성 유지 작용은 몸의 이온 이동, 활동 전위의 전달 등 생체신호의 변화를 가져오며, (그림 1)과 같이 비침습(Non-invasive)적 방법을 이용하여 전기, 임피던스, 음향, 자기(Biomagentic), 화학, 광학신호의 변화 측정이 가능하다(<표 2> 참조).

(그림 1)

감성인지를 위해 이용되는 생체신호 계측

*PPG(Photo-Plethysmography)

*ECG(Electrocardiography)

*EMG(Electromyography)

*EEG(Electroencephalogram)

*EOG(Electrooculography)

*GSR(Galvanic Skin Response)

최근, 생체정보 측정 기술은 건강 및 행복한 삶에 대한 사람들의 관심으로 무구속(無拘束), 무자각(無自覺)의 특징을 갖는 손목형, 안경형 또는 플랙시블 형태의 생체신호 측정 제품들이 많이 연구되고 있으며, 감성인지를 위한 생체신호 측정은 맥파 등의 측정 부위의 체적 또는 혈류량의 변화를 측정하기 위한 광학적 방법, 심전도, 뇌전도 등의 생체 전기신호를 측정하기 위한 비침습(non-invasive) 전기적 방법 및 피부전기전도도(GSR: Galvanic Skin Response), 피부온도(SKT: Skin Temperature) 등을 이용하고 있다.

혈관에 반사되거나 혈관을 투과한 빛의 양을 측정하는 광학식 맥파(PPG) 측정은심장의 수축, 이완으로 발생하는 혈액용적(blood volume)과 혈액내 헤모글로빈에 흡수되는 빛의 선형 관계를 이용하는 것으로, 주로 일반적인 반도체 패키지 형태의 반사형 광학식을 사용해 왔지만((그림 2) 참조), 사용자의 무구속, 무자각을 위하여 점차 전용의 소형 맥파 측정 센서가 출시되고 있다((그림 3, 4) 참조)[1].

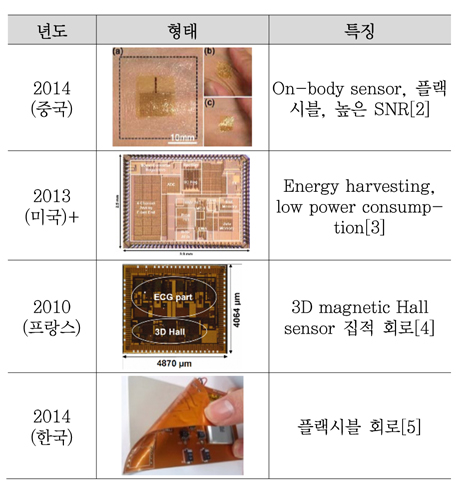

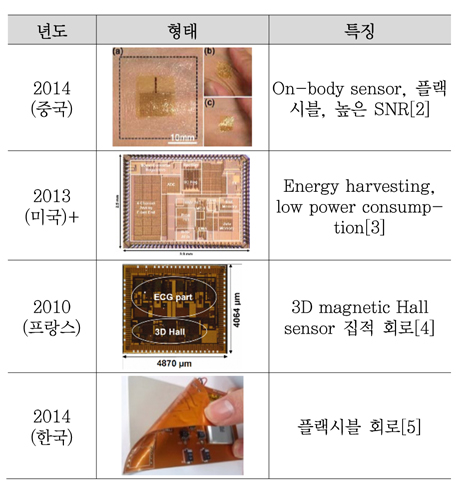

심전도란 심장 박동 시 각 심근세포들의 분극/탈분극으로 발생하는 전기적 변화를 측정하는 것으로, 몸에 심전도 전극이 직접 부착되는 심전도 측정 방법과, 정전용량 방식 또는 마이크로웨이브를 이용하는 비접촉식 방법 등이 있다. 사용자의 무구속/무자각을 위하여 초기 심전도 센서는 소형화 위주로 진행되었으나, 근래에는 장시간 충전 없이 사용 가능한 웨어러블 심전도 센서를 사용하여 피부에 부착이 가능하거나, 집적회로 형태의 소형, 저전력 센서의 연구가 세계적으로 진행되고 있다(<표 3> 참조). 하지만 국내의 생체신호 측정 센서의 개발은 회로의 소형화, 다기능에 중점을 두어 연구개발이 제한적으로 진행되고 있는 실정이다.

2. 감성인지기술동향

가. 생체 기반 감성인지기술

생체로부터 감성을 인지하는 기술은 신경과학-심리학-컴퓨터공학(과학) 등의 연결고리가 유기적으로 확장되어 이루어져야 하는 분야이다. 일반적으로 인간이 느끼는 감성은 뇌파, 심전도, 피부전도도, 피부온도 등과 같은 중추신경계 또는 자율신경계의 반응을 통해 생체신호로 나타나 감성상태의 판별이 가능하다고 알려져 있다[3].

현재까지 진행된 생체기반 감성인지 기술은 경험적이고 통계적인 Rule-based 기법과 기계학습법을 이용한 연구로 나뉘어 진행되고 있다. Rule-based 기법에 의한 기술들은 수많은 생체신호를 분석하고 감성을 표현하는 감성 특성을 추출한 후, 감성별로 Rule에 해당하는 조건을 설정하고 이를 통해 감성을 분류한다. 또한 기계학습에 의한 감성인지 알고리즘은 신경망(NN: Neural Network), 서포트벡터머신(SVM: Support Vector Machine), kNN(k-Nearest Neighbor), 다계층퍼셉트론(MLP: Multi Layer Perceptron), 가우시안 혼합모델(GMM: Gausian Mixture Model), 의사결정트리(DT: Decision Tree), 베이지안 네트워크(BN: Baysian Network) 등의 기법에 근간을 두고 있다[5]. 학습을 위해서는 많은 양의 생체 데이터를 수집하여 감성인식에 필요한 파라미터를 트레이닝해야 한다. 따라서, 수집된 학습 데이터의 신뢰도가 이후 인식 시스템의 성능을 크게 좌우한다. 그러나 지금까지 개발된 대부분의 감성인식 시스템에서는 과장되고 연출된 감정이 표현된 학습 데이터를 사용하고 있다. 이는 감성이 포함된 학습 데이터의 경우 인공적으로 취득하는 것이 용이하기 때문으로 실제 상황에서 감성인식 시스템의 성능이 저하되는 주요 요인 중 하나이다. 따라서 생체신호 기반으로 감성인지를 하기 위해서는 신뢰성 있는 생체데이터의 수집이 필수적이라고 볼 수 있다. 그러나, 생체신호는 주위의 환경조건이나 개인에 따른 심리 기저상태에 따라 감성의 변화가 달리 측정될 수 있어, 단일 생체신호만으로 감성을 정확히 인지하는 것은 매우 어렵다[6]. 그러므로, 단일 생체신호만을 이용한 감성인지를 지양하고 여러 생체신호를 복합적으로 활용하거나 추가적으로 음성 및 표정 등의 감성 측정 지표를 활용하는 방법을 시도하고 있다[7].

뇌파(EEG)를 이용한 감성인지기술 연구는 생체 인지기술 중 가장 널리 활용되는 분야이다. 뇌파는 다른 생체신호들과는 달리 중추신경계의 명령을 받는데, 뇌의 활동상태에 따라 알파파와베타파가 감성과 연관이 있다고 알려져 있다. 알파파는 안정, 이완 또는 눈을 감고 있을 때나 긍정감정일 때 나타나는 반면, 베타파는 부정감정일 때 더 나타난다. 또한 뇌파연구에서는 SVM을 이용하거나 Multiclass SVM을 활용한 연구들이 있고[8], 국내에서는 SVM과 K-means를 이용하여 행복, 공포, 슬픔, 고요를 분류한 연구가 있다[9]. 하지만 뇌파를 이용한 감성인지 기술의 실용화는 일상잡음의 해결이라는 큰 벽을 넘어야 한다.

뇌파 이외에도 뇌의 명령을 받아 반응하는 자율신경계의 반응, 즉 갑자기 놀라거나 위험에 처하면 심장은 빨리 뛰고, 얼굴 근육이 경직되고, 손바닥이나 목덜미 등에 땀이 나며, 체온 및 신체 특정 부위의 온도변화 등의 신체의 변화를 보인다. 이러한 신체의 변화는 자율신경계에 의해 조절되는 것이며, 따라서 자율신경계의 반응을 검출하여 신체 신호로부터 감성상태를 추론할 수 있다. 자율신경계의 반응에 따라 측정할 수 있는 생체신호들로는 심전도(ECG), 근전도(EMG), 피부전도도(GSR), 피부온도(SKT) 등이 있다[10].

맥박을 통해 심박동변이율(HRV: Heart Rate Variability)와 심박수(HR: Heart Rate)를 이용한 연구가 감성인지에 이용되고 있다. 맥박에서 HRV 산출 및 특징 추출을 통해 감성 분류를 하고 있으나 맥박만으로는 정확한 감성인지가 어렵다는 단점이 있다[11].

근전도(EMG)에 대한 감성인지는 주로 얼굴 근육의 움직임을 통해 감성을 인지하는 연구로, 얼굴의 근전도를 통해 표정 근육의 움직임을 측정할 수 있고 이를 이용하여 스트레스가 높은 긴장도 등을 측정하여 감성인지에 활용할 수 있다. 즉, 긴장/각성 상태에서 EMG는 증가하고, 이완상태에서는 감소한다. 하지만, 근육 긴장의 절대 레벨은 측정되는 근육 부위에 따라 다르므로, 세심한 측정이 요구되는 신호이기도 한다.

피부전도도(GSR)는 기본적으로 피부에 땀이 발생할 때 증가되는 피부의 전도성을 의미하며, 이는 자극이나 스트레스에 대한 유용한 지표로 사용될 수 있다. 피부전도도의 진폭(Amplitude)은 각성 또는 부정 감성일 때 커지며, 반응의 속도(Latency)는 민감한 자극일 때 빠르다. 반응의 민감도(Slope)는 갑작스럽거나 민감한 자극일 때 커진다. 그러므로 피부전도도는 부정적인 감성을 측정하는 좋은 지표로 활용할 수 있다.

피부온도(SKT)는 신체의 특정 부위들에 대한 온도 지표로써 체온과는 구별된다. 보통 핵심적인 생체신호 지표는 아니지만 감성상태 변화에 대한 느린 지표로 사용이 가능하며 외부환경 요인에 의해 크게 좌우된다. 일반적으로 피부온도신호의 진폭이 커지면 이완이고 쾌적한 긍정감정일 수가 있고, 작아지면 긴장 또는 불쾌한 부정감정일 수가 있다.

나. 영상 기반 감성인지기술

영상을 기반으로 하는 감성인지 기술은 사용자의 얼굴표정과 제스처를 읽어 들여 이에 따라 감성상태를 인지하는 기법이다. 이 중 가장 큰 비중을 차지하는 기법이 얼굴표정을 인식하는 기술이다. 표정의 변화는 인간의 얼굴 부위(눈, 눈썹, 입 등)의얼굴 근육 변화에 의해 각기 다른 감정을 표현한다[12].

얼굴 표정을 이용한 감성인식은 은닉 마르코프 모델(HMM: Hidden Markov Model), 신경망 처리와 같은 다양한 방법을 통해 이루어진다. 영상기반 감성인식 기법으로 제스처는 음성과 얼굴표정 인식과 함께 사용될 때 보다 정확한 결과를 나타낸다. 몸짓으로부터의 감성표현에 대한 예를 들면, 어떤 질문을 던졌을 때 박수를 치거나 손을 흔들거나 어깨를 들썩이는 것과 같은 제스처를 인식해서 감성상태를 판단할 수 있다. 손짓과 안구의 움직임 등의 제스처는 감성표현의 중요한 요소이다[13]. 얼굴 표정인지는 분노, 슬픔, 혐오, 기쁨, 놀라움 등 기본적인 감정표현에서 파생된 특징요소들의 변형을 통해 인지하며, 안경, 머리모양, 표정 등에 의해 수시로 바뀌는 얼굴모양과 주변환경의 다양한 변화를 고려한 연구들이 진행 중이다. 얼굴의 형상과 외관을 주성분 분석(PCA: Principal Component Analysis)으로 모델링하여 입력 영상으로부터 눈, 코, 입 등의 위치를 자동 추출하는 AAM(Active Appearance Model) 인식과 입력 영상을 GW(Gabor Wavelet)으로 얼굴의 특징점을 통해 표정을 인식하는 기술이 표정인식의 주요 기술로 발전 중이고, FACS(Facial Action Coding System)는 얼굴 근육 움직임에 따른 감성상태를 측정하는 것을 AU(Action Units)로 분류하여 얼굴 표정 변화에 대한 감성상태를 데이터베이스화한다.

얼굴 표정인지는 7가지 핵심 감정을 확장한 24개의 2차 감정에 관한 연구가 진행 중이며 13개의 내향적 감정과 11개의 외향적 감정으로의 분류 및 감정분석에 대한 연구가 진행 중이다.

다. 음성 기반 감성인지기술

음성은 화자의 의사에 대한 의미정보를 소리로 나타내는 것뿐만 아니라 감성을 포함하고 있다. 즉 감성에 따라 음성의 형식, 음의 강약, 장단, 고저 등이 각각 다르게 발성된다. 이 때문에 같은말이라도 운율이 서로 다른 두 음성은 전혀 다른 의미 또는 의도를 표현하게 된다. 또한 발성 속도, 각 발음 사이의 묵음구간의 길이, 의성어도 사람의 감성을 표현하는데 있어 매우 중요한 요소가 된다.

음성기반 감성인지는 크게 특징추출, 특징선택, 패턴인식, 언어모델로 구성되며, 음성 신호의 단기간 특징 또는 운율적 특징을 추출하고 특징들 중에서 감성인식에 효율적인 것을 특징 선택 알고리즘을 적용하여 선별, 패턴인식기를 이용하여 감성을 인지하는 연구들이 진행 중이다.

음성에 대한 정보는 음성의 높이, 속도, 액센트, 템포, 억양, 질, 어휘의 사용 등에 따라 서로 다르게 표현된다. 이들 특성들은 성대의 길이,성대 특성 등과 같이 선천적으로 타고나는 조음 기관들의 물리적 특징들이 복잡한 상호작용을 거쳐 나타나는데, 이러한 물리적 개인차와 말하는 습성 등으로부터도 음성의 특징이 나타난다. 감성 인식에서 주로 사용되는 파라미터로는 발음 세기, 음질, 발음 속도, 피치, 평균, 피치 변화 범위, 피치의 변화, 발음법 등이 주로 사용되어 오고 있다. 이러한 음성 파라미터는 음성신호의 정의된 구간에 대하여 계산된 피치와 에너지값으로부터 평균, 표준편차, 최대 값 등의 통계적 정보를 산출하여 감성인식에 사용한다. 음성의 특징을 추출하는 기법으로는 MFCC(Mel Frequency Cepstrum Coefficient) 파라미터가 많이 사용되고 있다. 같은 음소라 하더라도 감성상태에 따라 발음되는 음성의 형태가 다르다는 점에서 감성인식에 사용될 수 있다. 이러한 파라미터를 기반으로 감성 인식을 수행하기 위한 방법으로는 kNN, MLB(Maximum Like-lihood Bayes), KR(Kernel Regression) 분류기 등의 기본적 패턴인식 기법이 있다. 또한 피치와 에너지의 운율 파라미터를 사용하고 인식률을 높이기 위한 연구를 진행하고 있으며 음성모델 학습방법으로 HMM(Hidden Markov Model) 등이 사용되고 있다[14].

III. 감성서비스 기술동향

최근 들어 영상, 음성, 생체, 뇌파 및 신체의 정보를 감지하고 감성을 추출하여 감성응용서비스로 제공하고자 하는 시도가 다방면에서 급격한 관심사가 되고 있다. 감성 ICT는 이미 우리생활 환경에 적용할 수 있도록 다양하게 제품 개발 라이브러리나 웹 형태로도 서비스되고 있다[15].

감성연구에 대한 선두주자로 알려져 있는 MIT 미디어랩에서는 생체센서를 활용하여 스트레스를 자동으로 감지하고 스트레스 반응을 기반으로 만성적 스트레스 질환에 대한 예방과 삶의 질을 높이기 위한 기술을 개발 중에 있다[16]. 또한, 자동차에 부착된 감성인지 센서를 통해 차량 내부에서 감성을 추출하고 운전자의 경험적 내용을 추가하여 운전환경을 향상시켜 줄 수 있는 기술 개발 중에 있다[17].

세계 유수의 자동차 회사들은미래 자동차시장의 핵심은 감성기술의 접목임을 인식하고 미래시장을 선점하기 위해 감성인지기술 확보를 위한 투자에 적극 나서고 있다. 특히 도요타사에서는 운전하는 사람의 얼굴을 모니터링하고 286개 특징점을 추출하여 운전자의 감성을 평가하고 모니터링 할 수 있는 기술을 개발하고 있다.

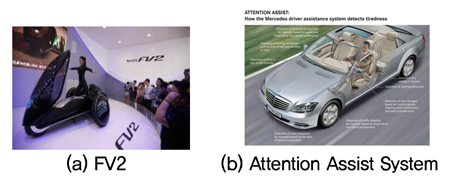

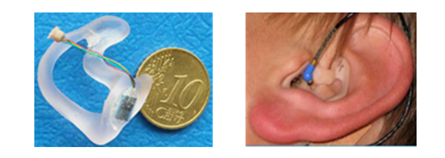

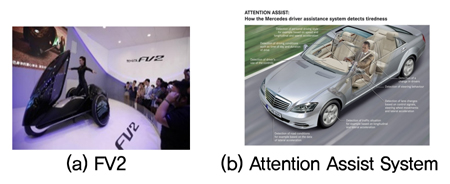

도요타사는 증강현실 디스플레이에 교통상황 및 안전정보를 표시하고 음성 및 영상인식기술을 사용하여 운전자의 기분에 맞추어 색상이 변경되며 휠을 사용하지 않고도 운전자가 몸으로 조향할 수 있는 기능을 제공하는 콘셉트카인 FV2를 2013 도쿄 모터쇼에서 선보였다.또한, 벤츠사에서 개발한 Attention Assist System은 운전자가 선글라스를 착용해도 표정으로 감성을 인지하고졸음 감지, 조향과 가속, 제동 등의 모니터링 서비스를 제공해 준다((그림 5) 참조).

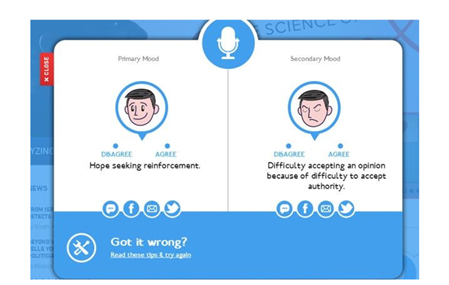

Beyond Verbal사에서는 Emotions Analytics 제품을 통해 사람들의 기분, 태도, 개인 특성, 억양 등을 토대로 실시간으로 감성을 인지하여 웹 또는 스마트폰 앱을 통해 서비스를 제공하고 있다((그림 6) 참조).

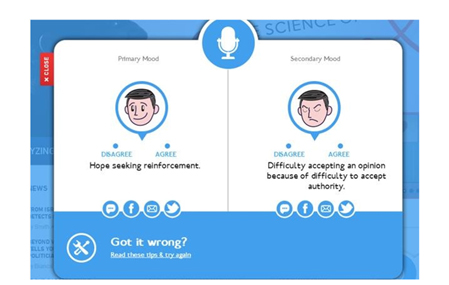

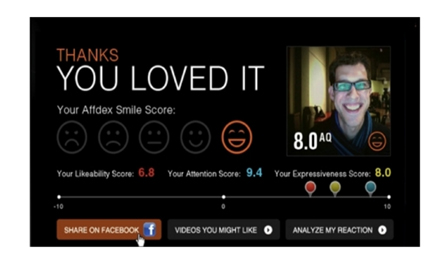

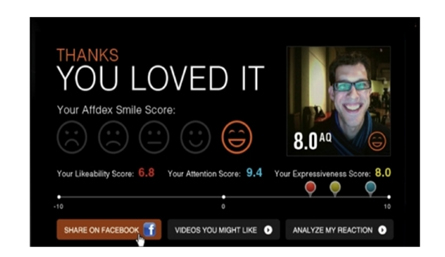

Affectiva사에서는 Affdex라는 제품을 통해 영상으로부터 얼굴 표정을 분석하여 감성을 인지하고 이를 비즈니스 모델로 활용할 수 있도록 지원하고 있으며, Emotiont사에서는 얼굴 영상의 표정을 분석하여 실시간으로 감성을 인식하는 구글 글래스앱 제품으로 여러 응용분야에서 소프트웨어를 사용할 수 있도록 API(Application Programming Interface)를 제공한다((그림 7) 참조).

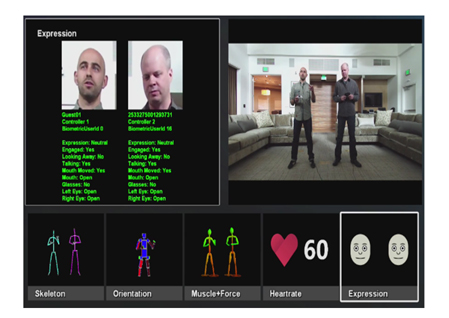

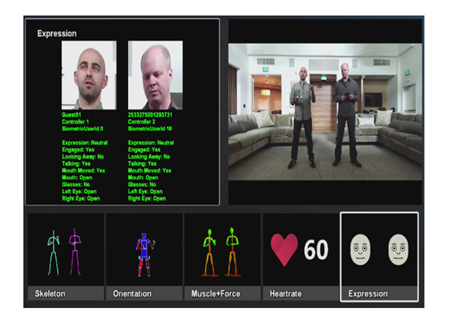

마이크로 소프트사의 키넥트 시스템 차기 버전에서도 영상 기반 감성인지기술이 적용된다. 기존 키넥트 시스템은 관절을 인식하여 움직임을 감지하는 기술이 사용되었다면, 차세대 버전에서는 움직임을 통한 무게 중심 및 개체 추출 기술과 함께 심박 생체신호, 안면 영상 분석을 통해 감성을 인지하고 이를 게임에 활용함으로써 게이머와의 상호작용을 통한 몰입도를 높이는 게임을 선보일 예정이다((그림 8) 참조).

그밖에 MIT 미디어랩의 감성 컴퓨팅 연구팀에서는자폐증 환자의 생체신호 분석하여 치료에 도움을 주는 ‘청각둔감게임(Auditory Desensitization Games)’ 프로젝트, 간질 환자의 생체정보 수신과 분석을 통해 발작 후 징후를 측정하여 돌연사를 방지하기 위한 ‘간질의 자율 신경계 활동(Autonomic Nervous System Activity in Epilepsy)’ 프로젝트, 상품 구매 시 소비자의 감성을 모니터링하여 상업적으로 서비스 하기 위한 ‘소매업의 경험을 다시 쓰다(Reinventing the Retail Experience)’ 프로젝트, 일상생활에서의 미소 패턴 분석 및 감성분석 등을 통해 삶에 감성을 적용하기 위한 ‘미소의 시간적 패턴을 탐색(Exploring Temporal Patterns of Smile)’ 프로젝트가 진행 중에 있다.

국내의 Brain IP사에서는 뇌파검출용 전극단자를 탑재한 블루투스 이어폰을 통해 뇌파를 검출하고, 음성을 추가 지표로 하여 감성상태를 측정한 후, 음악을 선곡 추천하는 기능을 갖춘 제품이 프로토타입 형태로 개발 중이다((그림 9) 참조)[18].

이와 같이 감성서비스 기술은 엔터테인먼트, 헬스케어, 시장조사, 온라인교육, 자동차, 고객 마케팅 및 일반 가정 등 다양한 분야에서 적용될 수 있는 가능성을 크게 보여주며 성장하고 있다.

IV. 감성 ICT 산업 및 시장동향

본 장에서는 감성 ICT 산업동향을 기술하고 감성 ICT 산업과 감성 ICT 융합산업으로 구분하여 시장동향을 예측 분석한다.

1. 감성 ICT 산업동향

모바일, PC, 게임산업분야에서는 미래시장 선점을 위해 제품의 감성화가 진행되고 있다. 얼굴, 표정, 음성, 생체 반응 등을 통해 감성을 인지하여 사용자와의 다양한 상호작용에 활용하고 있다.

자동차, 항공, 철도, 조선 등의 非ICT 산업분야에서도 감성지능형 스마트자동차, 여행자 감성 품질 서비스, 감성 좌석, 감성브랜딩, 감성 내부소재, 감성 엔터테인먼트 등 다양한 형태의 감성서비스가 개발되고 있다.

헬스케어, 웰니스, 테러피 산업 분야에서는 스트레스, 불면, 우울증, 비만, 정서 불안 등 다양한 정신적 질환 예방 및 치료와 개인 맞춤형 건강 서비스 산업에 IT, 의료기기, 보험사, 스포츠 용품 제조사 등 글로벌 기업들이 앞다투어 진입하고 있다[19].

2. 감성 ICT 시장동향

본 고에서는 ‘감성 ICT 산업’을기존의 ICT 산업에 감성 기술이 적용되어 새로이 발생하는 산업으로 정의하고 ‘감성 ICT 융합산업’을 非ICT 산업에 감성기술이 융합되어 새로이 탄생하는 산업으로 정의한다[20].

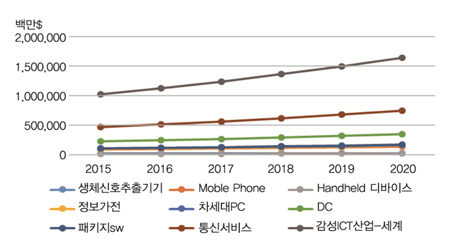

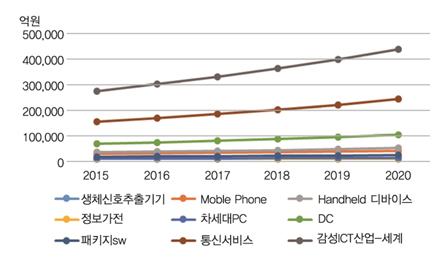

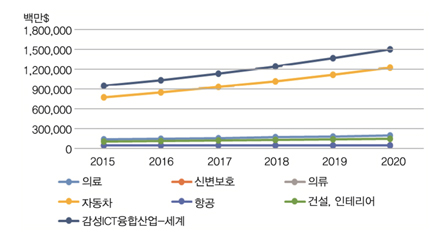

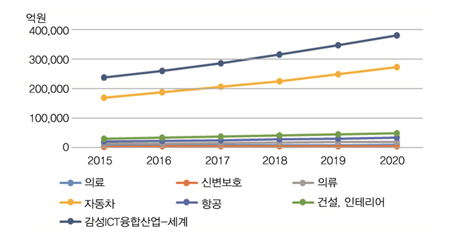

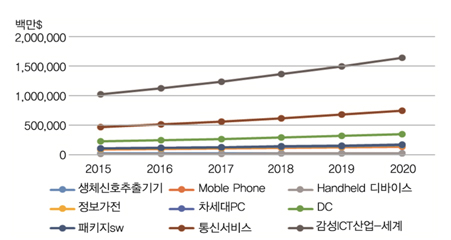

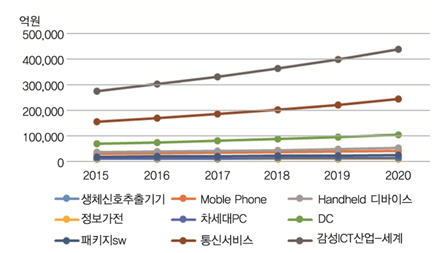

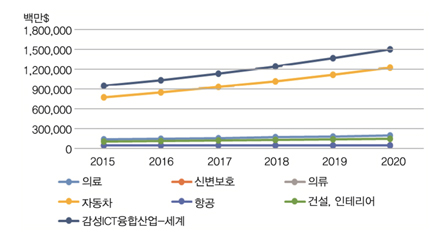

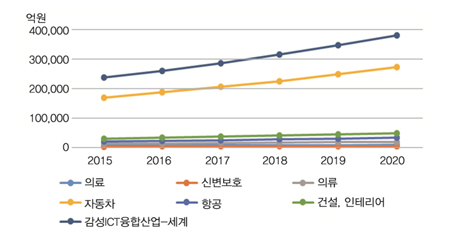

감성 ICT 산업으로는 생체신호추출기기, Mobile Phone, Handheld 디바이스, 정보가전, 차세대PC, DC, 패키지 SW, 통신서비스를 고려하였고 감성 ICT 융합산업으로는 의료, 신변보호, 의류, 자동차, 항공, 건설 및 인테리어를 대상으로 하였다.

감성 ICT 산업협회의 ‘감성 ICT 산업규모 및 경제적 파급효과’ 자료를 토대로 감성 ICT산업의 세계시장 규모를 예측해보면, (그림 10)과 같이 2015년 1조 달러에서 2020년 1조6천억 달러 규모로 연 10% 수준으로 성장할 것으로 전망된다. 국내의 경우 2015년 27조원에서 2020년 43조원 규모로 성장할 것으로 기대된다((그림 11) 참조)[21].

감성 ICT 융합산업의 세계시장 규모는 (그림 12)와 같이 2015년 9천억 달러에서 연 10% 수준으로 성장하여 2020년 1조 4천억 달러에 이를 것으로 전망된다. 국내의 경우 2015년 24조원에서 2020년 38조원 규모로 성장할 것으로 전망된다((그림 13) 참조).

V. 결론

감성 ICT 연구는 자연과의 커뮤니케이션 증진, 환경개선 등 인간사이의 커뮤니케이션 증진, 개인의 이해, 가족관계 증진, 여론 및 정책형성, 사회통합 증진 등 인공적 생산물, 제품과의 커뮤니케이션에 의한 애착형성 및 선택, 구매행동의 증진 등으로 나타날 것이다. 즉, 일상의 전 산업에 융합 적용될 것이며 미래 우리들 삶의 질을 책임질 기술이다.

감성 ICT는 궁극적으로 개인의 감성정보를 기반으로 한 제품 및 서비스를 제공하는 것을 목표로 한다. 개인의 정보를 다루는 일이라 민감한 부분이므로 개인의 프라이버시 문제해결을 위한 기술적 부분과 법제도 정비가 필요한 부분에 대해서는 세심한 검토와 접근이 요구된다. 또한, 현재의 플랫폼에 감성정보 처리기능을 개발, 적용하기 위해서는 감성정보의 규격 및 나아가 표준화가 국가주도로 이루어져야 하며 국제 표준화에도 앞장서야 한다.

이러한 문제들이 해결될 때 감성 ICT 기술은 향후 모든 제품과 서비스에 점진적으로 융합 정착되어 진정한 꽃으로 피어날 것이다.

용어해설

감정(Feeling) 어떤 현상이나 사건을 접했을 때 마음에서 일어나는 느낌이나 기분의 상태(Status)

감성(Emotion) 감정(feeling)에 의해 사람의 뇌(brain)를 거쳐 표출되는 생리/심리적 반응

약어 정리

AAM

Active Appearance Model

AU

Action Units

API

Application Programming Interface

BN

Baysian Network

DT

Decision Tree

ECG

Electrocardiography

EEG

Electroencephalogram

EMG

Electromyography

EOG

Electrooculography

FACS

Facial Action Coding System

GMM

Gausian Mixture Model

GSR

Galvanic Skin Response

GW

Gabor Wavelet

HMM

Hidden Markov Model

HR

Heart Rate

HRV

Heart Rate Variability

kNN

k-Nearest Neighbor

KR

Kernel Regression

MFCC

Mel Frequency Cepstrum Coefficient

MLB

Maximum Likelihood Bayes

MLP

Multi Layer Perceptron

NN

Neural Network

PCA

Principal Component Analysis

PPG

Photo-Plethysmography

SKT

Skin Temperature

SVM

Support Vector Machine

N. Luo et al., “Mobile Health:Design of Strectchable Electrophysiological Sensors for Wearable Healthcare Systems,” 2014 11th International Conf. Wearable Implantable Body Sensor Netw., pp. 87-91.

Y. Zhang et al., “A Batteryless 19 μW MICS/ISM-Band Energy Harvesting Body Sensor Node SoC for ExG Applications,” IEEE J. Solid-State Circuits, vol. 48, no. 1, Jan. 2013, pp. 199-213.

N. Pillet et al., “A complete device dedicated to ECG signal measurement with integrated 3D Hall sensor for signal correction,” 2010 17th IEEE International Conf. Electron., Circuits, Syst., Dec. 2010, pp. 227-230.

E. Hyun et al., “Patch Type Integrated Sensor System for Measureing Electrical and Mechanical cardiac Activities,” 2014 IEEE Sensors Appl. Symposium(SAS), Feb. 2014, pp. 94-96.

X. Niu, L. Chen and Q. Chan, “Research on Genetic Algorithm based on Emotion recognition using physiological signals,” 2011 International Conf. Computational Problem-Solving (ICCP), Oct. 2011, pp. 614-618.

A.T. Sohaib et al., “Evaluating classifiers for emotion recognition using EEG,” Foundations of Augmented Cognition Lecture Notes Comput. Sci., vol. 8027, 2013. pp. 492-501.

I. Guler and E.D. Ubeyli, “Multiclass Support Vector Machines for EEG-Signals Classification, ” IEEET Tans. Inf. Technol. Biomed., vol. 11, No. 2, Mar. 2007, pp. 117-126.

R. McCraty et al., “The Effects of Emotions on Short-Term Power Spectrum Analysis of Heart Rate Variability,” Am. J. Cardiol., vol. 76, no. 14, Nov. 15th, 1995, pp. 1089-1093.

B. Fong and J. Westerink, “Affective Computing in Consumer Electronics,” IEEE Trans. Affective Comput., vol. 3, no. 2, 2012, pp. 129-131.

Q. Ji, P. Lan, and C. Looney, “A probabilistic framework for modeling and real-time monitoring human fatigue,” IEEE Trans. Syst. Man and Cybernetics, vol. 36, no. 5, 2006, pp. 862-875.

A. Sano and R.W. Picard, “Stress recognition using wearable sensors and mobile phones,” Proc. 2013 Humaine Association Conf. Affective Comput. Intelligent Interaction, Sept. 2013, pp. 671-676.

J. Hernandez et al., “AutoEmotive: Bringing Empathy to the Driving Experience to Manage Stress,” Proc. 2014 companion publication Designing interactive syst., 2014, pp. 53-56.

- Sign Up

- 전자통신동향분석 이메일 전자저널 구독을 원하시는 경우 정확한 이메일 주소를 입력하시기 바랍니다.