Light-Field 영상획득 및 재현 기술동향

Trends of Light-Field Image Acquisition and Representation Technology

- 저자

- 이광순, 이응돈, 정원식, 허남호 / 광파영상재현연구실

- 권호

- 31권 3호 (통권 159)

- 논문구분

- 방송·전파·위성 & 스마트 미디어 기술 특집

- 페이지

- 50-59

- 발행일자

- 2016.06.01

- DOI

- 10.22648/ETRI.2016.J.310306

- 초록

- Light-field(LF) 기술은 자연스러운 완전 입체영상을 재현하면서도 홀로그램에 앞서 실현 가능한 기술로 알려져 있으며, 이에 대한 기술개발이 국내외에서 활발히 진행되고 있다. LF 기술은 카메라로 빛의 세기와 방향 정보를 획득 후 디스플레이로 그대로 재현함으로써 시각적으로 왜곡이 없는 완전 입체의 실감영상을 시청하게 하는 것이다. 조밀한 시점영상, 깊이영상의 제공으로 3D 단말 분야뿐만 아니라, 초점조절 기능을 통해 다양한 2D 응용 기술로 활용할 수 있다. LF 기술은 대형 디스플레이에서 완전 입체영상 제공을 목적으로 개발이 시작되었지만, 최근에는 모바일 단말, HMD와 같은 개인용 단말에 LF 기술을 적용하기 위한 기술개발이 시도되고 있다. 본고에서는 LF 카메라 및 단말 기술의 원리와 개발동향에 대해 살펴보고자 한다.

Share

Ⅰ. 서론

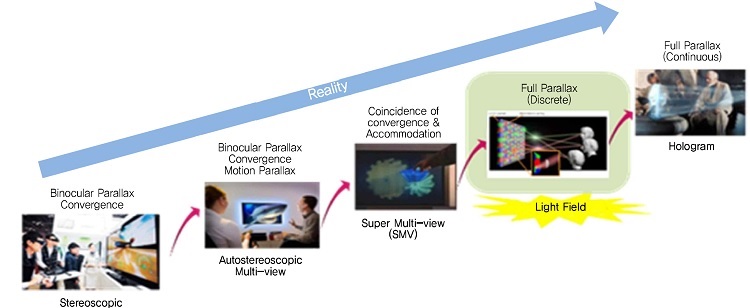

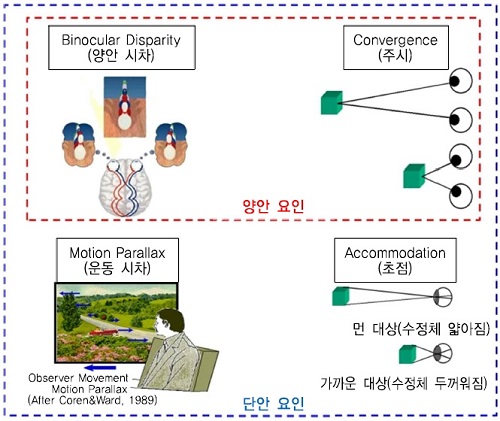

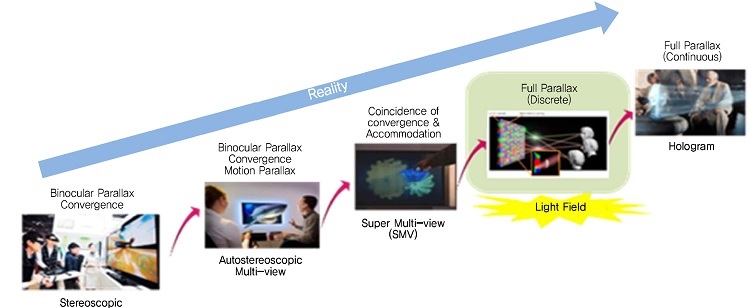

완전한 입체 실감영상을 획득하여, 디스플레이에 재현하기 위한 노력은 안경식 3DTV로부터 시작하여 끊임없이 지속되고 있다. 인간이 입체감을 느끼게 하는 요인을 (그림 1)에서와 같이 크게 4가지로 분류되고 있으며 디스플레이 기술의 진화와 더불어 단계적으로 재현해오고 있다. 인간에게 입체감을 느끼게 하는 4가지 주요 요인은 양쪽 눈의 망막에 맺히는 상의 차이로 인해 발생되는 양안시차(binocular disparity), 어떤 대상을 바라볼 때 양쪽 눈의 시선이 대상을 향해 모이는 폭주각의 차이로 인해 발생되는 주시(convergence), 관찰자와 대상자의 상대적 위치 차이에 의한 거리감 즉, 관찰자가 움질일 때 먼 곳은 느리게 가까운 곳은 빠르게 변화하여 느껴지는 운동시차(motion parallax), 인간의 눈이 먼 곳과 가까운 곳을 바라볼 때 동공의 수정체에 의해 초점이 변화하여 느껴지는 초점(accommodation)이 있다. 입체 단말 기술의 진화는 (그림 2)에서와 같이 양안시차와 폭주만 지원하는 안경식 3DTV에서 출발하여, 4가지 입체 요인을 완전히 실현할 수 있는 홀로그램까지 단계적으로 발전하고 있다. 하지만 홀로그램이 현재 상용화되기에는 현실적으로 해결되어야 할 기술적인 과제가 많아 시간이 좀 더 요구되므로, 4가지 입체 요인을 제한적으로 제공하지만, 현재 상용화가 가능한 기술인 초다시점 및 Light-Field(LF) 기술에 대한 응용이 국내외에서 다양한 실감 분야에 시도되고 있다. Ⅱ장에 자세히 설명하겠지만, LF 기술은 모든 방향의 광선(right ray)을 획득하여 고밀도로 재현하는 것으로서 수평방향의 광선만 다루는 초다시점 및 곤충의 눈을 묘사한 집적영상(integral imaging)[1]도 LF 분야에 포함된다고 볼 수 있다. LF 디스플레이는 초점조절까지 가능하여 시각피로의 주요 원인인 초점-주시 불일치 문제를 해결할 수 있다. 현재까지 LF 디스플레이에서 초점을 조절하는 방식은 동공 내에 2개 이상의 인접한 시점영상을 보이게 하는 방식(그림 2)과 다중 초점면(multi-focal plane)을 구성하여 재현하는 방법이 있다. 이외에 체적형 디스플레이는 물리적, 광학적으로 완전한 초점면을 형성할 수 있으나 응용분야가 제한적이다. 직접영상은 depth of field (DOF)가 큰 focal plane을 디스플레이에 구현하는 방법이고, MIT에서 소개되어 최근에 head mounted display(HMD)까지 적용되고 있는 적층형 LCD를 사용한 Tensor display는 대표적인 다중 초점면을 이용한 방식이다[3].

Ⅱ. Light Field의 개념

LF는 3차원 공간상에서 피사체로부터 반사되는 빛의 세기와 방향을 표현하기 위한 장(field)으로서, LF 영상획득 및 재현 기술은 카메라를 통해 LF를 획득한 후 디스플레이를 통해 그대로 재현하여 시각적으로 왜곡이 없는 완전 입체의 실감영상을 시청하게 하는 기술이다.

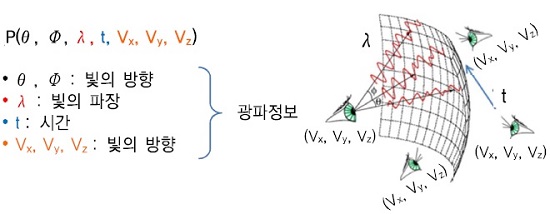

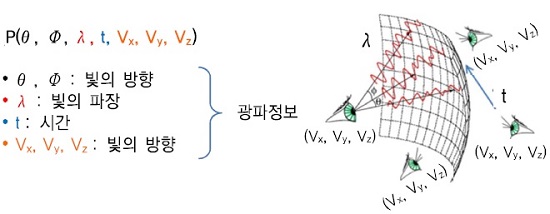

일반적으로 3차원 공간상에서 피사체로부터 반사된 빛은 모든 파장(λ)에 대해 전방향으로(θ, ϕ) 관측자의(이미지 센서, 눈) 위치(Vx, Vy, Vz)에 입사되는 빛의 세기의 시간적인 변화(t)를 나타내는 7D plenoptic 함수, P(θ, ϕ, λ, t, Vx, Vy, Vz)로 표현되고 이 7D plenoptic 함수를 구하게 되면 특정 3차원 공간에 대한 모든 LF 정보를 얻을 수 있다[4][5].

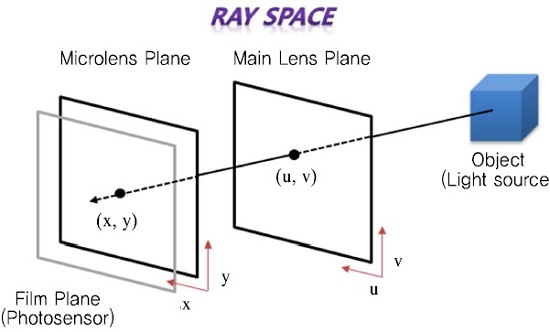

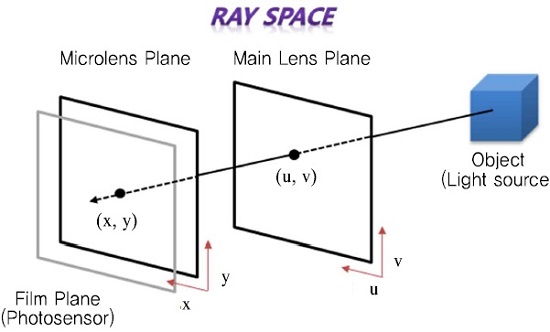

카메라의 경우, 4D 함수, P(θ, ϕ, Vx, Vy)로 표현되며 (그림 4)에서와 같이, 피사체의 한 점으로부터 나온 빛이 메인 렌즈의 임의의 한 점(u, v)을 지나 포토센서의 한 점(x, y)으로 입사되는 Ray-Space 상에서의 빛의 세기를 나타내는 4D 함수, P(x, y, u, v)로도 표현한다. 이상 4D plenoptic 함수는 카메라로부터 LF 정보를 획득하여 디스플레이 할 때 필요한 수학적 도구이며, 이를 시스템상으로 구현하기 위해서는 고밀도(dense)의 광선(light ray)을 획득 및 재현할 수 있는 광학 소자, 이미지센서, 디스플레이 소자 등이 필요하므로 Ⅲ장부터 이를 위한 기술개발 동향을 살펴보고자 한다. 여기서 고밀도의 광선은 Ray-space 상에서는 고해상도의 공간(spatial)성분과 방향(directional)성분으로 구성된다.

Ⅲ. Light-Field 영상획득 기술

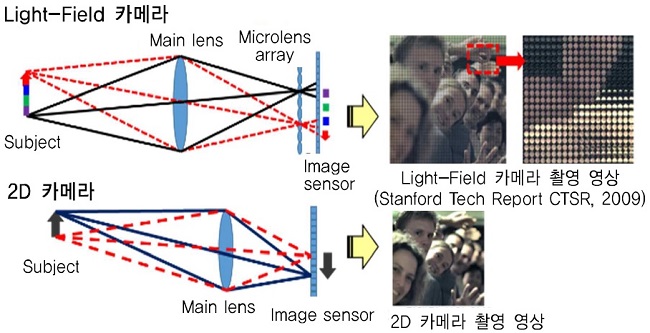

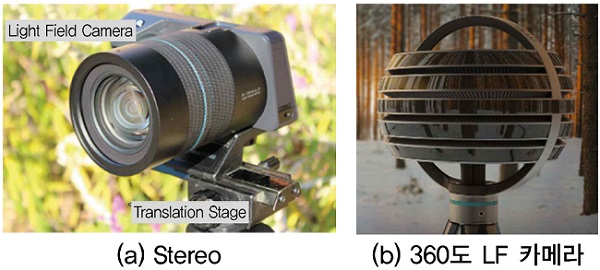

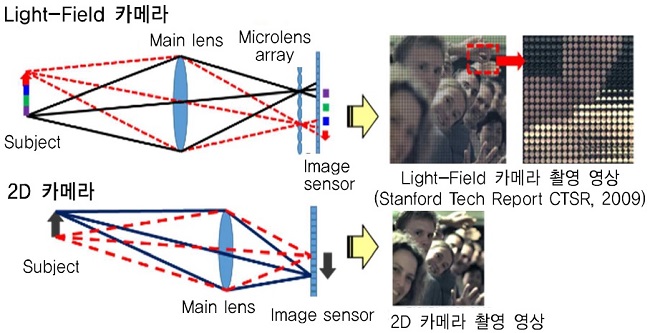

LF 영상을 획득하기 위해서는 우선 고해상도의 공간 및 방향 성분을 가지는 광선을 획득해야하며, 이를 위해 수평 및 수직 시차를 동시에 고해상도로 획득 가능한 영상획득 소자 또는 고정밀 깊이정보를 획득하기 위해 센서가 필요하다. LF 영상획득 방법은 수평 및 수직 어레이로 구성된 다중 카메라를 통해 획득하는 방법과 마이크로렌즈 어레이(microlens array) 기반의 카메라로 획득하는 방법이 있다. 마이크로렌즈 어레이 기반 LF 카메라는 마이크로렌즈 어레이를 통해 피사체로부터 반사되는 빛의 세기와 방향성 정보를 단일 CCD를 통해 획득할 수 있으므로, 획득이 용이하고 카메라 정렬(calibration) 및 보정(rectification) 등의 처리가 쉬워 LF 영상획득이 용이하다는 장점이 있다. 하지만 획득 가능한 광선의 각도가 작고 컴퓨팅에 의해 생성된 시점영상 중 최외각 간의 베이스라인(baseline) 폭이 다중카메라에 비해 좁아 획득 가능한 깊이 범위가 얇다는 단점이 있다[6][7]. 반면에 다중 카메라 기반의 LF카메라는 최외각 시점영상 간의 베이스라인 폭을 넓게 할 수 있어 시야각이 넓고 획득 가능한 깊이 범위가 깊으며, 시점영상당 해상도가 CCD의 해상도와 동일하게 유지할 수 있다는 장점이 있다. 하지만 (그림 6)에서와 같이 카메라 정렬 및 보정이 어렵고 설치가 난해하여 보급의 장애로 작용하고 있다[8].

1. 마이크로렌즈 어레이 기반 LF 영상획득 기술

마이크로렌즈 어레이 기반의 LF 카메라는 (그림 7)에서와 같이 대물렌즈(Main lens)와 마이크로렌즈 어레이로 구성되며, 대물렌즈에 의해 가상이미지(virtual image)를 생성한 후 다시 마이크로렌즈 어레이에 의해 방향성 광선을 CCD 센서에 투영하는 방식을 취한다. 따라서 단일 CCD 센서로 영상의 정보뿐만 아니라 방향성 정보를 동시에 획득할 수 있다는 장점이 있다[6]. 마이크로렌즈 어레이 기반 LF카메라의 동작 원리를 설명하면 다음과 같다. 메인렌즈를 통해 이미지 평면에 맺히는 가상영상을 마이크로렌즈 어레이가 다중카메라처럼 동작하여 요소영상(elemental image)을 생성한다. 가상영상의 특정 객체를 중심으로 몇 개의 요소영상으로부터 변위(disparity)를 구할 수 있고 이를 통해 깊이정보를 획득하는 것이다. 단일 CCD센서이고 마이크로렌즈 어레이의 광학특성이 유사하므로, 특별한 카메라 정렬 및 보정과정이 없고, 마이크로렌즈 어레이 간의 베이스라인 폭이 좁기 때문에 고해상도의 깊이 정보를 획득할 수 있는 것이다.

하지만, 마이크로렌즈 어레이 기반 LF 카메라의 가장 큰 단점은 여러 시점 영상이 한정된 이미지 센서에 동시에 투영되므로 시점 수가 증가할수록, 즉 방향 해상도가 증가할수록 시점 당 공간 해상도가 감소한다는 것이다. 따라서 시점영상의 해상도 및 획득 가능한 깊이 범위를 동시에 증대시키기 위한 기술개발이 마아크로렌즈 기반 LF 카메라 보급을 위해 절실히 필요한 실정이다.

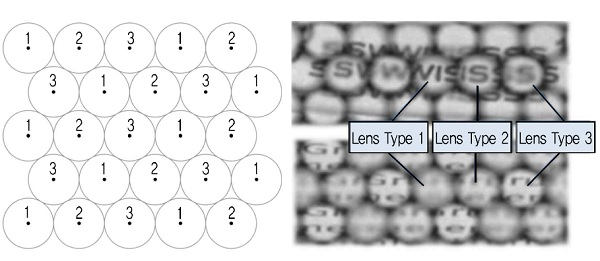

2. LF 카메라 성능 향상 기술

여러 개의 고해상도 카메라와 고감도 깊이센서를 사용하는 것이 고해상도의 시점영상과 고정밀 깊이 정보를 획득 가능한 방법이지만, 카메라 간 및 카메라-깊이센서 간 정렬 및 보정 등의 신호처리 기술과, 간편하게 사용할 수 있는 카메라 리그(Rig) 기술을 필요로 한다. 마이크로렌즈 어레이 기반 LF 카메라의 경우 공간해상도를 향상시키기 위해 마이크로렌즈 어레이의 초점을 가변하는 기술을 접목하고 있다. 대표적으로 독일의 Raytrix사는 (그림 8)에서와 같이 다중 초점면(multi-focus plane) 기법을 사용하고 있다[7]. 이는 서로 다른 초점거리를 가지는 다중 초점 마이크로렌즈 어레이를 사용하여 단일 초점 마이크로렌즈 어레이 방식보다 DOF를 증대시킬 수 있고, 신호처리를 통해 유효 공간 해상도를 CCD 센서 해상도의 1/4로 유지한다. 즉, 4K 해상도의 CCD를 사용하면 깊이정보와 더불어 다중의 Full HD 시점영상을 획득할 수 있게 된다.

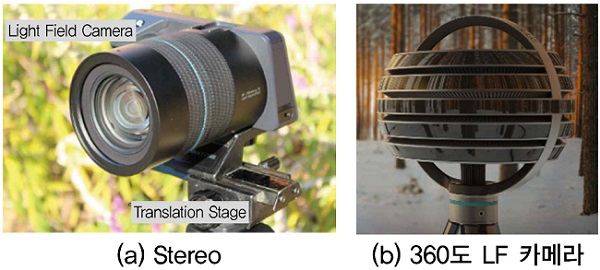

Lytro사는 소비자용의 LF 카메라를 출시하고 있으며, 베이스라인 폭이 작다는 단점을 보완하기 위해 (그림 9a)에서와 같이 LF 카메라가 좌우로 이동 가능한 스테레오 LF 영상획득 시제품을 제작하였다. 현재는 테스트용으로 시도되었지만 향후 Virtual Reality(VR) 서비스를 위해 성능확장을 시도하고 있다. 또한, 몰입형 VR서비스에 필요한 전방위 LF 영상을 획득하기 위해, (그림 9b)에와 같이 일련의 LF 센서들이 5층 적층형 구조로 장착되어 있는 Lytro Immerge의 개발을 최근에 공개하였다[8].

따라서 향후 마이크로렌즈 어레이 기반과 다중카메라 기반을 혼합한 LF 카메라가 개발된다면 두 방식의 장단점이 상호보완되어, 전방위까지 확장하여 3D 공간 영상정보를 초고화질 및 고밀도로 획득 가능할 것으로 전망된다.

Ⅳ. Light-Field 영상 단말재현 기술

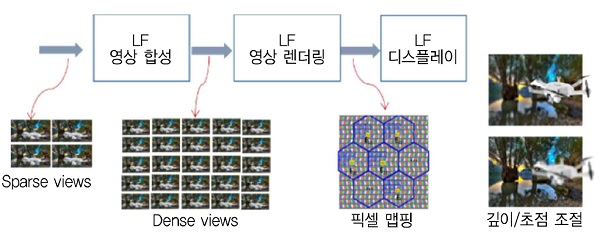

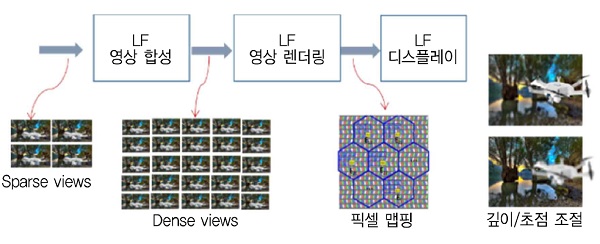

LF 카메라 혹은 CG에 의해 생성된 영상을 LF 단말에 재현하기 위한 개념도는 (그림 10)에서와 같다. 만일 콘텐츠 서버에서 LF단말에 필요한 영상을 3mm이내 고밀도 시점간격으로 생성하여 제공한다면 대용량의 데이터가 필요하기 때문에 일반적으로 저밀도(sparse)로 생성하여 단말에 전송하고, 단말에서 중간영상 합성을 통해 고밀도로의 Full parallax(수평/수직 시차 지원)시점 영상으로 시점보간(view interpolation)한다. 이때 LF 중간 영상 합성은 수평, 수직 및 대각선의 방향으로 시점보간이 되어야 하므로 고속의 LF 영상 합성기술의 개발이 필요하다. 일본 동경대는 64개(8×8)의 카메라 시스템으로 실시간 LF 영상을 획득하여 60시점으로 렌더링하기까지 한 프레임 처리에 100ms 소요하였으며, 시점영상이 256×192 정도로 저해상도였다[9]. 한편 최근에는 마이크로렌즈 기반 카메라, 다중/깊이 카메라 등 다양한 구조의 LF 영상이 다양한 형태의 LF 디스플레이에 공통적으로 사용할 수 있는 LF 영상 포맷 표준화에 대한 필요성이 Moving Picture Experts Group(MPEG) 국제 표준 단체에서 대두되고 있다.

1. 마이크로렌즈 어레이 기반 LF 디스플레이 기술

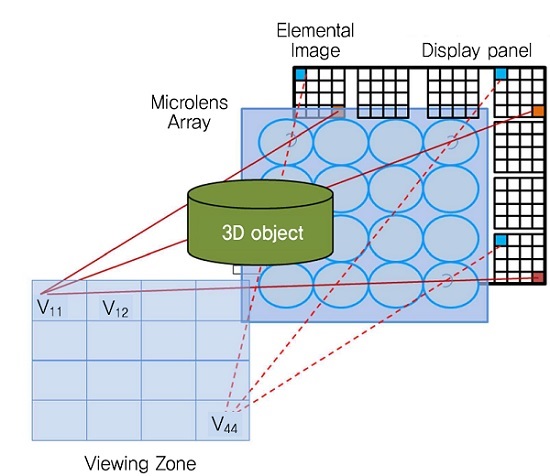

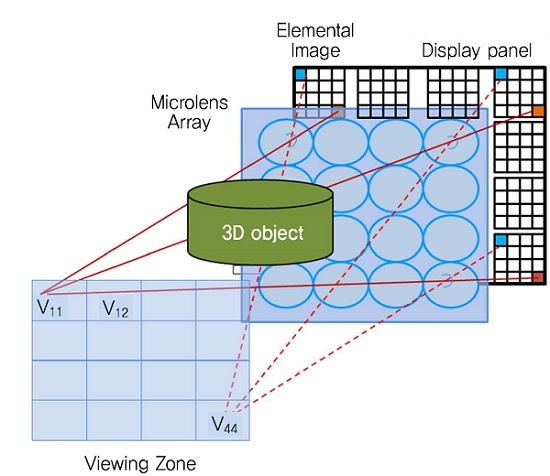

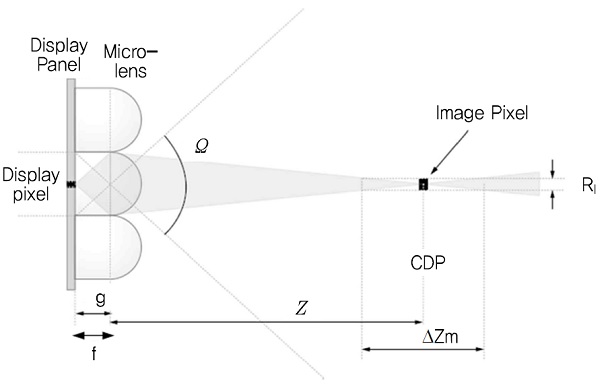

(그림 11)은 마이크로렌즈 어레이 기반 LF 디스플레이와 이의 시청환경 기하구조를 나타낸다. 마이크로렌즈 어레이를 통해 투영되는 영상이 요소영상(elemental image)이며, 요소영상의 각 픽셀들에 의해 조사되는 광선들은 렌즈에 의해 굴절되어 집속되면 시청영역(viewing zone)을 형성하는데, 광 추적 기법에 의해 시청영역내 각 시점구간들이(V11, V12, …) 계산될 수 있다.

가. 집적 영상기반 LF 디스플레이

마이크로렌즈 어레이 기반으로 LF 영상을 획득 및 재현하는 방식은 1908년부터 Lippmann에 의해 집적영상(integral imaging)[2]을 시작으로 개발되어 오고 있다. 집적영상 방식은 획득단계와 디스플레이 재현 단계가 상호 역의 관계가 되도록 동일하게 구성된다. 즉 카메라 단에서 마이크로렌즈 어레이를 통해 모든 방향으로 보여지는 3D 객체의 투영 시점영상이 여러 개의 요소영상으로 획득되며 역위 보정(pseudoscopic correction) 과정을 거친 후, 디스플레이에서 방향성이 있는 요소영상들이 재생되고 마이크로렌즈 어레이를 통해 3D 공간에 집적되어 재현되면 시청자에게 입체영상으로 보여지게 된다. 집적영상 방식은 단일 초점면을 이용할 때는 마이크로렌즈 어레이의 DOF 범위 내에서 초점이 맞는 깊이를 재현가능하며, 서로 다른 초점거리를 가지는 마이크로렌즈 어레이를 배열하여 다중 초점면을 구성함으로써 깊이 재현 범위를 확대하도록 시도되어 왔다.

집적영상 기술이 보편화되기 위해 해결해야 할 방식상의 이슈사항은 (그림 12)에서 집적되는 영상의 해상도(RI), 깊이감(ΔZm) 및 시야각(Ω)을 동시에 증가시키는 것이다. 하지만 집적영상 디스플레이의 특성상 이들은 상호 역의 관계이므로, 동시에 증가시키기 위해서 광선의 발생량을 증가시킬 수 있는 새로운 광학소자의 개발이 필요한 실정이다. 집적영상은 마이크로렌즈 어레이에 의해 초점이 맺혀 재현되는 영상의 위치에 따라 Real, virtual, focused 3가지 모드로 동작시킬 수 있는데, 이는 평판패널과 마이크로렌즈 어레이 간격(g)과 초점거리(f)에 따라 결정된다. 집적영상이 패널 앞쪽에 재현되는 real 모드는 g>f 인 경우이며, g<f 일 때는 virtual mode로서 집적영상이 패널 뒤쪽에 재현되고, focused모드는 g=f인 경우로서 집적영상은 패널 앞 및 뒤쪽으로 동시에 재현된다. 따라서 디스플레이 화면 앞뒤로 집적 영상을 동시에 재현하기 위해서는, focused 모드로 동작시켜야 하나 초점이 맞는 집적영상의 깊이범위(ΔZm)를 결정하는 Central Depth Plane(CDP)가 마이크로렌즈 어레이 층에 형성되므로 초점이 맞는 3D 영상을 재현시키는데 한계가 있다. 따라서 광학적으로 여러 개의 CDP를 형성하기 위한 방식이 완성되지 않는다면 초점조절이 가능하면서 깊이감이 큰 집적영상을 형성하기는 어려울 것이므로, 양안시차를 활용하고 동공내 2개 이상의 시점영상을 재현하는 방식은 필요하게 된다.

일본 NHK는 (그림 13)에서와 같이 현재 다중의 8K 패널 기반으로 확장 가능한 집적영상 방식의 3D 카메라 및 Integral 3DTV (3D 픽셀 수: 10만 픽셀)관련 장비 개발을 진행 중에 있으며, 2022년 IntegralTV(HoloTV) 방송을 계획하고 있다[10].

나. 공간 및 방향 해상도 증대 기술

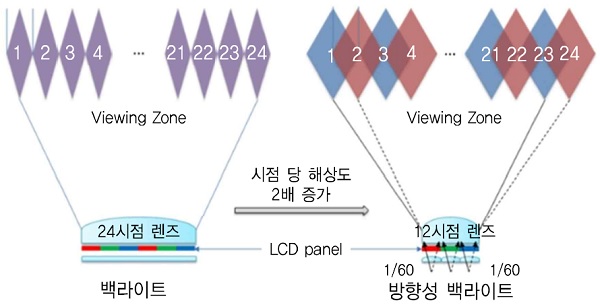

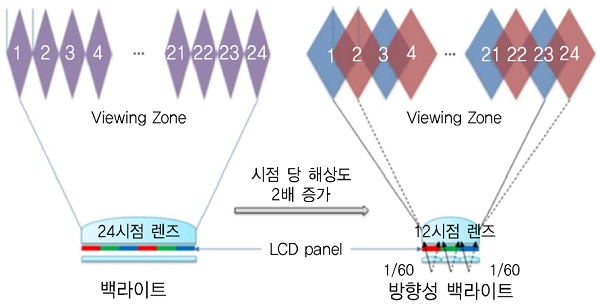

공간해상도는 LF 디스플레이를 통해 재현 가능한 시점해상도를 결정하고 방향해상도는 시점수를 결정한다. 주어진 디스플레이의 패널해상도상에 시점해상도와 시점수는 상호 역관계 있다. 따라서 LF 디스플레이가 재현 가능한 광선의 처리량(throughput)를 늘려 시점해상도 및 시점수를 동시에 향상시키기 위해서는, 평판패널 픽셀의 밀도인 Pixels per Inch(PPI)를 향상시키는 것과 동시에 전기적인 신호에 의해 동작하는 능동형 광학소자와 더불어 시간적다중화(time-multiplexing) 또는 공간적다중화(spatial multiplexing) 기법들의 적용은 필요하다고 할 수 있다. 대표적인 능동형 광학소자는 편광의존형 Liquid crystal(LC) 렌즈, 방향성 백라이트(directional backlight) 이며, (그림 14)는 능동형 방향성 백라이트를 이용하여 시점 해상도를 증대하는 기본적인 원리를 설명하고 있다.

(그림 14)에서 방향성 백라이트는 시간적으로 번갈아 가며 두 개 이상의 방향으로 빛을 굴절시킬 수 있다면, 즉 60Hz 속도로 동작하면서 홀수번 30Hz 프레임 구간은 홀수번 시점을 재생하고 짝수번 30Hz 프레임 구간은 짝수번 시점을 재생할 수 있다면, 30Hz 속도로 시점해상도 혹은 시점수를 2배 증대 가능한 것이다. 그림 12는 1/2 피치의 마이크로렌즈 어레이를 사용하여 시점수는 유지하면서 시점해상도를 증대시킨 경우이다.

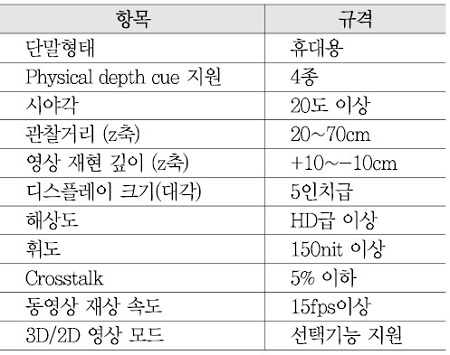

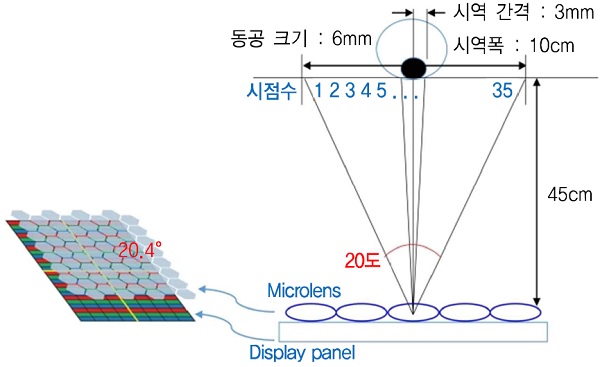

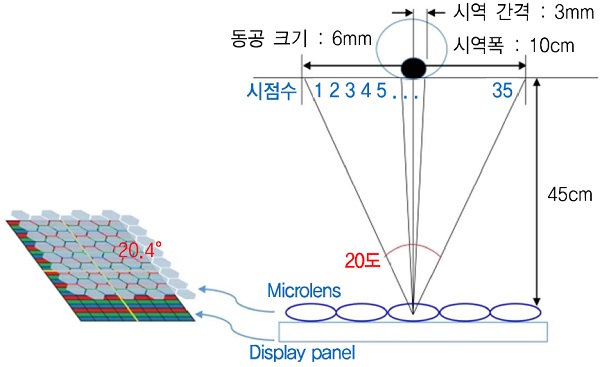

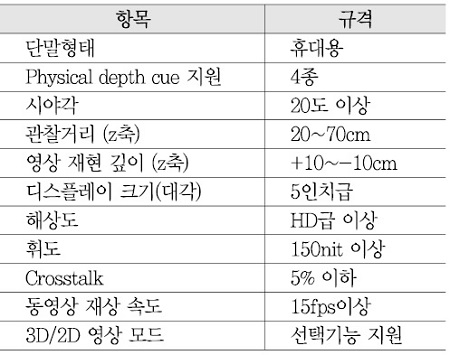

2. 모바일용 LF 단말 개발을 위한 요구규격

미래창조과학부 지원 범부처 기가코리아 사업을 통해 2015년 9월부터 모바일용 LF단말을 개발하고 있다. 본 기술개발은 초점조절을 포함하는 4가지 입체요인을 모바일 단말에 구현하여 사용자로 하여금 완전입체의 영상을 볼 수 있게 하는 것으로서 요구되는 스펙은 <표 1>과 같다. 여기서 초점조절은 동공내 2개 이상의 조밀한 시점 영상재현을 통해 구현할 예정이며, <표 1>에서 요구되는 시청거리, 시청각 및 시점해상도를 만족하기 위해서 (그림 15)에서와 같은 해결해야 할 기술적인 이슈가 있다. 45cm 시청거리에서 20도의 시야각을 형성하려면 시청폭은 약 10cm정도이다. 여기에 3mm의 시점간격을 유지하려면 35개의 시점영상을 필요로 한다. 만일 8K해상도의 디스플레이 패널을 사용한다면 시점영상의 수평해상도는 220픽셀 정도로서, HD급의 시점해상도와는 거리가 멀다. 따라서 삼성 디스플레이에 의해 디스플레이의 패널 해상도를 10K 정도까지 증대시키면서, 시간다중화 및 공간다중화의 효과를 동시에 적용하기 위한 능동형 마이크로렌즈 어레이 및 방향성 백라이트를 개발 중이다.

3. LF 응용 분야

LF 카메라로 획득된 영상은 수평/수직 시차 시점영상, 깊이영상 등의 실감영상 포맷을 지원하기 때문에 다양한 응용분야에 적용 가능하다. 스마트폰에 적용될 경우 노키아, 도시바가 일부 상용화를 시도했지만, 초점가변 및 깊이정보 추출 기능을 이용하여 한번 촬영한 영상의 배경을 바꿀 수 있다. (그림 16)는 전경 인물은 그대로 두면서 배경을 바다, 산, 강 등 다양하게 바꾸는 앱에 활용하는 것을 보여주고 있다. 또한, 획득된 시점 영상 및 깊이정보를 이용하여 3D 모델링된 영상을 생성할 수 있다.

LF 카메라는 초점가변 기능에 의해 넓은 피사체 심도를 제공하기 때문에, 피사체와 카메라와의 거리에 덜 민감하게 초점을 맞추고 이를 통해 인식률을 높일 수 있으므로, 방범용 CCTV 카메라 또는 영상 인식 카메라로 이용 가능하다. 독일의 Raytrix사의 경우 주요 판매 제품은 생산라인에서 제작되는 부품 중에서 불량품을 체크하는 관측 카메라용이다.

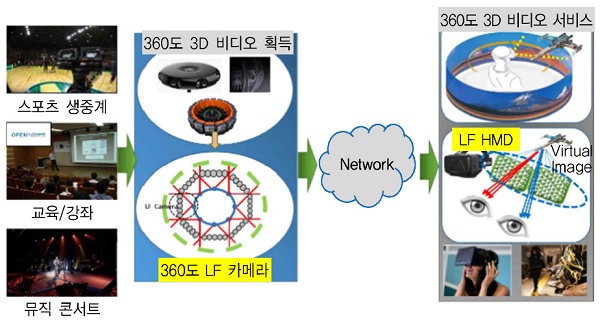

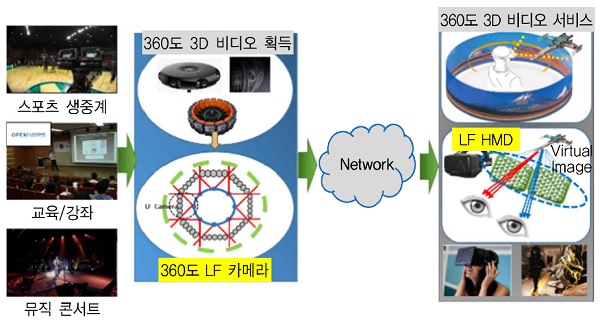

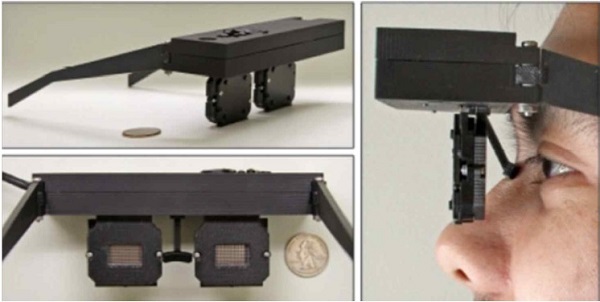

(그림 18)에서와 같이 현재 전 세계적으로 이슈가 되고 있는 VR 서비스에도 활용될 수 있다. VR 서비스의 활성화를 위해서는 개인용 단말인 HMD 및 투시형 디스플레이(see-through display)를 사용자 친화적으로 개선하는 것이 절실한데, 이를 위해 경량으로 시각피로가 없이 몰입감을 극대화할 수 있는 기능의 구현이 필요하다. 이를 위해 국내외에서 LF 기술을 VR에 접목하는 시도가 기초연구 차원에서 진행되어오다가 최근에 시제품까지 개발되고 있다. (그림 19)에서와 같이 NVIDIA사는 집적영상의 virtual mode를 이용해 마이크로렌즈 어레이가 이미지 확대용 광학렌즈를 대체하고 동시에 초점조절 기능을 부여할 수 있는 HMD 시제품을 개발하여 시연하였으며[11], Arizona 대학은 마이크로 프로젝트와 마이크로렌즈 어레이를 이용해 초점조절이 가능한 투시형 디스플레이 시제품을 시연하였다[12].

시연된 제품들은 아직 시제품 수준으로서, 마이크로렌즈 어레이에 의한 공간해상도의 열화 개선, 조절 가능한 초점 범위 향상, 6 자유도(degrees of freedom) 제공을 위한 운동시차(motion parallax) 부여 등의 기술개발을 필요로 하고 있다. 또한, Lytro사의 Lytro Immerge 카메라와 같이 전방위 LF 영상을 고품질의 공간해상도와 방향해상도로 획득 가능한 전방위 LF 카메라의 개발도 병행되어야 할 것이다.

Ⅴ. 결론

본고에서는 완전입체 실감영상을 구현하기 위한 LF 카메라 및 단말재현 기술에 대해 살펴보았다. 본고에서는 주로 획득과 디스플레이에 대해 다루었지만 대용량 LF 영상을 고효율로 압축하기 위한 논의도 이미 MPEG 국제 표준화에서 진행되고 있고, 모바일 LF 카메라 및 단말이 국책사업을 통해 개발되고 있으므로 향후에 LF 기술은 차세대 실감미디어 서비스를 위한 기반 기술이 될 것으로 전망된다.

약어 정리

M.G. Lippmann, “Épreuves Reversible, Photographies Integrales,” Académie des Siences, 1908, pp. 446-451.

Y. Takaki, K. Tanaka, and J. Nakamura, “Super Multi-View Display with a Lower Resolution Flat-Panel Display,” Optics Express, vol. 19, no. 5, 2011, pp. 4129-4139.

G. Wetzstein et al., “Tensor Displays: Compressive Light Field Synthesis using Multi-layer Displays with Directional Backlighting,” ACM Trans. Graph. - Proc. ACM SIGGRAPH, vol. 31, no. 4, 2012, pp. 1-11.

S.J. Gortler et al., “The Lumigraph,” Proc. 23rd Ann. Conf. Computer Graphics and Interactive Tech-niques (SIGGRAPH), 1996, pp. 43-54.

R. Ng et al, “Light Field Photography with a Hand-Held Plenoptic Camera,” Stanford Tech Report CTSR, Feb. 2005.

Y. Taguchi et al., “TransCAIP: A Live 3D TV System Using a Camera Array and an Integral Photography Display with Interactive Control of Viewing Parameters,” IEEE Trans. Visualization and Computer Graphics, vol. 15, no. 5, 2009, pp. 841-852.

D. Lanman, and D. Luebke, “Near-Eye Light Field Displays,” ACM Trans. Graph SIGGRAPH Asia, vol. 32, no. 6, 2013.

- Sign Up

- 전자통신동향분석 이메일 전자저널 구독을 원하시는 경우 정확한 이메일 주소를 입력하시기 바랍니다.