강정원 (Kang J.W.) 영상미디어연구실 책임연구원

김휘용 (Kim H.Y.) 영상미디어연구실 책임연구원

최진수 (Choi J.S.) 실감방송미디어연구부 책임연구원

Ⅰ.서론

고품질 영상 서비스에 대한 사람들의 수요 증가에 맞춰 관련 기술들이 나날이 눈부시게 발전하고 있다. 불과 10여년 전만 해도 UHD는 주변에서 들어보지도 못한 생소한 용어였고 관련 촬영장비나 디스플레이조차 변변치 않았다. 하지만 불과 몇 년 사이 UHD는 누구나 다 아는 일반적인 용어가 되었고 UHD 관련 장비들은 전문가가 아닌 일반인도 손쉽게 접할 수 있는 시대가 도래하였다. 이러한 시대 흐름에 발맞추어 보다 사실적이고 실감나는 영상 서비스를 제공받기 원하는 사람들의 관심은 단순히 해상도 확장과 같은 1차원적 요소에만 머무는 것이 아니라 영상의 명암이나 색감까지 고려한 복합적 요소에까지 이르게 되었으며 관련 연구와 표준화 또한 활발히 진행되고 있다.

기존 영상의 명암비와 색역대를 비약적으로 키워 자연에 가까운 밝기 변화와 색감을 표현할 수 있도록 하는 기술을 통칭하여 High Dynamic Range(HDR)/ Wide Color Gamut(WCG) 기술이라고 한다. 일반적인 의미에서 HDR/WCG 영상이라 함은 1000:1 이상의 명암비를 지원해야하며 ITU-R BT.709[1]에 정의된 색역 이상을 표현할 수 있어야 한다. 원할한 HDR/WCG 영상 서비스를 제공하기 위해서는 HDR/WCG 신호를 다룰 수 있는 카메라나 디스플레이 같은 각종 장비뿐만 아니라 이를 소비자들에게 전달하기 위한 방송/통신 규격 및 압축 표준 등이 필요하다. 하지만 현재 사용되고 있는 표준들은 당시 기술 수준만을 고려하여 제정되었기 때문에 HDR/WCG와 같은 고실감 영상 서비스를 제공함에 있어 큰 걸림돌로 작용하고 있다. 따라서 이와 같은 문제점을 해결하기 위해 ITU-R, SMPTE, MPEG, ATSC 등 다양한 단체들에서 관련 표준 제정을 위해 노력하고 있으며 보다 효율적인 HDR/WCG 영상 서비스를 위한 요소 기술들이 다양한 표준단체들을 통해 기고되고 있다. 본고를 통해 HDR/WCG의 기본적인 개념을 알아보고, HDR/WCG 비디오 서비스를 위한 요소 기술 및 관련 표준화 동향에 살펴보고자 한다.

Ⅱ. HDR/WCG 개요

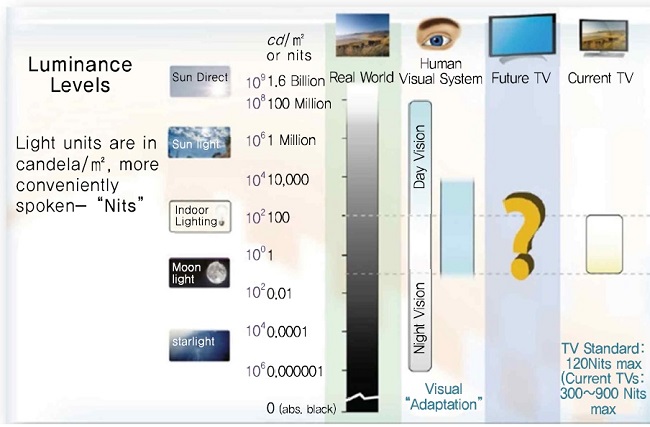

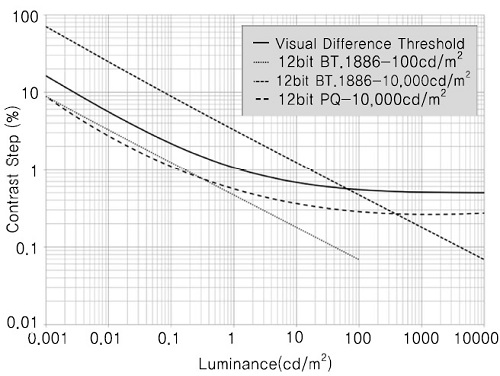

인지시각의 관점에서 인간이 인지할 수 있는 밝기(또는 휘도) 범위는 10-6~108nits이다. nits는 밝기를 나타내는 단위로 단위 면적당 빛의 세기를 나타내기 위해 사용되는 cd/m2 와 동일하다.

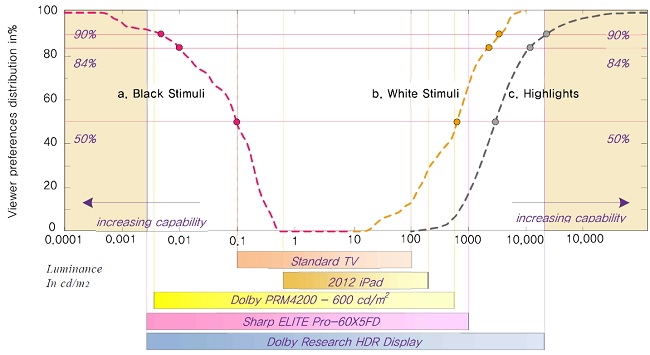

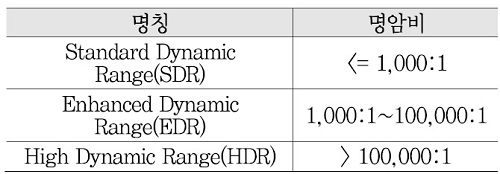

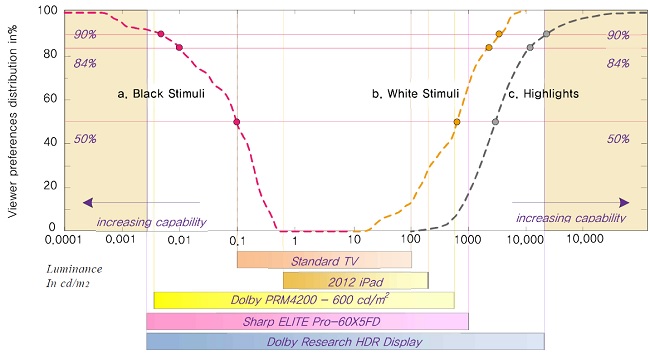

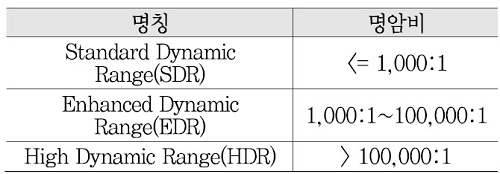

(그림 1)은 사람이 인지하고 디스플레이에서 표현할 수 있는 밝기 범위를 나타낸 그림이다. (그림 1)에서 처 수 있듯이 현재 표준에서 정의하는 TV에서 제공되는 영상의 최대밝기 수준은 120nits 정도이고 일반 디스플레이에서 지원하는 최대밝기 범위도 300~900nits이다. (그림 2)는 현재 개발된 상용 혹은 연구용 디스플레들이 지원하는 밝기 범위와 밝기에 따른 시청자 만족도를 누적분포 함수 형태로 표현한 것이다[2]. (그림 2)에서도 알 수 있듯이 일반 TV를 통해 표현할 수 있는 어두운 영상(Black Stimuli)은 50%, 밝은 영상(White Stimuli)은 20% 정도의 시청자 만족도를 나타내며, 하이라이트와 같은 아주 밝은 부분을 포함하는 영상에 대한 시청자 만족도는 0%에 가깝다. 이는 현재 유통/소비 과정에서 통용되는 영상은 실제환경(Real world)를 표현함에 있어 굉장히 제한된 부분만 표현할 수 있음을 나타낸다. 이에 명암비를 확장함으로 시청자의 영상 밝기에 대한 만족도를 기존 일반 TV에서 제공하는 것 이상으로 끌어올리고자 하는 것이 HDR의 기본 목적이다. 서론에서 언급한 것처럼 HDR의 명암비 현재 비디오 서비스에서 제공되는 명암비인 1,000:1 이상을 의미하기도 하나 표준마다 정확한 정의 및 용어에 대한 차이가 있다. 다음 <표 1>에는 MPEG에서 정의한 명암비에 따른 용어 정의 및 분류를 명시하였다. <표 1>과 같이 MPEG에서는 인간이 휘도순응 없이 볼 수 있는 명암비인 100,000:1 이상을 HDR로 분류하고 있으며 현재 비디오 서비스가 제공하는 수준의 밝기 범위(0.1~100nits)인 명암비 1,000:1 이하를 SDR로 정의하고 있다.

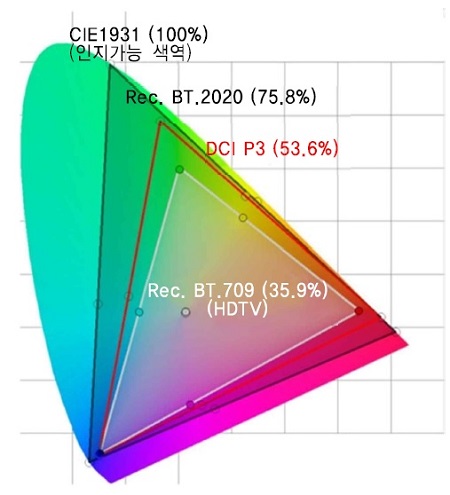

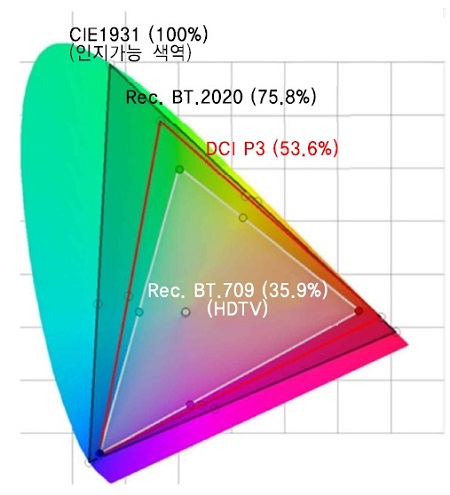

WCG는 색 표현 범위를 넓힘으로써 사실감을 극대화하기 위한 기술로 (그림 3)에서는 CIE 1931에서 정의한 인지 가능한 색역을 기준으로 다양한 표준에서 정의한 색역을 도시하고 있다[3]. 종래 영상 서비스에서 제공하던 색 표현 범위는 BT.709에서 정의된 것으로 CIE1931에서 정의한 인지가능 색역의 35.9% 정도에 해당된다. 이는 고실감 영상 서비스를 제공하는 있어 충분하지 않으며 현재 ATSC, DVB, UHD Alliance, HDMI Forum, UHD Blue-ray Disc Association(BDA) 등의 단체들에서 UHD 신호를 위한 색역 표준으로 BT.2020을 채택함에 따라 BT.2020에 기반 WCG 기술개발 및 표준화에 대한 필요성이 대두되고 있다.

Ⅲ. HDR/WCG 영상 서비스를 위한 기술 및 표준화 동향

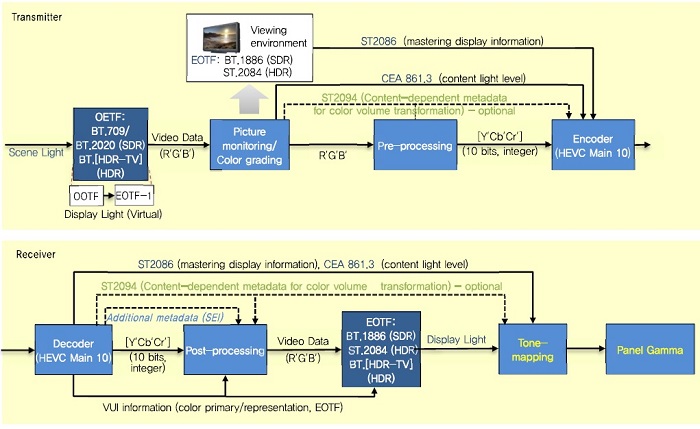

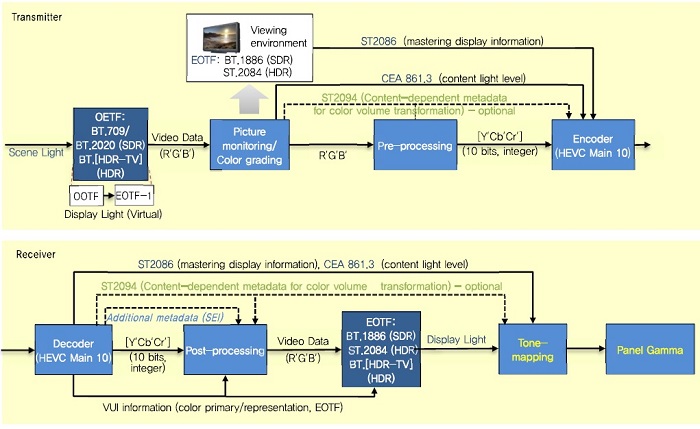

(그림 4)는 HDR/WCG 영상 서비스를 수행하면서 신호의 생성(획득), 송출, 수신 및 재생에 이르는 각 단계를 도식화하였고 각 단계별로 필요한 요소 기술 및 관련 표준들에 대해 간략히 명시하였다. 본고에서는 카메라로부터 획득된 HDR/WCG 신호를 전/후처리 및 전송을 위해 필요한 전자신호로 변환해 주는 Opto-Electrical Transfer Function(OETF: 광전변환함수) 기술과 전자신호를 디스플레이에서 표현하기 위한 광신호로 변환해 주는 Electro-Optical Transfer Function (EOTF: 전광변환함수) 기술, 생성된 신호의 전/후처리에 필요한 정보를 정의하는 메타데이터(Metadata) 기술, 생성된 신호의 압축을 위한 압축 기술과 이를 위한 표준화 동향을 함께 다루고자 한다. 또한, HDR/WCG 기반의 방송 서비스 표준화 동향 및 각종 영화사들과 가전사들을 중심으로 한 HDR/WCG 서비스 규격화 및 표준화 동향들에 대해서도 간략히 살펴보고자 한다.

1. HDR 변환기술

송신단에서 카메라를 통해 들어온 빛은 광전변환을 통해 전자신호로 변환되고 변환된 전자신호는 전/후처리 및 압축을 거쳐 수신단으로 전달된다. 수신단에서 수신된 전자신호는 송신단의 역과정을 거쳐 다시 디스플레이에 광신호로 표현된다. 이때 디스플레이를 통해 표현되는 빛의 특성은 카메라에서 획득되는 빛의 특성과 선형적인 관계를 가지지 않는다. 따라서 카메라와 디스플레이 사이에 적용되는 변환함수를 어떻게 설계하는냐에 따라 디스플레이에서 표현되는 영상과 카메라에서 획득된 영상 간의 상관관계가 크게 달라지게 된다.

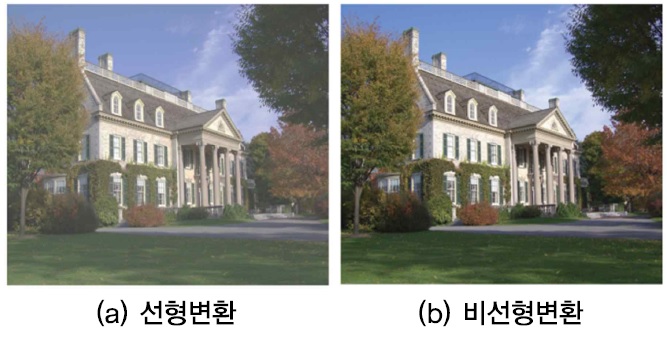

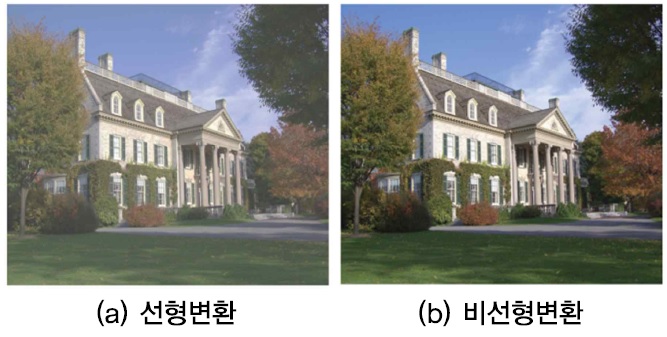

(그림 5)는 변환함수의 특성에 따라 디스플레이에서 표현되는 영상의 화질이 달라짐을 보여주는 예시로 좌측의 영상은 카메라의 입력과 디스플레이의 출력이 선형관계를 가지도록 변환함수를 설계하였다[2]. 좌측영상의 경우, 우측영상과 비교해 전체적으로 영상의 색이 바랜 것 교은 느낌을 준다. 이를 통해 카메라 특성과 디스플레이 특성을 고루 반영한 변환함수를 설계하는 것이 고실감 영상 서비스를 위한 하나의 핵심 기술임을 알 수 있다. 변환과정에 사용되는 주요변환 함수는 다음과 같다.

• Opto-Electrical Transfer Function (OETF: 광전변환함수)

• Electro-Optical Transfer Function (EOTF: 전광변환함수)

• Opto-Optical Transfer Function (OOTF: 광광변환함수)

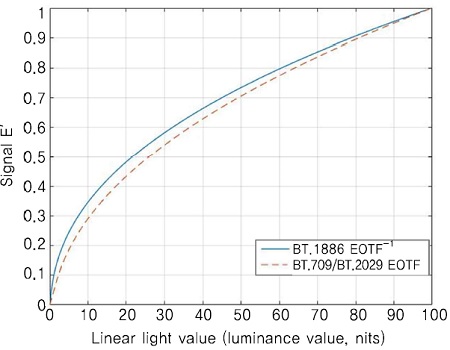

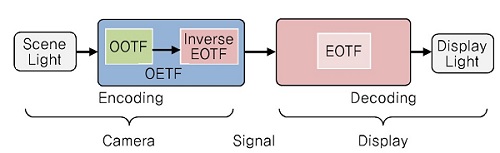

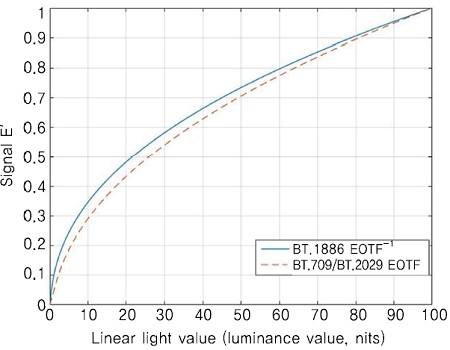

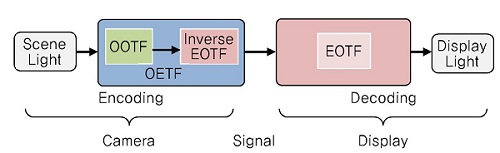

OETF는 선형적인 광신호를 전/후처리 및 압축을 위해 전자신호(또는 비디오 신호)로 변환하는 역할을 수행하며 주로 카메라에서 일어난다. EOTF는 전자신호를 선형적인 광신호 형태로 디스플레이에 출력하는 역할을 수행한다. OOTF는 렌더링 작업을 염두에 둔 변환으로 실제 카메라 환경과 디스플레이 사이에서 발생하는 색조인식(Tonal Perception)의 차이에 대한 보상 및 영상에 제작자의 의도를 담기 위한 용도로 사용되는 변환이다. 제작자의 의도를 반영하기 위해 영상을 변화시키기 위한 과정을 포함한 OOTF을 ‘Artistic OOTF’라고 부른다. 카메라에서 획득되는 광신호는 OOTF를 통한 추가적인 색보정 과정을 거칠 수 있으며 색보정 과정 후 부호화기를 통해 부호화된다. 부호화된 비트스트림은 복호화 및 후처리 과정을 거친 후 EOTF를 통해 디스플레이에서 표현된다. EOTF 및 OETF는 BT.1886[4], BT.709, BT.2020[5]에서 정의한 것을 사용하고 있으며 크게 입력변환인 OETF를 기준으로 변환함수와 역변환함수를 정의하는 방식과 출력변환인 EOTF를 기준으로 변환함수와 역변환함수를 정의하는 방식으로 구분되어진다. BT.1886은 EOTF, BT.709와 BT.2020는 OETF 관점에서 변환함수를 정의하였다. (그림 6)은 BT.1886에서 정의된 EOTF의 역함수인 EOTF-1와 BT.709/ BT.2020에서 정의된 OETF를 각각 나타냈다. 각자 다른 관점에서 설계되었지만 두 함수가 상당히 유사한 변환특성을 가짐을 확인할 수 있다. 기존 100nits에 최적화된 변환함수로 1000nits 이상의 HDR 신호를 변환하는 데 문제가 발생하였고 여러 기관에서 이를 해결하기 위한 새로운 변환함수들을 제안하였다. 변환함수 관련 기술은 주로 ITU-R에서 논의되고 있다. 제안된 기술은 1000nits 이상의 밝기에 최적화된 변환함수 설계에 관한 것으로 입력변환 관점에서 OETF를 설계하는 기술과 출력변환 관점에 EOTF를 설계하는 기술로 나누어지고 이를 ‘Display-referred EOTF’와 ‘scene-referred OETF’라고도 부른다. ‘Scene-referred’ 신호는 입력신호의 밝기 값을 정의함에 있어 카메라에서 획득된 빛의 밝기에 비례하여 생성된 밝기신호를 의미하며, ‘display-referred’ 신호는 출력관점에서 ‘scene-referred’ 신호에 제작자의 의도 등이 반영되어 디스플레이에 표현되는 신호를 의미한다. 우선 ‘display-referred EOTF’를 살펴보면 EOTF를 통해 디스플레이에서 표현되는 신호에 제작자의 의도를 반영하기 (그림 7)과 같이 카메라단 입력에 OOTF를 적용한다. 여기서 OOTF는 제작자의 의도가 포함된 변환함수이고 이를 통해 카메라 입력인 ‘scene-referred’ 신호가 ‘display-referred’ 신호로 변환된다. 다시 ‘Display-referred’ 신호에 EOTF-1를 적용한 신호를 수신단에서 전달받아 EOTF를 적용하면, 콘텐츠 제작자가 제작한 것과 동일한 신호가 생성된다[3].

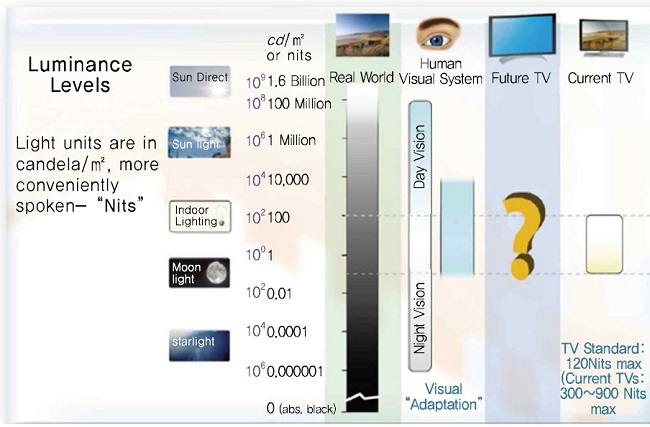

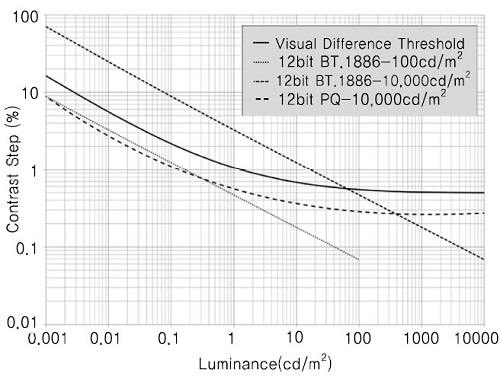

기존 변환함수의 문제점을 개선하기 위해 제안된 EOTF는 주로 인지시각 모델에 기반한 것으로 Dolby, Philips, Technicol-or 등에 의해 제안하였고 특히 Dolby가 제안한 PQ(Perceptual Quantization)-EOTF는 Barten의 인지시각 모델[6]에 기반하여 최대밝기 10,000nits에 최적화된 변환함수로 SMPTE ST2084[7]에 표준으로 규정되었다. (그림 8)은 밝기 변화에 따른 BT.1886 EOTF와 PQ-EOTF 변환곡선의 contrast step 변화량을 나타낸 그림이다. (그림 8)에 표기된 ‘Visual Difference Threshold’는 Barten의 인지시각 모델에 기초하여 설정된 곡선으로 EOTF 곡선이 Barten의 곡선 위에 존재할 경우, imgae banding 같은 열화가 나타날 수 있음을 나타낸다. 또한, 밝기 변화량 대비 contrast step 변화량을 통해 해당 신호를 표현하기 위해 할당되어야 할 codeword의 변화량을 알 수 있다. 기존 방식인 BT.1886 EOTF의 최대밝기를 10,000cd/m2로 조정하였을 경우, 밝기가 100cd/m2 이하인 신호에서는 곡선이 Barten의 곡선 위에 있음으로 열화가 발생함을 알 수 있다. 또한, BT.1886 EOTF의 최대밝기를 100cd/m2로 조정하였을 경우, 밝기가 1cd/m2 이상인 경우, Barten 곡선이나 PQ-EOTF에 비해 밝기 변환 대비 contrast step 변화량이 큼으로 이를 표현하기 위해 더 많은 코드워드가 할당되야함을 알 수 있다. PQ-EOTF의 경우, 모든 구간에서 Barten 곡선 아래에 존재하고 밝기 값이 커짐에 따라 이를 표현하기 위한 코드워드의 할당폭이 감소함을 알 수 있다. Philips에서도 Dolby와 유사한 인지시각 모델 기반의 EOTF를 제안하였고 제안한 EOTF는 5,000nits에 최적화되었다.

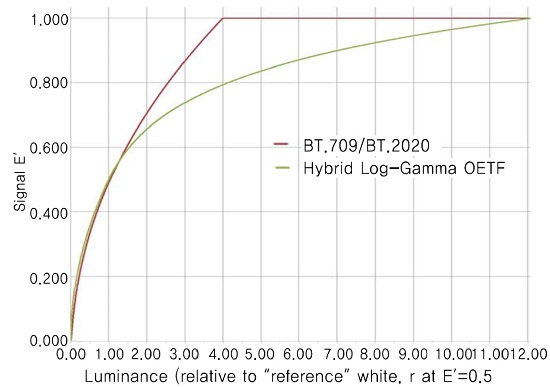

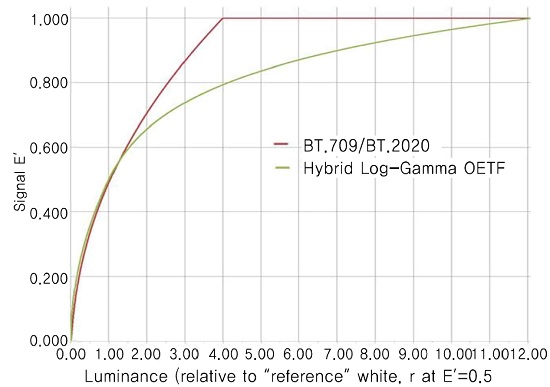

‘Display-referred EOTF’의 경우 EOTF가 적용되는 수신단에서 사용되는 디스플레이의 최대밝기가 레퍼런스 디스플레이의 최대밝기보다 작은 경우, HDR 신호를 표현하기 위해 tone mapping과 같은 추가 보정 과정을 거쳐야 하는 문제가 발생한다. 이러한 문제는 NHK와 BBC에 의해 제기되었고, 이를 해결하는 방안으로 NHK와 BBC는 nits 단위의 절대적인 밝기 값이 아닌 카메라의 출력으로 제공되는 상대적인 신호 밝기 값을 사용하는 ‘scene-referred OETF’를 제안하였다. 이는 신호를 절대 밝기 값이 아닌 상대밝기 값으로 표현한 scene-referred 신호에 OETF를 적용하여 수신단에 전달함으로 수신단에서도 신호를 표현함에 있어 디스플레이의 최대밝기 대한 상대밝기로 표현함으로 ‘display-referred EOTF’에서의 발생하는 문제를 해결하였다. 또한, 이 방식은 SDR 신호에 대한 역호환성도 제공한다. NHK와 BBC가 제안한 OETF는 저계조 부분에서 SDR 신호를 위한 OETF인 BT.709/BT.2020의 Gamma 함수를 이용하고 고계조 부분에서 해당 부분의 인지 시각특성을 일정 부분 고려한 Log 함수를 이용하여 OETF를 설계하였고 이를 HLG(Hybrid Log-Gamma)-OETF라고 명명하였다. HLG OETF는 기준이 되는 ‘reference white’의 밝기신호를 전자신호 ‘0.5’로 매핑하고, ‘reference white’ 밝기의 12배 밝기를 가지는 신호까지 전자신호로 변환 가능하도록 설계되었다[3]. (그림 9)에는 HLG-OETF의 변환곡선이 나타나 있다. HLG OETF가 ‘PQ-EOTF’의 문제점을 해결하였음에도 불구하고 해당 모델이 Barten의 인지시각 모델에 최적화 되어 있지 않다는 것과 더불어, SDR 신호의 경우 BT.709에 정의되어 있는 OETF 조차도 실제 비디오 제작 과정에서 일반적으로 사용되고 있지 않다는 점이 단점으로 지적 받고 있다. 또한, OETF는 입력 변환을 고정함으로 입력단에서 카메라 제조사 별 고유 특성을 카메라에 반영하는데 있어서도 제약이 발생하는 문제점도 있다.

상기 업급된 문제점들이 있음에도 불구하고 2016년 2월 ITU-R BT.[HDR-TV] 권고안을 통해 PQ-EOTF와 HLG-OETF 기반의 콘텐츠 제작 및 방송을 위한 HDR 파라미터들을 정의하였고 BT.2390을 통해 HDR의 기본 개념, PQ-EOTF와 HLG-OETF에 대한 상세소개 및 HLG 신호와 PQ 신호 상호 간의 변환방법 등을 소개하였다[8].

2. 후처리를 위한 메타데이터

앞에서 언급했듯이 PQ-EOTF 사용 시, 수신단과 송신단 디스플레이의 사이의 최대밝기 차이로 문제가 발생할 수 있고 이를 보정하기 위한 추가 작업들이 필요하다. 이런 추가적인 보정 작업을 위한 부가 정보들을 정의한 것이 메타데이터의 주요 내용이다. 후처리를 위한 메타데이터에는 크게 정적 메타데이터(Static Meta-data)와 동적 메타데이터(Dynamic Metadata)로 정의된다. 정적 메타데이터에 대한 표준화는 주로 SMPTE와 Consumer Electronics Association(CEA)에서 진행되었다. SMPTE ST2086[9]에서는 레퍼런스 모니터의 색역(colour primaries), 백색점(white point), 밝기 범위(luminance range) 정보 등을 메타데이터로 정의하여 2014년 10월 표준으로 공표하였고, CEA 861.3[10]에서는 비디오 신호의 최대밝기(Maximum Content Light Level)와 각 프레임별 최대밝기의 평균 값(Maximum Frame Average Light Level)을 메타데이터로 정의하여 2015년 1월 표준으로 공표하였다. SMPTE ST2086과 CEA 861.3에서 정의한 메타데이터는 모두 High Efficiency Video Coding(HEVC) 표준화에 제안되었으며 HEVC 표준에서는 이를 Supplemental Enhancement Information(SEI) message로 정의하였다.

수신단의 디스플레이를 통해 HDR/WCG 콘텐츠를 표현함에 있어 수신단의 디스플레이의 색역(또는 색재현)이 마스터링 단계에서 사용한 디스플레이보다 작을 경우, 수신단에서는 HDR/WCG 신호를 수신단의 색역에 맞게 변환하는 작업이 필요하다. 이를 ‘color volume transformation’이라 하며 동적 메타데이터는 ‘color volume transformation’에 필요한 정보들을 메타데이터 집합(metadata set) 형태로 정의한 것을 말한다. 특히 SMPTE ST2094에서는 BT.709 색역을 지원하는 SDR 디스플레이에서 HDR/WCG 콘텐츠를 재현하기 위한 메타데이터를 다루고 있으며 이와 관련하여 Dolby, Philips, Technicolor, 삼성 등이 참여하였다. SMPTE ST2094[11]는 총 6개의 문서로 구성되어 있으며 ST2094-1에는 ST2094의 다른 하위 문서에서 사용하기 위한 ‘transformation metadata set’ 및 ‘metadata paremeter’ 같은 공통 정의들이 기술되어 있다. ST2094-2에서는 ‘Syntax’ 와 ‘Carrier’ 같이 다른 문서에서 정의한 메타데이터들을 표현하는 방식에 대해 정의하기로 되어있었으나 구체적인 진행은 되지 않은 상태이다. ST2094-10/ST2094-20/ST2094-30/ST2094 -40은 특정 응용에 따른 메타데이터들을 정의하였고 주로 ‘color transformation’의 주요 방법인 ‘color volume mapping’과 ‘tone mapping’에 필요한 메타데이트를 주로 다루고 있다.

3. HDR/WCG 비디오 부호화 기술

HEVC는 2013년 1월 표준이 완료된 비디오 압축 표준이다. 최근 HDR/WCG 영상 서비스에 대한 관심이 높아짐에 따라 MPEG에서는 제 108차(2014년 4월) 회의를 통해 HDR/WCG 영상 압축을 위한 표준화 논의를 시작하였고 제 111차(2015년 2월) 회의에서 HEVC 기반 HDR/WCG 비디오 부호화를 위한 CfE(Call for Evidence)를 발행하였다[12]. CfE에 기술된 HDR/WCG 비디오 부호화 기술 분야는 크게 세 가지 Category로 나눌 수 있으며, Category 1은 HEVC Main10 Profile을 적용한 CfE anchor 대비 부호화 효율을 높일 수 있는 Normative 부호화 기술, Category 2는 SDR을 지원하는 Backward compatibility 기술, Category 3는 HEVC 표준의 변경 없이 전/후처리 및 인코더 최적화를 통한 부호화 기술을 정의하고 있다. 이후 제112차(2015년 6월) MPEG회의에서 CfE에 대한 응답으로 Dolby, Technicolor, Qualcomm, Ericsson, Apple, Philips 등을 필두로 총 9개의 기고서가 제안되었으며, 세 가지 Category 중 Category 1과 3에 대해서만 각 기관들이 CfE를 대응하였다. 관련 기고서 중에서 카테고리 1에 해당하는 제안 기술들은 HEVC 표준의 Normative change에 관련된 것이었으나 실제로 기고서상의 제안 기술들은 VUI, SEI message 등으로 메타데이타를 전송하여 SDR과의 역호환성을 지원하는 접근이 대부분이었으며 HEVC 표준을 수정하는 Normative change에 대한 기술은 없었다. 표준화 일정상 상기 회의를 통해 HDR/WCG 비디오 부호화 표준을 위한 Call for Proposal(CfP)을 발간하기로 예정되어 있었으나 VCEG 과의 논의 가운데 JCT-VC에서 공동으로 표준화를 진행하는 것이 결렬되었고, MPEG 에서는 ‘fast track’으로 진행하기로 결정되었다. 제113차(2015년 10월) MPEG회의에서 HDR/WCG 표준화를 위한 실험영상 선정 및 공통실험조건이 결정되었으며, 차기 회의부터 JCT-VC에서 HDR/WCG 표준화를 공동으로 진행하기로 결정되었다. 더불어 당시 회의를 통해 MPEG HDR/WCG CfE에서 사용된 Anchor를 개선하기 위한 Ericsson 제안기술 2건이 채택되었으며, HDR/WCG test model(H2M) First draft가 발행되었다. 가장 최근 표준화 회의인 제114차(2016년 2월) MPEG 및 제23차 JCT-VC 회의에서 직전 표준화 회의에서 정의된 실험영상 및 공통실험조건 환경하에서 기존 HEVC Main10 기반 부호화 및 HEVC Main10에 Reshaper를 적용한 코덱으로 영상을 부호화하여, MPEG Test chair의 주관으로 SIM2 display를 통한 주관적 화질 비교 평가를 진행하였다. 그 결과, HDR/WCG 비디오 부호화를 보다 효과적으로 제공할 수 있는 신규 Normative 기술은 없다는 결론을 내리고 향후 HDR/WCG 비디오 부호화를 위한 신규 표준화 작업을 진행하지 않을 것을 최종결정하였다. 이에 HDR/WCG를 표준화를 진행하는 대신, HDR/WCG 비디오를 보다 잘 부호화할 수 있는 Guideline을 제공하는 데 향후 초점을 맞출 것을 동의하였다.

4. HDR/WCG 비디오 서비스 표준화 동향

HDR/WCG 비디오 기반의 방송 서비스 표준화를 위한 논의는 주로 DVB, ATSC를 통해 진행되고 있다. DVB는 2015년 11월 완료한 UHD-1 Phase 2 요구사항에 UHDTV에서 HDR/WCG 지원을 위한 요구사항들을 정의하였으며 ATSC에서는 ATSC 3.0 기반의 HDR/ WCG 비디오 서비스 제공을 위한 기술들을 2015년 9월 회의를 통해 제안받아 이에 대한 평가를 진행하고 있다. 방송 서비스를 위한 표준화 이외에 최근 헐리우드 영화사들 및 가전사들을 중심으로 Digital Entertainment Content Ecosystem(DECE), BDA, CEA, UHDA(UHD Alliance) 같은 단체들이 결성되었으며 HDR/WCG 기술을 기반으로 콘텐츠 제작 및 유통 그리고 관련 장비 개발을 위한 표준 규격을 발표하고 있다. DECE는 2015년 2월 ‘HDR10 Media Profile’ 이라는 이름으로 관련 규격을 발표하였고 추후 메타데이터에 대한 규격으로 SMPTE ST2086와 CEA861.3을 추가하였다[13]. BDA는 Ultra HD Blu-ray에 대한 표준으로 HDR10 Media Profile 규격을 적용하기로 하였으며 CEA 역시 ‘HDR 호환 비디오 디스플레이(HDR compatible video displays)’를 위한 산업 규격으로 ‘HDR10 Media Profile’ 규격을 채용하였다. ‘HDR10 Media Profile’ 주요 내용은 아래와 같다.

• Color Primaries: ITU-R BT.2020

• Transfer function: SMPTE ST2084

• Color Representation: Non-Constant Lumi-nance(NCL) defined in BT.2020

• Color Sampling: 4:2:0 (for compressed video sources)

• Bit Depth: 10bits

• Metadata: SMPTE ST2086, CEA 861.3

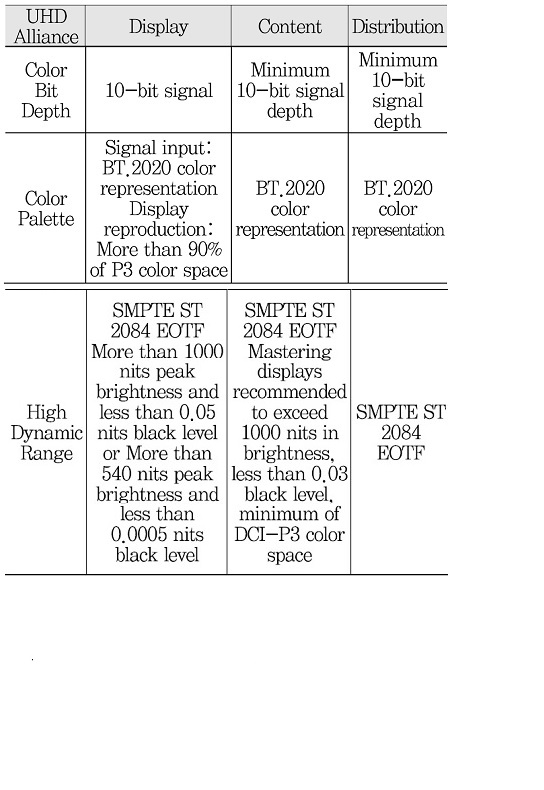

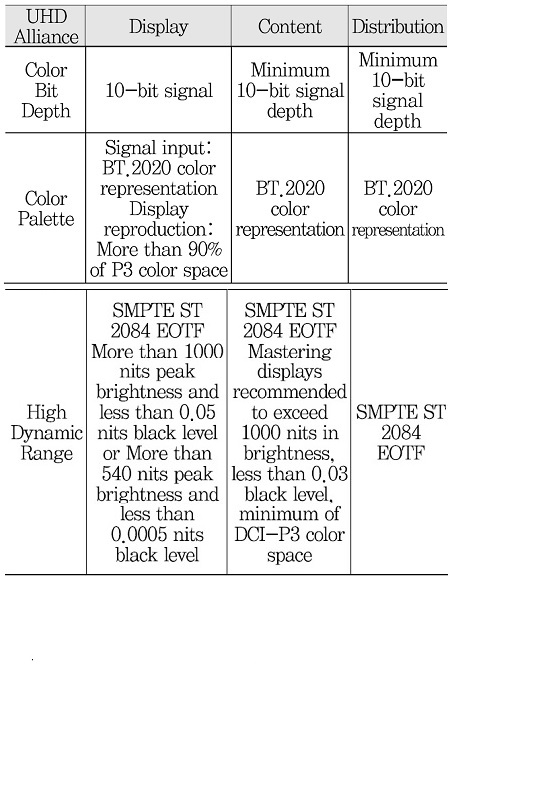

UHDA 역시 HDR 및 WCG 비디오 서비스 제공을 위한 규격의 토대를 마련하였으며 주요 내용은 <표 2>와 같다[14]. 관련 규격은 디바이스(디스플레이)와 콘텐츠 제작, 유통 또는 배포의 측면으로 나누어 정의하였으며 주요 내용은 ‘HDR10 Media Profile’과 유사하다.

Ⅳ. 결론

본고를 통해 HDR/WCG의 개념 및 HDR/WCG를 위한 각종 요소 기술들과 관련 표준화 동향을 함께 살펴보았다. HDR/WCG 기술은 영상의 사실감을 극대화시킴으로서 기존의 영상서비스와 차별되는 고품질 영상서비스를 할 수 있다는 것 있다는 점에서 큰 장점이 있고 다양한 연구와 Cousumer Electronis Show(CES)나 National Association of Broadcasters(NAB) Show와 같은 전시회를 통해 이 사실이 입증되고 있다. 각종 전시회를 통해 관련 장비들이 쏟아져나오고 있으며 빠른 서비스를 위한 표준화 역시 급속히 진행되고 있어 HDR/WCG를 이용한 영상 서비스에 대한 전망은 굉장히 밝을 것으로 사료된다.

약어 정리

BDA

Blue-ray Disc Association

CEA

Consumer Electronics Association

CES

Cousumer Electronis Show

CFP

Call for Proposal

DECE

Digital Entertainment Content Ecosystem

EDR

Enhanced Dynamic Range

EOTF

Electro-Optical Transfer Function

HDR

High Dynamic Range

HEVC

High Efficiency Video Coding

NAB

National Association of Broadcasters

OETF

Opto-Electrical Transfer Function

OOTF

Optical-to-Optical Transfer Function

SDR

Standard Dynamic Range

SEI

Supplemental Enhancement Information

UHD

Ultra High Definition

UHDA

UHD Alliance

WCG

Wide Color Gamut

References

(그림 1)

휘도레벨에 따른 인지특성 및 재현특성 비교

(그림 2)

밝기변화에 따른 누적 인지율 및 디스플레이의 밝기표현 범위

<표 1>

명암비에 따른 명칭 정의

(그림 3)

표준별 정의된 색역범위 및 인지율

(그림 4)

HDR/WCG 영상 서비스를 위한 제작 및 송수신 흐름도 및 관련 표준

(그림 5)

변환함수에 따른 화질 비교

(그림 6)

EOTF(BT.1886)와 OETF(BT.709/BT.2020) 변환함수 비교

(그림 7)

카메라단에서 적용된 OOTF 예시

(그림 8)

밝기 변화에 따른 Contrast Step 변화

(그림 9)

BT.709/BT.2020-OETF vs HLG-OETF

<표 2>

UHDA 관련 주요 규격