자율주행차 및 스마트카용 라이다 3차원 영상센서 기술개발 동향 및 전망

Development Trends and Expectations of Three-Dimensional Imager based on LIDAR Technology for Autonomous Smart Car Navigation

- 저자

- 최규동, 한문현, 송민협, 서홍석, 김철영, 홍성철, 민봉기 / 광융합플랫폼연구실

- 권호

- 31권 4호 (통권 160)

- 논문구분

- 일반 논문

- 페이지

- 86-97

- 발행일자

- 2016.08.01

- DOI

- 10.22648/ETRI.2016.J.310409

- 초록

- 빛의 반사시간 및 산란정보를 측정하여 기상정보를 수집하던 초기 라이다 기술은 실내외 3차원 정보를 확보하는 센서 기술로 응용 영역을 확대하고 있다. 특히 최근에는 자율주행차/스마트카를 중심으로 차량/보행자의 안전과 고도화된 자율주행 성능을 위하여 차량 주변 환경에 대한 3차원 좌표를 고속으로 획득하는 라이다 기술의 중요성이 부각되고 있으며, 이에 따라 관련 기술에 대한 이해와 동향파악이 필요하다. 이에 본고에서는 차량에 적용될 수 있는 라이다 기반 3차원 영상센서 기술 전반에 대한 리뷰를 진행하고, 자율주행차/스마트카 시장에서 핵심이슈 및 기술별 대응 특징을 소개한다. 아울러 3차원 센서기술의 글로벌 경쟁상황을 기반으로 향후 차량용 라이다 기술의 발전방향을 전망해 본다.

Share

Ⅰ. 라이다 기술 개요

라이다 기술의 원리는 레이저가 개발되기 전에 사용되었다. 최초의 라이다 기술은 1930년대 대기권의 공기 밀도를 측정하기 위해서 탐조등 빔을 이용해 산란 강도를 파악하는 데 이용되었다. 이때 높이정보는 원거리 망원경으로 볼 수 있는 영역의 수신부가 연속적인 빛의 빔을 따라 스캐닝 되면서 얻어졌고, 그 후 1938년에 구름의 높이를 측정하기 위해서 펄스 타입의 빛이 처음으로 사용 되었다[1].

이후 현대 라이다 기술은 1960년대 초 레이저가 발명되고, laser의 초점 이미지와 신호가 돌아오는데 걸리는 시간을 측정함으로써 거리를 계산하는 radar(RAdio Detection And Ranging: RADAR)기술이 결합되면서 급속하게 발전하였다. ‘lidar’ 어원도 light와 radar의 합성어로 1963년에 처음 사용되었다. 그 후 1970년 초 보다 넓은 의미가 있는 ‘LIght Detection And Ranging’ 또는 레이저 광원을 활용하는 ‘Laser Imaging, Detection and Ranging’의 약자로 LIDAR 용어가 사용되었다[2].

비교적 간단한 아이디어에서 출발한 라이다 기술이지만, 이후 이용하는 레이저 파장을 변경하고, 반사된 신호를 분석하는 기법에 대한 연구가 이루어지면서 다양한 응용분야에 적용하게 되었다. 라이다 기술은 파장에 따라서 사용되는 응용분야가 다르다. 250nm의 ultraviolet은 기상관련 분야에 사용하고, 500~600nm의 visible 영역은 수심 측량, 1040~1060nm의 near-infrared 영역은 지형 맵핑에 사용한다. 그리고 1500~ 2000nm의 infrared 영역은 기상 측정 분야에 사용되며 특히 Doppler LIDAR에 사용되고 있다[3]. 그중 1550nm 파장 대역은 시각 안전 파장으로 최근 차량용 및 로봇 등으로 응용 영역을 넓히고 있으며, 시각에 안전하면서도 눈에 보이지 않는 대역으로 군용 기술에도 적극적으로 활용되고 있다[2].

Ⅱ. 자율주행차/스마트카를 위한 라이다 기술

2010년 이후로 자율주행차 및 스마트카 분야는 구글, 애플, 테슬러 모터스, 우버, 크루즈 오토메이션, 뉴토노미, 리프트 등의 다양한 글로벌 IT업체와 토요다, 현대자동차, BMW, 메르세데스, 볼보, 지엠, 포드 등 완성차 업체가 다양한 방식으로 서비스 시연 및 연구개발을 하면서 더욱 뜨겁게 이슈가 되고 있는 분야이다. 자율주행차 및 스마트카 기술이 뜨겁게 떠오르면서 다양한 상황인지 센서 기술들도 급속하게 발전하고 있다. 특히 자율주행 기술을 연구하는 모든 차량에는 핵심 센서 기술로 라이다가 채택되어 있고, 구글, 포드, GM 등은 높은 해상도의 3차원 위치 정보를 확보하기 위해 고해상도 라이다 센서모듈을 적용하거나 저해상도 라이다 센서모듈을 다수로 배치하여 고해상도 영상 정보를 3차원으로 검출하고 있으며[4], 추가적인 성능 개선 및 요구사항 만족을 위해 다양한 방식의 실외용 라이다 기술을 적극적으로 활용하고 있다.

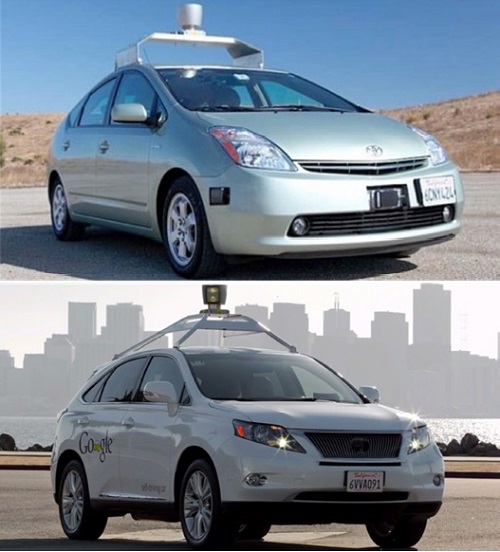

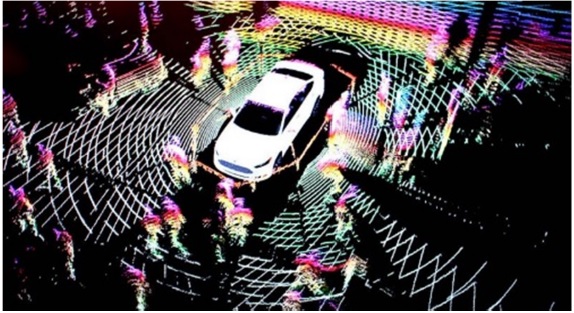

실제 도로에서 자동차 자율주행 기술을 시연하고, 기술적으로도 가장 진보한 기술을 확보한 구글 자율주행차[(그림 7) 참조] 기술의 성공은 인공지능, 기계학습 그리고 딥러닝과 관련된 소프트웨어 설계능력에 기반한 것이지만, 소프트웨어의 구동에 필수적이면서도 우수한 성능을 확보하는데 핵심적인 데이타는 주변상황에 대한 3차원 영상센서에 의하여 획득된다.

현재 관련업계에서 자율이동 및 자율주행을 지원하기 위해 기술적 개선의 필요성이 가장 큰 요소로 평가되는 것은 해상도와 센서모듈 가격이다. 즉 최소 비용으로 주변 공간에 대한 최대 분해능의 3차원 정보 획득을 요구하고 있다. 기존의 센서들로는 이러한 높은 수준의 분해능으로 3차원 공간정보를 확보하기 어렵기 때문에 라이다 기술이 자율주행 자동차 시대의 핵심 센서로 인식되고 있다[4]. 실제 요구되는 성능 및 가격 조건은 자율주행 레벨 및 애플리케이션에 따라서 다르지만 차량용 라이다 센서는 주·야간 구분 없이 100m 이상 범위의 주변 상황에 대한 고해상도 3차원 공간정보 검출이 가능하도록 해야 한다.

차량 및 보행자의 안정성 확보를 위하여 충분한 정보(Redundancy)를 제공하는 것은 매우 중요하다. 빛을 조사 후 검출하는 액티브 방식 라이다 기술과 더불어 차량에 탑재된 다양한 센서 기술들을 조합하여 함께 활용하면 매우 우수하면서 안정성 있는 센서 기술을 제공할 수 있지만, 라이다 기술이 제공하는 공간 분해능은 다른 센서 기술의 조합으로도 확보하기 어려운 성능으로 자율주행 자동차의 다양한 센서 중에서 라이다 센서기술은 전략적으로 매우 중요한 요소이다. 구글 자율주행차의 성공은 바로 이러한 요소를 파악하여, 개발 초기에 우수한 공간 분해능의 정보를 제공하는 라이다 모듈(실제로 적용된 모델은 Velodyne사의 HDL-64 모델)의 특징을 충분히 활용하였고, 이를 중심으로 하여 관련 자율주행 소프트웨어 기술을 비약적으로 발전시켰기 때문에 빠른 시간에 성공적인 시연이 가능하였다.

이와 같은 글로벌 IT 기업이 자율주행 자동차 분야에서 이룬 기술혁명은 기존 글로벌 완성차 기업과 산업에도 커다란 자극이 되었으며, 이는 기존에 존재하던 차량의 첨단운전보조시스템(Advanced Driver Assistance Systems: ADAS)을 더욱 발전시켜 자율주행 기능을 가속화하는 방향으로 연구개발 및 관련 투자를 이끌어내고 있다. 특히 고속도로에서 자동차선 변경 등의 기능을 지원하면서 레이다와 비젼을 사용하던 기존 방식으로는 자율주행을 위한 성능이 충분하지 않아 글로벌 IT기업과 동일하게 라이다 기술을 필수적으로 채택하고 있다. 다만 비교적 단순한 수준의 자율주행에는 상대적으로 낮은 성능의 저가격 저해상도 라이다가 활용되는 추세이다.

Ⅲ. 글로벌 차량용 라이다 기술 그룹

원격 탐지(Remote Sensing) 방식으로 전방 또는 주변 공간에 대한 3차원 정보를 획득하는 라이다 기술은 다양한 방식으로 구현할 수 있다. 레이저(빛)를 조사하는 능동형 라이다 기술과 레이저를 조사하지 않는 수동형 라이다 기술로 나누어질 수 있는데, 본고에서는 주야간 모두 사용해야 하는 차량용 센서에 더 적합한 능동형 라이다 기술에 대해 세부적인 특징을 살펴보고자 한다.

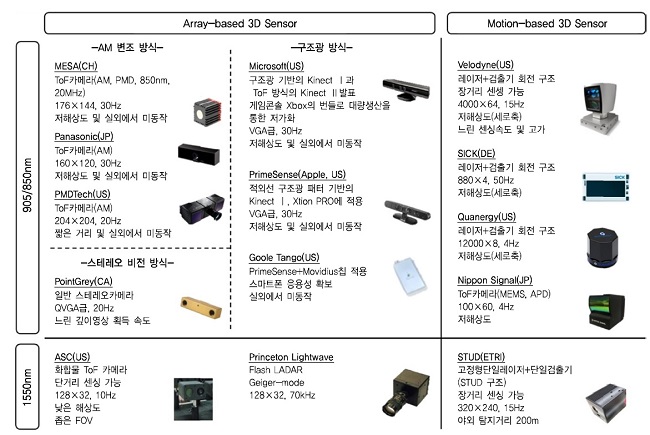

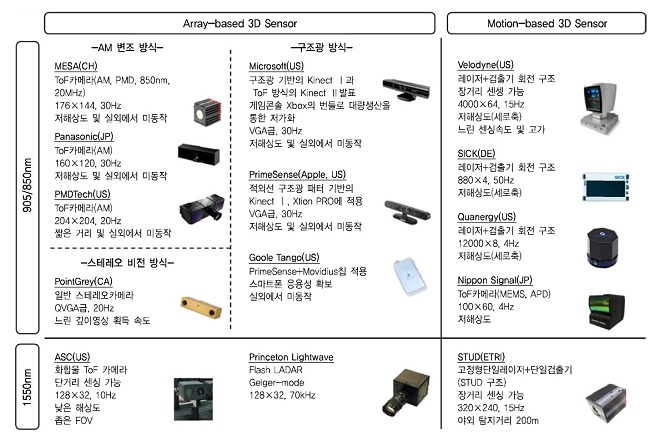

능동형 라이다 기술은 두 가지 요소, 즉 검출에 응용되는 파장과 검출기의 구성형태에 따라서 크게 4가지 유형[(그림 2) 참조]으로 구분이 가능하다. 또한, 제시된 기술그룹들은 허용 가능한 입사 배경광 수준, 빛의 조사 방식, 조사되는 빛의 수준, 그리고 검출기의 민감도(Sensitivity)에 따라서 3차원 영상획득이 실내용으로 제약이 되는 경우도 있고, 실내외 겸용으로 사용이 가능한 경우도 있다.

3차원 라이다 센서가 실외용으로 성능상 제약 없이 활용되기 위해서 해결되어야 할 가장 큰 문제점 중 하나는 태양광으로 인한 조도 변화에 대한 대응이다. 일반적으로 직사광선에 닿는 표면의 밝기는 최대 7~8만 lux 수준에 해당하며 라이다 센서가 야외에서 문제없이 동작하기 위해서는 이러한 조도에서도 반사된 레이저 신호를 안정적으로 검출할 수 있도록 개발되어야 한다. 이를 위해서는 기본적으로 광 검출기의 감도가 우수해야 할 뿐만 아니라, 배경광에 대한 대책이 수립되어야 하고, 또한 빛을 조사하는 파워가 배경광에 의하여 발생하는 노이즈 보다 더 큰 신호를 확보할 만큼 충분한 신호대잡음비(Signal-to-noise ratio)를 확보해야 한다. 특히 빛을 조사하는 광 송광부에서 출력되는 광 파워는 시각안전 등급 Class 1을 만족하고, 최종 라이다 모듈의 시각안전성이 확보될 수 있도록 구성되어야 한다.

라이다 기술의 구성 요소에 따라서 회전하는 구조체를 가진 회전형 라이다 기술, 광 검출기를 어레이로 구성하여 반사된 파형의 시간차이를 어레이로 인식하는 어레이형 라이다 기술, 그리고 마지막으로 두 가지 방식의 단점을 보완한 스터드 라이다 기술로 나누어 설명을 진행한다. 설명의 편의를 위하여 어레이형 라이다 기술의 경우 이용되는 광 검출기의 종류에 따라 화합물과 실리콘 방식으로 분리하였다.

1. 회전형 라이다 기술

라이다에 응용되는 파장은 (그림 2)에서 구분된 바와 같이 시각안전파장으로 알려진 1,550nm 대역과 실리콘 광 검출기를 이용할 수 있는 850nm 및 905nm 대역의 부근을 이용하는 기술로 나누어진다. 일반적으로 상용 광원 부품이 많이 나와 있는 830~850nm 대역과 905nm 대역이 이용되는데, 이 대역은 가시광선 대역에서 벗어나 있어 눈에 보이지 않으면서도 화합물 광 검출기보다 상대적으로 저렴한 가격의 실리콘 광 검출기를 이용할 수 있는 장점이 있다. 하지만 일반적으로 해당 파장 대역에서는 실리콘 광 검출기의 공정 최적화를 거쳐도 광 검출 효율이 5% 미만 수준으로 떨어져서 일반 가시광선을 이용하는 실리콘 광 검출기의 성능에 크게 미치지 못하는 수준이다. 이러한 단점에도 불구하고 저렴한 방식으로 라이다 모듈을 구성할 수 있어서 상용화 및 응용이 가장 활발한 방식이다. 그러나 실제 응용에서는 앞서 언급한 이유로 검출성능이 낮아서 탐지거리가 줄어드는 것이 일반적인데, 이를 억제하기 위해서는 송광 신호를 크게 하거나, 수광되는 신호를 크게 하려고 송광되는 빔의 퍼지는 정도를 최대한 줄이는 방식이 이용된다. 송광신호를 키우는 것은 시각안전 문제로 한계가 있어 실제로는 빔 퍼짐 정도를 최대한 줄여서 목표물에 닿는 스팟을 줄이는 방식을 활용하고, 이 스팟을 하나의 광 검출기로 검출하는 방식을 이용하여 검출거리를 반사율 90%에서 100미터 내외까지 증가시킬 수 있다. 결국, 실제 구현은 송광되는 빔의 크기를 일정한 수준으로 유지되는 상태(collimated beam)로 다수의 레이저를 수직방향으로 배치하여 송광하고, 이 빛에 쌍을 이루는 다수의 수광 채널을 두어 이를 수평 방향으로 회전함으로써 100미터 내외의 3차원 영상 확보가 가능하다. 기술적으로 가장 간단하기 때문에 (그림 3)과 같이 가장 많은 상용제품이 개발 및 판매되고 있다. 하지만 이 방식의 기술이 차량용으로 사용되기에는 두 가지 문제점이 있다. 첫째는 자율주행 수준이 높아질수록 중요해지는 수직해상도가 높아야 되는 경우, 송수광부 쌍을 송수광 렌즈 뒷면에 배치하기 때문에 전체 모듈의 부피가 급격하게 커지는 문제점이 있다. 두 번째는 송수광부와 본체 사이의 전기적인 연결을 유지하면서 회전을 해야 하는 방식으로 슬립링 등의 특성에 의하여 수명 및 센서 동작 안정성의 개선이 필요하다.

2. 화합물 어레이형 라이다 기술

어레이형 라이다 기술은 수광부 픽셀을 N×M형태로 세로와 가로로 다수를 배치하는데 이 어레이의 배치가 바로 최종 3차원 영상 해상도의 기준이 되는 방식이다. 또한, 광 검출을 위한 수광부가 어레이로 배치되어 있기 때문에 송광부는 빛을 퍼트려서 보내는 방식을 주로 사용한다. 이때 실리콘 광 검출기가 검출할 수 있는 파장 대역의 광 파워보다 1,000배 이상 높은 에너지를 사용하더라도 눈에 안정적인 1,550nm 파장 대역을 사용하는 경우, 앞서 설명한 바와 같이 시각안전 특징이 있어 비교적 넓은 영역의 탐지거리 확보가 가능하다. 하지만, 저렴한 실리콘이 아닌 상대적으로 고가의 화합물 광 검출기를 사용해야 하며, 검출신호의 병렬 처리를 위한 Readout IC(ROIC)도 동일하게 2차원 어레이 구조로 제작해야 하는 문제점이 있다. 또한, 픽셀 크기로 제한된 영역의 회로에서 픽셀 별로 발생하는 신호를 고속 및 저잡음으로 병렬 처리하여 거리 및 반사 신호의 세기 등을 추출하도록 해야 한다. 결국, 이러한 기술상의 제약조건과 높은 비용구도의 화합물 광 검출기 어레이 및 ROIC 제작의 어려움으로 인하여 최종적으로 차량용에 불리한 고가의 솔루션이 될 수밖에 없다. 또한, 이 방식[(그림 4a) 참조]은 앞서 언급한 바와 같이 빔을 퍼트리는(diffuse) 방식으로 인하여 상대적으로 높은 레이저 파워(피크파워 기준 약 1MW)를 필요로 하므로 내구성 및 프레임 레이트 개선 등에 한계를 가지게 된다. 이러한 고출력 광원의 문제를 해결할 수 있는 방법으로 2차원 화합물 광 검출기 어레이를 단일광자 광 검출모드(Geiger-mode, 가이거모드)로 활용하는 방법이 있다[(그림 4b) 참조]. 이 방식의 경우 단일 광자 수준의 낮은 광 수신 파워로도 검출이 가능하여 고출력 레이저 광원이 필요하지 않으며, 고출력 레이저로 인하여 발생할 수 있는 단점을 보완할 수 있다. 하지만 단일광자를 검출하기 위한 방법인 가이거모드 자체가 가지는 고유의 노이즈원인 Dark count 및 After pulsing 효과는 획득된 3차원 영상에 심각한 노이즈 발생원으로 작용하여 통계적 데이터 처리와 같은 충분한 신호처리를 해야만 실제 차량용으로 응용할 수 있어 이에 대한 대책이 필요하다.

3. 실리콘 어레이형 라이다 기술

앞서 설명된 바와 같이 화합물 어레이 방식은 화합물 어레이 및 ROIC로 인하여 저가형 솔루션으로 만들기에는 한계가 있다. 이러한 문제에 대한 해법으로 제시되고 있는 방법 중 하나가 저렴한 실리콘 광 검출기 어레이를 활용하는 것이다[(그림 5) 참조]. 이 방법은 기존의 Com-plementary Metal–Oxide–Semiconductor(CMOS) 이미지 센서 또는 Charge Coupled Device(CCD) 비젼 센서에 존재하는 픽셀을 변형하여 아날로그 또는 디지털 방식으로 변조된 빛을 조사한 후 수광되는 빛의 상대적인 위상을 추출하도록 활용한 방식이다. 이 방식은 실리콘에서 흡수가 가능하도록 하기 위해 응용파장을 830~905nm 대역으로 두어야 하고, 따라서 시각에 안전하지 않은 문제점을 안고 있기 때문에 1550nm 파장과는 달리 사용이 가능한 최대 광 파워가 매우 제약적인 것이 특징이다. 하지만 기존의 이미지센서 칩들과 같이 다양한 CMOS 회로 기법 및 신호처리 기법을 이용하여 최대한 저잡음 상태에서 검출이 가능하도록 CMOS 픽셀 및 CCD 픽셀 자체를 최적화하여 탐지거리를 늘일 수 있다. 이 방식의 가장 큰 문제점으로 지적되는 부분은 높은 입사 배경광 잡음에 의하여 픽셀이 쉽게 포화(saturation)된다는 것이다. 실제로 이러한 문제점으로 인하여 전 세계적으로 개발된 모든 CMOS/CCD 실리콘 Time-Of-Flight(TOF) 센서는 적절한 광학 필터를 사용하는 조건에서도 야외기준 탐지거리 10m 수준을 넘지 못하는 상황이고, 태양광 아래에서도 최소 20m, 최대 100m 이상의 탐지성능을 확보해야 하는 자율주행차/스마트카에 적용하기에는 성능상의 제약이 많이 따른다.

4. 한국 독자 구도의 스터드 방식 라이다 기술

지금까지 검토한 바와 같이 다양한 방식의 3차원 라이다 기술이 존재하지만, 각각의 기술은 고유의 문제점이 존재하기 때문에 추가적인 개선이 필요한 상황이다. 각 기술분야의 선두를 지키고 있는 각국의 대표기업은 보유기술에 대한 기술적인 선점을 강화해 가면서 동시에 문제점 해결을 위해서 노력하고 있다.

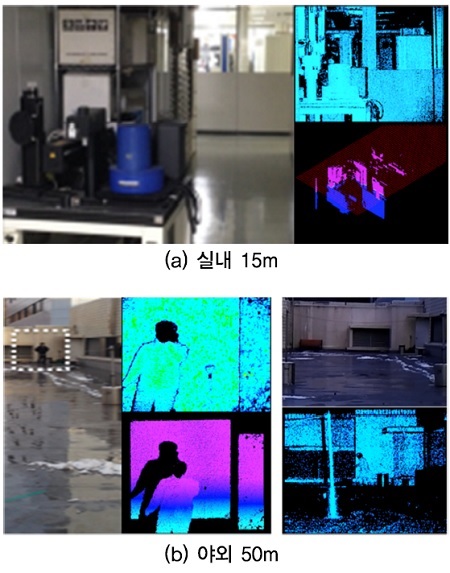

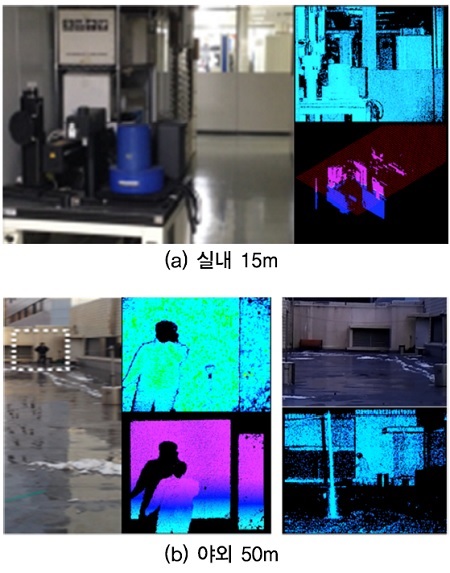

이러한 상황에서 한국전자통신연구원은 기존 기술의 문제점을 독자적인 기법을 이용하여 원천적으로 해결하기 위해 국내 독자 기술인 STatic Unitary Detector (STUD, 스터드) 방식을 세계 최초로 제안하였다[7]. 이 기술은 고해상도의 3차원 영상품질을 낮은 비용으로 확보하는데 최적인 솔루션으로 평가되고 있는데, 센서 배치 구조에 따라 자율주행차용 3차원 영상 센서뿐만 아니라, 경량 저전력이 필요한 드론용 센서, 내구성/내진동성이 필요한 국방 경계 감시 로봇, 초소형 IoT 센서 등에 적합하도록 확장 및 응용이 용이하다. 지금까지 연구는 일반적으로 요구되는 국방용 및 민수용 애플리케이션을 타겟으로 다양한 연구시제품[(그림 6) 참조]을 확보해 왔으며, 최근 글로벌 라이다 센서 시장의 경쟁이 더욱 치열하게 확대되고 있어, 차세대 라이다 요소기술 개발 및 추가적인 핵심 IPR 확보를 진행해 가고 있다.

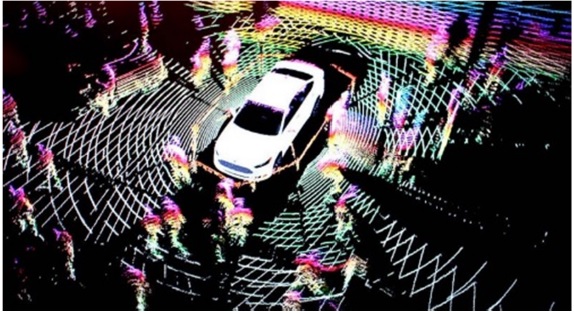

이 중에서 세미눈(SemiNoon)이라 명명된 GEN3 모델은 3세대 연구시제품으로 현재 판매되고 있는 상용 라이다 제품 수준인 100×100×150mm 크기로 소형화를 이룬 모델이다. 이 모델을 통해 획득이 가능한 검출 성능은 최대 전방 40도, 200미터 범위에 대하여 가로 320 픽셀, 세로 240픽셀의 해상도로 3차원 영상 및 일반영상(반사세기영상)의 획득이 가능하며, 이는 3차원 해상도 및 공간 분해능 관점에서 세계 최고 수준이다. 세미눈 모델은 검출되는 3차원 정보(픽셀 별 거리 및 반사정보)의 포인트 클라우드를 UDP 패킷 포맷으로 전송하며, 자체 포인트 클라우드 전용 디스플레이 프로그램에 의하여 (그림 7)과 같이 획득된 3차원 입체영상 및 일반영상을 실시간으로 확인할 수 있다.

기본적으로 스터드 방식은 센서 모듈 구성의 유연성이 기존의 다른 라이다 기술과 비교하여 매우 높아 회전 없이 광각/360도 탐지형태로도 간단하게 구현할 수 있으며, 구동 중에도 해상도 임의조절이 자유롭고, 센서모듈의 소형화에도 매우 유리한 특징을 갖고 있어 향후 추가적인 연구시제를 통해 다양한 분야로 응용될 예정이다.

Ⅳ. 글로벌 라이다 기술 응용 동향

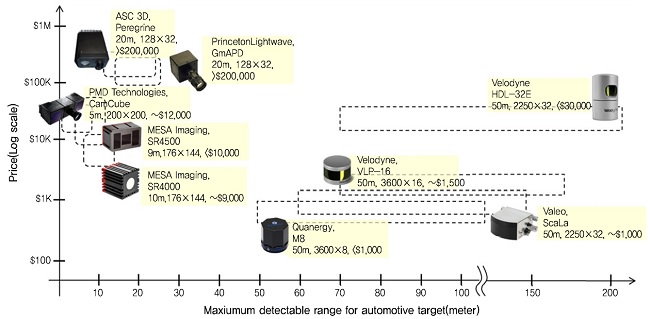

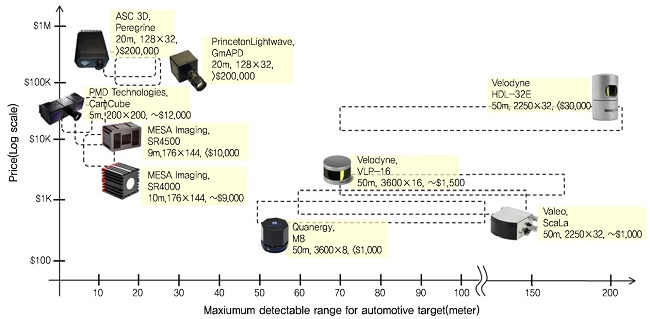

1. 라이다 기술의 가격과 탐지거리 분석

현재 글로벌 시장에서는 다양한 라이다 센서가 개발되고 있으며, 그 방식도 다양하다. 라이다 센서를 차량에 적용하기 위해서는 저렴한 가격과 탐지거리가 중요한데 기존 라이다 제품 중 화각 30도 이상 조건에서 구동이 가능한 제품들의 성능을 가격과 탐지거리 관점에서 분류하면 (그림 8)과 같다. 그림에서 알 수 있듯이 고가의 라이다 센서가 무조건 좋은 성능을 갖는 것은 아니며, 방식에 따라서 측정할 수 있는 거리 성능이 눈에 띄게 구별된다. 측정거리 50m 이하에 나타난 센서들은 퍼트리는 빔을 사용하는 방식이고, 50m 이상에 나타난 센서들은 빔을 모아서 내보내는 방식을 사용하는 센서들이다. 빔을 퍼트리는 방식은 빔을 모아서 보내는 방식보다 높은 가격대를 형성하고 있으며, 가격이 높은 센서라 할지라도 측정할 수 있는 거리가 50m를 넘지 못하는 반면 빔을 모아서 송신하는 센서들은 최대 200m까지 측정 할 수 있다. 이렇게 원거리를 측정할 수 있는 성능과 비교적 저렴한 가격 때문에 현재 자율주행차 개발에 빔을 모아서 보내는 방식으로 개발된 라이다 센서들이 주로 사용되고 있다.

하지만 (그림 8)의 제품 중 빔을 모아서 보내는 대다수 센서들의 단점은 빔을 퍼트려서 보내는 센서들보다 수직 해상도가 작다는 것이다. 이렇게 해상도와 거리에 대한 문제점을 보완하면서 저가격, 소형화가 가능하고, 고해상도, 원거리 3차원 영상을 획득할 수 있는 센서가 필요한데, 앞서 설명한 스터드 방식의 라이다 기술을 적용하면 가능하다.

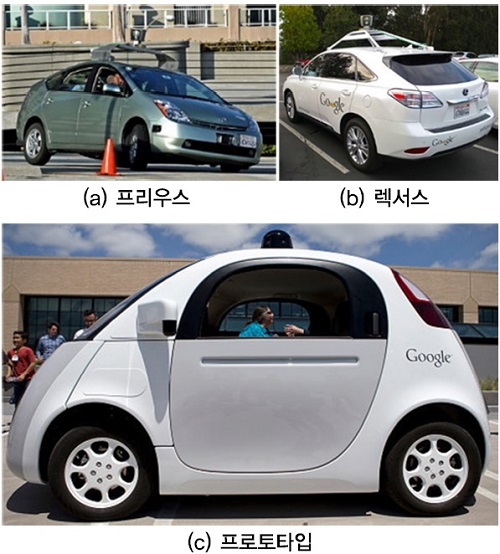

2. 구글 자율주행차의 라이다 3차원 영상센서

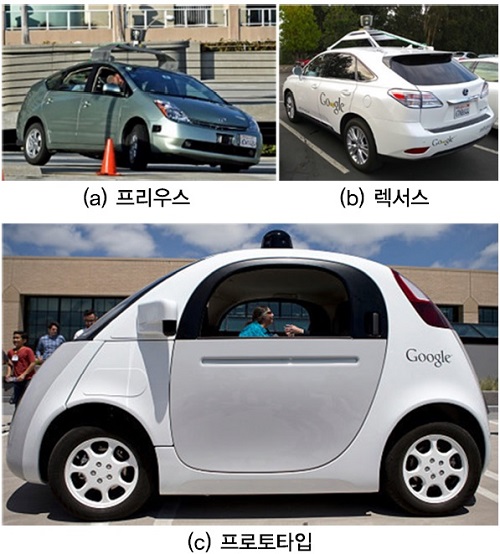

구글은 자율주행 자동차 분야에서 선두를 달리고 있다. 내연기관 자동차 회사, 전기 자동차 회사뿐 아니라 현재 스마트카 개발을 진행 중인 모든 회사를 통틀어 가장 많은 자율주행 자동차를 일반 도로에서 운행하고 있으며, 그 거리는 2016년 4월 기준 자율주행 모드로 2,518,500km를 넘었다[8]. 2009년 도요타의 프리우스를 이용한 자율주행 테스트를 처음으로 시작했다. 당시 프리우스는 라이다 센서를 지붕 위에 달고 있었으며, 라이다 센서의 인식 범위를 높이기 위하여 높은 거치대를 이용했다. 차량을 확대하여 2012년 도요타 프리우스 6대, 아우디 TT 한대 그리고 3대의 렉서스 RX450h를 운행하였다. 그 후 23대의 렉서스 자동차만을 이용하기 시작했으며[9][10], 라이다 센서는 프리우스와 마찬가지로 차량 지붕 위에 거치대를 두어 배치하였다. 이처럼 라이다 센서의 성능을 극대화하기 위해서 기존 상용차를 이용해 만든 자율주행 테스트 자동차들은 크기가 크고(높이 30cm), 무거운(13kg) 라이다 센서[11]를 지붕 위에 높이 장착했다. 하지만 프리우스처럼 작은 차량은 무거운 센서의 높이를 높이면 무게 중심 때문에 고속 주행 회전시 사고의 위험성이 높았다. 그래서 센서의 성능과 무게, 높이를 고려하여 고가의 차량임에도 불구하고 렉서스 RX450h와 같이 큰 차량을 이용한 것을 알 수 있다.

2014년, 구글은 직접 자율주행 자동차 프로토타입을 만들었고, First Drive라는 이름으로 시연하였다. 크기는 작고, 앞, 뒤로 짧게 만들어 라이다 센서의 성능을 고려한 모양으로 만들었다. 구글이 기존에 SUV 상용차를 이용한 것과 달리 작은 크기의 프로토타입 자동차를 만들 수 있었던 이유는 라이다 센서의 소형화 덕분이다. 기존에 사용하던 13kg 이상의 무게와 약 30cm 높이의 라이다 센서를 높이는 반으로 줄이고, 무게는 약 1kg인 제품으로 대체할 수 있었기 때문이다[11]-[13]. 구글이 만든 프로토타입 자율주행 자동차는 (그림 9)와 같이 라이다 센서가 차량 지붕 위에 바로 붙어 있는데 이는 차량의 디자인과 탐지성능을 모두 고려하여 라이다 센서를 개량하고 차량에 적절하게 배치한 결과이다.

2016년 5월 구글은 피아트 크라이슬러와 파트너쉽을 맺고 자율주행 기술을 적용하기로 했다[14]. 차종으로는 미니밴을 선택했는데 이것은 라이다 센서의 성능을 고려한 기존의 실험 및 프로토타입 자동차 디자인을 통한 연구내용과 상이한 부분이며, 크기가 다른 여러 차종을 이용하여 자율주행 기술을 실험해 온 구글이 앞으로 어떤 라이다 센서 기술을 이용하여 개발을 진행할지 지켜볼 부분이다. 미니밴은 슬라이드 도어가 있어 이 도어에 손을 대지 않으면서 안전하게 타고 내릴 수 있는 차량 테스트를 진행할 예정인데 미니 밴 실험이 성공한다면 한 두 사람의 탑승이 아닌 가족 단위, 또는 소규모 그룹이 편하게 이용할 수 있는 자율주행 차량을 기대해 볼 수 있다.

3. 야간 자율주행 및 멀티 라이다 모듈

최대 자동차 회사 중 하나인 포드도 2014년 Detroit Auto Show와 Mobile World Congress(MWC) 행사에서 자율주행자동차 기술 연구를 위해 라이다 센서를 장착한 차량을 선보였다. Fusion이라는 자동차 지붕 위에 Velodyne사의 32채널 라이다 센서 4개를 장착하였다. 포드는 자율주행 기술 개발을 위해 비가 오는 환경, 눈이 내리는 환경 등 여러 기후 조건에서 자율주행 기술을 다양하게 실험해 왔다. 그리고 2016년 3월에 야간 주행이 가능한 자율주행 자동차 기술을 시연 했다[15]. 포드의 이번 시연이 의미 있는 것은 기존 자율주행 기술을 선보이던 회사들과는 다르게 주변 상황이 보이지 않는 암흑과 같은 어둠 속에서 주행이 이루어졌으며, 비젼 카메라를 사용하지 않고 라이다 센서를 이용한 결과라는 것이다.

이 실험은 Arizona에 위치한 proving ground에서 Nightonomy라는 프로젝트명으로 진행되었다. 빛이 없는 곳에서 실험을 진행했기 때문에 관계자들은 야간 투시경을 착용했고, (그림 10)도 투시경을 통해서 촬영된 것이다. 이 실험을 통해 포드는 라이다 센서를 이용한 주·야간 완전 자율주행이 가능하다는 것을 보여주었으며, 라이다 센서가 자율주행차/스마트카에 필수센서라는 것을 다시 한번 입증하였다.

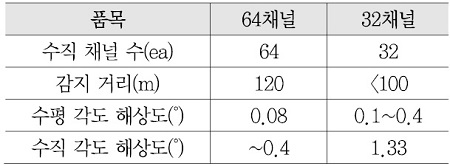

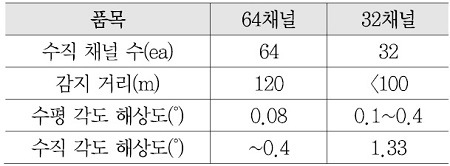

포드는 자율주행 자동차를 개발하면서 기존에 구글이 사용하던 64채널 라이다 센서의 문제점을 해결하고자 작은 크기의 32채널 라이다 센서를 장착하였다. 하지만 Velodyne사의 라이다 센서는 <표 1>의 비교처럼 크기가 작아진 만큼 성능도 떨어지는데 센서 성능 감소는 인식률 감소와 자율주행 성능 감소로 이어진다.

포드는 한 개의 라이다 센서로는 감당할 수 없는 성능의 한계를 보완하기 위해서 동일한 라이다 센서 4개를 장착했다. 그뿐만 아니라 4개 중 2개는 비스듬하게 설치함으로써 센서의 인식공간을 교차하게 하였고, 그 효과로 (그림 11)과 같이 감지 사각지대를 줄이기 위해 노력했다.

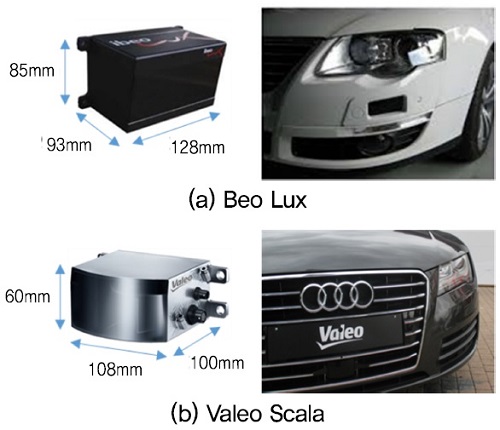

4. 소형 저가형 라이다 센서 활용

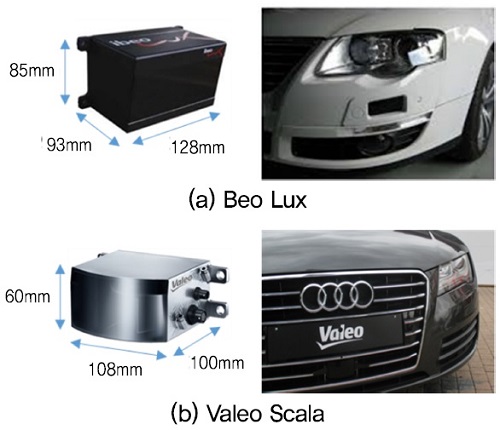

상용차에 필요한 자율주행 기능을 구현하기 위해서 라이다 센서는 자동차 디자인에 영향을 주지 않는 소형이면서 눈에 잘 띄지 않는 디자인으로 개발이 요구되고 있다. 따라서 라이다 센서 개발 회사들은 성능이 떨어지더라도 크기가 작고 차량에 이질감 없이 장착되는 형태의 디자인을 고려해 센서를 개발하고 있으며, (그림 12)와 같이 최대 크기인 면의 길이가 15cm 이내의 센서들을 개발하고 있다.

센서의 크기가 작아지면서 성능이 제한되는 문제는 (그림 13)과 같이 차량의 여러 위치에 센서를 장착하여 사각지대 및 성능이 저하되는 부분을 최소화해 해결하고 있다. 이것은 앞서 설명한 포드가 개발하고 있는 자율주행 차량의 사례와도 유사한 경우이다.

성능을 일부 희생하면서 소형, 저가격의 센서를 개발하고, 자동차의 디자인을 고려하는 이유는 현재 완성차 업체가 먼 미래의 완전 자율주행 기술보다는 차세대 ADAS를 위한 기술을 먼저 적용하고 싶어하기 때문이다. 비교적 저가의 라이다 센서를 활용하여 초기 시장 진입 비용에 대한 상승을 억제하며 최종적으로는 조기에 성공적인 상업화가 진행될 수 있도록 노력하고 있다.

Ⅴ. 맺음말

현재 글로벌 IT 업계와 글로벌 완성차 업계는 모두 자율주행차 기술을 차세대 기술로 주목하고 있다. 이는 자율주행 기술이 단순히 운전이 필요없도록 하는 하나의 기술이 아니라 인류 문명에 큰 파급효과를 가져오기 때문이다. 자율주행 기술이 단시간에 완성되기는 어려운 것으로 예상되지만 관련 산업계는 이러한 시대를 위해 대비하고 있다.

자율주행 자동차 기술에 반드시 빠지지 않는 기술이면서 가장 빠르게 변하고 있는 기술이 바로 라이다 3차원 영상센서 기술이다. 보다 높은 수준의 완전자율주행 서비스를 제공하고자 하는 글로벌 IT업계는 고성능의 라이다 기술이 필요하며, ADAS 기반으로 자율주행 기술을 더욱 빠르게 상업화하고자 하는 글로벌 완성차 업계는 저사양 저가의 라이다 기술이 필요 하다. 이와 같이 응용 산업에서 라이다 기술에 요구하는 다양한 조건들은 라이다 기술 그룹들이 서로 다른 특징을 가지고 발전할 수 있도록 하고 있다.

이제 분명한 것은 미래 자동차에서 라이다 3차원 영상센서 기술은 더이상 차량에 장착된 센서 중 하나가 아니며, 차량에 장착된 라이다 3차원 영상센서 기술은 미래 글로벌 자율주행차 및 스마트카 시장의 근간을 흔들 수 있는 핵심 플레이어 역할을 할 것이다. 이러한 상황에서 라이다 기술에 대한 적절한 투자 및 저변 확대를 통해 국내에서 보유하고 있는 라이다 기술 및 관련 IT기술의 강점을 접목하고, 최종적으로는 현재 대한민국이 가진 자동차 강국의 위상을 미래에는 스마트카 강국의 위상으로 이어갈 수 있기를 기대한다.

용어 해설

Readout IC 전압으로 입력 받은 빛의 신호를 분석하여 세기 정보, 시간 정보 등을 출력하는 칩

Time-Of-Flight 송신한 빛이 반사되어 돌아오는 시간

Advanced Driver Assistance System 운전자의 운전에 도움을 주는 첨단 운전자 보조 시스템

LIDAR 빛을 조사하고 난 후에 반사되는 광신호의 특성을 통하여 반사위치까지의 거리 또는 매질의 속도, 온도, 특성을 분석할 수 있으며, 하나의 포인트가 아닌 2차원의 면에 대한 분석을 수행할 경우 3차원 정보를 획득할 수 있는 기술

약어 정리

M. Carter, “California Governor Jerry Brown Signs Bill Legalizing Self-Driving Cars,” Sept. 2012

B. Mheen et al., “High-Resolution Three-Dimensional Laser Radar with Static Unitary Detector,” Electronics Letters, vol. 50, no. 4, 2014, pp. 313-315.

Google self-driving car, https://en.wikipedia.org/wiki/Google_self-driving_car, Re-trieved May 5th, 2016.

Google self-driving car project, https://www.google.com/selfdrivingcar/where, Retrieved May 5th, 2016.

B. Woodall and E. Taylor, “Google, Fiat Chrysler Team Up on Self-Driving Miniva,” May 4th, 2016.

WITTMANN, ARIZ, “No Lights? No Problem! Ford Fusion Autonomous Research Vehicles Use LIDAR Sensor Technology to See in the Dark,” Apr. 11th, 2016.

- Sign Up

- 전자통신동향분석 이메일 전자저널 구독을 원하시는 경우 정확한 이메일 주소를 입력하시기 바랍니다.