정준영 (Jeong J.Y.) 테라미디어연구그룹 연구원

김준수 (Kim J.S.) 테라미디어연구그룹 연구원

윤국진 (Yun K.G.) 테라미디어연구그룹 책임연구원

정원식 (Cheong W.S.) 테라미디어연구그룹 책임연구원

서정일 (Seo J.I.) 테라미디어연구그룹/그룹장

Ⅰ. 서론

VR(Virtual reality) 미디어란 높은 사실감과 현장감을 제공하는 VR 콘텐츠를 획득하여 부호화한 후, 방송망 또는 통신망을 통해 전송하여 사용자가 HMD(Head mounted display)와 같은 실감 인터페이스 기기로 상호작용하며, 가상의 환경에 자연스레 몰입하게 하는 미디어의 한 형태이다. 전 세계적으로 VR 미디어는 기존의 미디어 수단을 대체할 새로운 매개체가 될 것으로 기대되고 있다. 이와 같은 상황 속에서 세계 유력 표준화 단체에서는 주요 요소기술 선점을 위해 기술 조사 및 분석, 유스케이스(Use case) 수집, 서비스 요구사항 정의 등 표준화를 위한 준비가 활발히 이루어지고 있다.

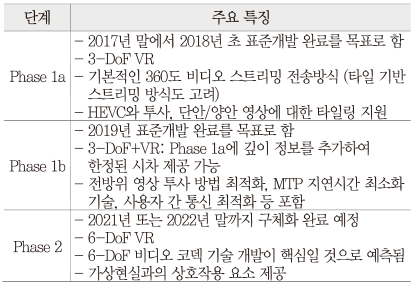

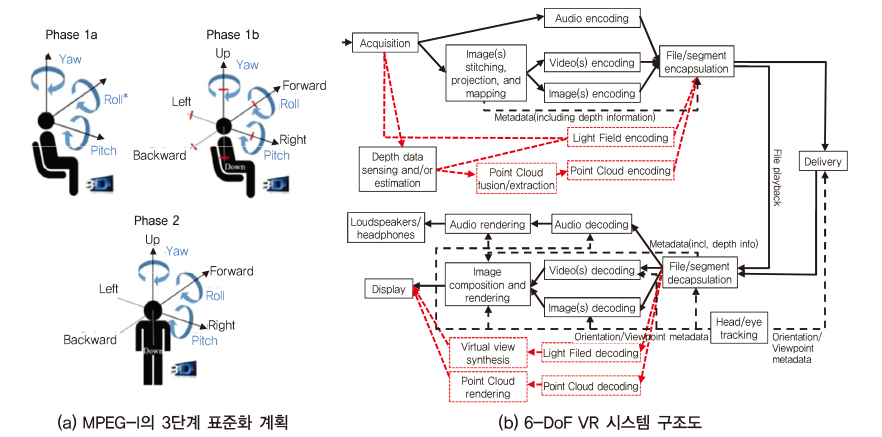

비디오, 오디오 등 멀티미디어 데이터의 국제 표준 개발을 담당하고 있는 MPEG(Moving Picture Experts Group)는 2016년 10월 116차 회의를 통해, 2021년 또는 2022년까지 6-DoF(Degrees of freedom)를 지원하는 VR 기술의 표준화 작업 완료를 목표로 3단계의 표준화 계획을 포함한 MPEG-I(MPEG immersive) 프로젝트를 발족하였다. 이에 따라 5개 표준화 파트를 도출하고, 파트 별 수행 그룹 구성을 위한 논의와 효율적인 전방위 VR 영상 저장 포맷, 압축 및 전송 기술 등에 대한 검토를 진행하고 있다[1].

전 세계 이동통신 시스템 기술 규격을 제정하는 3GPP (3rd Generation Partnership Project)는 2016년 4월 VR 미디어 서비스 관련 기술 보고서[2] 작성을 시작으로, ‘3-DoF 360VR over LTE’를 주제로 한 표준화를 진행하고 있다. 3GPP 규격 하에서의 VR 미디어 서비스의 상호 운용 가능성을 검토하고, 시스템 요구사항을 정의하는 등 관련 논의를 활발히 진행 중이다.

유럽의 디지털 방송 표준화 단체인 DVB(Digital Video Broadcasting) 또한, 2015년 말 DVB-CM(Commercial module)-VR-SMG(Study Mission Group)을 발족하여 VR의 방송 및 미디어 서비스 적용 가능성, VR 시장 현황, 관련 요소기술 등 폭넓은 분석을 진행하고 있다. 이러한 분석을 바탕으로 2018년 말까지 상업적 요구사항 정의 완료하고, 2020년까지 VR 방송 표준 규격 제정이라는 계획을 발표했다[3].

본고에서는 현재 VR 미디어 관련 표준화를 다루는 세계 유력 표준화 단체들의 동향을 살펴보고, 관련 핵심 요소기술들의 연구 개발 현황을 확인해보고자 한다.

Ⅱ. VR 미디어 표준화 동향

1. MPEG 표준화 동향

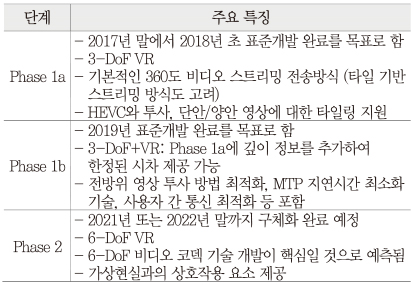

MPEG에서는 2016년 1월부터 VR을 중점으로 이머 시브(Immersive) 미디어에 대한 활발한 논의를 진행했으며, 116차 MPEG 회의에서 ISO(International Standardization Organization)에 실감 미디어 표준화 프로젝트인 MPEG-I를 제안했다. 궁극적으로 6-DoF를 지원하는 VR 미디어 서비스 제공을 목표로 MPEG-I는 현재 <표 1>, (그림 1a)와 같이 총 3단계에 걸친 단계적 표준화를 계획하고 있다[1]. (그림 1b)에서 검은색(실선)으로 표시된 부분들은 Phase 1a, 1b에 해당하는 부분으로, 스티칭(Stitching)을 통한 3-DoF 전방위 영상의 제작, 부/복호화, 전송 그리고 이미지 재현까지의 과정을 묘사하고 있다. Phase 1a, 1b가 각각 2017년 말과 2020년에 성공적으로 종료되면, (그림 1b)의 적색(점선) 부분에 표현된 것과 같이 라이트 필드(Light field)와 포인트 클라우드(Point cloud) 도입을 통해 6-DoF로 확장해 나갈 예정이다.

현재 MPEG-I 프로젝트의 범위는 아래와 같이 크게 5개 파트로 나뉜다[4].

• Part 1: Technical report on immersive media

• Part 2: Omnidirectional media application format

• Part 3: Immersive video

• Part 4: Immersive audio

• Part 5: Point cloud compression

2017년 1월 117차 회의에서는 상기 파트별 AhG(Ad hoc group)에 대한 윤곽을 잡아 프로젝트 진행에 대한 논의를 시작했다.

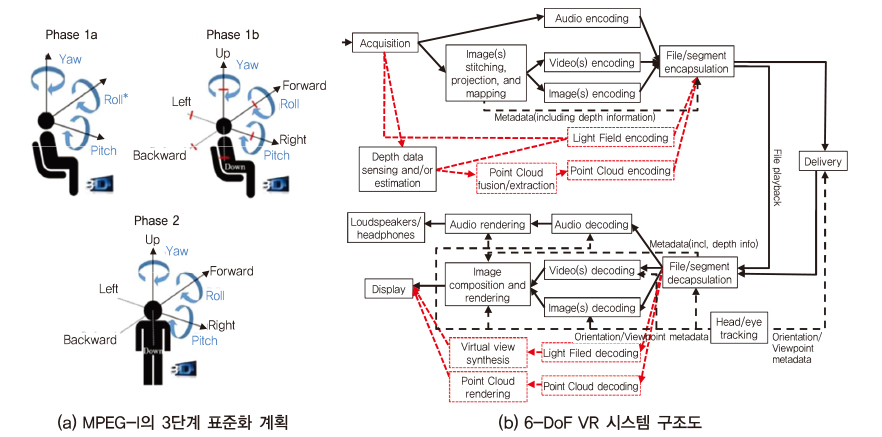

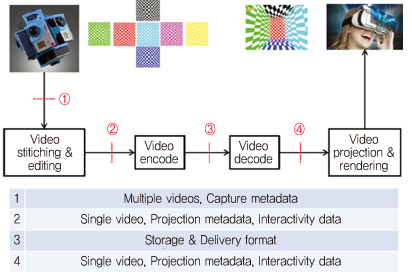

MPEG-I에서는 (그림 2)와 같이 총 4개의 인터페이스로 구성된 VR 미디어 시스템의 흐름도를 정의했으며, 이 중 현재 중점적으로 논의되고 있는 이슈는 3번 인터페이스 부분의 전방위 VR 영상의 저장 및 전송 포맷인 OMAF(Omnidirectional media application format)이다. MPEG-I에서는 113차 회의부터 OMAF의 요구사항 정의를 위해 지속적인 논의를 진행해 왔으며, 현재까지의 사항을 정리하면 아래와 같다[5], [6].

• 2D/3D 기반 전방위 비디오와 오디오 파일의 저장, 전송 및 렌더링을 지원해야 함.

• ISOBMFF(ISO base media file format)와 호환성을 지원해야 함.

• MMT(MPEG media transport) 및 DASH (Dynamic adaptive streaming over HTTP) 기반의 전송 방식을 지원해야 함.

• VR 영상을 구, 정육면체, 원통 등의 형식으로 투사하기 위한 메타 데이터를 지원해야 함.

• 3D 오디오와 비디오의 공간적 동기화를 지원해야 함.

• 사용자 시점 변화에 따른 부호화, 전송, 렌더링 등의 처리 과정을 지원해야 함.

• 사용자 초기 시점 정보를 담은 메타 데이터 및 이에 따른 영상 재생을 지원해야 함.

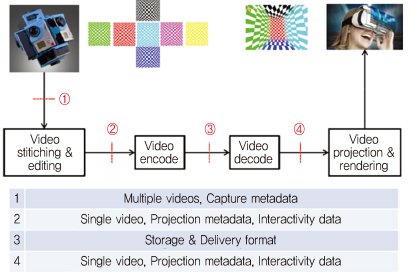

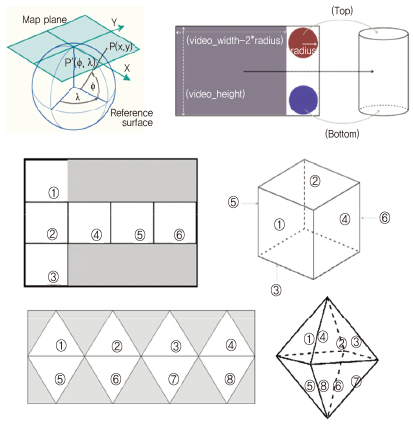

또한, (그림 3)과 같은 다양한 전방위 영상 투사(Projection) 방법과 정보 패킹(Packing) 방법에 관한 실험 및 논의도 진행 중이다. 최근 회의에서는 Equi-rectangular 투사 방법의 코딩 효율에 대해 실험한 결과 보고와 HEVC(High efficiency video coding) 기반 360° 영상 부가정보(SEI: Supplementary enhancement information) 메시지 정의 등이 이루어졌다.

한편, VR 미디어 전송 기술 관련 논의도 진행 중이다. DASH 기반의 전송 기술을 주로 다루고 있는데, 3-DoF 지원 360° VR 미디어(Phase 1a) 전송에 대한 적용 방안 및 즉시 적용 가능성 등을 분석 중이다. 전송 시나리오로는 타일 기반 360° 영상 전송 등이 고려되고 있는데, 이의 요구사항은 아래와 같다[7].

• 성능: 최소한 기존 1,080p 수준의 시각적 경험 (Visual experience)을 제공해야 하며, 낮은 MTP(Motion to photon) 지연을 가져야 함.

• 재사용성: MPEG 포맷, 특히 OMAF 포맷을 지원해야 하며, 또한 DASH 포맷을 최소한으로 확장하는 것을 권장함.

• 적응형 비트율 스위칭: 클라이언트의 통신 환경(대역폭 등)에 따라, 비트율이 다른 콘텐츠를 정적/동적으로 선택할 수 있는 적응형 비트율 스위칭이 제공되어야 함.

• 적용 편의성: DASH 규격에 특화된 방식보다는 범용적으로 사용 가능한 구조를 권장하며, 투사나 기하 유형에 무관할 것을 권장함.

MMT 기반의 모바일 VR 스트리밍 서비스에 대한 기술현황도 발표되었다[8], [9]. 타일 기반의 4K 스트리밍 기술이 시연되었는데, 핵심 성능 인자인 MTP 지연이 최소 수백 ms 수준으로 일반적 VR 게임에 해당하는 수십 ms에 도달하기 위해서는 아직 많은 연구가 필요할 것으로 예상된다.

2. 3GPP 표준화 동향

3GPP에서는 현재 ‘3-DoF 360VR over LTE’를 주제로 3GPP 이동통신 규격 기반의 VR 미디어 서비스 관련 표준화를 진행하고 있다. 2016년 4월에 VR 미디어 서비스에 관한 기술 보고서 작성을 시작하였고, 해당 문서를 통해 VR 미디어 서비스와 3GPP 간 연관성 및 상호운용 가능성 등을 검토하고 있다. 기술 보고서는 현재 VR 비디오 및 오디오 시스템의 구조와 3GPP 규격 하에서의 VR 미디어 서비스 형태에 대한 실시 예 등을 포함하며, 2017년 말까지 1.0 버전으로의 완성을 목표로 한다.

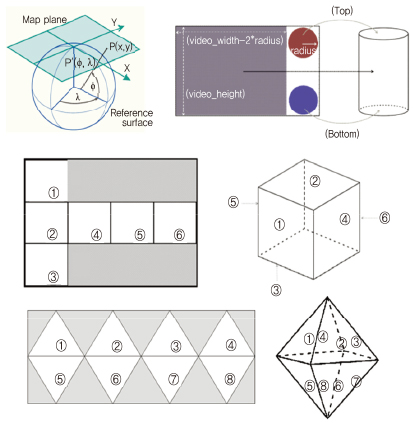

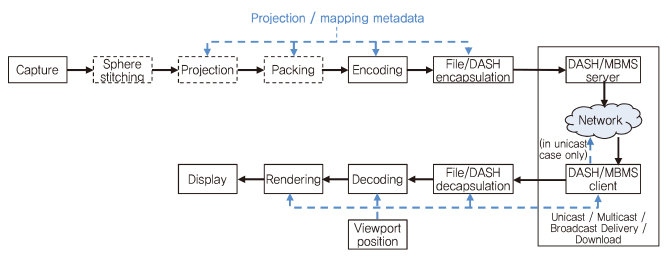

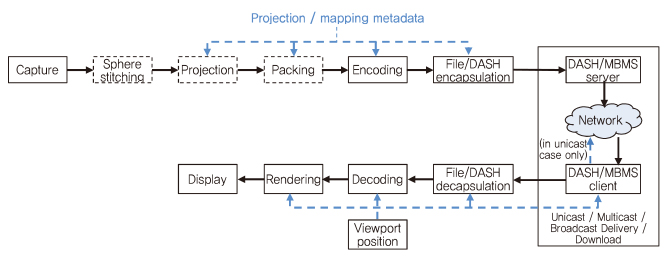

(그림 4)는 3GPP에서 논의하고 있는 VR 비디오 시스템의 개요도이다. 개요도를 구성하고 있는 핵심 기능 블록들에 대한 기술적 분석과 요소기술별 적용 가능성 검토가 이루어지고 있다.

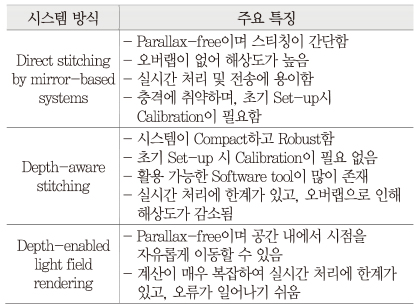

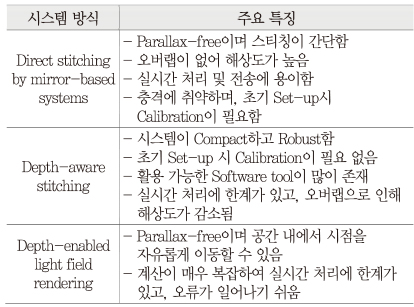

캡처와 스티칭 기술로는 거울 기반의 직접 스티칭 시스템(Direct stitching by mirror-based systems)과 깊이 인지(Depth-aware) 스티칭, 그리고 깊이 정보를 이용하여 중간 시점을 생성하는 라이트 필드 렌더링[10]이 <표 2>와 같이 비교 분석되었다. 주로 스티칭을 포함한 후처리(Post-processing)의 복잡도와 이에 따른 실시간 처리 가능성 위주로 검토되었다. 투사 기법으로는 Equirectangular와 Cubic 방식에 따른 코딩 효율 및 샘플링 왜곡(Sampling distortion) 등이 논의되었고[11]–[13], 코덱 및 스트림 전송 방식에서는 아래 세 가지 전송 방식이 검토되었다[14].

• Single stream approach: 사용자 별 단일 스트림으로 전체영상 또는 관심영역에 해당하는 부분영상을 전송하는 방식

• Multi-stream approach: 뷰포트에 따라 영상 품질을 달리한 복수 개의 전체 영상을 복수 개의 스트림으로 전송하는 방식

• Tiled stream approach: 독립적으로 부호화된 타일 단위의 부분영상을 복수 개의 스트림으로 전송하는 방식

또한, 유스케이스 수집 및 지연 시간 분석 등을 통해 3GPP 규격 하에서의 VR 미디어 서비스의 운용 가능성을 검토했다. 유스케이스에 있어서는 3-DoF로 정의되는 단일 관찰점(Single observation point) 경우에 대해 주로 다루었고, 사용자의 제어에 따라 시점이 자유롭게 변하는 경우를 ‘Apparently full freedom’으로 명기하며, 기존 3-DoF 환경에서 적어도 수평 방향으로의 직선 운동 자유도가 추가된 경우로 정의했다. 논의된 유스케이스에는 Unicast DASH기반의 실시간 스트리밍 서비스나, MBMS(Multimedia broadcast multicast services) 기반의 TV 생중계 서비스 등 3GPP 네트워크상에서의 다양한 미디어 서비스 방식이 포함되었다.

이러한 유스케이스들을 지원하기 위해 현재 3GPP 표준에 보완이 필요한 파트를 아래와 같이 정의하여, 향후 표준화 진행 시 논의할 사항으로 정리하였다.

• 360° 비디오 및 3D 오디오 콘텐츠를 위한 효율적인 부복호화 방식

• 다운로드 전송에 적합한 파일 포맷으로의 VR 미디어 캡슐화(Encapsulation) 방식

• 정의된 부호화 및 캡슐화 방식 기반의 VR 미디어 DASH 전송 관련 지원사항

• 주어진 인터넷 미디어 타입과 DASH MPD (Media presentation description)에 따라 부호화 및 전송된 VR 미디어의 정적/동적 서비스 제공을 위한 필요사항

• 시그널링 및 프로세싱 스텝(다운로드 전송, DASH 전송, VR 서비스 플랫폼과 VR 렌더링 시스템 간 인터페이스 등 포함)을 제공하는 레퍼런스 클라이언트 아키텍처

• 정의된 360° 비디오 및 3D 오디오 포맷에 적합한 렌더링 요구사항 또는 권장사항

특히 360° 비디오 부호화는 투사 과정과 일반적인 비디오 부호화의 두 단계로 구분하고, 후자의 경우 3GPP의 TV 비디오 프로파일 코덱[15]의 적용 및 확장을 고려할 수 있다고 언급하였다.

한편, 지연시간 관련 요구사항을 논의하여 VR 미디어 서비스의 실제 적용 가능성을 검토했다. 최근 미디어 서비스의 초당 프레임 수가 약 60~90FPS(Frame per second)임을 고려할 때, 사용자 움직임에 대한 반응 지연시간을 약 10ms로 목표하는 것이 타당하다고 명시했다. 여기에 사용자 움직임을 감지하는 시간 및 관련 영상 처리시간이 모두 포함되어야 하므로 어려움이 있다는 점 역시 지적하고 있다.

3. DVB 표준화 동향

이러한 VR 미디어 서비스 표준화의 흐름 속에서, DVB도 2015년 말 VR 방송 시스템 및 서비스를 위한 요소 기술의 표준화를 추진하기 위해 DVB-CM-VR-SMG 그룹을 발족시켰다. 이 그룹의 목표는 VR 방송이 과연 미디어 세계의 판도를 뒤바꾸는 뉴미디어 수단이 될지에 대한 답을 찾고, VR을 성공적으로 방송서비스에 접목하기 위해 DVB가 수행해야 할 역할을 정의하는 것이다.

상기 목표를 바탕으로 DVB는 ‘Virtual reality prospects for DVB delivery’라는 스터디 미션 보고서의 초안[3]을 2016년 6월 배포하였다. 또한, 2018년 말 VR 방송을 위한 상업적 요구사항 정의를 완료할 예정이며, 2020년까지 VR 방송 표준 규격을 제정할 예정이라고 발표했다.

스터디 미션 보고서에 따르면, DVB는 VR 기술의 상업적 성공 여부를 판단하기 위해 아래의 세 가지 질문을 제시했다.

• 경제적이고 실용적인 VR 영상의 획득, 전송 그리고 디스플레이 기술의 개발이 가능한가?

• VR 멀미를 포함하여 신체적·감각적 불편함을 없앤 VR 시스템 개발이 가능한가?

• 소비자가 기꺼이 지갑을 열 만한 콘텐츠 형식의 개발이 가능한가?

위 세 가지 질문의 해답을 찾기 위해 현재 DVB에서는 VR 체감 품질 관련 기술적 요소, 신체적·심리적 고려사항, 콘텐츠 제작 방법, VR 시장 조사 및 관련 장비 판매 현황 등을 포함한 광범위한 분석을 진행 중이다.

DVB 측에서 제시한 VR 방송 서비스를 위한 주요 고려사항은 다음과 같다.

• 다양한 환경 또는 디바이스에서 VR 미디어 소비가 가능해야 함.

• VR 영상은 8K 이상의 고화질을 제공해야 함.

• VR 멀미 감소를 위해 프레임률은 최소 90FPS, 최대 120FPS여야 함.

• VR 미디어 저장, 편집 그리고 배포를 위한 공통된 표준 파일 포맷이 필요함.

• 이미 개발된 또는 개발 중인 VR 서비스 플랫폼을 활용해야 함.

이러한 고려사항에 따라, DVB에서도 타 표준화 단체와 마찬가지로 영상 포맷, 전송 방식 등을 포함한 VR 방송 시스템 기술에 대해 논의를 진행하고 있다.

Ⅲ. 결론

이상으로 세계 유력 표준화 단체에서 진행 중인 VR 미디어 관련 표준화 동향을 살펴보았다. 각 표준화 단체별로 진척도는 서로 다르나, 모두 VR 미디어를 핵심적인 차세대 미디어 형태 중 하나로 인식하고 관련 표준화 방안 검토 및 기술 논의에 주력하고 있는 것을 확인할 수 있었다. 국내의 산업계, 학계, 연구소에서 이러한 VR 미디어 표준화 동향을 파악하고 관련 기술의 연구 개발 방향을 예측하여 차세대 VR 미디어 시장에서의 국가 경쟁력을 높일 수 있는 계기가 될 것으로 기대한다.

용어해설

MPEG(Moving Picture Experts Group) 1988년에 설립되어 350여명의 다양한 산업 및 학계 전문가가 참여하고 있는 멀티미디어 표준화 전문 그룹

3GPP(3rd Generation Partnership Project) 전세계적으로 적용 가능한 3세대 이동통신 시스템 규격의 작성을 목적으로 1998년에 세워진 이동통신 관련 단체들 간의 공동연구 프로젝트

DVB(Digital Video Broadcasting) 유럽의 270여개의 산업체 컨소시엄으로 구성된 프로젝트로 지상파, 위성, 케이블 방송 규격을 제정하는 표준화 기구

DoF(Degree of Freedom) 로보틱스나 가상 현실 시스템에서 사용되는 모든 동작요소를 뜻함. 상하회전, 좌우회전 전후회전의 3-DoF와 상하이동, 좌우이동, 전후이동의 3-DoF가 있으며, 상기 동작요소를 모두 포함하는 6-DoF가 있음

약어 정리

3GPP

3rd generation Partnership Project

AhG

Ad hoc Group

CM

Commercial Module

DASH

Dynamic Adaptive Streaming over HTTP

DoF

Degrees of Freedom

DVB

Digital Video Broadcasting

FPS

Frame Per Second

HEVC

High Efficiency Video Coding

HMD

Head Mounted Display

HTTP

Hyper Text Transfer Protocol

ISO

International Standardization Organization

ISOBMFF

ISO Base Media File Format

MBMS

Multimedia Broadcast Multicast Services

MMT

MPEG Media Transport

MPD

Media Presentation Description

MPEG

Moving Picture Experts Group

MPEG-I

MPEG Immersive

MTP

Motion to Photon

OMAF

Omnidirectional Media Application Format

SEI

Supplementary Enhancement Information

SMG

Study Mission Group

VR

Virtual Reality

References

<표 1>

MPEG-I 3단계 표준화 계획<a href="#r001">[1]</a>

(그림 1)

MPEG-I의 3단계 표준화 계획과 6-DoF VR 시스템 구조도<a href="#r001">[1]</a>

(그림 2)

전방위 영상 획득, 부복호화, 재생 흐름도<a href="#r003">[3]</a>

(그림 3)

전방위 영상에 대한 다양한 투사 방법<a href="#r005">[5]</a>

(그림 4)

VR 비디오 시스템 개요도<a href="#r002">[2]</a>

<표 2>

VR 캡쳐/스티칭 시스템의 비교<a href="#r003">[3]</a>