클라우드 연계 자율주행 맵 시스템 기술동향

Trends on High-Precision Digital Map for Autonomous Driving Services

- 저자

- 최정단, 민경욱, 성경복, 한승준, 이동진, 박상헌, 강정규, 조용우 / 자율주행시스템연구그룹

- 권호

- 32권 4호 (통권 166)

- 논문구분

- AI & Human machine Interface

- 페이지

- 40-47

- 발행일자

- 2017.08.01

- DOI

- 10.22648/ETRI.2017.J.320405

본 저작물은 공공누리 제4유형: 출처표시 + 상업적이용금지 + 변경금지 조건에 따라 이용할 수 있습니다.

본 저작물은 공공누리 제4유형: 출처표시 + 상업적이용금지 + 변경금지 조건에 따라 이용할 수 있습니다.- 초록

- 자율주행 맵은 도로의 주행환경 정보(차로, 도로 마크, 신호등의 위치 등)와 시간에 따라 변화하는 동적 주행환경 정보(장애물 출현, 일시적인 통행제한, 긴급한 도로 복구, 교차로 교통혼잡 등)로 구성된다. 자율주행 맵 생성 및 갱신 기술은 차로 구분선이나, 도로 교통과 관련된 실시간 갱신 주기 측면에서 더욱 세밀하고, 정확한 위치 정보가 요구되며, 또한, 최신성을 유지하는 기능을 가진다. 이러한 고정밀 지도의 세밀함과 정확성, 최신성은 자율주행 서비스를 위해 요구되는 필수적인 요소이다. 클라우드와 연계하여 생성되는 자율주행 맵은 차량 운행 시 수집되는 정보를 클라우드에 축적하여 가공함으로써, 시간과 인력 투입을 통해 데이터를 취득하고 지도를 구축하는 면에서 작업 품을 효과적으로 개선하는 데 도움이 된다. 유지와 보수 측면에서는 정기적으로 또는 신속하게 갱신하여 최신의 정보를 유지하는 장점이 있다. 본고에서는 자율주행 맵을 생성하고 갱신하는 클라우드 연계 플랫폼과 연구 결과 일부를 소개한다.

Share

Ⅰ. 서론

자율주행 맵은 도로의 주행환경 정보(차로, 도로 마크, 신호등의 위치 등)와 시간에 따라 변화하는 동적 주행환경 정보(장애물 출현, 일시적인 통행제한, 긴급한 도로 복구, 교차로 교통혼잡 등)로 구성된다. 자율주행 맵의 구성 내용은 현재의 내비게이션 지도와 다르지 않으나 나타나는 형태는 차로 구분선이나 도로 교통과 관련된 실시간 갱신 주기 측면에서 더욱 세밀하고 정확한 위치 정보가 요구되며 또한, 최신성을 유지하는 기능을 가진다. 이러한 고정밀 지도는 도로 인프라에 대한 세밀함과 정확성, 최신성이 있어야 하며, 이는 자율주행 서비스를 위해 요구되는 필수 요소이다. 자율주행을 위한 필수 요소 중 가장 중요한 기능은 출발지에서 목적지까지의 자율주행서비스를 위해 자율주행 맵을 참조하여 인식하고 목적지를 찾아가기 위해 최적의 경로를 계획하는 것으로 고정밀의 맵을 활용한다.

최근에는 고정밀의 지도를 자동으로 생성하는 연구가 다양하게 연구되고 있으며, 본고에서는 클라우드 서버와 연계하여 부분적인 지역에서 수집된 도로인프라정보가 점차 확장되어 점진적으로 세밀해지는 자율주행 맵 생성 플랫폼과 현재 구현현황을 소개하고자 한다.

Ⅱ. 정밀지도 기술 동향

1. 정밀지도

최근에는 전 세계적으로 지도 데이터의 가치는 높게 평가되고 있으며, 정밀지도 제작에 이미 착수하여 일부 구간에 대해서는 정밀지도를 활용하고 있다. 특히 자동차업체와 협력하여 향후 성장 가능성이 큰 자율주행차용 정밀지도시장을 선점하기 위해 연구자들이 노력하는 중이다. 정밀지도는 구글에서 자율주행차량에 대한 연구를 진행하면서 급속하게 발전하였다. 구글은 2010년부터 DARPA(Defense Advanced Research Projects Agency)의 2005년 Grand Challenge 우승자들을 중심으로 자율주행차량 개발을 시작하였다.

Here[1]와 TomTom[2]은 유럽의 대표적인 내비게이션 업체로서 유럽, 미국 등지에서 정밀지도를 제작하고 있다. 라이다, 카메라, 항공영상을 모두 활용하여 세부 지도를 구축하고 있으며, Here는 무인자동차용 3D(3 Dimension) 지도를 제작하기 위해 메르세데스-벤츠와 협력하여 차선 너비, 신호등 위치 등의 속성을 3D 맵 솔루션에 포함한 Here라는 지도 브랜드를 공개하였다. 지도에 포함된 정보는 자율주행 자동차가 도로와 주변 정보를 잘 이해할 수 있도록 제작되었다.

기존의 정밀 맵 개발 제작 기술은 대부분 MMS(Mobile mapping system) 기술을 사용하였다. MMS는 GIS 분야에서 널리 사용되는 기술로서 차량 등의 이동체에 GPS, 레이저스캐너, 카메라, INS(Inertial navigation system) 센서 등을 장착하고 이들 데이터를 조합하여 사용하는 이동형 측량 시스템이다. 이 기술은 주로 지도제작, 도로관리, 시설물 관리 등의 목적으로 사용되었다. 대부분의 내비게이션 관련 회사에서는 2D, 3D 지도데이터를 주로 사용하고 있으나 현대엠엔소프트[3]는 향후 자율주행차량에 사용될 수 있는 고정밀지도 기술을 개발하고 있다. 고정밀지도 데이터 획득을 위해 정밀 센서를 탑재한 지도구축 차량을 제작하고, 이를 이용해 실제 주행을 통해 정밀지도 데이터를 획득하고 있다.

2. 클라우드 맵 서비스 기존 연구

오픈스트리트맵 재단은 오픈 소스 방식의 참여형 무료 지도 서비스인 오픈스트리트맵(OpenStreetMap)을 서비스하고 있으며, 2013년 벤츠는 KIT(Research Center for Information Technology) 및 FZI(Karlsruhe Institute of Technology) 와 함께 자체 제작한 정밀맵을 사용하여 벤츠 S500 차량의 100km 자율주행을 시연하였다.

포드는 미시간 대학과 함께 2013년 퓨전 하이브리드 리서치 차량을 발표 하였고, DGPS(Differential GPS) 및 4대의 32채널 LiDAR(Light detection and ranging) 센서를 사용하여 도심 환경의 3차원 지도를 제작하였다.

2015년 1월 닛산과 미국 NASA는 무인주행이 가능한 무인 차량과 화성 탐사 로봇을 목적으로 공공개발을 진행하기 위하여 5년간의 파트너십을 발표하였다. 닛산은 무인주행을 위해 희박 밀도 맵(Sparse map)을 연구하고 있으며, 이는 구글과 같이 과거에 매우 높은 정밀도의 지도를 가지고 있지 않더라도, 제삼자가 제공하는 지도를 사용하여 주행할 수 있도록 한다. 즉 매우 높은 AI 기술이 요구되며 공통의 지도를 사용함을 의미한다.

국내 국토교통부에서 운영하는 브이월드는 공간정보 오픈플랫폼으로 국가가 보유하고 있는 공개 가능한 공간정보를 자유롭게 활용할 수 있도록 하였다. 현재 일반적인 지도정보 외에도 교통 CCTV, 날씨정보, 지적도, 3차원 건물, 산사태 위험지도 등의 다양한 정보를 제공한다. 지도, 내비게이션 업체에서는 클라우드 기술을 이용하여 내비게이션 지도 업데이트 기능을 제공하고 있다. 맵퍼스에서는 내비게이션에 클라우드 기술을 도입하여 초기 설치 용량을 최소화하고, 별도의 업데이트 과정 없이 언제나 최신지도로 안내하는 기능을 구현한다.

Ⅲ. 자율주행 맵 생성 및 활용 플랫폼

1. 자율주행 맵의 활용을 위한 개념 서비스

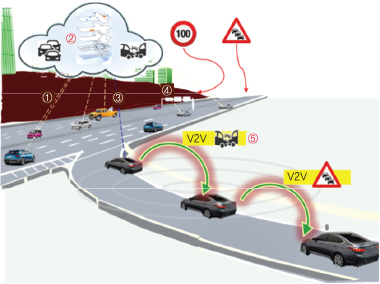

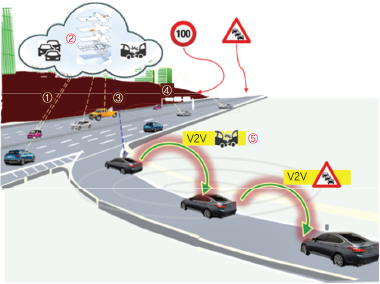

자율주행 맵 플랫폼은 정보 수집단과 정보를 가공하는 클라우드 서버로 구성된다. 플랫폼을 구성하기 위한 정보는 차량으로부터 수집되어 서버로 전달되며 이때에 하나의 공통된 정보전달 프로토콜이 요구된다. 동시에 다양한 서비스 지원을 위해 클라우드 서버는 단일화된 표준 규격을 만족하도록 해야 하며, 정보에 대한 신뢰성 검토과정이 반드시 요구된다.

최근 자동차는 다양한 안전 및 편의 서비스를 위하여 ICT와 융합하여 차량에 장착된 카메라 센서 및 위치수집 센서 등으로부터 위험 상황에 대한 경고를 제공하고 직접 제어한다. 이러한 스마트 자동차는 다양한 정보 수집을 위한 센서를 기본적으로 장착하고 있으며, 통신 기능을 통해 수집된 정보를 클라우드 서버로 전송한다. 클라우드 서버에서는 수집된 다양한 도로인프라 정보에 의하여, 기존의 맵 데이터베이스를 점차 확장하고 생성된 도로 인프라 맵과 빅데이터를 기반으로 ICT와 연계하여 교통상황을 예측하고 대응한다.

클라우드 연계를 통하여 동시 다발적으로 최신의 주행환경정보를 수집하고, 점진적으로 정밀 진화하는 맵 생성기술은 아래의 단계로 구성 가능하다[(그림 1)참조].

1) 영상센서 기반 장시간 동안 변화하지 않는 정적인 속성 정보를 차량에서 클라우드 센터로 전달.

2) 클라우드에서는 제공된 데이터의 신뢰성을 판단하고 최신의 자율주행맵으로 상세화 하는 단계.

3) 클라우드에서는 데이터를 요청하는 차량에게 상세화된 부분 자율주행 맵을 제공하는 단계.

4) 부분 맵을 전달 받은 차량은 안전하게 이동하고, 새로이 수집된 정보는 최신의 자율주행 맵을 갱신하기 위해 클라우드 서버로 전달하는 단계로서 2)의 과정이 반복됨.

2. 정적맵 구축 기술

가. 정보수집을 위한 고정밀 캘리브레이션

자율주행 맵 생성을 위해서 카메라, INS, GPS 등 여러 센서의 융합이 필요하다. 센서에서 취득한 데이터는 차량 중심점을 기준으로 변환해서 맵 생성 알고리즘에 활용하기 때문에 센서들의 정확한 설치 위치를 측량하는 것은 매우 중요하다.

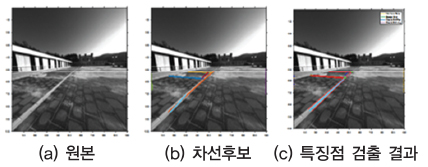

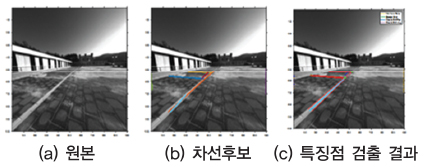

시뮬레이터에서 가상의 영상 정보와 차량의 모션 정보를 생성하고 이를 이용해서 최적화 알고리즘을 수행한다. 가상의 영상 정보는 카메라 초기 캘리브레이션 정보를 이용해서 만들어지며, 특징점 정보는 개별 카메라 영상으로 변환된다. 시뮬레이션의 역과정을 통해 좌표 변환을 수행하고, 이를 지도와 매칭 한 뒤 최적화 알고리즘에 반영한다[(그림 2) 참조].

나. 동일영역 맵 데이터 정합 및 점진적 정밀도 향상

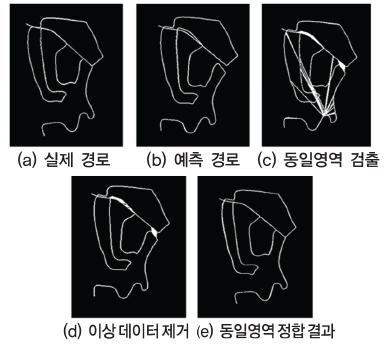

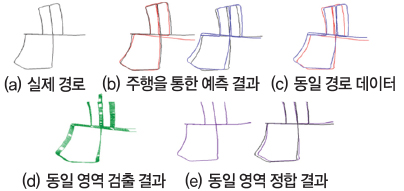

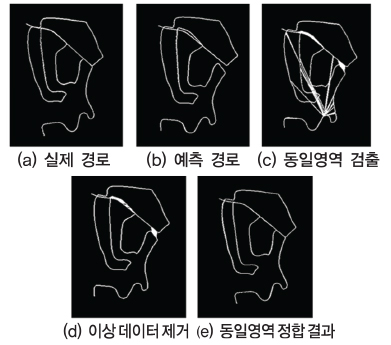

동일영역은 (그림 3)과 같이 수집된 데이터가 기존에 수집된 데이터와 같은 공간에서 수집된 것으로 판단되는 경우를 말하며, 해당 정보는 맵 데이터의 점진적 확장과 정밀도 향상에 사용된다.

동일영역 맵 데이터를 정합하기 위해 수집된 데이터와의 일치성을 검출한다[(그림 4) 참조]. Bag-of-Words 기법은 영상에서 특징점을 추출하여 Vocabulary로 저장하여, 영상 데이터를 Vocabulary에 포함된 Words[4]들로 표현하는 기법이다. 이때 두 영상을 표현하는데 사용된 Vocabulary Words의 패턴을 사용하여 두 영상의 일치 여부를 판단하게 된다.

검출 대상에 맞는 Vocabulary의 학습은 Bag-of-Words의 성능에 큰 영향을 준다. 일반적으로 표적으로 하는 데이터 환경과 동일한 데이터를 사용해 Vocabulary를 학습했을 때 가장 좋은 성능을 나타내는 것으로 알려져 있다.

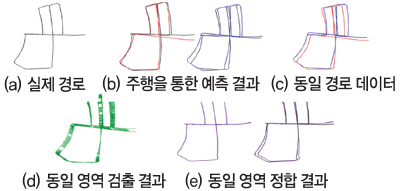

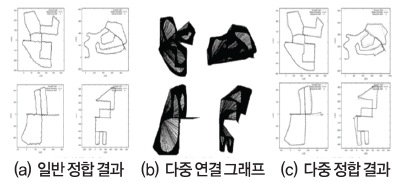

새롭게 수집된 데이터의 경로가 기존과 동일 한 경우, 두 개의 경로 데이터 정보를 사용하여 정확도를 개선할 수 있다[(그림 5) 참조].

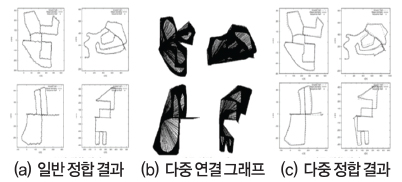

차량의 주행 중 위치를 예측하기 위해 사용되는 기술 중 주행거리 센서정보는 이전 프레임에서의 차량 위치와 상대적 위치 변화를 누적하여 출발 지점과의 상대적 위치를 예측한다. 그러나 이 방법의 경우 상대적 위치 예측 시, 발생되는 오차가 누적되어 주행거리가 길어질수록 정확도가 낮아지는 단점이 있다. 이에 비해 GPS는 차량의 절대적 위치 좌표를 제공해주는 장점이 있지만, 주행거리 센서정보와 비교하여 정확도가 낮고, 또 차량이 터널 또는 숲속을 주행할 경우 정확도가 매우 떨어지는 단점이 있다. (그림 6)은 주행거리 센서정보와 GPS 두 방법의 단점을 서로 보완하기 위해 그래프 최적화에 의한 연구결과로 위치 음영지역에서도 강인한 결과를 나타낸다.

다. 교통표지판과 신호등 인식

클라우드 연계 자율주행맵의 정적맵에는 속도 및 통행 규제를 지시하는 표지판 정보가 포함되며, 이를 위하여 검출 및 인식이 요구된다. 그러나, 현재 우리나라에서는 교통표지판에 대한 공개 데이터 셋이 전무한 상태로 대부분의 연구자는 부분적인 표지판 모델을 직접 만들거나, 저명한 논문에 소개된 공개 모델을 활용하여 학습기 모델을 연구한다. 공개된 데이터 셋은 TT100K(중국), GTSDB(독일) 등이 있다[(그림 7) 참조].

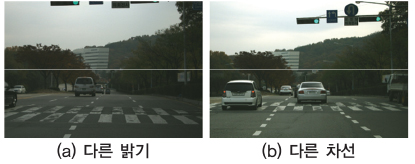

신호등의 경우는 나라별로 신호기 설치 위치 및 신호구의 개수도 상이하여 자체 데이터 셋을 갖춰야 하기 때문에 초기 작업이 많이 요구된다. 먼저 신호등의 위치를 검출한 후에 전구의 색상을 인식한다. (그림 8)은 대덕 연구단지 내의 신호등 데이터 셋을 활용한 신호등 인식 실험 결과 이다[7], [8].

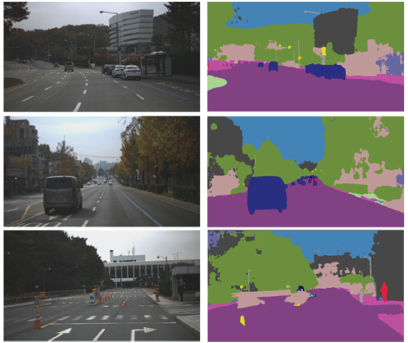

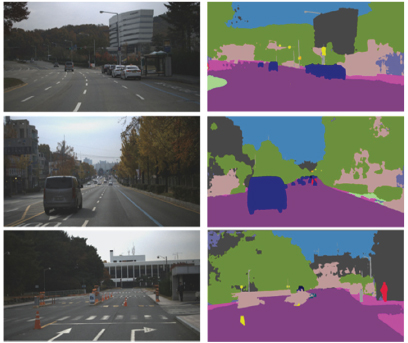

라. 시맨틱 환경정보 추출

영상 기반으로 장면에 대해 빠르게 이해하기 위해 오브젝트 단위로 정보를 추출한다. 이해하려는 장면별로 데이터베이스는 다를 수 있으며, 도심도로 환경으로 구성된 Cityscapes[9] 데이터베이스와 Pascal 데이터베이스를 사용하였다. Pascal 학습 데이터 셋은 분류, 검출, 분리, 행동분류 분야에 대해 사용할 수 있고, Cityscapes는 실제 유럽의 도시 교통 환경에서 얻은 시내 영상으로 도로, 사람, 탈것, 물체 등 총 30개의 분류 기준으로 구성되어 있다. (그림 9)는 대덕연구단지 데이터 셋을 구축하여 DNN(Deep neural networks)을 이용하여 주행환경에 대한 시맨틱 환경정보를 추정한 결과이다[10].

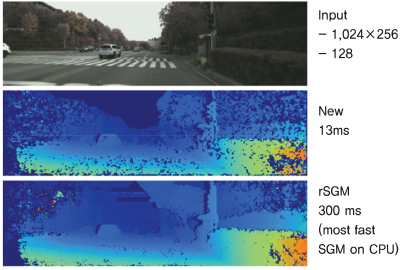

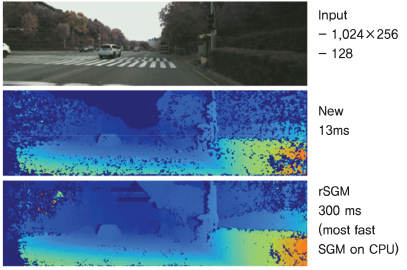

마. 깊이 정보 고속추정 기술

전방의 장애물과의 거리, 또는 노면의 높이 정보는 환경인식을 위해 가장 중요한 정보이나, 영상을 이용한 정보 취득은 FPGA(Field-programmable gate array) 또는 GPU(Global positioning system) 등의 가속 장치 없이는 실시간으로 처리하기 매우 어려운 문제로 알려져 있다. 최근에는 다양한 가속기가 개발되었으나, 전력 및 특정 벤더에 종속되는 상황으로 별도의 하드웨어 가속기 없이 깊이 정보를 고속으로 추정하는 것이 난제이다. 도로 영상은 텍스춰가 거의 없고 이동속도가 빠르기 때문에, 데이터 압축 기술과 해제, 효율적 매칭기법 등이 요구된다. (그림 10)은 단일코어 CPU를 이용하여 1,024×768픽셀의 영상에 대해 128픽셀 시차를 13ms로 계산하는 속도개선 결과 영상이다[11]–[14].

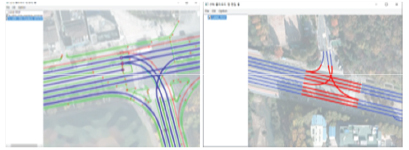

바. 로드마크 데이터 이용 차로 중심선 생성 기술

클라우드 서버에서 생성된 정밀맵의 논리적 저장 모델의 구성요소 중, 자율주행을 위해 가장 필요한 데이터는 차로의 중심선 정보이다. 생성된 자율주행 맵의 차로 중심선은 MMS를 이용하여 구축된 데이터와 비교를 통해 피드백을 수행한다. (그림 11)은 직선 성분 및 교차로에 대해 부분적인 자동화 도구를 이용하여 차로 중심선을 생성한 결과이다.

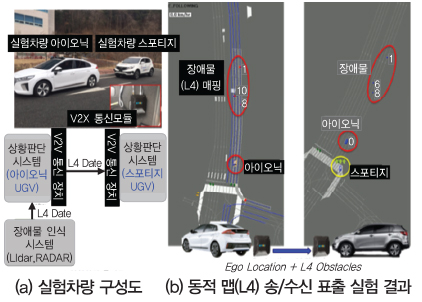

3. 동적맵 생성 및 V2X 통신 활용 기술

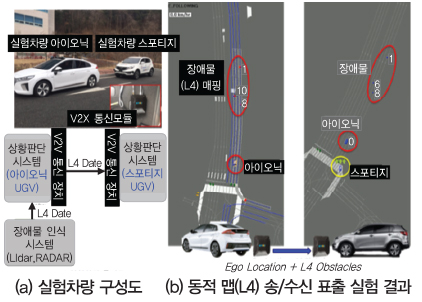

차량에서 검출된 도로상의 일시 점유 또는 움직이는 물체로 분류되는 동적 데이터는 다른 차량에 직접 전달하여 위험 상황에 미리 대처하도록 한다. 차량의 상황판단 모듈에서는 장애물의 특성을 판단하여 필수적인 속도, 위치 등의 정보를 전송한다. 차량 간 정보전송을 위해서는 표준 프로토콜이 필수적으로 요구되며, 장애물 정보 및 빠른 데이터 송수신 주기가 요구된다. (그림 12)에서는 ETRI에서 실험한 결과로서, 77GHz 전방 레이더를 이용하여 검출된 차량의 위치정보를 전송하기 위해 ISO13184 표준 프로토콜을 준수하고 10Hz 데이터 송수신 주기를 사용하였다.

차량과 클라우드 서버 간의 통신은 도로 인프라의 통신 시설을 이용하는 것이 유용하며, 차량 내 저장용량과 통신의 대역폭을 고려하여 전송 주기 및 전송 내용이 결정되어야 한다.

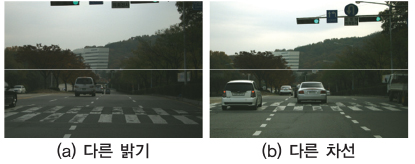

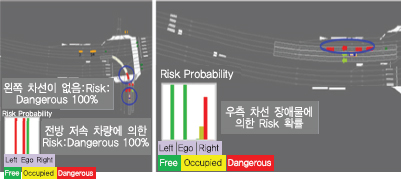

4. 자율주행맵이용 상황판단 및 제어기술

고정밀 맵은 자율주행서비스를 위해 검출과 인식, 판단과 제어 등의 전 단계에 걸쳐 효과적으로 활용할 수 있다. 자율주행서비스를 위해 차량은 최신의 고정밀 맵을 기반으로 차량에 장착된 카메라 센서를 이용하여 횡단보도 앞의 정지선을 인지하고 정지하거나 신호구의 정확한 검출을 위해 활용한다[14], [15].

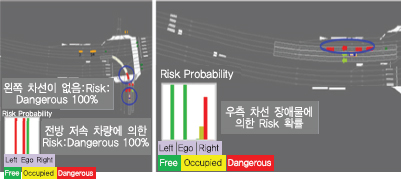

주행상황에 대한 속도와 방향 판단을 위해 차선별 위험도 수준을 계산하여 시뮬레이션한 후, 주어진 자율주행 미션을 수행한다. 위험도 측정을 위한 요소로는 충돌시간(TTC: Time to collision), 정지시간(TTB: Time to break), 안전거리(MSM: Minimal safety margin)로 구성되며, 확률적으로 계산한다. (그림 13)은 고정밀 맵을 활용하여 차선별 위험도를 판단하는 시뮬레이션 결과이다[16]–[18].

Ⅳ. 결론

본고에서는 도로를 주행하는 차량으로부터 동시다발적으로 도로속성 정보와 시간에 따라 가변적인 교통정보를 실시간으로 수집·관리하여 자율주행서비스를 비롯한 다양한 응용서비스를 위해 고정밀 지도를 제공하는 플랫폼을 다루었다.

클라우드 연계 점진·정밀·진화형 맵 생성 플랫폼은 시간과 인력 투입을 통해 데이터를 취득하고, 지도를 구축하는 작업 품을 효과적으로 개선하는 데 도움이 되며, 유지와 보수 측면에서는 정기적으로, 또는 신속하게 갱신이 가능한 장점이 있다. 또한, 최근에는 카메라 센서와 모바일 위치인식 센서를 내장한 스마트 자동차가 보편화 됨에 따라 주행중 취득된 도로 정보는, 클라우드로 전송되어 실시간 지도 생성 및 유지관리에 활용된다. 클라우드 기반 맵 생성 기술은 지능형 센서가 장착된 차량이 운행 중에 수집하는 주행환경정보로부터 맵 생산에 이용하고, 공동으로 생산된 맵은 자율주행을 위해 소비하는 생산과 소비 동시참여가 가능한 친환경 생태계를 갖출 수 있다.

그러나, 카메라 센서의 캘리브레이션이 차량마다 상이할 수 있어, 이를 해결하는 방법과 수집된 데이터의 빠른 전송 시간을 위한 통신 인프라에 대한 고려가 필요하다. 뿐만 아니라 주행정보에 대한 데이터 수집을 독려하기 위한 인센티브 제공하는 방식과 개인화된 정보를 보호하는 방법 및 데이터 신뢰성 검증 기술이 추가로 개발되어야 한다. 비교적 낮은 비용으로 광범위한 환경의 연결성을 기반으로, 동시다발적으로 도로 시설물의 3차원 정보 수집이 가능하고, 확장 가능함에 따라 맵 정보가 점점 정확해지는 장점이 있다.

향후, 근거리 대중교통 연계 이동 수단, 또는 도심의 대규모 단지 내의 공용 주차장에서 각 시설간의 무인셔틀 시범서비스 등의 완전 자율주행서비스 적용과 함께 다양한 자율주행기술에 관한 사용자 수용성 데이터를 수집하기 위해 확대 적용할 계획이다.

약어 정리

3D

3 Dimension

DGPS

Differential GPS

DNN

Deep Neural Networks

FPGA

Field-programmable Gate Array

GPS

Global Positioning System

GPU

Graphics Processing Unit

INS

Inertial Navigation System

LiDAR

Light Detection and Ranging

MMS

Mobile Mapping System

MSM

Minimal Safety Margin

TTB

Time to Break

TTC

Time to Collision

D. Galvez-Lopez and J.D. Tardos, “Bags of Binary Words for Fast Place Recognition in Image Sequences,” IEEE Trans. Robot., vol. 28, no. 5,IEEE Trans. Robot. 2012, pp. 1188?1197.

R. Arandjelovic et al., “NetVLAD: CNN Architecture for Weakly Supervised Place Recognition,” Proc. IEEE Conf. Computer Vis. Pattern Recogn., Las Vegas, NV, USA, June 27?30, 2016, pp. 5297?5307.

R. Kummerle et al., “G2o: A General Framework for Graph Optimization,” IEEE Int. Conf. Robot. Automation, Shanghai, China, May 9?13, 2011, pp. 3607?3613.

M. Jensen et al., “Vision for Looking at Traffic Lights: Issues, Survey, and Perspectives,” IEEE Trans. Intell. Transportation Syst., vol. 17. no. 7, July 2016, pp. 1800-1815.

M. Cordts et al., “The Cityscapes Dataset for Semantic Urban Scene Understanding,” in Proc. IEEE Conf. Comput. Vis. Pattern Recogn., Las Vegas, NV, USA, June 27?30, 2016, pp. 3213?3223.

T. Pohlen et al., “Full-Resolution Residual Networks for Semantic Segmentation in Street Scenes,” in Proc. IEEE Conf. Comput. Vis. Pattern Recogn., 2017.

H. Hirschmuller, “Stereo Processing by Semiglobal Matching and Mutual Information,” IEEE Trans. Pattern Anal. Mach. Interll., vol. 30, no. 2, Feb. 2008, pp. 328-341.

M. Bleyer and M. Gelautz, “Simple but Effective Tree Structures for Dynamic Programming-Based Stereo Matching,” Int. Conf. Comput. Vision Theory Applicat., Madeira, Portugal, Jan. 22?25, 2008, pp. 415-422.

R. pangenberg et al., “Large Scale Semi-Global Matching on the CPU,” IEEE Intell. Veh. Symp. Proc., Dearborn, MI, USA, June 8?11, 2014, pp. 195?201.

A. Geiger, M. Roser, and R. Urtasun, “Efficient Large-Scale Stereo Matching,” in Asian Conference on Computer Vision(ACCV), Lecture Notes in Computer Science, Heidelberg, Berlin, Germany: Springer, 2010, pp. 1?14.

A. Chen, “High-Precision Lane-Level Road Map Building for Vehicle Navigation,” IEEE/ION Position Location Navigation Symp., Indian Wells, CA, USA, May 4?6, 2010, pp. 1035?1042.

K.W. Min et al., “Design and Implementation of Path Generation Algorithm for Controlling Autonomous Driving and Parking,” Proc. Int. Conf. Control, Automation Syst., Jeju, Rep. of Korea, Oct. 17?21, 2012, pp. 956?959.

S.-J. Han and J. Choi, “Real-Time Precision Vehicle Localization Using Numerical Maps,” ETRI J., vol. 36, no. 6, Dec. 2014, pp. 968-978.

- Sign Up

- 전자통신동향분석 이메일 전자저널 구독을 원하시는 경우 정확한 이메일 주소를 입력하시기 바랍니다.