상종희 (Sang J.H.) 스마트콘텐츠연구실 연구원

박수명 (Park S.M.) 스마트콘텐츠연구실 책임연구원/실장

Ⅰ. 머리말

스마트폰의 보급과 딥러닝 기반의 이미지 인식 기술의 발전은 카메라를 통해 다양한 객체를 손쉽게 인식하고 정보를 획득할 수 있는 토대를 마련하였다. 식물 인식 분야는 이러한 기술의 진보를 적용할 수 있는 좋은 활용 사례로서 다양한 기술 연구가 진행되고 있고 이를 기반으로 한 서비스도 모바일 기기를 통해 손쉽게 접할 수 있는 환경이 되었다. 특히 유럽, 미주 등의 경우 EOL(The International Initiative Encyclopedia of Life, (그림 1) 참조)[1], Pl@net[2] 등 다양한 비영리 기관에서 사용자의 자발적 참여를 통해 식물 데이터를 수집하고 배포하여 식물 인식 분야의 기술 진보를 위한 단단한 토양을 제공하고 있다. 주목할 점은 데이터를 수집할 때 데이터를 기반으로 개발한 기술을 적극 활용하여 1차적으로 기계가 분류한 식물을 사람이 선택하는 방식으로 데이터 수집의 효율성을 높이고 있는 데 있다.

아시아나 국내의 경우 안타깝게도 식물에 대한 대량의 이미지를 수집하고 배포하는 전문적인 단체나 기관은 찾아보기 어렵다. 식물의 경우 대륙에 따라 서식하는 종의 분포가 다른 점을 고려할 때 국내에 서식하는 식물에 대한 데이터를 체계적으로 수집, 분류하고 배포하는 작업이 필요할 것으로 보인다. 또한, 식물 인식 기술이 교육, 생태, 환경 연구에 매우 긍정적이고 지대한 영향을 줄 수 있음을 고려해 보았을 때, 이에 대한 연구도 시급한 상황이다.

Ⅱ. 이미지 인식 기술 동향

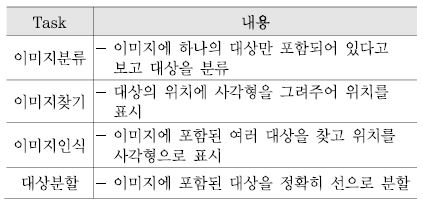

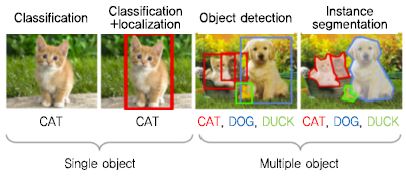

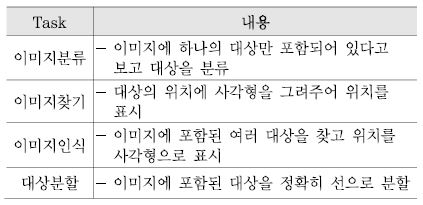

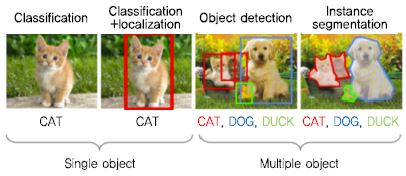

이미지 인식 기술은 통상 이미지에 나타난 객체가 무엇인지를 인식하는 기술을 지칭한다. 세부적으로는 <표 1>과 같이 분류할 수 있으며 기술별 차이점은 (그림 2)와 같다.

최근 몇 년간 이미지 인식 기술은 엄청난 성능의 향상을 보여주었다. 이는 크게 두 가지 요인에 기인한 것인데 첫 번째로 이미지넷을 통한 대량의 이미지 인식용 데이터 배포와 두 번째로는 잘 알려진 데로 딥러닝 기술의 발전을 들 수 있다.

1. 이미지넷(ImageNet)

이미지넷[4]은 스탠포드의 페이페이 리 교수가 진행한 프로젝트로 이미지에 나타난 객체를 인식하기 위하여 데이터를 구축한 프로젝트이다. 2007년부터 프린스턴 대학의 카이리 교수와 프로젝트를 시작하였고, 인터넷과 집단 지성을 적극적으로 활용하였다. 거의 10억 장에 이르는 이미지를 다운로드했고, 아마존의 MTurk (미캐니컬 터크)와 같은 크라우드 소싱 기술을 사용해 이미지에 레이블(Label)을 붙였다. 5만 명 가까운 작업자가 세계 167개국에서 약 10억 장의 후보 이미지정리 분류 작업을 도왔다. 2009년에 객체와 사물을 2만 2천 개의 범주로 분류한 1,500만 장의 미이지 데이터베이스를 공개하기에 이른다. 예를 들어, 고양이의 경우 6만 2천 장의 이미지가 다양한 모양과 자세, 집고양이부터 들고양이까지 모든 종류를 망라한 사진들을 이미지넷에서 만나볼 수 있다. 그리고 이 방대한 이미지 데이터베이스를 모든 사람이 활용할 수 있도록 무료로 공개하였다[5], [6].

2. 딥러닝 기반 이미지 인식

엄청난 양의 이미지넷 데이터는 이미지를 인식하는 비전 분야의 머신러닝 기술 발전에 지대한 영향을 끼쳤다. 특히 기존의 신경망 기술을 발전시킨 딥러닝 기술은 급격한 성능향상을 보여주었고, 비전과 자연어처리 등 인공지능이 필요한 거의 모든 분야에 접목되어 지금도 활발히 연구가 진행되고 있다.

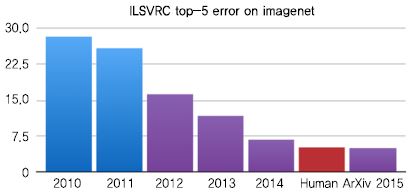

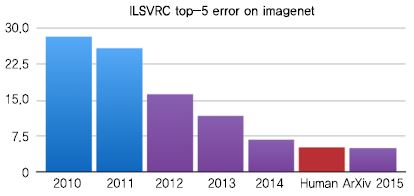

(그림 3)은 이미지넷 데이터를 이용하는 분류 대회인 ILSVRC에서의 이미지 분류 성능을 나타낸다. (그림 3)에서 볼 수 있듯이 2012년도에 토론토 대학의 제프리 힌튼 교수가 딥러닝 기술을 도입한 후에 성능은 눈에 띄게 향상되었고 2015년 도 이후에는 이미지 분류와 같은 일부 분야의 경우 딥러닝의 성능이 인간을 넘어섰다는 평가를 받기도 한다.

Ⅲ. 식물 인식 기술 동향

1. 식물 이미지 인식 기술

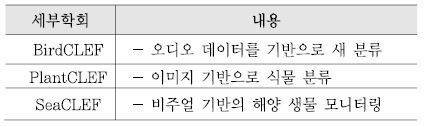

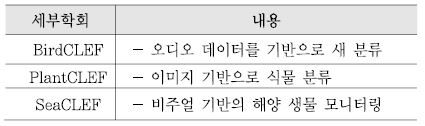

식물 인식 기술은 이미지 인식 기술 중에 이미지 분류 기술을 주로 활용한다. 식물 인식의 주요 목적 중 하나가 카메라로 찍은 식물의 종류를 인식하는 것이기 때문에 식물이 주요 피사체가 되고 따라서 분류만으로도 충분히 사용성이 높아진다. 딥러닝 기술의 발전에 따라 식물 인식 분야에도 딥러닝 기술이 널리 활용되고 있다[7]-[12]. 식물 인식 기술 분야의 대표적인 학술대회로 LifeCLEF[13] 학회가 있다. LifeCLEF 학회는 생물, 지리 등의 생태계에 대한 지식을 구축하고 정보를 제공하기 위하여 연구결과를 공유하고 관련된 데이터를 제공한다[<표 2> 참조].

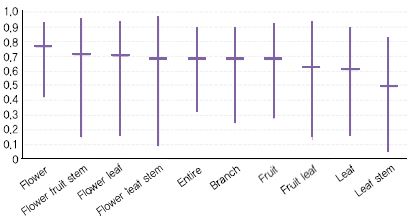

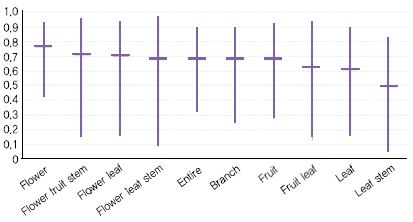

이 중 PlantCLEF는 식물 이미지 인식에 대한 데이터를 제공하고 연구결과를 공유하는 학회다. 식물 이미지 분류를 위하여 유럽과 북미에 서식하는 식물을 대상으로 만 종의 식물에 대한 135만여 장의 이미지 데이터를 제공한다. 이 중 25만 이미지는 EOL에서 제공하는 이미지를 사용하였고, 110만 이미지는 웹에서 크롤링하여 구축하였다[7], [14]. 2017년 학회에서는 다양한 딥러닝 모델을 혼합하여 사용한 앙상블 모델의 Top1 성능이 0.885, Top 5 성능이 0.962로 가장 높은 성능을 보여주었다. PlantCLEF에서는 식물 이미지 데이터를 꽃, 줄기, 잎 등 어느 조직을 찍었는지에 대한 정보도 제공한다. 조직별로 이미지를 분류하였을 때의 성능은 꽃을 이용하여 분류할 때 가장 높았고, 입과 줄기를 혼합하여 분류하였을 때 가장 낮게 나왔다. 즉 꽃을 이용하여 식물을 분류하는 것이 현재로선 가장 성능을 높일 수 있다는 것을 나타낸다[(그림 4) 참조].

2. 식물 이미지 생성 기술

딥러닝을 이용한 식물 처리 기술 중 흥미로운 기술로 새로운 이미지를 합성해 내는 기술로 유명한 GAN (Generative Adversarial Network)을 이용한 식물 이미지 생성 기술이 있다[6]. 이 기술은 모양을 묘사하는 문자열을 입력받아 이를 기반으로 이미지를 생성해 낸다. 꽃과 새에 이 기술을 적용하여 인간이 쉽게 구분해 낼 수 없도록 합성 이미지를 생성하는 성과를 거두었다[(그림 5) 참조].

3. 식물 도감 기반 식물 이미지 분류 기술

오랜 시간 이미지 인식(Visual Recognition)과 텍스트처리는 서로 연관성이 적은 독립적인 분야로서 연구되었다. 그러나 인간은 종종 객체의 생김새나 특징을 글로 묘사하거나 거꾸로 글을 읽고 객체의 이미지, 특징을 상상하기도 한다. 정보를 전달하거나 습득할 때도 마찬가지로 이러한 메커니즘이 적극적으로 활용된다. 예를 들어서 식물도감의 경우에 식물이 어떤 색을 가지고 잎은 어떤 모양을 띄는 지, 언제 꽃이 피는 지 등을 글로 묘사하여 사진이 없거나 부족한 경우에도 식물의 종류를 파악할 수 있도록 정보를 제공한다. 현재 한국전자통신연구원은 디지털콘텐츠 인하우스 R&D 과제를 통해 기업의 수요를 받아 식물 인식 기술을 개발하고 있다. 개발중인 식물 인식 기술은 기존의 꽃 중심의 인식 기술에서 탈피해 잎, 과일 등의 다양한 조직(Organ)에 대한 분류를 수행하며, 또한 식물 감 자료를 이용해 이미지에 대한 묘사를 참고하여 식물 이미지 인식의 성능을 향상할 수 있도록 하고 있다.

Ⅳ. 식물 인식 주요 제품 동향

식물 인식은 자연학습 및 호기심 해결을 위하여 수요가 많은 기술이다. 특히 꽃을 인식하는 기술이 많은 관심을 가지고 있으며, 최근 스마트폰 앱으로 사진으로 찍은 식물이나 꽃을 분류해주는 기술이 많이 출시되고 있다. 그러나 기술 개발의 어려움으로 인하여 아직은 자동 분류 대신 전문가가 개입하여 분류해 주는 형태의 앱이 더 많이 서비스 되고 있는 실정이다. 본 절에서는 관련 앱 동향을 소개한다.

1. Pl@net[15]

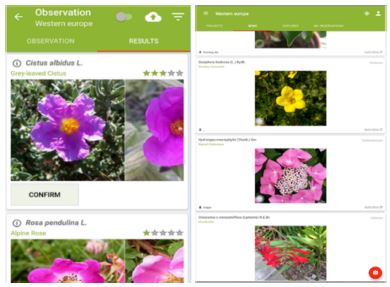

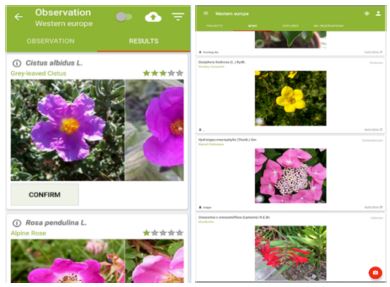

Pl@net은 식물을 식별하기 위한 이미지 공유 및 검색 어플리케이션으로 iOS/Android로 출시되었다. 프랑스 연구 기관(CIRAD, INRA, INRIA 및 IRD) 및 TELA 보타니 네트워크의 과학자들에 의해 개발되었으며, 이미지 인식 기술을 통해 사진에서 식물 종을 식별하는 기능을 제공한다. 관상용 식물에 대한 서비스는 제공하지 않는다. 제대로 종을 식별하는 경우 기여 버튼을 사용하여 프로젝트에 피드백 제공할 수 있다[(그림 6) 참조].

2. FlowerChecker[16]

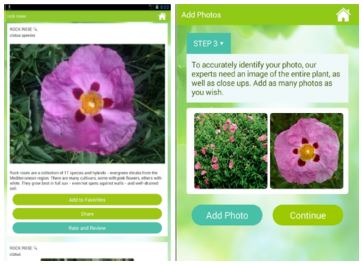

알고 싶은 식물(또는 이끼, 이끼, 심지어 곰팡이)의 사진을 촬영하면 국제적 전문가팀이 식별해주는 앱이다. 식별 과정이 자동이 아니라 전문가의 개입을 통해 수작업으로 이루어지기 때문에 비용을 지불해야 한다. 식물의 식별은 1USD/0.7EUR의 요금으로 제공하며 평균 95% 이상 정확성을 보이며 수 분에서 수 시간까지 시간이 소요된다[(그림 7) 참조].

3. PictureThis[17]

수천 가지 종류의 식물, 꽃, 나무의 데이터베이스를 기반으로 사용자가 간단하게 사진을 찍으면 상세한 설명과 함께 어떤 종류의 식물인지 알 수 있는 어플리케이션. 빠른 속도(1초 미만)가 장점이며 이미지 인식 기술과 정원 및 원예 정보도 제공한다. 중국 연구팀에 의해 2015년에 시작되었고 500만 활성 사용자의 활발한 커뮤니티를 구축하고 있다[(그림 8) 참조].

4. Garden Answers Plant Identifier[18]

이미지 인식 기술을 사용하여 2만 개가 넘는 식물을 식별하고 정확하고 상세한 정보를 제공한다. 정원 및 원예 전문가들에 의해 제공된 식물에 대한 정보뿐만 아니라 원예 하는데 필요한 정보 및 질문에 대한 답변도 제공하는 것이 특징이다[(그림 9) 참조].

5. 다음 꽃 검색[19]

포털의 검색 DB와 연동해서 가장 정확한 자료 제공하며 수치로 제공하는 확률로 신뢰감을 준다. 정확도는 현재 시점에서 90% 수준이나 모양은 비슷하지만 크기나 줄기 길이에 따라서 꽃 이름이 다를 수 있기 때문에 꽃의 형태가 명확할 때만 성공했다는 평이 많은 편이다. 꽃 검색 서비스 개발을 위해 다음 꽃 사전뿐만 아니라 블로그나 까페 등 꽃 사진이 올라온 여러 서비스의 사진들을 가져다 학습에 활용한다[(그림 10) 참조].

Ⅴ. 맺음말

본고에서는 이미지 기반의 식물 인식 기술 동향에 대해서 살펴보았다. 딥러닝을 이용한 최근의 식물 관련 연구 동향을 소개하고 관련된 제품 동향 역시 살펴보았다. 식물은 국가가 보유한 가장 소중한 자원 중 하나이며 실생활에 밀접한 영향을 가지고 있음은 물론 일반인의 관심도 높은 분야 중 하나이다. 최근 딥러닝의 기술을 통해 식물을 인식하고 자동으로 구별할 수 있는 기술이 보급되고 있으며 이는 식물에 대한 인식과 관심을 높을 좋은 기회일 것으로 보인다. 다만 국내의 경우 아직 식물 이미지 등 관련 데이터의 공유가 해외만큼 활발하지 않고, 기술 서비스 개발도 활발하지 않는 점은 빠른 시일 내에 조속히 개선되어 할 점으로 보인다.

References

(그림 1)

EOL 홈페이지: 지구의 동식물에 대한 이미지 데이터 수집

<표 1>

이미지 인식 기술 세부 분류

(그림 2)

이미지 인식 기술별 차이점<a href="#r003">[3]</a>

(그림 3)

연도별 ILSVRC 성능

<표 2>

LifeCLEF의 세부 학회 목록

(그림 4)

식물 조직별 분류 성능

(그림 5)

GAN을 이용한 식물, 새 이미지 합성

(그림 6)

Pl@net 모바일 앱 화면<a href="#r015">[15]</a>

(그림 7)

FlowerChecker 앱<a href="#r016">[16]</a>

(그림 8)

PictureThis 앱 화면<a href="#r017">[17]</a>

(그림 9)

Garden Answers Plant Identifier 앱 화면<a href="#r018">[18]</a>

(그림 10)

다음 꽃 검색 앱 화면<a href="#r019">[19]</a>

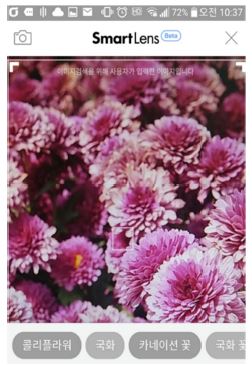

(그림 11)

네이버스마트렌즈 앱 화면<a href="#r020">[20]</a>

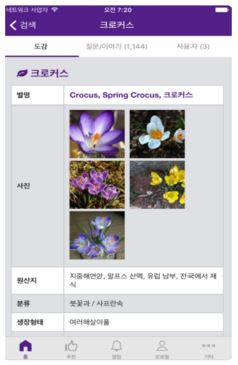

(그림 12)

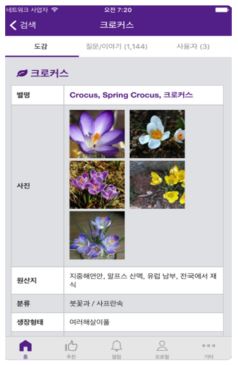

모야모 앱 화면<a href="#r021">[21]</a>