김거식 (Kim K.S.) 광융합시스템연구실 선임연구원

민기현 (Min G.) 광융합시스템연구실 선임연구원

손동훈 (Son D.H.) 광융합시스템연구실 선임연구원

김정은 (Kim J.E.) 광융합시스템연구실 선임연구원

김성창 (Kim S.C.) 광융합시스템연구실 책임연구원/실장

Ⅰ. 서론

초분광 이미징(HSI: Hyper-Spectral Imaging)은 공간 정보에 분광 기술을 더한 것으로 전자기파의 스펙트럼 밴드(Spectrum band)에 따른 2차원적인 영상정보를 초분광 큐브(Hypercube) 형태로 구성하여 대상체의 상태(State), 구성(Composition), 특징(Feature), 변이(Transform) 등을 도출하는 기술을 의미한다. 컬러 카메라나 사람의 눈도 적색, 녹색, 청색의 스펙트럼 정보를 각각 획득하여 사물의 색이나 상태를 인식하므로 분광 이미징이라 할 수 있으나, 보통 분광 이미징이라 함은 이보다 큰 스펙트럼 밴드 수를 가질 때를 의미한다. 초분광(Hyper-spectral)이란 어원은 1983년 사이언스지에 실린 ‘Imaging Spectrometry for Earth Remote Sensing’에서 기원을 찾을 수 있는데, 여기서 초분광 큐브는 연속되고, 100개 이상의 스펙트럼 밴드를 가지며, 물질의 성질을 파악할 수 있을 정도의 스펙트럼 분해능을 가진 것으로 정의하고 있다[1].

초분광 이미징은 1960년대 원격탐사(Remote sensing)가 시작되면서 그 역사가 시작되었다. 초기 원격탐사는 4개에서 7개 정도의 스펙트럼 밴드를 가진 다분광 센서가 위성이나 항공기에 실려 지질 상태, 기상, 작물 생장, 수분함유 등을 확인하는데 사용하다가 점차 밴드 수가 충분히 확보된 초분광 기술이 활용되고, 장치 소형화 및 분석 기술이 발달함에 따라 환경, 국방, 헬스케어, 식품, 농업, 머신 비전(Machine vision), 지질 및 광물 분야 등으로 점차 그 영역을 넓혀가고 있다[2].

최근 발표된 시장 자료에 따르면, 초분광 이미징 시장은 2015년 4억5,730만 달러에서 연평균 11.6% 성장하여, 2020년 7억9,140만 달러에 이를 것으로 전망되며 높은 성장률을 보일 것으로 기대된다[3]. 초분광 이미징 기술이 주로 적용되는 분야는 환경, 국방, 헬스케어, 식품 및 농업, 머신비전, 자원탐사 등이 있으며, 이 중 국방과 헬스케어 분야가 전체 시장 중 각각 19.5%와 19.2%의 비중을 차지하여 가장 큰 시장을 형성할 것으로 전망된다. 특히, 헬스케어 분야는 연평균 성장률 14.1%로 가장 큰 성장세를 보일 것으로 전망된다.

본 논문에서는 초분광 이미징 기술의 분류, 구현방법, 분석기술과 연구개발 동향, 최근 응용분야 등을 중심으로 논의하고자 한다.

Ⅱ. 초분광 이미징 기술

1. 초분광 이미징 기술의 분류

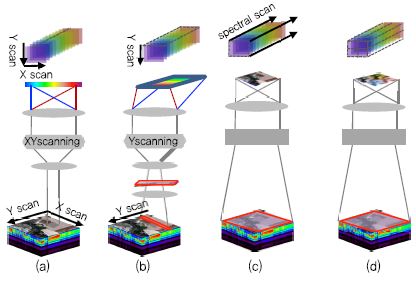

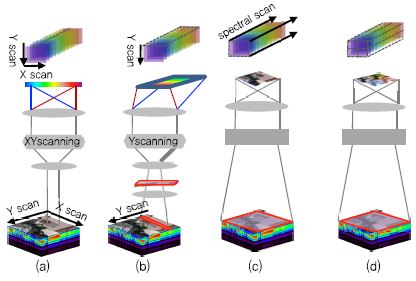

초분광 이미징은 데이터 습득 형태, 파장 대역, 스펙트럼 밴드(해상도) 수에 따라 다양하게 분류할 수 있다[4]. 데이터 습득형태는 크게 공간스캐닝(Spatial scanning) 과 스펙트럼 스캐닝(Spectrum scanning)방식으로 구분할 수 있는데 공간 스캐닝 방식은 일정한 스펙트럼 영역을 동시에 분광하여 공간좌표에 따라 움직이면서 측정하는 점스캐닝(Point-scanning 또는 Wisky-broom)과, 하나의 라인센서를 통해 Y축을 움직여 가며 측정하는 라인스캐닝(Line-scanning 또는 Push-broom)이 있다. 스펙트럼 스캐닝 방식은 파장을 변화시키면서 측정 영역의 전체 이미지를 스캐닝하는 영역스캐닝(Area-scanning 또는 staring)과 센서를 다수의 스펙트럼 영역으로 구분하여 동시에 측정하는 스냅샷(Snapshot) 방식이 있다. 공간스캐닝 방식의 경우 데이터가 연속된 스펙트럼 밴드형태로 저장되기 때문에 일정 영역을 모두 측정한 후에 공간적으로 병합하여 초분광 큐브를 생성하는 반면에, 스펙트럼 스캐닝의 경우에는 공간 정보와 초분광 정보를 같이 획득하기 때문에 빠르게 초분광 큐브를 생성할 수 있다.

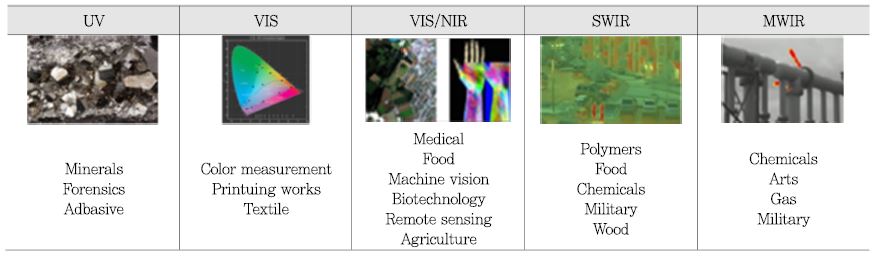

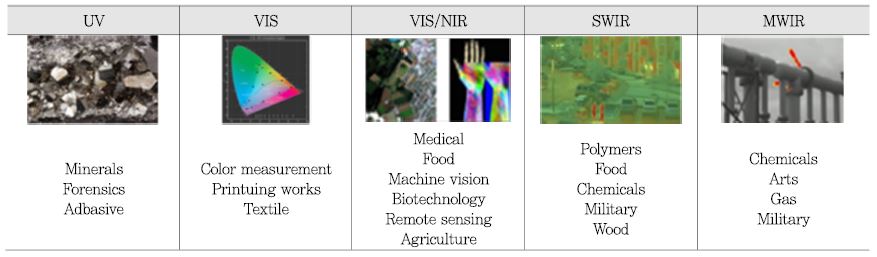

측정 스펙트럼 대역은 초분광 카메라의 응용분야를 결정하는 주요한 분류기준이다. 스펙트럼의 범위에 따라 UV (200~400nm), VIS(400~600nm), NIR(700~ 1,100nm), SWIR(1.1~2.5μm), MWIR(2.5~7μm)로 구분된다. 주로 바이오 분야에서는 UV ~ SWIR대역을, 대기환경(원격감시) 응용분야의 경우 VIS ~ SWIR, 국방분야에서는 SWIR ~ MWIR 대역을 사용한다[<표 1>참조].

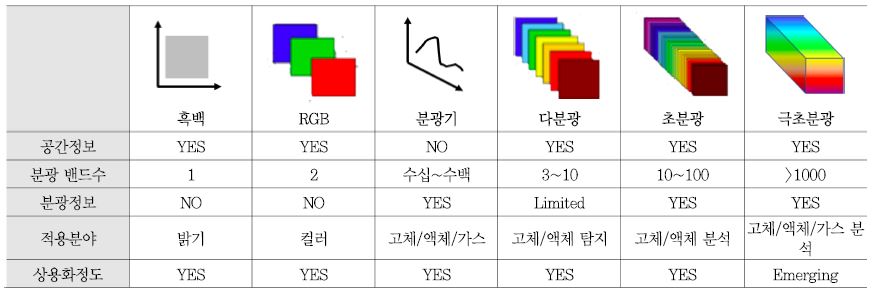

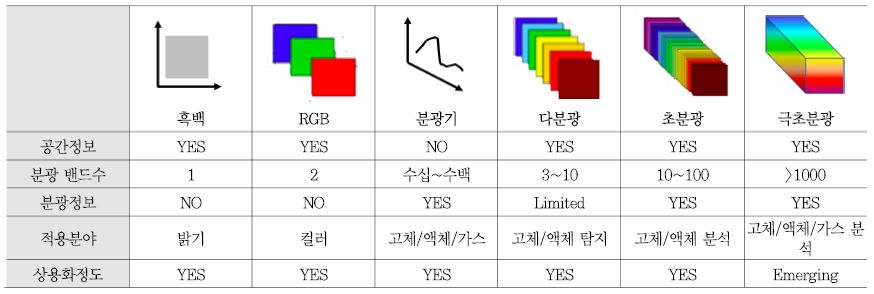

스펙트럼 밴드가 10개 이하이면 다분광 이미징(Multi-spectral imaging), 10개 이상이면 초분광(Hyper-spectral) 이미징, 1,000개 이상이면 극초분광(Ultra hyperspectral) 이미징으로 구분한다[5]. 한편, 스펙트럴 해상도를 통해 초분광 이미징을 구분하기도 하는데, 초분광 이미징은 ∆λ/λ~0.01 정도의 해상도를 갖으며 이보다 이하의 경우 다분광 이미징(Multi-spectral imaging, ∆λ/λ~0.1), 이보다 큰 경우 극초분광 이미징(Ultra-spectral imaging, ∆λ/λ>0.001)으로 구분한다. 다분광 이미징의 경우 스펙트럼에 따른 거시적 대상체 분류정도가 가능하며, 초분광 이미징의 경우 고체나 액체의 화학적 조성비에 따른 대상체의 분류, 극초분광 이미징의 경우 기체의 화학적 조성비에 대한 분석이 가능하다[<표 2> 참조].

2. 초분광 이미징 시스템

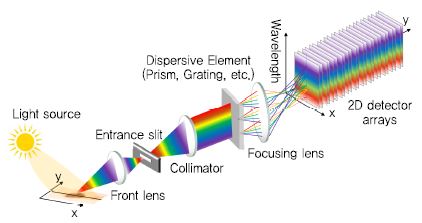

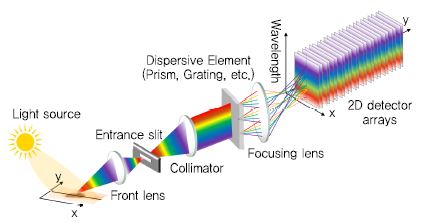

초분광 이미징 시스템은 주로 광원(Optical source)과 광학계, 스펙트럼 분산 장치(Spectral dispersion device) 그리고 이미지 센서(Detector)로 구성된다[(그림 2) 참조].

광원은 외부(Outdoor)환경, 즉 지질상태이나 환경감시, 타겟 검출 등으로 활용되는 위성, 항공, UAV(Unman-ned Aerial Vehicle), 지상 등의 응용분야에서는 자연광(태양광)이 사용되고, 실내(Indoor) 환경에서는 램프, 발광다이오드, 레이저 등 별도의 조명(Illuminator)을 사용한다. 외부환경에서는 대기환경, 대상체와 초분광장치간의 기하학적 상태(입사각, 음영 등)가 주요하게 고려해야 하는 사항이며, 실내환경에서는 광원을 별도로 사용하기 때문에 광원, 대상체, 센서의 기하학적 상태뿐만 아니라 광원의 공간 균일성, 파장의 균일성, 효율, 동작 거리에 따른 광 세기의 균일성 등에 대한 검토가 필요하다[6], [7].

이미지 센서는 초분광 이미징 데이터를 얻는 방식에 따라 1D 또는 2D 이미지센서를 사용한다. 또한, 광학계 및 측정 스펙트럼 대역에 따라 하나의 센서를 사용하거나 다수의 센서를 사용하는 방식이 있다. 보통 대부분의 경우 단일 센서를 사용하지만, 다중 센서 방식을 사용하는 경우 빔 스플리터(Beam splitter)를 사용하여 광 경로를 달리 한 후 각기 다른 센서를 통해 파장 별 정보를 얻는 방식이 대표적이다.

분광 분산 장치는 크게 프리즘, 격자(Grating) 등을 이용하는 모노크로메터(Monochromator) 방식과 필터 휠, 액상결정 가변필터(LCTF: Liquid Crystal Tunable Filter), 음향광학 가변필터(AOTF: Acousto-Optic Tunable Filter) 등을 이용하는 광학 가변 필터(Optical tunable filter) 방식으로 구분된다.

가. 모노크로메터 방식

프리즘은 주로 가시광(VIS)과 근적외선(NIR) 대역에서 사용하며, 굴절률에 따른 파장의 진행 속도 차이 및 광의 이동 경로차를 이용하여 분산시키는 기본 소자이다. 격자 소자(Grating)는 유리 또는 광학 물질 기저에 등간격으로 선이나 일정 패턴을 새겨 넣은 형태로, 빛의 회절과 간섭 현상을 이용하여 입사빔을 파장별로 분산시키는 기능을 한다.

1991년 VTT Electronics 사의 Aikio에 의해 프리즘과 격자를 결합한 형태의 Prism-Grating-Prism(PGP) 소자가 개발되었다. PGP 소자는 프리즘과 격자 두 방식의 장점을 취하면서 소형화가 가능하기 때문에 의료 분야를 비롯한 다양한 분야에서 응용을 위한 연구가 진행되고 있다[8].

나. 가변 필터(Tunable Filter) 방식

가변 필터는 크게 고정형과 가변형으로 나눌 수 있다. 고정형 가변 필터는 필터 휠(Filter wheel) 방식과 패브리 페롯(Fabry-perot) 간섭계 필터가 대표적이며, 가변형 필터는 전기적으로 필터링 파장을 변환시키는 방식으로 액상결정 가변필터와 음향광학 가변필터방식이 있다.

필터휠 방식은 측정 밴드 수를 늘리기 위해서 여러 개의 필터를 Wheel에 쉽게 장착할 수 있는 장점이 있는 반면, 필터 수에 따라 휠의 크기가 커지게 되고, 필터 회전에 따른 이미지의 편심이 발생하기 쉬우며 빠른 회전력과 진동에 안정적인 모터의 성능에도 의존해야 한다는 단점이 있다[9]. 패브리 페롯(Fabry-perot) 간섭계 필터는 1890년대 후반 Charles Fabry와 Alfred Perot에 의해 처음 고안된 필터 방식으로, 다파장의 빛이 필터에 입사되면 공진층에서 다중간섭현상을 일으키고 그 결과 특정한 파장만을 투과시키고 나머지는 반사 시키는 원리를 이용한다. 이때, 입사광의 입사각도, 공진층의 굴절율, 거울면 사이의 거리 조정을 통해 투과 파장을 선택적으로 분광한다. 최근에는 이러한 간섭계 원리를 이용하여 이미지 센서 픽셀에 서로 다른 길이의 필터를 부착하여 여러 파장의 정보를 한번에 얻을 수 있는 스냅샷 방식의 초분광이미지 카메라가 개발되어 상용화되었다[10].

초분광 장치에서 사용되는 가변 필터는 액상결정 가변 필터와 음향광학 가변필터가 대표적이다. 액상결정 가변필터는 Lyot 복굴절 필터 방식을 사용하며 여러 개의 편광자 사이에 두께가 다른 액상 결정 판을 각각 위치시킨 구조이며 전류 변화를 통해 액상 결정 분자의 방향을 변화시켜 투과 파장을 가변시키는 원리를 이용한다. 액상결정 가변필터의 동작 파장 범위는 가시광과 근적외선 영역이며, 파장 튜닝 속도는 액상 결정 분자의 반응 속도에 따라 결정되는데 대략 수십 msec 이다[11]. 음향광학 가변필터는 압전 트랜스 듀서의 진동을 통해 결정성 물질에 일정 주파수의 섭동(Perturbations)을 형성하고 섭동과 입사빔의 광자(Photons)와의 상호 작용으로 일정한 파장만을 통과하는 원리를 이용한다. 음향광학 가변필터의 동작 파장 범위는 자외선(UV)에서 적외선(IR) 영역으로 매우 넓고 파장 튜닝 속도는 수십 μsec로 매우 빠르기 때문에 많은 응용 분야에서 적용되고 있다[12].

액상결정 가변필터는 음향광학 가변필터에 비해 높은 공간 분해능과 고해상도의 이미징을 얻을 수 있지만, 음향광학 가변필터에 비해 느린 파장 튜닝 속도와 필터링 대역폭(FWHM: Full Width at Half Maximum)이 넓다는 단점이 있다. 반면, 음향광학 가변필터는 액상결정 가변필터에 비해 매우 빠른 튜닝 속도, 넓은 시야각 및 미세 파장 변조가 가능하지만, 음파의 음향-광학 효과에 의존하기 때문에 영상 품질은 액상결정 가변필터에 비해 좋지 않은 단점이 있다[12], [13].

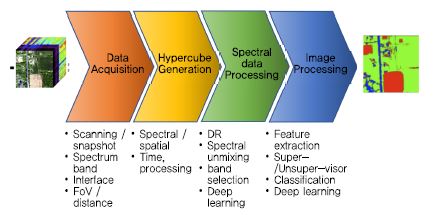

3. 초분광이미징 분석 기술

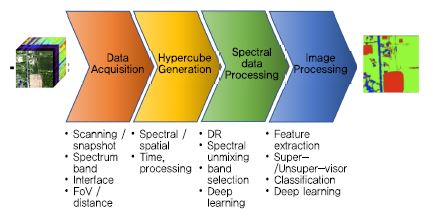

높은 공간 및 스펙트럼 정보를 포함하는 초분광 큐브는 수십~수백 메가바이트의 대용량으로, 대기 및 기하학적인 왜곡 등 물리적인 요인뿐만 아니라, 데이터의 혼합된 픽셀, 인접 대역에서의 높은 상관관계로 인한 높은 데이터 중복성, 초분광 시그니처(signature)의 가변성, 그리고 차원의 저주(curse of the dimensionality)와 같은 많은 요인이 초분광 데이터 분석을 어렵게 한다[14]. 초분광 데이터에서 의미있는 정보를 얻기 위해서는 기본적으로 데이터수집, 초분광 큐브의 생성, 초분광 데이터 처리, 특징값 추출의 과정을 거친다[15].

가. 분광 혼합분석(Spectral Unmixing)

초분광 큐브에서 공간상의 화소(Pixel)는 하나 이상의 물질에서 나오는 반사에너지가 정량적으로 혼합되어 나타난다고 볼 수 있으며, 이를 분광 혼합(Spectral mixture)이라 한다. 분광 혼합은 하나의 픽셀이 대상체의 특성을 담기에는 공간해상도가 부족하거나 분광 센서의 분광 해상도가 낮아 서로 다른 물질에서 나오는 스펙트럼이 개별 스펙트럼의 합으로 나타날 때 발생한다. 이러한 혼합 화소(Mixed pixel)를 분석하는 방법을 분광 혼합분석(Spectral unmixing)이라 한다. 이는 각 화소에 포함되어 있는 여러 물질의 고유한 분광반사특성을 이용하여 각 화소를 구성하는 물질의 비율(Fraction)을 분석하는 방법이다. 이때 각 화소를 이루고 있는 단일의 순수한 물질을 엔드멤버(Endmember)라 하며, 각 화소는 여러 엔드멤버 의 구성 비율(Fraction)의 합으로 나타낼 수 있다(Fractional abundances).

분광혼합분석은 화소에 영향을 미치는 각 스펙트럼 성분을 독립적으로 가정할 수 있는가에 따라 선형 분광 혼합분석(Linear spectral unmixing)과 비선형 분광 혼합분석(Non-linear spectral unmixing)으로 나눈다. 엔드멤버의 합으로 표현되는 선형 분광 혼합분석과 달리, 비선형 분광 혼합분석은 각 엔드멤버의 분광신호가 미시적으로 얽혀있거나, 서로 영향을 주어 화소값은 엔드멤버의 비선형 조합으로 표현된다. 이러한 한계로 인해 선형보다는 비선형 분광혼합분석에서 엔드멤버의 특성을 도출하는 것은 매우 어려운 문제이다[16].

분광혼합분석은 혼합모델에서 엔드멤버를 찾는 것이 목적이다. 분광 혼합분석을 수행하는 과정은 크게 1) Dimensionality reduction, 2) Endmember detection, 3) Abundance estimation으로 이루어진다. 첫 번째 Dimensionality reduction(DR) 방법은 효과적인 분석과 노이즈 제거를 위해 분광영상에서 분광정보를 줄여 원하는 특정정보만을 추출하는 것으로, 비지도학습인 PCA(Principle Component Analysis)와 LDA(Linear Discriminant Analysis) 등을 주로 사용한다. 두번째 Endmember detection 방법은 화소에서 엔드멤버의 종류와 각 엔드멤버의 분광신호를 정의하고 영상에서 엔드멤버을 도출하는 것이다. 이 알고리즘은 크게 동시 알고리즘(Simultaneous algorithm)과 순차 알고리즘(Sequential algorithm)으로 나눌 수 있으며, 동시 알고리즘은 먼저 엔드멤버의 수를 알고 있다고 가정하고 엔드멤버를 도출하는 방법으로 대표적인 것은 N-FINDER이며, 순차 알고리즘의 엔드멤버는 순차적인 엔드멤버의 세트로서 구성되어 있다고 가정하고 엔드멤버를 찾는 것이다.

최근에는 신경망 알고리즘의 발전으로 인해 이 분야에서도 이를 적용하고자 하는 노력이 진행되고 있다[17].

나. 분류(Classification)

분류(Classification)는 최근 초분광 영상에서 주목받는 분야 중 하나이다. 분류 알고리즘은 미지의 한 픽셀을 하나의 클러스터에 할당함으로써 다른 픽셀정보와 구분하여 유사성에 따라 공간상에 경계를 설정한다. 이러한 분류방식은 크게 스펙트럼 분류와 분광공간 분류로 구분할 수 있는데, 스펙트럼 분류는 단순히 스펙트럼 특성에 따라 분류하지만, 분광공간 분류는 인접한 픽셀 간 공간의존성을 고려하여 분류를 수행한다[18], [19].

또 이러한 분류는 지도학습과 비지도학습, 반지도 접근법으로 알고리즘을 구분할 수 있다. 지도학습의 경우 이미 알려진 훈련 샘플을 이용하여 새로운 입력데이터를 분류(Classification)한다. 비지도 학습의 경우 훈련 샘플없이 픽셀의 스펙트럼 유사성에 의존하여 초분광영상의 물질을 군집화(Clustering)한다. 비지도 학습의 대표적인 알고리즘으로는 SDS(Spectral Distance Similarity), K-means algorithm, SCS(Spectral Correlation Similarity) 등이 있으며, 지도학습의 알고리즘으로는 SVM (Support Vector Machine), ELMs(eXtreme Learning Machines) 등이 있다. 최근에는 딥러닝의 발전에 따라 HSI의 영상분류에서도 신경망 기반 알고리즘에 대한 연구가 크게 증가하였다. 4장에서는 신경망 기반의 초분광 분류 알고리즘에 대해 보다 자세히 설명한다.

다. 밴드 선택(Band Selection)

초분광 데이터 분석에 있어서 계산 복잡성을 줄이기 위해 중복된 데이터(Redundancy)를 제거하거나 분석 목적에 적합한 파장 대역의 데이터만을 선택하여 사용하는데, 주로, 웨이블릿 변환을 적용하여 불필요한 이미지 밴드를 제거하는 방식이 사용된다. 이후 피쳐(Feature) 선택 접근법인 유사도 전파 알고리즘을 통해 잡음이 제거된 데이터로 부터 대표적인 밴드를 선택한다[20].

라. 압축 및 전송

초분광 큐브는 하나의 공간영상에 대해서 수십~수백 채널에 이르는 고용량의 분광 데이터를 생성하므로, 데이터의 저장, 전송, 분석, 처리를 위해서 데이터의 압축이 요구된다. 데이터 압축은 크게 손실(Lossy)과 무손실(Lossless) 압축으로 나눌 수 있다[21]. 무손실 압축의 경우 직접적으로 압축된 데이터에서 원본 영상을 복원할 수 있지만, 손실압축의 경우 원본영상의 근사로만 이루어져 데이터의 손실이 있다. 그러나, 많은 경우 초분광 큐브의 모든 부분이 사용되지 않기 때문에 손실 압축으로도 충분히 데이터 복원이 가능하다. 최근의 연구는 응용분야에 따라 적절하게 손실 및 비손실 알고리즘을 혼합한 하이브리드(Hybrid) 압축을 적용하고 있다.

4. 딥러닝 기반 초분광 이미징 분석 기술

2012년 ImageNet challenge에서 딥러닝 알고리즘을 기반으로 하는 AlexNet의 우승은 이미지 분류 문제에서 전통적인 머신러닝 알고리즘들의 분류 성능을 획기적으로 뛰어넘은 사례이다. 데이터 분석에 있어서 딥러닝 기반의 분석 방법은 신경망 층을 깊게 구성함으로써 복잡하고 비선형적인 입력 신호에 대해 높은 성능을 기대할 수 있다. 특히, 초분광 데이터의 경우 대기환경의 변화, 주변물체로 인한 산란, 실시간 변동성 등의 영향을 많이 받기 때문에 측정된 초분광 데이터에서 유용한 정보를 추출하는 것은 어려운 문제이다. 이런 관점에서 딥러닝 기반의 분석 방법은 외부 영향에 불변하고 식별 가능한 특성들을 점진적인 학습을 통해 특징을 찾아내므로 low-level 특징값 추출을 통한 기존 방식에 비해 높은 성능을 기대할 수 있다[22]. 본 장에서는 초분광 데이터 분석에 사용되는 다양한 딥러닝 분석 방법들의 동향을 소개한다.

가. 분광공간 분류

초분광 데이터 분석에서 딥러닝 기술을 가장 많이 활용하고 있는 분야는 분류(Classification)와 군집화(Clustering)로, 분류는 식별된(Labeled) 데이터로 모델을 학습하여 입력 데이터가 무엇인지를 판단하는 것이고, 군집화는 비식별된(Unlabeled) 데이터를 같은 특성을 갖는 것끼리 묶어 그룹화하는 것이다. 딥러닝을 이용한 분광공간 분류기는 심층 신경망을 통해 더욱 함축(Abstract)된 특징값을 추출함으로써, 입력 데이터에서 국소 지점의 변화에 둔감하도록 학습한다.

Stacked Auto-Encoder(SAE)나 Deep Belief Network(DBN) 알고리즘은 기본적으로 비식별데이터의 군집화를 위해 주로 사용되며, 초분광 데이터 분석에서는 입력값의 특징을 추출하고 차원을 줄이기 위해 사용된다. 이들의 기본 구조는 SAE/DBN의 은닉층에서 학습을 통해 입력된 초분광 데이터의 특징값을 추출하고 출력단에 로지스틱 회귀(LR: Logistic Regression) 분류기 등을 연결하여 데이터를 분류한다.

CNN(Convolutional Neural Network) 기반의 분광공간 분류기는 기 식별된 정보를 바탕으로 모델을 학습하여 초분광 데이터를 분류하는 것으로, 각 픽셀 단위의 1차원 초분광 데이터를 입력하는 1D-CNN, 임의 공간 단위의 초분광 데이터를 전처리하여 입력하는 2D-CNN, 전처리 없이 초분광 원본(Raw) 데이터를 입력하는 3D-CNN이 있다.

2D-CNN에서의 전처리는 초분광 데이터 분석에 유용한 공간 정보나 분광 정보를 학습에 추가하여 분류 성능을 높이기 위해 사용되며, 전처리 방법으로 전통적인 머신러닝 알고리즘인 PCA를 이용한 PCA-CNN과, Gabor-CNN 등이 있다[23].

최근에는 CNN에 시간적 변화를 분석하는 Recurrent CNN도 연구되고 있다. 이는 분광공간 특징 값의 변화를 시간에 따라 학습하게 하는 방법으로, 이를 이용하여 특정 지역에서 객체의 변화 추이를 관찰할 수 있다[24].

나. 해상도 개선

상대적으로 낮은 초분광 이미지의 해상도를 개선하기위한 방법은 초고해상도(Super-resolution)법과 영상 융합(Pan sharpening)법으로 구분할 수 있다[25]. 초고해상도법은 단일 이미지 센서에서 부화소 이동(Sub-pixel shift)을 통해 반복적으로 수집한 저해상도 초분광 이미지들을 딥러닝 학습을 통해 고해상도 이미지로 변환하는 것으로, Deep Spectral Difference CNN(SDCNN), 3D Full CNN(3D-FCNN) 등 CNN 모델이 주로 학습에 사용된다. SAE 기반의 방법으로는 고해상도 전정색(Panchromatic) 영상을 다운 샘플링(Down-sampling)하여 저해상도로 변경한 후 원래 고해상도 전정색 영상을 예측하도록 모델을 학습시키는 Stacked Modified Sparse Denoising Autoencoder(S-MSDA) 방법이 있다.

영상융합법은 고해상도 전정색 영상과 저해상도 초분광 영상을 융합하여 초분광 영상의 해상도를 전정색 영상 급으로 높이기 위한 기술로 고해상도의 데이터를 학습에 사용한다는 점에서 초고해상도법과 차이가 있다. 최근에는 자연 이미지(Natural image)에서 기 학습된 Super-resolution CNN 모델을 초분광 데이터에 맞도록 Fine-tuning하여 영상융합에 적용하는 Transfer learning도 시도되고 있다.

다. 분광혼합 분석

분광혼합 분석에 있어서 딥러닝은 앞 장에서 서술된초분광 데이터의 비선형적 분광혼합 특성을 모델링하는데 유용하게 사용될 수 있다. CNN 기반의 분광혼합 분석은 여러 엔드멤버의 신호가 혼합된 초분광 원본 데이터로부터 특징값을 추출하고 이로부터 각 엔드멤버의 구성비를 계산하여 매핑하는 단계로 진행된다. 임의 영역 내 분광공간 정보를 초분광 큐브 형태로 입력하는 3D-CNN이 사용되며, 심층 구성된 컨볼루션층을 통해 특징 벡터를 추출하고, 출력단에서 각 노드의 출력값의 비율에 따라 각 엔드멤버의 구성비를 결정한다. 이 방법은 초분광 이미지 내 4종(나무, 물, 모래, 길)의 엔드멤버를 매핑하는 Jasper ridge dataset 테스트에서 기존 머신러닝 기법에 비해 개선된 성능을 보여 분광혼합 분석에서의 딥러닝 활용 가능성을 보여주었다[26].

라. 합성 학습데이터 생성

초분광 데이터 분석에서 딥러닝 기술을 적용하기 위해서는 대용량의 데이터베이스가 필수이나, 실제 활용분야에 맞는 대량의 학습데이터를 확보하기에는 쉽지 않다. 이를 위해 최근 각광받는 Generative Adversarial Network(GAN)를 이용하여 합성된 학습데이터를 생성하여 딥러닝 모델을 학습시키고자 하는 연구가 시도되고 있다. [27]에서는 3D Bilateral Filter로 초분광 데이터에서 분광공간 특징을 추출한 뒤 이를 GAN에 학습시켜 합성된 초분광 데이터를 생성하는 방법이 제안되었으며, [28]에서는 각 픽셀에서의 분광벡터를 입력으로 사용하여 합성된 학습데이터를 생성하는 분광 분류기용 1D-GAN과 임의 공간 내 초분광 큐브를 입력으로 하여 3차원 합성데이터를 생성하는 분광공간 분류기용 3D-GAN이 제안되었다.

Ⅲ. 초분광 이미징의 응용분야

1. 환경 분야

환경분야에서는 가뭄 스트레스, 환경오염, 수자원 분석, 농작물 감시 등 다양한 분야에 적용되고 있다. 특히 초분광 카메라는 드론 및 항공기에 탑재되어 높은 해상도로 넓은 지역의 측정이 가능하기 때문에 그 응용분야는 더욱 넓어질 것으로 기대된다.

성공적으로 작물을 수확하기 위해서는 수분과 관련된 스트레스를 적시에 관찰하여 적절한 시기에 알맞은 조치를 취해야 한다. 초분광 이미징 센서는 잎의 수분 스트레스를 조기 측정을 가능하게 하였고, 농장 수준에서 가뭄 스트레스 검출에도 사용할 수 있다[29]. 또한, 원격 감지 기술을 통해 농작물의 질병들에 대한 공간적/시간적 변화 및 살균제 처리 유무에 따른 질병 발생 분포도 확인할 수 있다[30].

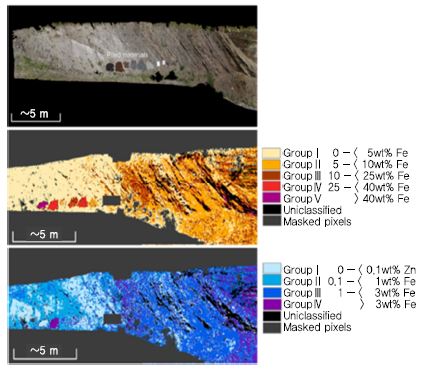

또한, 토양 침식 지도를 위해 광합성 식물, 비광합성 식물, 나지를 구분하는데 적용되기도 하였으며[29], (그림 4)처럼 토지 성분의 공간적 분포도 확보에도 응용되었다[31], [32]. 이외에도 Vesta와 달에 관련된 운석, 단백석의 성분 분석, 대기 상태 측정에도 적용하고 있다[33].

수자원에 대한 연구는 거의 수질을 평가하거나 성분 분류에 집중되어 있다. 일반적으로 초분광 분석법을 이용하여 cyano-phycoerythrin과 독성이 있는 조류, 클로로필 알파 (chlorophyll-a)를 이용한 Phycocyanin 농도, phytoplankton, 부유물질, 탁도를 측정하는데, 이것은 수질 및 해조 레벨을 평가하는데 중요한 요소이다[29], [34]. 또한 초분광 이미징 시스템은 해변이나 호수에 존재하는 식물의 타입, 거대한 켈프(kelp) 및 대형 조류를 분류하여 수질의 상태를 분석하는데 응용되기도 한다[29].

2. 국방 분야

국방 분야에서 초분광 이미징은 주로 정보, 감시 및 정찰을 위해 사용된다. 군용차량이나 지뢰, 병사와 같은 타겟 들이 위장되었을 때 이런 것들을 쉽게 감지하고 구별할 수 있다[35], [36]. 현재 NASA, 미국 해군 연구소 및 US Army NVESD에서도 초분광 카메라를 사용해 표적물을 추적하고 파괴해 왔으며, 오사마 빈 라덴(Osama Bin Laden)을 추적하기 위해 미 해군 실(US Navy SEALs)이 실시한 작전에서도 초분광 이미징 장치를 이용해 수행되었다[3].

이 분야에서 초분광 이미징의 기술은 넓은 시야각과 센서의 높은 해상도, 정확한 이상탐지를 위한 성능 향상의 기술적 발전이 요구되며 실시간 초분광 이미징 장치의 요구를 충족시키기 위한 고속 디지털 신호처리 기술 개발이 필요할 것으로 예상된다.

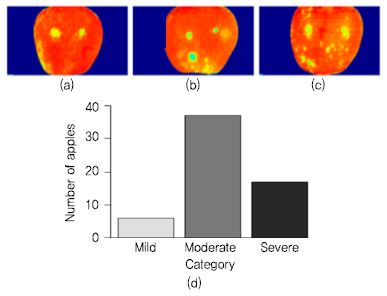

3. Food 분야

식품 및 농작물들은 비접촉, 비파괴 측정 방식으로 분자에 대한 스펙트럼의 특이성 추출이 가능한 초분광 이미징 기술이 이들의 품질 평가/상태 검사에 사용되고 있다[29]. (그림 5)[37]와 같이 농산물의 상처나 결점 측정, 해산물의 색, 질감 및 지방 분석, 육류의 색, 마블링, 부드러움 및 pH, 수분 함류량 등의 특성을 분석하여 식품을 평가하거나 등급 분류에 사용되었다[37]-[39]. 또한 식품의 성분 분석 및 육안/비전 시스템에서 측정할 수 없는 이물질의 존재, 부패, 질병 상태 등을 감지할 수 있다. 요리, 건조, 냉각, 냉동 및 저장, 경화, 발효와 같은 가공 이후 식품 품질 및 안전 평가에 적용되고 있다[37], [38].

또한, 여러 식품 가공 산업 환경에서도 식품 재료를 분류[40]하거나 커피콩의 성숙도에 따른 분류[33] 등에 적용되기도 하였다. 현재 식품 가공 공장에서는 까다롭고 엄격한 FDA 규정과 미국 농무부 지침을 따라야 하기 때문에 초분광 이미징 기술이 식품 품질 감지 및 규제에 더 많이 적용될 것으로 예상하고 있다[3].

4. 바이오/의료 분야

바이오/의료 분야에서 초분광 이미징 기술은 주로 조직의 2차원 스펙트럼 정보를 실시간 분석하여 진단/수술에 이용하는 의료 진단 및 영상 가이드 수술 장치로 사용되고 있다. 출혈성 쇼크(Hemorrhagic shock)의 진단, 말초 동맥 질환, 치아 우식의 조기 발견, 신장 결석 유형 조사, 후두 장애 검출 등에 적용할 수 있으며, 암, 심장 및 망막 질환, 당뇨병 족부병변(Diabetic foot), 조직 병리학 및 이미지 가이드 수술 분야에도 적용 가능하다[41].

ETRI 호남권연구센터는 스냅샷(Snapshot) 초분광 기술을 이용한 피부질환 진단기술에 대해 연구를 진행 중이다. 보통 피부질환 또는 피부암 진단을 위해 전문의는 문진, 촉진을 비롯하여 육안으로 ABCDE(Asymmetry, Border, Colour, Diameter, Evolving), Menzies method, 7 point checklist[42] 등을 사용하는데 초분광 이미징은 산소포화도, 혈류 등의 측정이 가능하여 더 정확한 진단에 도움이 될 수 있다[43]. 또한, 피부질환의 분류 및 초분광 데이터의 분석을 위해 Spectral CNN기반의 딥러닝 기술을 연구하고 있다.

의료 분야에 특화된 초분광 이미징 기술의 적용은 바이오/의료 분야의 조기진단, 진단 정확도, 수술 가이드 등에 기여할 수 있을 것으로 기대된다.

Ⅳ. 결론

초분광 이미징 기술은 한 픽셀당 넓은 대역의 스펙트럼 정보를 획득하여 2D 이미지 상에서 특정 대상 및 물질의 식별 또는 발견을 용이하게 하는 것을 목표로 한다. 초분광 이미징 기술은 하드웨어 구성이 복잡하고 결과 데이터 양이 매우 커 초기 원격감시 분야에 국한되어 사용되었지만 최근에는 다양한 소형 이미지 센서 기술, 대용량 스토리지 기반의 클라우드 기술 및 머신러닝을 통한 대용량 데이터분석 기술 개발이 활발히 이루어 지면서 국방, 환경, 농업, 보안, 머신비전, 바이오/의료 분야로 널리 확산되고 있다.

최근 초분광 이미징 기술의 이슈로는 1) 초분광 카메라의 소형/저가격화, 2) 1,000 채널 이상의 극초분광 이미징 기술, 3) 딥러닝을 포함한 머신러닝 기반의 실시간 데이터 분석 기술 등이다. ETRI에서는 현재 초분광 센서 개발 및 딥러닝 기반의 초분광 데이터의 실시간 분석 기술에 대해 연구개발하고 있으며 향후 의료분야 진단 시스템 및 스마트팩토리용 머신비전 등으로 활용 가능할 것으로 판단된다.

본고에서는 초분광 이미징 기술에 대한 하드웨어 연구 동향과 이에 대한 분석기술에 대해서 나타내었으며, 최근의 이슈가 되고 있는 딥러닝 기술을 이용한 초분광 이미징의 분류, 군집화, 혼합분석, 데이터생성 등에 대해서 기술하였다. 마지막으로 초분광 이미징이 활발히 사용되고 있는 응용분야인 환경, 국방, Food, 바이오/의료 등에 대해서 최신 동향을 파악하였다.

용어해설

Hyper-Spectral Imaging공간정보에 분광기술을 더한 의미로서, 객체의 전자기파의 스펙트럼 밴드(Spectrum band)와 2차원적인 영상정보를 초분광 큐브(Hypercube) 형태로 구하여 대상체의 상태(State), 구성(Composition), 특징(Feature), 변이(Transform) 등을 영상화 하는 기술

약어 정리

3D Full CNN

3D-FCNN

AOTF

Acousto-Optic Tunable Filter

CNN

Convolutional Neural Network

DBN

Deep Belief Network

ELMs

Extreme Learning Machines

FWHM

Full Width at Half Maximum

GAN

Generative Adversarial Network

HSI

Hyper-Spectral Imaging

LCTF

Liquid Crystal Tunable Filter

LR

Logistic Regression

LDA

Linear Discriminant Analysis

MWIR

Mid-Wavelength InfraRed

NIR

Near InfraRed

PCA

Principal Component Analysis

PGP

Prism-Grating-Prism

SAE

Stacked Auto-Encoder

SCS

Spectral Correlation Similarity

SDCNN

Spectral Difference Convolutional Neural Network

SDS

Spectral Distance Similarity

S-MSDA

Stacked Modified Sparse Denoising Autoencoder

SVM

Support Vector Machine

SWIR

Short-Wavelength Infrared

UAV

Unmanned Aerial Vehicle

UV

Ultra-Violet

VIS

Visible

References

<표 1>

초분광 이미징 사용대역

(그림 1)

초분광 이미징 데이터 습득형태 (a) Point- scan (b) Line-scan (c) Area-scan (d) snapshot

<표 2>

밴드수에 따른 분광 기술

(그림 2)

초분광 이미징 시스템의 예

(그림 3)

초분광 이미징 분석절차

(그림 4)

토지의 Fe과 Zn의 분포도

(그림 5)

HSI를 이용하여 분류한 사과의 상태 분류