제4차 산업혁명 시대의 물류/배송로봇의 동향 및 시사점

Logistics and Delivery Robots in the 4th Industrial Revolution

- 저자

-

최성록지능로봇연구실 sunglok@etri.re.kr 김동형지능로봇연구실 donghyungkim@etri.re.kr 이재영지능로봇연구실 jylee@etri.re.kr 박승환지능로봇연구실 sinkyv@etri.re.kr 서범수지능로봇연구실 bsseo@etri.re.kr 박병재지능로봇연구실 bjp@etri.re.kr 송병열지능로봇연구실 sby@etri.re.kr 김중배지능로봇연구실 jjkim@etri.re.kr 유원필지능로봇연구실 ywp@etri.re.kr 조재일지능로봇연구실 jicho@etri.re.kr

- 권호

- 34권 4호 (통권 178)

- 논문구분

- 일반논문

- 페이지

- 98-107

- 발행일자

- 2019.08.01

- DOI

- 10.22648/ETRI.2019.J.340410

본 저작물은 공공누리 제4유형: 출처표시 + 상업적이용금지 + 변경금지 조건에 따라 이용할 수 있습니다.

본 저작물은 공공누리 제4유형: 출처표시 + 상업적이용금지 + 변경금지 조건에 따라 이용할 수 있습니다.- 초록

- This article examines the technical trends of recent logistics and delivery robots. Since the commencement of the 4th industrial revolution, logistics robots and delivery robots have gained considerable attention from the public and the market owing to advances in artificial intelligence and information and communication technology. This article reviews logistics and delivery robots from the perspectives of the market and academia. In addition, we summarize difficulties that they currently face and enumerate further work for their success in the market.

Share

Ⅰ. 서론

제4차 산업혁명은 한층 발전된 정보통신기술(ICT)과 기존 산업 분야의 융합을 통해 지능화, 자동화, 그리고 연결성이 극대화된 산업 환경의 변화를 의미한다. 인공지능, 사물인터넷, 빅데이터, 로봇, 자율주행, 클라우드 컴퓨팅 등이 제4차 산업혁명의 주요 기술 동력으로 알려져 있고, 그 중 인공지능은 가장 핵심적인 기술로 꼽힌다. 로봇 분야도 한 단계 더 진보된 인공지능 기술과 관련 ICT 기술의 발달을 바탕으로 새로운 제품과 시장을 모색하고 있다.

로봇은 그 기능에 따라 산업용로봇(Industrial robot)과 서비스로봇(Service robot)으로 구분된다. 산업용로봇(또는 제조로봇)은 대량생산과 공장자동화로 대변되는 과거의 사회적 요구와 기술 발전에 힘입어 크게 성장하였고, 여전히 세계 로봇 시장에서 과반을 넘는 큰 비중을 차지하고 있다[1]. 개인용컴퓨터(PC) 시대의 도래와 같이 1990년대부터 많은 사람들은 서비스로봇, 특히 개인서비스로봇(Personal service robot)의 시장 이 폭발적으로 성장할 것으로 예상하였다. 그러나 청소로봇을 제외하고는 여전히 킬러 애플리케이션이 부재하고, 로봇 시장에서 차지하는 비중도 미미하다. 최근 저출산과 고령화로 인한 노동 인구 감소와 생산성 혁신에 대한 사회적 요구, 그리고 제4차 산업혁명의 기술적 토대를 바탕으로 여전히 서비스로봇, 특히 물류로봇(Logistics robot), 배송로봇(Delivery robot)과 같은 전문서비스로봇(Professional service robot)에 대한 대중과 시장의 관심이 커지고 있다. 호주의 투자은행 Macquarie는 2017년 전문서비스로봇 시장 중에서 물류로봇, 의료로봇, 접객로봇, (음식)배달로봇이 매출과 출하대수 관점에서 앞으로 가장 유망할 것으로 예상하였다[2].

흥미롭게도 물류로봇과 배송로봇은 모두 세계최대의 전자상거래 기업인 Amazon에 의해 시장의 큰 주목을 받기 시작하였다. Amazon은 2012년에 물류이송로봇 스타트업인 Kiva Robotics를 인수하여 자사의 대형 물류창고에 누적 4.5만 대가량의 물류이송로봇을 적용하여 비용의 약 80%를 절감하고 물류 처리시간도 90분에서 15분으로 단축할 수 있음을 보였다[3]. Amazon의 예는 유사한 물류이송 로봇이 물류창고 외에 공장이나 병원 등의 다른 시설에 적용되어도 Amazon의 경우와 같이 저비용과 고효율을 달성할 수 있을 것이라는 시장의 기대를 갖게 하였다. 또 Amazon은 2013년에 Prime Air[4]라는 드론을 이용한 배송 서비스의 컨셉을 발표하여 대중과 학계에 큰 반향을 일으켰다. 이로부터 약 3년이 지난 2016년 12월, Amazon은 이를 실제 구현하여 구매 13분 만에 미국 캘리포니아 지역에 구매한 물품이 드론을 통해 배송되는 데모를 보였다. Prime Air의 발표 이후 드론뿐만 아니라 보다 현실적인 모바일로봇(Mobile robot)과 장거리 배송에 적합한 자율차(Autonomous car)를 이용한 다양한 형태의 배송로봇의 컨셉과 데모들이 줄을 이었다.

본 고에서는 제4차 산업혁명이라고 일컫는 정보통신기술의 진보와 융합의 토대 위에서 로봇분야, 특히 최근 큰 관심을 받는 물류로봇과 배송로봇의 기술 동향을 살펴보고, 물류 및 배송 로봇의 성공을 위한 기술적 난제와 시사점을 도출하고자 한다.

Ⅱ. 물류로봇의 기술 동향

물류로봇은 창고나 공장에서 물건을 옮기는 작업을 수행하는 로봇이다. 물류로봇의 기능은 로봇이 직접 이동하며 물건을 원하는 위치까지 이송하는 주행(Navigation) 기술과 로봇팔을 통해 물건을 집어 적재나 집하, 분류, 포장을 하는 조작(Manipulation) 기술로 구분할 수 있다. 현재 시장에 나온 물류로봇은 두 가지 기능 중 하나에 집중하거나 두 가지를 모두 수행한다.

1. 물류로봇의 주행 기술 동향

물류이송로봇의 대표적인 예는 앞서 설명한 미국 Amazon Robotics(구, Kiva Robotics)의 물류이송 로봇이다(그림 1 참조). Amazon의 물류로봇은 최신의 기술로 일반적인 물류이송 상황에서 필요한 복잡한 문제를 완벽히 풀기보다 주어진 상황을 단순화하고 경제적이고 적정한 기술을 도입하여 문제를 해결한 것이 가장 큰 특징이다. 이는 로봇시스템을 단순화하고 로봇의 도입과 유지비용을 낮춰 Amazon이 수만 대의 로봇을 운용할 수 있는 이유가 된다. 예를 들어, Amazon의 물류로봇은 기술적으로 복잡하고 어려워 자동화가 힘든 물체인식(Object recognition) 및 파지(Grasping), 포장 등의 조작 기능은 사람이 담당하고, 물건이 담긴 팔렛(Pallet)을 이송하는 작업에만 집중한다. 또한 주행 기술 중 가장 중요한 전역위치추정(Localization)은 사전에 바닥에 부착된 2차원 바코드를 통해 해결한다. 또한 옮겨야 할 물건이 담긴 팔렛도 팔렛에 부착된 2차원 바코드를 통해 이뤄진다. 로봇은 바코드로 이뤄진 로봇 길을 통해서만 이동하며, 장애물 회피를 하지 않고, 사람이 로봇 이동 영역에 진입하고자 할 때 버튼을 통해 모든 로봇을 정지시키는 방식을 사용한다. Amazon 물류로봇의 성공 이후, 유사한 형태와 기술 수준의 많은 물류로봇들을 시장에 발표되었다. 대표적인 예는 중국 Hikvision의 물류로봇 HIKRobot이다. HIKRobot도 Amazon의 물류로봇과 유사하게 2차원 바코드를 기반으로 주행한다. HIKRobot은 현재 중국 1위의 택배회사인 신통택배(STO Express)에 적용되어 하루 20만 개의 택배를 분리하고 처리한다[3]. 캐나다의 CIMCORP[5]의 3D Shuttle은 바닥이 아닌 천장에 설치된 레일을 통해 물건을 옮기는 물류 자동화 솔루션을 제안하였고, 국내의 서울우유와 남양 등에서 적용되었다[3].

그림 1

Amazon Robotics의 물류이송로봇

출처 designboom, “15,000 Amazon Kiva Robots drives eighth generation fulfillment center,” 2014, CC BY, https://vimeo.com/113374910.

하지만, 앞서 언급한 Amazon 물류로봇과 유사 주행 기술은 창고와 같이 제한되고 구조화된 공간을 벗어나 사람이 함께 생활하는 병원이나 호텔과 같은 혼잡한 환경에 적용할 수 없다. 또 바닥이나 천장에 부착된 바코드와 같은 인공표식(Artificial landmark)은 심미적인 이유로 설치를 기피하는 경우가 많다. 따라서 장애물을 감지하고 회피하며 인공표식이 아닌 공간에 내재된 자연표식(Natural landmark)을 이용하여 로봇의 위치를 추정하여야 한다. 미국 Aethon[6]의 TUG는 병원에서의 물건을 나르는 작업을 수행하는 대표적인 상용화된 로봇이다(그림 2 참조). TUG는 사전에 제작된 로봇용 공간지도와 레이저센서(이하 LiDAR) 데이터를 이용해 전역위치추정을 수행한다. 학계에서 널리 알려진 MCL 기법을 통해 위치를 추정하는 것으로 보인다. 또 장애물을 감지하여 회피하는 것도 가능하다. 안전성을 위해 LiDAR뿐만 아니라 초음파/적외선센서, 범퍼센서를 탑재하여 로봇 전방의 180°의 장애물을 모두 감지 가능하다. TUG는 (로봇팔 없이) 병원의 엘리베이터나 자동문을 별도의 장치로 원격 제어하는 것이 특징이다. TUG는 2013년 기준으로 전 세계 150개 이상의 병원에서 500대 이상 로봇을 운용 중인 것으로 알려져 있고[3], 현재 1년에 약 5백만 건의 이송 서비스를 제공하고 있다고 한다[6]. 국내 유진로봇의 GoCart[7]는 TUG와 유사한 기능과 서비스를 제공하는 물류로봇이다. GoCart는 유진로봇에서 자체 개발한 LiDAR를 채용하고 있고, LiDAR와 카메라를 이용해 자연표식을 이용한 전역위치추정이 가능하다. 또 부분적으로 AR 마커를 도입하여 엘리베이터의 위치나 현재 층수, 충전기 위치를 정확하게 파악할 수 있다. GoCart는 2018년 을지대병원에 도입되어 본관 진단검사의학과를 하루 4번 순회하여 진단 검사체를 이송하는 서비스를 제공하고 있다. 배달앱 “배달의민족”으로 유명한 우아한형제는 Bear Robotics[8]와 고려대 정우진 교수팀과 협업하여 음식점에서 음식을 서빙하는 로봇인 딜리(Dilly)를 시연하였고, 신세계 이마트도 주어진 고객을 따라 이동하는 자율주행 카트 일라이(eli)를 선보인 바 있다[9]. 딜리와 일라이는 모두 TUG와 GoCart와 유사하게 실내 공간에서 사전에 제작된 지도와 LiDAR와 카메라를 이용해 주행한다.

그림 2

Aethon의 병원 물류이송로봇 TUG

출처 aethonrobotics, “C|Net features Aethon's TUG at UCSF Mission Bay,” Jan. 2015, CC BY, https://www.youtube.com/watch?v=REEzJfGRaZE

2. 물류로봇의 조작 기술 동향

물류로봇에서 조작 기술, 즉 물건을 집어 옮기는 작업은 물건의 크기와 형상, 무게, 재질이 상이한 경우가 많기 때문에 물건을 인지하고, 이를 실제 집는 것(Picking)은 앞서 언급한 자율주행에 비해 상대적으로 복잡하고 어려운 문제이다. 따라서 Amazon의 물류로봇은 이러한 조작 작업을 사람이 수행하고, 물건을 이송하는 작업만 로봇이 수행하는 형태로 로봇의 역할을 단순화하였다. 그러나 노동 환경 개선과 보다 효율적인 물류 처리에 대한 요구에 많은 관련 기술이 개발/연구되고 있다.

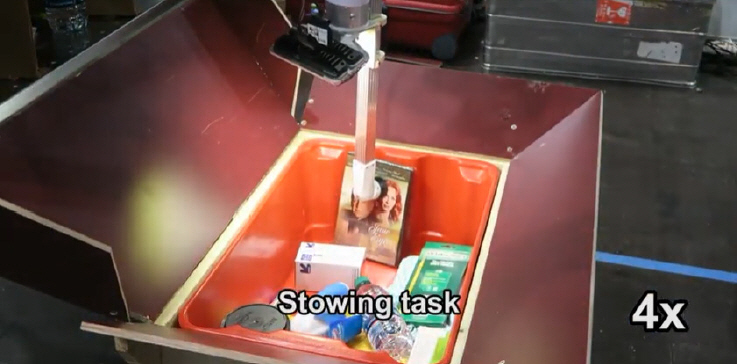

Amazon은 ICRA 2015 학술대회에서 Amazon Picking Challenge1)를 개최하여 이러한 연구를 독려하였다. Amazon Picking Challenge는 20분 동안 로봇이 정해진 물건들을 팔렛에서 찾아 집고, 로봇이 직접 포장상자까지 이동하여 이를 상자에 넣는 미션을 수행하게 된다. 따라서 대회에서는 물건을 인지하는 기술과 임의의 형태를 가진 물체들을 집는 기술이 중요하고, 이러한 문제는 현재 Amazon의 물류로봇이 풀지 못한 부분이다(그림 3 참조).

그림 3

Amazon Picking Challenge 2016 (Team Nimbro)

출처 Anton Milan, "Team NimbRo at APC 2016", Sept. 2016, CC BY, https://www.youtube.com/watch?v=PpbvNeairZQ

2015년 첫 대회에서는 베를린공대의 RBO팀이 148점을 받아 우승하였는데, 20분 동안 10개의 물건을 성공적으로 옮긴 수준이다. 2015년 대회에서는 물건을 로봇손으로 파지(Grasping)하는 방식과 진공청소기와 같이 공기를 흡입(Suction)하여 물건을 로봇팔에 붙이는 방식이 모두 출전하였는데, 이후 대회는 RBO팀이 사용했던 흡입 방식이 그 단순함과 효율성으로 널리 사용되었다. 총 3회에 걸친 Amazon Picking Challenge를 통해 3차원 물체 인지와 조작 기능을 담고 있는 오픈소스 소프트웨어 MoveIt[10]이 보다 널리 알려지고 사용되는 계기가 되었고, KUKA iiwa[11]와 같은 경량 로봇팔을 모바일로봇 위에 탑재한 모바일 매니퓰레이터(Mobile manipulator)를 이용한 연구과 제품 개발도 활발해졌다. 또 대회 참가자들이 대회를 통해 축적된 기술을 바탕으로 스타트업을 설립한 사례도 있는데, 벨기에의 Pick-it N.V.[12]와 중국의 XYZ Robotics[13]가 대표적이다. Pick-it N.V.는 로봇팔에 쉽게 적용할 수 있는 3차원 비전 시스템을 3D 카메라와 산업용 프로세서로 구성된 제품으로 구현하였고, XYZ Robotics는 기존 산업용 로봇팔을 기반으로 다양한 종류의 물건을 집을 수 있는 소프트웨어와 시스템을 솔루션으로 제공한다.

2003년 독일 DHL이 개발한 소포 로봇은 조작 기능이 포함된 물류로봇의 첫 번째 사례로 꼽힌다[14]. DHL의 로봇은 트레일러 및 컨테이너 안에 있는 박스들을 컨베이어 벨트에 내려놓는 고정형 로봇팔인데, 실제 현장에 적용되지는 못했다. 이후 2013년 미국의 Wynright[15]는 트럭의 물류 하차 로봇을 시장에 내놓았다. Wynright는 DHL이 사용하던 LiDAR 대신 상대적으로 저렴한 카메라를 사용하여 시간당 약 500개의 박스를 처리할 수 있다. 같은 시기에 프랑스 ALFI Technologies[16]도 PACKTRIS라는 팔레타이징(Palletizing) 로봇을 선보였다. 팔레타이징은 팔렛 위에 물건을 적재하는 작업이다. PACKTRIS는 3차원 카메라를 통해 다양한 크기의 박스를 인식할 수 있고, 휴리스틱 알고리즘을 통해 다양한 크기의 박스를 3차원 테스리스와 같이 빈틈없이 적재 가능하고, 시간당 최대 80개 소포를 적재 가능하다. 네덜란드의 Robomotive B.V.는 2018년 DHL의 물류창고에 집기 및 적재를 적용하였는데, 로봇팔의 주변 환경을 제한구획(cell)으로 통제하여 로봇이 박스를 집기 유리한 환경을 마련하여 시간당 400개의 박스 처리가 가능하다[17]. 중국의 Dorabot도 일본의 야스카와(Yaskawa)와 전략적 제휴 맺고 물품의 정렬(Sorting), 적재(Loading), 팔레타이징(Palletizing) 작업을 개발하였는데, 정렬은 시간당 700개, 물품을 떨어뜨리는 중력 정렬의 경우 시간당 1000개, 적재의 경우 컨테이너와 트레일러에 시간당 각각 380개, 280개, 팔레타이징은 시간당 400개까지 가능하다[18].

Ⅲ. 배송로봇의 기술 동향

배송로봇도 물류로봇과 유사하게 주어진 물건을 원하는 장소까지 옮기는 미션을 수행하는 로봇이다. 물류로봇이 창고나 공장과 같이 한 장소(건물)내에서 물건의 옮기는 것과 달리, 배송로봇은 건물을 벗어나 원거리의 다른 건물까지 물건을 옮기는 실외 주행을 포함하는 것이 큰 차이점이다. 따라서 식당에서 음식을 서빙하거나 병원에 의료폐기물을 이송하는 로봇의 경우 기술적으로는 물류로봇으로 구분할 수 있다. 물건을 옮기는 작업에 대해 장소와 역할에 따라 물류 또는 배송이라는 의미가 부여된 것이기 때문에 넓은 의미에서 물류로봇과 배송로봇은 같은 의미로 사용되기도 한다.

그림 4의 Starship Technologies[19]는 2014년 에스토니아에서 시작된 스타트업으로 현재 에스토니아, 미국, 영국의 6곳에서 모바일로봇을 이용한 물품과 식자재 배송 서비스를 운영하고 있고, 현재 약 30,000건의 배달을 완료하였다(2019년 2월 기준, 한 달 이용료 약 10달러). 또 Benz와의 협업을 통해 자율차를 이용해 보다 원거리의 배송 서비스인 Robovan에 대한 컨셉을 발표하기도 하였다. Amazon 또한 2019년 Scout이라는 이름으로 Starship과 유사하게 모바일로봇을 이용한 배송 서비스 데모를 선보였다[20]. Starship의 배송로봇은 카메라와 GPS, 관성센서(IMU)를 사용하고, LiDAR를 사용하지 않고 자율주행하는 것이 특징이다. 상대적으로 고가인 LiDAR를 사용하지 않으므로 경제적 관점에서 다수의 배송로봇을 운용하기 유리해진다. LiDAR가 담당하는 로봇근처의 물체 감지 및 보도(이동 가능 영역) 인식은 카메라를 이용한 CNN기반 영상인식기술이 담당한다. 현재 Starship의 배송로봇은 5개의 카메라를 이용해 360° 시야각의 파노라마 영상을 획득하고, 이를 일반 상용 GPU를 사용해 초당 2,000프레임의 영상을 처리 가능하다. Starship 배송로봇의 시연 영상[21]을 분석하였을 때, Starship의 배송로봇은 GPS/IMU와 길지도 매칭을 통해 전역위치인식을 수행하고, 카메라를 통해서 보도 위에서 로봇의 방향각과 위치를 추정하고 주변 물체들을 인식하는 것으로 보인다. 현재 배송 서비스 진행하는 6곳의 경우, 높은 건물이나 숲/터널이 있는 지역은 아니기 때문에 GPS를 이용한 기술로 충분히 자율주행할 수 있을 것으로 생각된다. Amazon의 Scout의 경우도 LiDAR를 사용하지 않는 Starship과 유사하게 카메라와 CNN기반 인식 기술을 사용하고 있다.

그림 4

Starship Technologies의 배송로봇

출처 Mart Rootamm (Mardus) [CC BY-SA 4.0 (https://creativecommons.org/licenses/by-sa/4.0)]

한편 실리콘벨리의 스타트업인 Marble[22]은 Starship과 달리 기존 실내 자율주행 로봇이나 실외의 자율주행 자동차와 유사한 주행기법을 사용하고 있다. Marble의 배송로봇은 사전에 획득한 3차원 정밀지도(HD map)와 로봇에 탑재된 3차원 LiDAR를 사용하여 전역위치추정을 수행한다. 또 3차원 LiDAR와 2차원 LiDAR를 사용하여 장애물 감지 및 보도 인식을 수행한다. Marble의 배송로봇은 Starship의 배송로봇보다 복잡한 도심환경에서 동작 가능하며 다중센서를 통해 높은 안정성을 갖지만, 사전에 정밀한 공간지도를 구축하여야 하고, 로봇의 부품가가 높아지는 단점이 있다. 국내의 우아한형제도 2018년 Starship과 Marble의 배송로봇과 유사한 실외 배송로봇의 컨셉을 공개한 바 있다[23].

Ⅳ. 관련 요소 기술의 학계 동향

학계에서 물류 및 배송로봇 그 자체에 대한 연구는 드물지만, 이를 위한 핵심 요소 기술들은 예전부터 많은 연구가 이뤄지고 있다. 모델기반의 전통적인 연역적 접근 방법과 최근 큰 주목을 받고 있는 기계학습(Machine learning)을 이용한 귀납적 접근 방법 모두 활발히 연구되고 있다.

1. 위치추정 기술 동향

로봇의 현재 위치와 방향각을 추정하는 연구는 모바일로봇 분야에서 가장 중요한 연구 주제 중 하나이다. 전역위치추정 기술은 공간의 인공표식을 이용하는 방법과 자연표식을 이용하는 방법으로 구분할 수 있다. 2차원 바코드나 반사마커(Reflective marker), UWB나 WiFi AP와 같은 라디오 비콘(Radio beacon)은 인공표식의 예이고, Amazon Robotics와 Hikvision의 물류로봇이 인공표식을 이용한다. 자연표식을 이용하는 방법은 추가적인 인공표식의 설치 없이 공간의 모양이나 내재된 특징을 이용하는 방법이다. Aethon의 TUG와 유진로봇의 GoCart는 자연표식을 이용한다. 자연표식을 이용하는 방법은 환경으로부터 많은 정보를 얻을수록 위치추정에 유리하기 때문에 LiDAR나 카메라와 같이 대용량 데이터를 제공하는 센서를 사용하는 것이 일반적이고, 학계의 연구는 대부분이 자연표식을 이용하는 연구에 집중되어 있다. 현장에서는 조명 등의 환경 변화에 민감한 카메라를 이용하는 방법보다 LiDAR를 이용하는 방법이 선호되고,입자필터(Particle filter)를 사용하는 MCL이나 그래프최적화(Graph optimization)가 널리 사용된다. Google의 Cartographer[24]는 LiDAR 데이터와 그래프최적화를 이용한 위치추정과 지도작성이 가능한 오픈소스 프로젝트이다.

실외 모바일로봇의 경우 인공표식으로써 위성을 사용하는 GNSS가 가장 기본적이고 널리 사용되는 위치추정 방법이다. 미국의 GPS, 러시아의 GLONASS, EU의 갈릴레오(Galileo)는 GNSS의 각 국가별 구현인데, 일반적으로 GNSS라는 기술용어보다 GPS가 더 널리 사용된다. GPS는 단독으로 사용되는 경우는 드물고, IMU와 융합하여 사용하는 것이 일반적이다. GPS와 IMU의 융합은 로봇 분야뿐만 아니라 제어계측, 항공, 선박 등의 분야에서 오래전부터 많은 연구가 이뤄졌다. 또 실외 모바일로봇이나 자동차와 같이 로봇이 이동 가능한 (도로)지도가 미리 주어진 경우, 현재 추정된 위치와 지도의 정보를 매칭하여 위치를 보정하는 기술도 널리 알려져 있다. GPS는 높은 건물들이 밀집된 도심(urban canyon)이나 터널 등에서 정확도 급격히 떨어지거나 위치추정이 불가능한 단점이 있고, 이를 다른 센서를 통해 보완하는 연구들이 많이 이뤄지고 있다.

카메라는 가장 쉽고 저렴한 비용으로 구할 수 있는 센서로 한 장의 영상을 이용해 카메라의 현재 위치를 추정하는 영상기반 장소인식(Visual place recognition) 기술과 연속된 영상을 통해 카메라의 이동궤적을 추적하는 영상기반 오도메트리(Visual odometry) 기술, 그리고 이 둘을 융합한 형태로 구분할 수 있다[25]. DBoW2[26]는 전통적인 접근을 따르는 장소인식 기술로 영상에서 추출한 지역적 특징점(Local salient feature)을 장소의 단서, 즉 bag-of-words(BoW)로 모델링하여 장소를 인지하는 기법이다. ORB-SLAM2[27]는 ORB라는 지역적 영상 특징점을 이용하는 전통적 기법의 오도메트리 기술과 장소인식 기술이 융합된 SLAM 기술이고, DSO[28]은 영상 특징점의 추출 없이 영상의 각 픽셀값을 바로 사용하는 오도메트리 기술이다. Google의 실외 영상기반 위치인식 기술인 Visual Positioning Service(VPS)[29] 또한 영상 특징점을 이용한 전통적인 접근의 한 예이다.

최근 딥러닝을 이용한 학습기반의 기술들이 학계에서 많이 시도되고 있다. PoseNet[30]과 NetVLAD[31]는 딥러닝을 이용한 장소인식 기술의 예이다. NetVLAD는 계절, 날씨, 시간 변화를 극복할 수 있는 연구를 목표로 하고 있고, 이러한 변화를 포함하고 있는 Pitts250k 데이터셋에서 25m 오차 범위 내의 top-1 기준으로 81.0%의 인식률(recall)을 달성하였다. KAIST 김아영 교수팀은 카메라가 아닌 LiDAR 데이터에서 Scan Context[32]라는 패턴을 추출하여 장소를 인식하는 연구를 수행하였다. UnDeepVO[33]는 딥러닝을 이용한 영상기반 오도메트리 기술인데, 현재 전통적인 접근법을 따르는 오도메트리 기술들보다 성능이 크게 떨어지고, 딥러닝 접근을 적용했다는 점에 의미가 있다.

2. 물체/환경인지 기술 동향

물체의 종류와 형태, 그리고 로봇이 이동 가능한 영역을 인식하는 것은 물류/배송로봇의 자율주행과 물체 조작에 매우 중요한 기능이다.

자율주행 중 경로상의 물체, 즉 장애물을 인지하는 기능은 LiDAR나 깊이카메라를 통해 쉽게 구현 가능하다. 또한 Starship의 배송로봇과 같이 일반 카메라와 영상기반 물체인식을 통해 이를 대체 가능한데, 이를 위해서는 정확하고 실시간으로 동작하는 영상기반 물체인식 기술이 필요하다. 딥러닝을 이용한 물체인식 기술은 기존 기술들에 비해 높은 인식 성능을 보이고 있고, YOLO(You Only Look Once)[34]나 SSD(Single Shot MultiBox Detector)[35]와 같은 기술은 딥러닝 기술에 문제가 되었던 실시간 동작 문제도 해결하였다. Starship이나 Amazon Scout과 같은 배송로봇도 유사한 딥러닝 기술이 적용되었을 것으로 생각된다.

로봇팔을 이용한 물체의 조작을 위해서는 물체를 인지하는 것뿐만 아니라 물체의 3차원 형태도 알아야 한다. 이를 위해서는 일반 카메라보다는 깊이(Depth) 데이터도 동시에 획득할 수 있는 RGB-D 카메라를 이용하는 것이 일반적이고, 관련하여 Point Cloud Library(PCL)[36]이나 MoveIt[10]과 같은 오픈소스 프로젝트가 활발히 진행되고 있다.

물체 또는 장애물을 인지하는 것 외에 실외에서 이동하는 배송로봇은 보도와 같이 로봇이 주행 가능한 영역을 인지하는 것도 필요하다. LiDAR를 이용해 연석(curb)을 검출할 수 있지만 도로와 보도의 경계가 불분명하지 않은 경우 실패할 수 있다. 따라서 LiDAR의 거리 감지 데이터 외에 영상 데이터를 활용할 수 있다. 딥러닝 접근을 이용한 SegNet[37]은 CNN으로 영상 인코딩하고 영상 내 영역의 의미(semantic)를 디코딩하는 네트워크 구조를 통해 영상 내 지면과 나무, 표지판과 같은 지물과 사람, 자동차 등과 같은 물체를 구분할 수 있는 의미적 영상분할(Semantic segmentation) 기술이다. 또 Mask R-CNN[38]은 기존 물체 인식과 의미적 영상분할 기술이 합쳐진 것으로 개별 물체를 인지하는 것과 영역을 분할하는 기능이 동시에 가능하지만 현재 실시간으로 동작하지는 않는다.

Ⅴ. 결론 및 시사점

기술 발전과 사회 변화와 맞물려 물류 및 배송로봇 시장은 앞으로 더욱 크게 성장할 것으로 기대된다.

많은 대기업과 스타트업에서 앞 다투어 관련 제품과 기술을 선보이고 있고, 본 고에서 그 중 기술적 특징이 있는 제품들을 살펴보았다. 여러 제품들을 관통하는 중요한 시사점은 바로 제품으로서 성공하기 위해서는 “적절한 문제의 제약과 해법이 필요”하다는 것이다. 모든 상황에 대처하고 동작하는 로봇은 매우 복잡하고 비싸거나 또는 불가능할 수 있다. 따라서 로봇이 적용되는 환경에 제약을 주고 이를 통해 로봇시스템을 단순화하여 경제적이고 효과적인 로봇을 만들 수 있다. Amazon Robotics의 물류이송로봇은 로봇의 이동 경로를 2차원 바코드가 설치된 길로 한정하여 쉽게 로봇의 위치를 파악한다. 또 물체인식 및 집어넣기와 같이 복잡한 작업은 로봇의 역할에서 배제하였다. Starship의 배송로봇은 로봇이 동작하는 실외 환경을 높은 건물이 즐비한 복잡한 도심이 아니라 어느 정도 GPS의 정확성이 확보되는 환경으로 한정하여 서비스를 시작하였다. 시장에서는 로봇을 위한 인공표식의 설치를 기피하지만, 유진로봇의 GoCart는 적은 수의 인공표식을 엘리베이터와 충전기 근처에 설치하여 현재 층수를 알아내는 기능과 충전을 위한 정밀 위치추정을 쉽게 해결할 수 있었다. Amazon와 Starship은 현실성 있는 로봇과 서비스를 통해 시장에 진입하여 어느 정도 성과를 내고 있다. 두 기업의 미래 자산은 바로 그들의 로봇에 구현된(카피할 수 있는) 적정한 기술이 아니라 장시간 대규모 운영을 통해 축적된 마일리지, 즉 경험이고 이러한 부분이 이후 시장 진입하는 다른 기업들과의 차이를 만드는 부분일 것이다.

또 본 고에서는 또 학계에서 발표된 관련 요소 기술들 중 주요 마일스톤에 해당하는 기술들을 간단히 살펴보았다. 기술이 임계점을 지나 한 단계 더 발전함에 따라 보다 다양하고 복잡한 상황을 극복할 수 있을 것이다. 자율주행 기술 관점에서 LiDAR를 이용한 실내 자율주행 기술은 어느 정도 완성되었다고 보이지만, 실외 주행 기술은 해결하여야 할 이슈가 많다. Starship의 GPS 주도적인 접근 방법은 아파트가 많은 국내 환경에서는 부정확한 위치추정으로 인해 자율주행이 쉽지 않을 것으로 예상된다. 또 Marble과 같이 자율차에 사용되는 3차원 고밀도 지도(HD map)를 사용하여 위치추정을 수행하는 것이 대안이 될 수 있는데, 환경 변화에 따른 지도의 업데이트 이슈뿐만 아니라 최종 목적지까지 가기 위해 작은 길까지 고려된 3차원 고밀도 지도가 구축 가능할지는 의문이다. 카메라는 시간과 날씨에 의한 조도의 변화에 민감하고, 이러한 부분은 앞으로 더욱 많은 연구가 필요하다. 따라서 국내의 도심 환경에서 로봇을 이용한 배송 서비스를 제공하기 위해서는 풀어야 할 문제들이 많다. 물류로봇을 위한 조작 기술 또한 학계의 지속적인 관심이 필요한데, 물체의 3차원 형태를 정확하게 인지/추정하는 것에서부터 미지의 형태의 물체를 로봇이 파지하는 것까지 많은 연구가 필요하다.

또한 물류 및 배송로봇은 기술적인 부분 외에 사회적으로 해결하여야 할 부분이 많다. 우선 물류로봇은 반복적이고 고된 노동환경을 개선하지만 자동화에 따른 인력 감축을 야기할 수 있다[39]. 또한 실외 자율주행은 안전사고와 사생활 침해와 같은 문제를 야기할 수 있다. 따라서 로봇의 역할과 인간의 삶의 질을 향상을 고민이 필요하고, 관련 법적 규제에 대한 사회적 합의가 필요하다.

용어해설

전역위치추정 GPS나 카메라 영상, LiDAR 데이터와 바퀴의 엔코더 데이터, IMU 데이터 등을 이용하여 주어진 절대좌표계를 기준으로 로봇의 위치와 방향각을 추정하는 기술

AR 마커 증강현실(AR: Augmented Reality)에서 카메라의 위치와 자세를 파악하기 위해 영상인식을 통해 쉽게 인지되도록 설계된 인공표식물

CNN 영상과 같이 다차원 데이터에 적합한 신경망 네트워크의 구조 중 하나로 데이터에서 값들의 인접성과 네트워크 가중치 공유를 통해 효율적인 학습이 가능

약어 정리

AP

Access Point

AR

Augmented Reality

CNN

Convolutional Neural Network

GNSS

Global Navigation Satellite System

GPS

Global Positioning System

GPU

Graphics Processing Unit

HD

High Definition

ICRA

IEEE International Conference on Robotics and Automation

IMU

Inertia Measurement Unit

LiDAR

Light Detection and Ranging

MCL

Monte Carlo Localization

ORB

Oriented FAST and Rotated BRIEF

RGB-D

Red, Green, Blue, and Depth

SLAM

Simultaneous Localization and Mapping

UWB

Ultra Wide Band

DHL Trend Research, "Robotics in Logistics: A DPDHL Perspective on Implications and Use Cases for the Logistics Industry," 2016.

Wrnright Robotic Truck Unloader, https://www.wynright.com/products/by-system/receiving-systems/robotic-truck-unloading/

ALFI Technologies PACKTRIS, https://www.alfi-technologies.com/en/intralogistique/logistique-et-messagerie/robot-palettiseur-packtris/

DHL Netherlands, "Robot Picking Cell with Vision Technology at DHL Warehouse in Beringe," September, 2018. https://www.logistics.dhl/nl-en/home/press/press-archive/2018/robot-picking-cell-with-vision-technology-at-dhl-warehouse-in-beringe.html

James Vincent, "Amazon has made its own autonomous six-wheeled delivery robot," The Verge, January, 2019. https://www.theverge.com/2019/1/23/18194566/amazon-scout-autonomous-six-wheeled-delivery-robot

W. Hess, D. Kohler, H. Rapp, and D. Andor, "Real-Time Loop Closure in 2D LIDAR SLAM," in Proc. ICRA, 2016. https://github.com/googlecartographer

D. Galvez-Lopez and J. D. Tardos, "Bags of Binary Words for Fast Place Recognition in Image Sequences," IEEE Trans. Robot., vol. 28, no. 5, 2012. https://github.com/dorian3d/DBoW2

R. Mur-Artal and J. D. Tardos, "ORB-SLAM2: an Open-Source SLAM System for Monocular, Stereo and RGB-D Cameras," IEEE Trans. Robot., vol. 33, no. 5, 2017. https://github.com/raulmur/ORB_SLAM2

J. Engel, V. Koltun and D. Cremers, "Direct Sparse Odometry," IEEE Trans. Pattern Anal. Mach. Intell., 2018. https://github.com/JakobEngel/dso

T. Reinhardt, "Using Global Localization to Improve Navigation," Google AI Blog, 2019. https://ai.googleblog.com/2019/02/using-global-localization-to-improve.html

A. Kendall, M. Grimes, and R. Cipolla, "PoseNet: A Convolutional Network for Real-Time 6-DOF Camera Relocalization," in Proc. ICCV, 2015. http://mi.eng.cam.ac.uk/projects/relocalisation/

Arandjelovic et al., "NetVLAD: CNN Architecture for Weakly Supervised Place Recognition," in Proc. CVPR, 2016. https://www.di.ens.fr/willow/research/netvlad/

G. Kim, B. Park, and A. Kim, "1 Day Learning, 1 Year Localization: Long-term LiDAR Localization using Scan Context Image," IEEE Robot. Autom. Lett., 2019. https://github.com/irapkaist/scancontext

R Li et al., "UnDeepVO: Monocular Visual Odometry through Unsupervised Deep Learning," in Proc. ICRA, 2018. http://senwang.gitlab.io/UnDeepVO/

J. Redmon and A. Farhadi, "YOLOv3: An Incremental Improvement," arXiv, 2018. https://pjreddie.com/darknet/yolo/

W. Liu et al., "SSD: Single Shot MultiBox Detector," in Proc. ECCV, 2016. https://github.com/weiliu89/caffe/tree/ssd

R. B. Rusu and S. Cousins, "3D is here: Point Cloud Library (PCL)," in Proc. ICRA, 2011. http://pointclouds.org/

Badrinarayanan et al., "SegNet: A Deep Convolutional Encoder-Decoder Architecture for Image Segmentation," IEEE Trans. Pattern Anal. Mach. Intell., vol. 39. no. 12, 2018. http://mi.eng.cam.ac.uk/projects/segnet/

Kaiming He et al., "Mask R-CNN," in Proc. ICCV, 2017. https://github.com/facebookresearch/Detectron

그림 1

Amazon Robotics의 물류이송로봇

출처 designboom, “15,000 Amazon Kiva Robots drives eighth generation fulfillment center,” 2014, CC BY, https://vimeo.com/113374910.

그림 2

Aethon의 병원 물류이송로봇 TUG

출처 aethonrobotics, “C|Net features Aethon's TUG at UCSF Mission Bay,” Jan. 2015, CC BY, https://www.youtube.com/watch?v=REEzJfGRaZE

그림 3

Amazon Picking Challenge 2016 (Team Nimbro)

출처 Anton Milan, "Team NimbRo at APC 2016", Sept. 2016, CC BY, https://www.youtube.com/watch?v=PpbvNeairZQ

그림 4

Starship Technologies의 배송로봇

출처 Mart Rootamm (Mardus) [CC BY-SA 4.0 (https://creativecommons.org/licenses/by-sa/4.0)]

- Sign Up

- 전자통신동향분석 이메일 전자저널 구독을 원하시는 경우 정확한 이메일 주소를 입력하시기 바랍니다.