이상재 (Lee Sangjae)

오미경 (Oh Mi Kyung)

강유성 (Kang Yousung)

Ⅰ. 서론

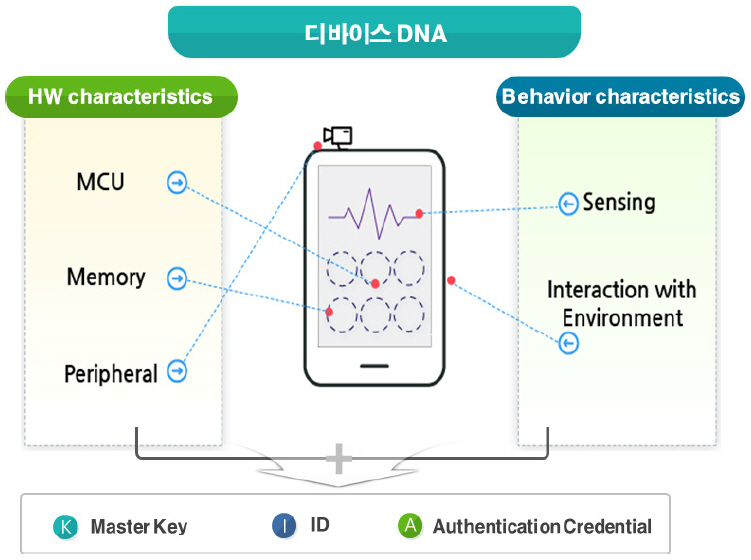

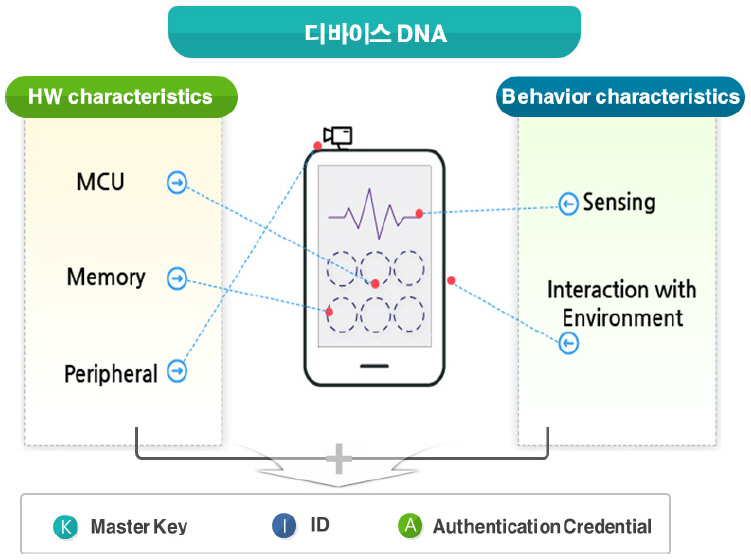

1. 디바이스 DNA

지문, 홍채, 정맥, 얼굴 등의 신체적 특징과 음성, 걸음걸이, 자판입력, 서명 등과 같은 행동적 특징 등을 이용하여 사람을 구별할 수 있듯이 IoT 디바이스 등에서도 복제 불가능한 여러 가지 특징을 포함하고 있다.

이러한 특징들은 반도체 공정이 필요한 SDRAM 등과 반도체 집적회로의 구조기술을 기본으로 하는 센서(가속도, 자이로, 이미지 센서 등)에서 주로 발견할 수 있다. 같은 생산 공정에서 생산된 동일 부품이라도 생산 공정의 불완전성으로 인해 각각의 부품들은 부품마다 각기 다른 오차를 포함한다.

칩의 물리적 구조 차이 및 소자나 회로의 연산 시간 차이, SDRAM의 전원 on/off 시의 잔류 데이터 차이 및 센서의 센싱 결과의 미세한 차이 등을 예로 들 수 있다.

각 부품들의 미세한 차이는 사람을 구별할 수 있는 DNA 정보처럼 IoT 장치를 구별할 수 있는 정보로 디바이스 DNA로 정의할 수 있다(그림 1 참조).

같은 회사, 동일 모델의 각기 다른 부품들이라도 서로 다른 디바이스 DNA를 가지고 있어 물리적으로 서로 다른 부품의 DNA를 복제할 수 없으므로 물리적 복제 방지 기능(PUF: Physically Unclonable Function)을 갖는다.

물리적 복제 방지 기능(PUF)은 반도체의 미세한 구조 차이 등을 이용하여 물리적으로 복제가 불가능한 암호키나 ID(IDentity)를 생성하는 기술[1]로, PUF를 통해 언제든지 생성할 수 있고 비휘발성 메모리 등에 저장할 필요가 없어 유출 등의 보안 위험에 안전하다. 물리적 복제 방지 기능에 대한 다양한 보안 요구사항들이 있으며, 이에 대한 시험방법에 대한 국제적인 표준화 작업도 이루어지고 있다[2].

2. 디바이스 DNA 종류

반도체 칩의 물리적 특성을 디바이스 DNA로 이용하는 기술들로는 Arbiter-PUF[3], RO(Ring Oscillator)-PUF[4], LoopPUF[5], VIA PUF[6] 등과 상용 메모리 기반의 SRAM[7]과 DRAM[8]을 이용한 물리적 복제 방지 기술 등이 있다.

표 1은 ETRI에서 최근 연구 중인 디바이스 DNA 기술들에 대한 것으로 레지스터와 커패시터 연결을 통해 발생하는 오차를 이용하는 RC(Resister-Capacitor) PUF, 통신 칩셋(Wi-Fi, SUN칩)의 여유 SRAM을 이용한 PHY-PUF, 플래시 메모리를 이용한 Flash PUF, 링 오실레이터의 위상 변화의 오차를 이용한 PDRO(Phase Detection Ring Oscillator) PUF 등도 저마다 각기 다른 형태의 디바이스 DNA를 사용한 것이다.

표 1 ETRI에서 연구/개발 중인 디바이스 DNA 종류

| Primitive 명칭 | (1) RC PUF | (2) PHY PUF | (3) Flash PUF | (4) Image Sensor PRNU† | (5) External Sensing Data |

|---|---|---|---|---|---|

| 대상 하드웨어 | Resistor-Capacitor (저항-커패시터) | 통신 칩셋 SRAM 메모리(Wi-Fi, SUN) | Flash 메모리 | Camera module (이미지 센서) | 주변 센서류(가속도, 자이로스 코프 등) |

| 출력 타입 | Dynamic (32bits challenge) | Fixed or Restricted Dynamic | Fixed or Restricted Dynamic | Dynamic | Dynamic |

| 출력 사이즈 | 128~2,048bits | 통신모듈 버퍼 사이즈 | Flash 메모리 사이즈 | 학습 네트워크 모델(오토인코더의 잠재 공간 노드 수에 비례) | 학습 네트워크 모델(오토인코더의 잠재 공간 노드 수에 비례) |

| 개발 보드 (시험 제품) | STMicro의 STM32F4 MCU를 사용한 보드 | Kidden-Ruby 보드 (STM32F4) + P mod WiFi module | Kidden-Ruby 보드 (STM32F4) + S25FL 128S(16MB) Flash Memory | 삼성, 로지텍, 샤오미 IP 카메라, 아이폰 | 스마트폰(안드로이드), 아두이노 |

| 특징 | • 반복성, 유일성, 난수성 등 우수 | • 반복성, 유일성, 난수성 등 우수 | • 반복성, 유일성, 난수성 등 우수 | • 상용제품(판매 중인 IP 카메라)에서 디바이스 DNA 확보 | • 상용제품(판매 중인 안드로이드/아두이노)에서 디바이스 확보 |

| • RC 회로 내장 보드 제작 필요 | • 챔버 테스트(-20~70℃에서 stability 유지) | • 하드웨어 수정 불필요 | |||

| • Voltage(MCU) variance에 강인 | • Voltage variance에 강인 |

• 온도 및 전압에 대한 신뢰성 평가 진행 예정 |

• 카메라 모듈 고유 노이즈를 학습시켜 활용 |

• 주변 센서류의 센싱 데이터를 추출하여 활용 |

|

• 챔버 체스트 완료 |

• 하드웨어 수정 불필요 |

이미지 센서와 가속도 센서 등의 반도체 공정이나 반도체 미세회로 등이 적용된 센서에서도 역시 미세한 오차를 포함하고 있으며, 이를 이용하여 디바이스 DNA를 구성할 수도 있다.

3. 센서 기반의 디바이스 DNA

이미지 센서, 특히 반도체 공정을 사용하는 CMOS 계열에서 센서별 오차를 많이 포함하고 있다. 또한, 초정밀 미세회로가 적용되는 MEMS 기반의 센서들(예, 가속도 센서[9,10], 자이로 센서[10,11], 지자기 센서[10,12] 등)에서도 이러한 오차가 발견되며, 이를 이용한 많이 연구들이 진행되고 있다.

센서 기반의 디바이스 DNA들은 주로 센싱 데이터의 오차를 이용한다. 따라서 데이터에 대한 분석 및 특징 추출 등의 과정이 필요하거나 학습 및 시험 등의 절차가 필요하다. 이렇게 생성되는 디바이스 DNA는 센서를 확인하는 ID 또는 보안키 등으로 사용할 수 있다.

안드로이드 스마트폰의 경우 웹브라우저를 통한 웹페이지에서의 모션센서(가속도, 자이로 및 지자기 센서 등)에 대한 접근 권한은 따로 필요없으며, 아이폰에서는 사용자의 부주의한 승인을 통해 웹 사이트는 쉽게 스마트폰 모션센서 정보를 수집할 수 있다[9,21]. 수집된 정보를 통해 사용자 스마트폰 ID를 생성하고 분류할 수 있으며, 이는 사용자의 프라이버시 침해로 이어질 수도 있다.

이미지 센서는 더 많이 연구들이 진행되고 있는데, 이는 주로 불법 영상물 배포와 특히 아동 영상물의 오용에 따른 소스 카메라를 검증하는 포렌식 기술로 많이 활용되기 때문이다[13-17].

Ⅱ. 이미지 센서 DNA 기술

1. 이미지 센서 DNA

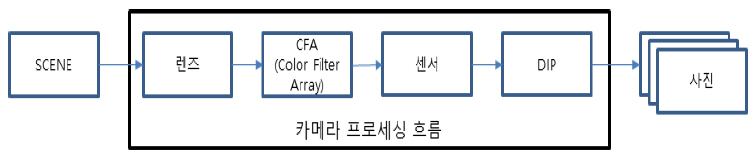

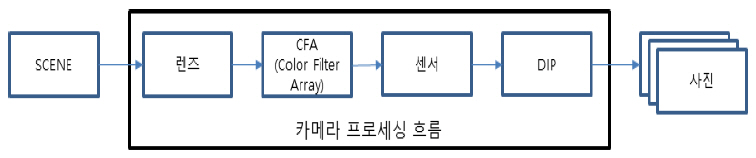

디지털 카메라는 그림 2의 카메라 프로세싱 흐름을 따라 사진을 구성한다.

CFA를 통과한 빛들은 센서를 통해 양자화되고 DIP(Digital Image Processing) 과정을 통해 일부 노이즈 제거 및 압축 등을 통해 사진으로 저장된다.

이 과정에서 센서는 생산과정의 불완전성(실리콘 웨이퍼의 균질성 저하로 센서 어레이 픽셀의 빛 민감도 차이 유발) 때문에 빛에 균일하게 반응하지 못하는 현상(PRNU: Photo Response Non-Uniformity)이 발생하며, 최근의 디지털 이미지 포렌식 기술들은 소스 카메라 검증에 PRNU를 많이 사용하고 있다.

이미지 센서에서 발생하는 SPN(Sensor Pattern Noise)은 사진 구성 과정에서 생기는 전체 노이즈를 의미하며, FPN(Fixed Pattern Noise)과 PRNU로 구성된다. FPN(Fixed Pattern Noise)은 미세한 전류에 의해 생성되는 노이즈로 카메라 렌즈를 완전히 닫고 촬영된 사진의 평균을 구하여 노이즈를 구할 수 있으며, 이를 이용해 쉽게 제거할 수 있다.

2. PRNU 추출 및 검증

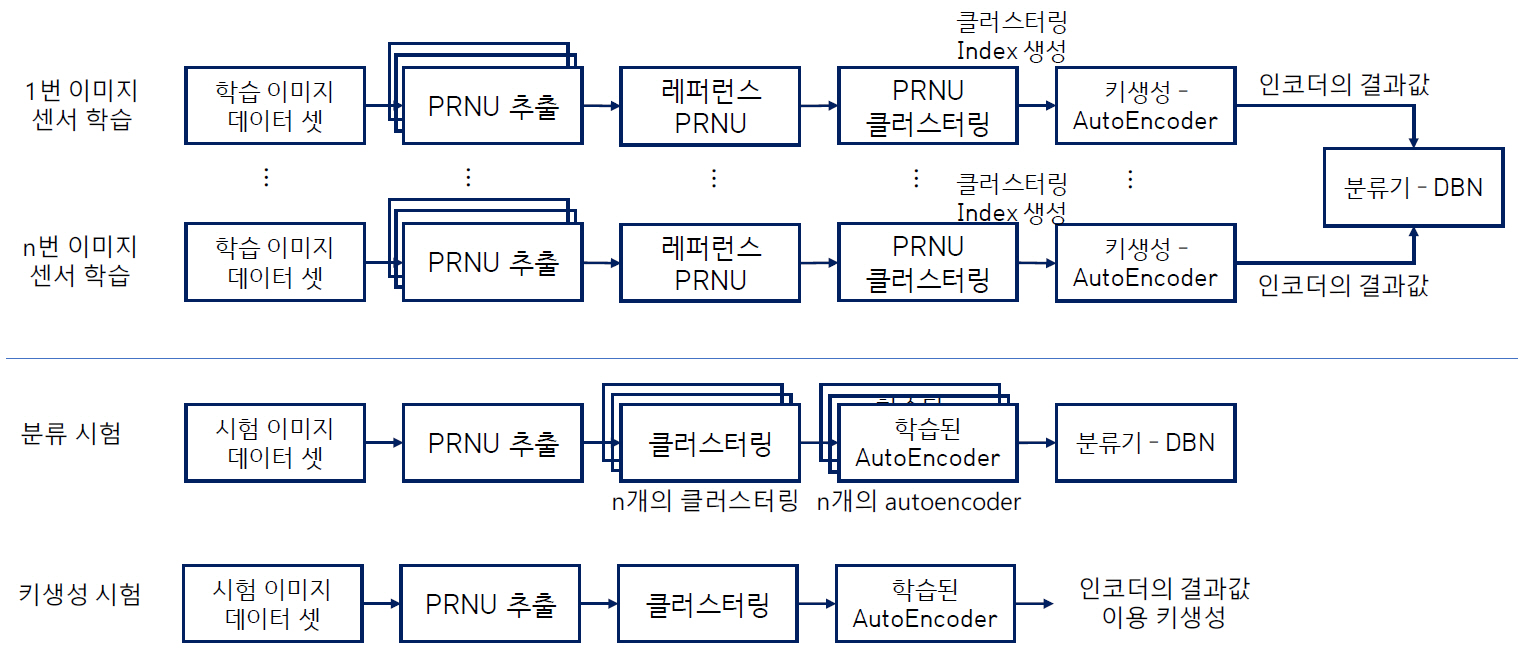

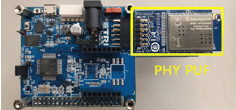

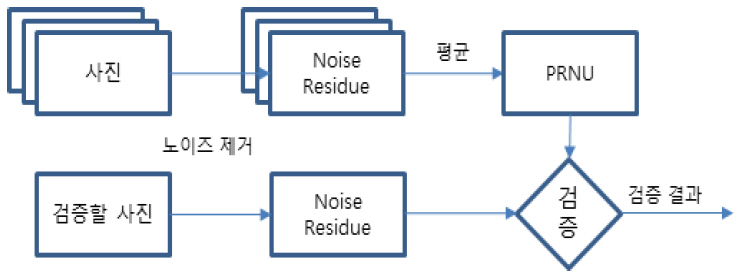

그림 3은 이미지들에서 PRNU를 추출하는 방법과 검증하는 절차를 간단한 도식으로 표시한 것이다[18].

이처럼 간단한 절차로도 실험실 레벨(한정된 공간에서의 몇 종류의 카메라 사진들)에서는 상당히 높은 확률로 소스 카메라의 구별이 가능함을 그림 4와 같은 절차의 실험 결과로 확인하였다. 그림 3의 절차에 PRNU 클러스터링[5]을 접목하고 딥러닝 기법을 접목하여 사용하였다. PRNU를 추출하고 단순히 상관도를 비교한 방식도 실험실 레벨에서는 비슷한 결과를 얻었다.

3. PRNU기반 Counter-Forensic

그림 3에서처럼 PRNU를 추출할 수 있으면 이미지에서 PRNU를 제거 및 위조하여 프라이버시를 높이는 방법도 있다. 즉, 이미지에서 소스 카메라 검증이 어렵게 PRNU를 제거하거나 다른 카메라의 PRNU를 넣어 위조할 수 있는데, 이를 디지털 이미지에 대한 counter-forensic 기술[19,20]로 정의할 수 있다. 최근에는 SNS상에 스마트폰으로 찍은 사진이나 영상 등이 많이 올라온다. 그 사진이나 영상을 수집해 분석하면 한 개인의 스마트폰의 PRNU를 유추할 수 있다. 이를 다른 이미지에 추가하여 소스 카메라 검증에 혼란을 주는 것도 가능하다.

Counter-forensic 기술을 이용하면 이미지 센서의 고유 패턴을 찾기 어렵게 만들 수 있지만, Ⅲ장에서와 같이 디바이스 DNA를 일종의 ID 및 보안키로 사용하는 방식에서는 그 영향이 제한된다.

Ⅲ. 센서 DNA 활용

1. 가속도 센서 DNA 실험

그림 2의 센서 DNA의 분석, 추출, 사용하는 방법에는 다양한 방식이 존재할 수 있다. 예를 들어, 참고문헌 [9,22]에서는 표 2와 같이 가속도 센서의 데이터를 시간 영역 및 주파수 영역으로 구분하여 각각 10개와 15개의 특징을 추출하였다.

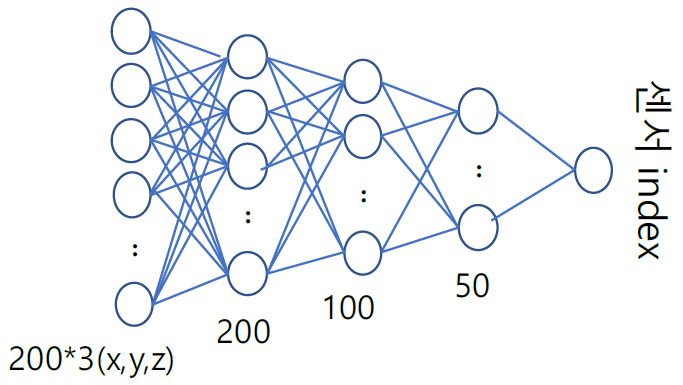

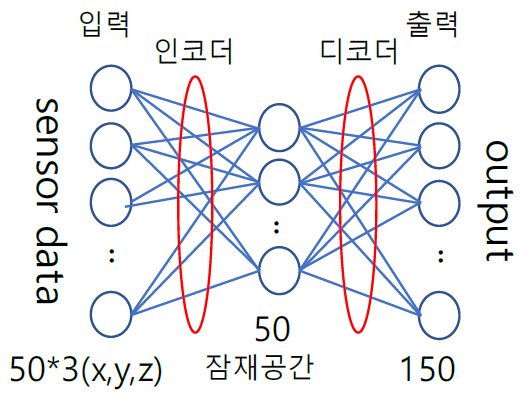

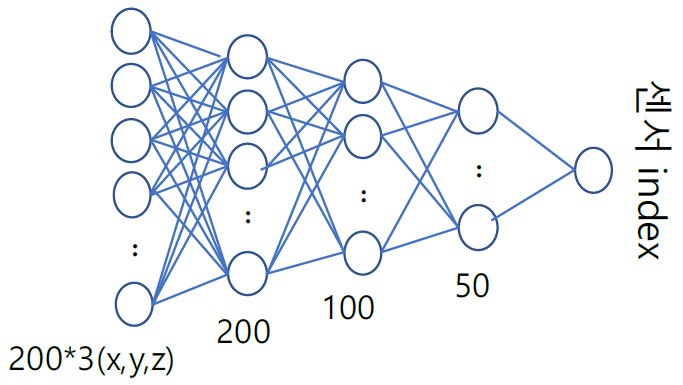

이를 가속도 센서의 지문처럼 사용하여 다른 센서들과의 데이터 특징과 비교하는 방식을 사용하였지만, 이를 특징 추출하지 않고 그림 5 처럼 간단한 신경망으로 데이터만 학습시켜 센서를 분류할 수도 있으며, 학습에도 다양한 방법을 사용할 수 있다.

센싱 데이터로 분류된다는 의미는 센서 고유의 DNA 존재한다는 의미가 되며, 이를 ID나 키로 활용하기 위해서는 결과가 그림 5의 센서 인덱스가 아닌 센서 특성을 포함하는 다른 종류의 데이터가 필요하다.

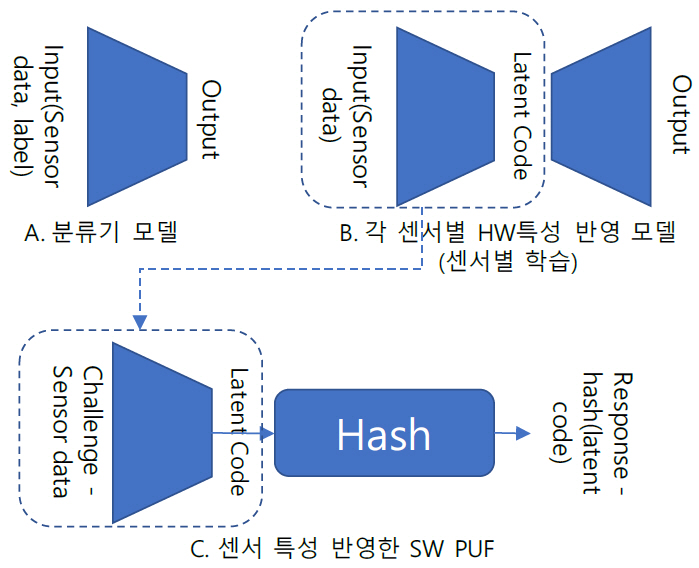

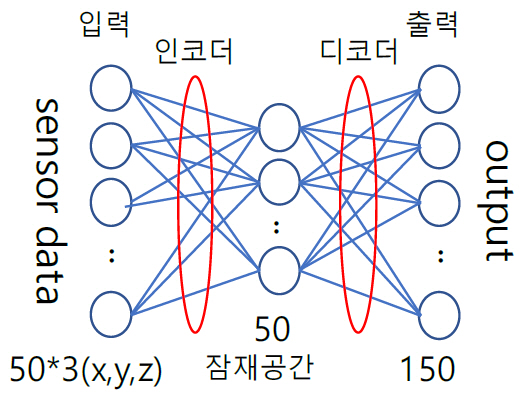

센서 특성을 포함된 데이터를 생성하기 위해서는 여러 방법이 있겠지만, 표 2의 특징들을 양자화하거나 그림 6처럼 개별 센서의 센싱데이터를 오토인코더(입력데이터와 출력데이터가 유사하도록 학습시키는 비지도 학습 방법)로 학습시켜 잠재공간(Latent space, 인코더와 디코더 사이의 히든레이어의 결괏값)에 특성이 반영될 수 있게 하여 인코더의 결괏값을 사용하여도 된다.

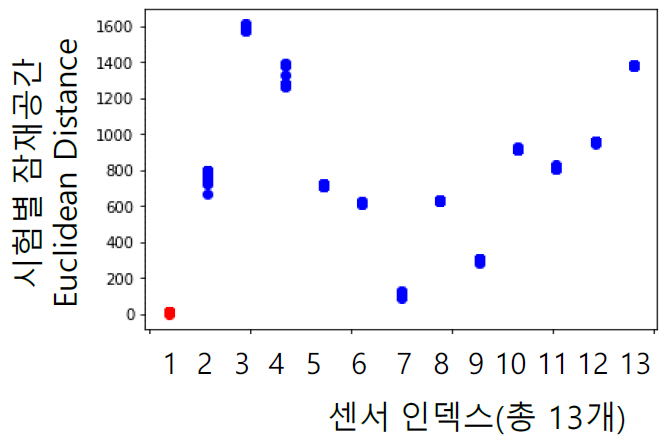

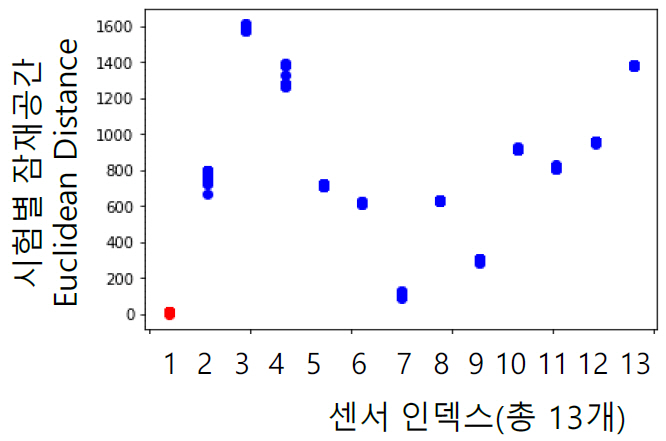

그림 6과 같이 학습시킨 모델에서 인코더에 여러 센서의 데이터를 넣어 시험한 결과는 그림 8과 같다.

그림 7은 빨간색으로 표시된 1번 장치의 데이터로 학습시키고 1~13번 센서의 데이터들로 시험한 결과이다. Y축 값은 1번 장치의 첫 번째 잠재공간(50개의 실수 벡터)을 기준으로 유클리디안 거리값을 비교한 것으로 시험 시마다 점을 찍게 한 그래프이다. 1번 장치로 학습시켰기 때문에 1번의 값이 제일 낮게 나오고 센서 DNA가 학습 모델의 인코더에 반영되었음을 알 수 있으며, 이를 인증 및 보안키의 역할로 사용할 수도 있다.

인증 또는 보안키의 역할로 사용하기 위해서는 사용될 환경 및 센서 DNA를 고려한 보안 프로토콜 설계가 별도로 필요하다.

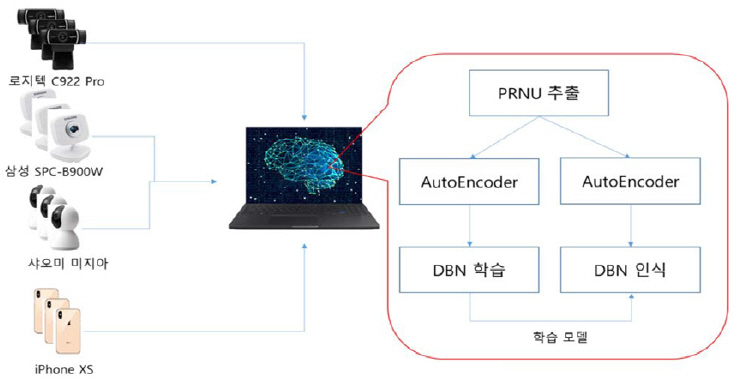

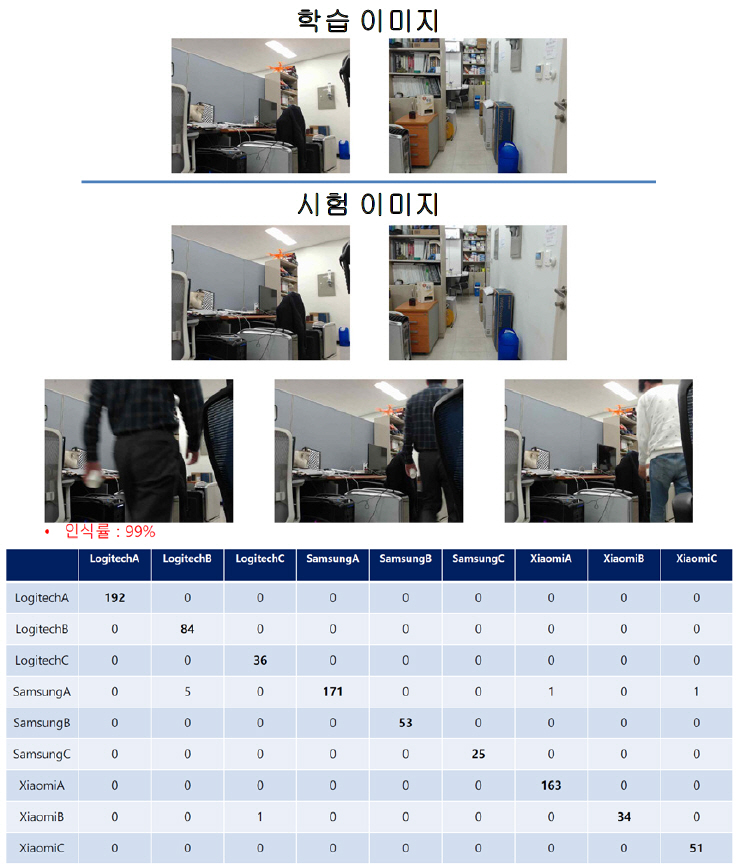

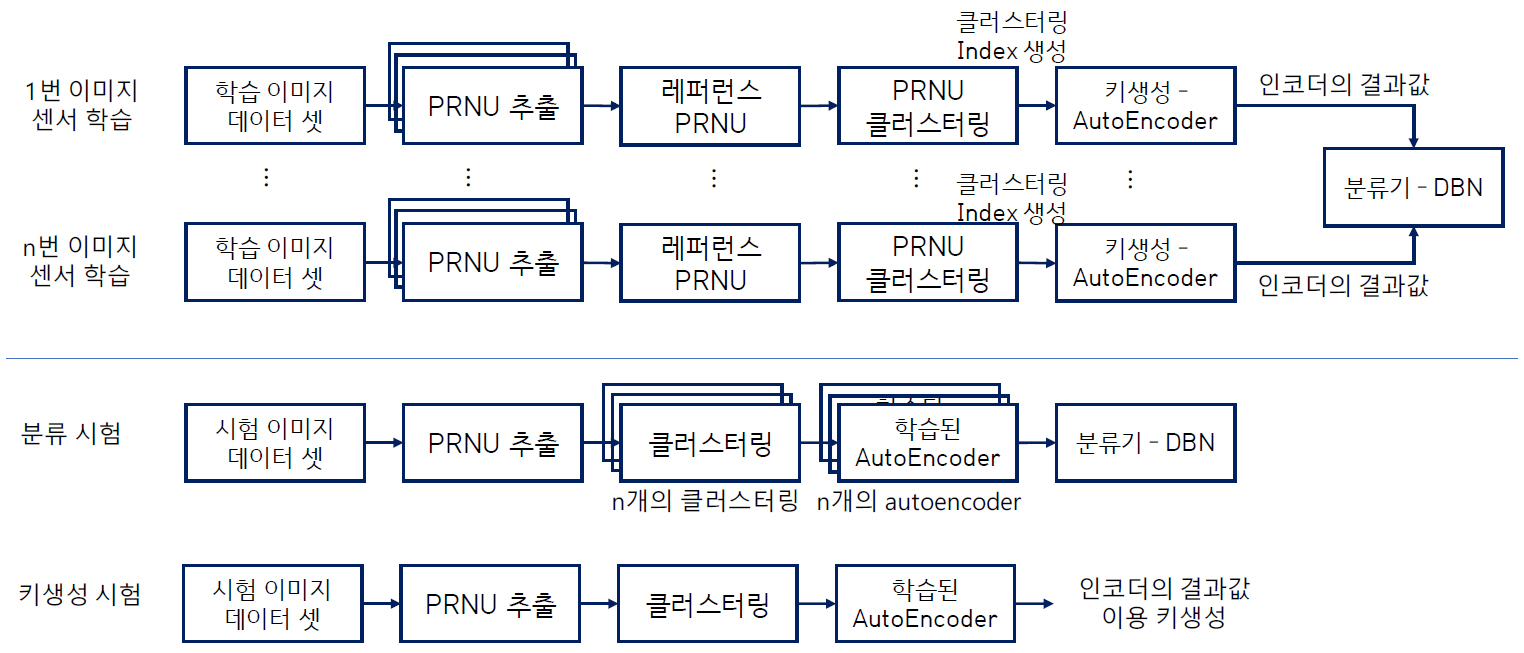

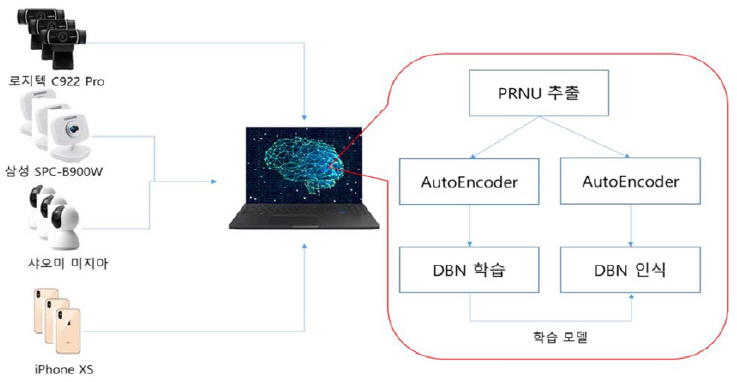

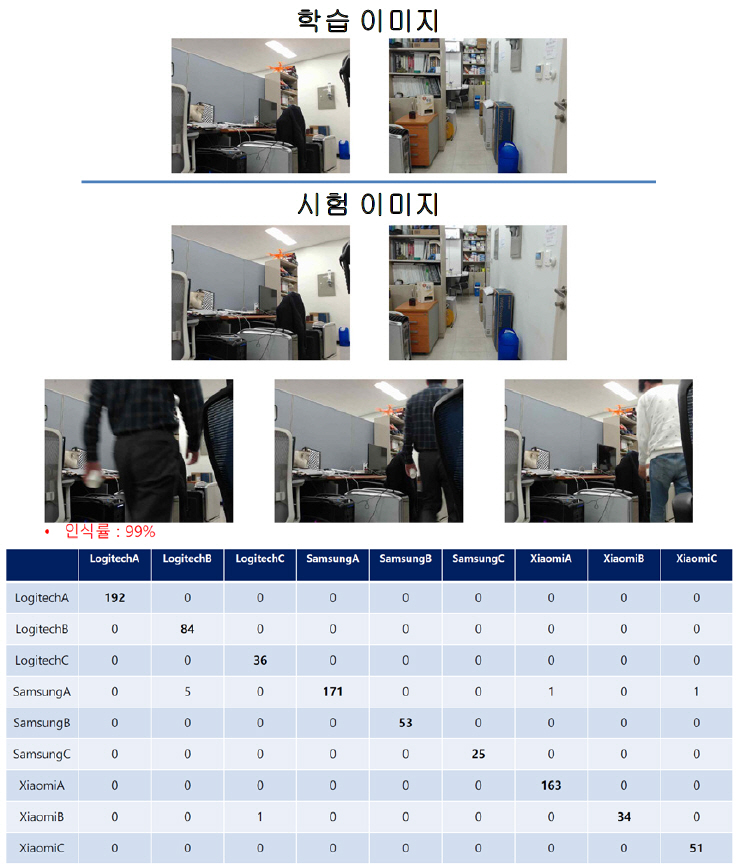

2. 이미지 센서 DNA 실험

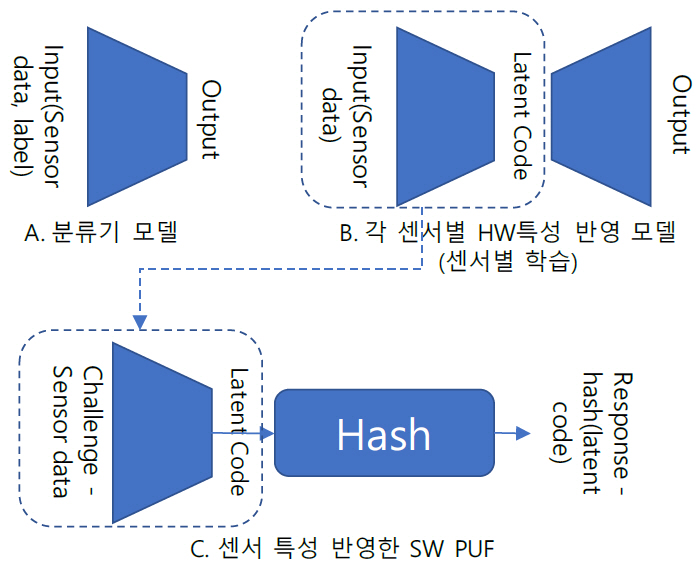

그림 8은 그림 4의 이미지센서 분류 학습 모델을 간략화한 것이다. 오토인코더로 개별 이미지센서의 DNA 특성을 반영시키고, 인코더의 출력을 DBN(비지도 학습을 하는 딥러닝 기술) 입력으로 넣어 소스 카메라 인식을 하는 모델이다. 그리고 그 모델로 실험(IP 카메라-로지텍, 삼성, 샤오미의 IP 카메라 각 3대씩 총 9대)한 결과는 그림 9와 같다.

학습 이미지와는 다른 이미지(사람 및 사람의 움직임이 포함된 사진)가 있어도 99% 정도 분류됨을 알 수 있으며, 이를 통해 이미지 센서 DNA가 존재함을 알 수 있다. 특히 개별 이미지 센서 DNA는 그림 8의 개별 오토인코더의 인코더 부분에 포함되어 있다. 따라서 이 부분을 안전하게 보관할 수 있으면 이미지 센서의 DNA를 반영한 SW 기반의 PUF처럼 운영도 가능하다.

3. 센서 DNA 활용

개별 센서들에 찾아낸 DNA(특징 또는 학습된 모델 등)는 고유의 센서 특성을 포함하고 있어, 이를 그림 10에 보이는 것처럼 PUF와 비슷한 방법으로 운영할 수 있다.

칩 기반의 PUF는 기능들이 칩 안에 들어 있어 상대적으로 안전하지만 그림 10과 같은 센서 기반의 DNA 기술은 PUF처럼 사용하려면 센서 특성이 담긴 특징 또는 모델을 저장할 안전한 곳(Secure 영역)이 필요하다.

4. 센서 DNA 응용

디바이스 DNA 기술들은 센서가 탑재되는 디바이스가 필요한 전 산업 분야에서 센서의 검증 및 이상 여부를 파악하는 기술에 활용할 수 있다.

드론도 디바이스 DNA 기술을 잘 접목할 수 있는 장치이다. 산업용 및 군사용에 필요한 드론들은 인증 및 (피아)식별을 위한 보안모듈이 필수적이다. ETRI에서도 드론에 탑재하여 드론의 인증 및 (피아)식별이 가능한 보안모듈(SW/HW 형태)을 연구 및 개발 중이다. 이 연구에서는 드론의 인증 및 식별을 보안모듈에 의존한다. 따라서 보안모듈을 이식하였을 경우, 드론의 인증 및 식별 대상이 변하게 되는 문제가 생길 수 있다.

드론에 포함된 센서들(가속도 센서, 자이로 센서, 지자기 센서, 바로미터 및 이미지 센서 등)의 DNA 기술과 보안모듈을 페어링시키면 드론 장치 그 자체를 보안모듈과 동시에 인증 및 식별해 해결할 수 있다.

Ⅳ. 결론

사람의 바이오 정보처럼 디바이스에도 갖가지 형태의 HW 특성이 담긴 정보들이 포함되어 있다. 이를 디바이스 DNA로 정의하고 센서 DNA를 통해 센서를 분류함으로써 이를 검증할 수 있다. 그리고 센서 기반 DNA를 SW 기반의 PUF의 형태로도 활용할 수 있다.

디바이스 DNA는 종류에 따라 디바이스 인증 및 보안키에 핵심으로 사용할 수 있는 특성을 가질 수도 있지만, 센서 기반 DNA 기술은 디바이스 인증 및 보안키에 필요한 이차적인 요소로 사용하는 것이 적합하다. 멀티 팩터 인증의 부가 요소, 디바이스(또는 센서)의 변경 여부를 검증하는 기술로 활용할 수 있다.

참고문헌

그림 1

디바이스 DNA 개요

그림 2

디지털 카메라 프로세스 구성

그림 3

PRNU 추출 및 검증 절차

그림 4

PRNU 기반의 디바이스 DNA 추출 및 소스카메라 검증 절차

그림 5

센서 데이터 학습 및 분류

그림 6

개별 센서 데이터 학습

그림 8

이미지 센서 데이터 학습

그림 7

개별 센서 학습 모델 시험 결과

그림 9

IP 카메라 분류 시험

그림 10

센서 특성 기반의 SW PUF 모델