클라우드-IP 기반의 방송 미디어 제작 기술 동향

Cloud-IP based Broadcasting Media Production Technology

- 저자

-

오혜주미디어방송연구실 feeler@etri.re.kr 이재영미디어방송연구실 jaeyl@etri.re.kr 김순철미디어방송연구실 choulsim@etri.re.kr 최동준미디어방송연구실 djchoi@etri.re.kr

- 권호

- 37권 6호 (통권 199)

- 논문구분

- 일반논문

- 페이지

- 64-73

- 발행일자

- 2022.12.01

- DOI

- 10.22648/ETRI.2022.J.370607

본 저작물은 공공누리 제4유형: 출처표시 + 상업적이용금지 + 변경금지 조건에 따라 이용할 수 있습니다.

본 저작물은 공공누리 제4유형: 출처표시 + 상업적이용금지 + 변경금지 조건에 따라 이용할 수 있습니다.- 초록

- This document describes the technologies related to internet protocol (IP)-based media production systems. As high-capacity, high-quality data transmission increases, broadcast production platforms are shifting to IP. The IP-based production system uses the network by sharing resources and is easy to control centrally. It also facilitates software-based cloud production. A cloud IP-based media production platform can work regardless of dedicated hardware and can easily collaborate. Associations and industrial groups have created common standards related to production, and manufacturers are developing solutions with their technologies based on their product competitiveness. This study investigates the open standard technologies used for IP-based media production and technology trends in the ProAV industry and describes the production in the cloud environment and cloud AI-based production technology trends.

Share

Ⅰ. 서론

미디어 제작 워크플로우는 야외 및 스튜디오의 카메라 촬영에서부터 편집, 가공 후 사용자에게 배포하기까지 다양한 표준 기술과 제작 장비들로 구성된다. 전통적으로 방송 미디어 제작은 지상파 방송사 및 특정 업체를 중심으로 이루어졌고, 소비를 위한 유통 경로도 매우 제한적이었다. 하지만 네트워크 인프라 기술이 발전하면서 인터넷 동영상 서비스 산업이 활성화되고 미디어 소비 형태가 변함에 따라 미디어 제작 방식에도 기술적 변화와 진화가 있었다. 기존 제작 분야에서는 SDI(Serial Digital Interface) 방식이 광범위하게 사용되었으나, 4K, 8K의 고해상도 대용량 데이터의 전송 요구가 높아지고 이머시브 미디어로 획득되는 고품질 영상 콘텐츠들이 늘어나면서 전송 방식의 물리적인 한계점이 나타났고, 원거리에 따른 신호 품질도 보장할 수 없게 되었다. 그래서 원격 촬영지, 스튜디오, 데이터 센터, 통합 부조정실의 방송 제작 시설을 갖추어야 하는 제작 시스템은 점점 IP 기반 시스템으로 점점 전환하게 되었다. 제작 환경에 IP 기술을 도입하는 것은 콘텐츠의 전송 거리와 전송 속도의 한계를 해결할 수 있을 뿐만 아니라 네트워크를 통해 자원을 공유해서 쓸 수 있고, 시스템을 하나로 묶어 중앙에서 제어하기가 쉽다는 큰 장점이 있다. 또한, 하드웨어 기반의 장비 중심에서 소프트웨어 기반의 가상화 기술로 클라우드 서비스도 자연스럽게 적용할 수 있다[1]. 5G 네트워크 기술 또한 이전의 모바일 기술과 비교하여 많은 부문에서 산업 참여, 새로운 서비스와 비즈니스 기회를 열어 주면서 미디어 산업에서도 혁신의 기회를 만들었다. 네트워크 이동성과 유연성, 보안 및 안전성이 향상되면서 콘텐츠 제작자와 서비스 제공 업체가 언제 어디서나 모든 장치를 통해 콘텐츠를 전달하고 소비할 수 있게 된 것은 미디어 제작 패러다임의 전환이라고 볼 수 있다[2].

인터넷 동영상 서비스 산업이 활성화되면서 콘텐츠 유통도 방송 중심에서 시간과 장소에 상관없이 원하는 콘텐츠를 이용할 수 있는 온라인 서비스로 확대되고, 미디어 제작도 방송 및 미디어 기업들의 전유물이 아니라 소규모, 개인 방송 제작 참여가 급격히 늘어났다. 제작 기술의 진화와 함께 전문가용 오디오/비디오(ProAV: Professional Audiovisual)와 방송 및 미디어 장비 산업의 기술적 차별성이 점차 줄어들어 엔트리 시장과 고가의 장비 통합 가능성이 커지고 있다. 기존에는 전문가가 큰 비용과 시간을 투입하여 고가의 촬영 장비를 이용해야 했지만, 지금은 간단하게는 스마트폰만 있으면 언제 어디서나 콘텐츠 제작과 편집을 할 수 있다. 1인 미디어 플랫폼의 영향력이 확대되면서 무료에서 유료까지 다양한 기능을 가진 라이브 스트리밍 제작 소프트웨어들이 있으며, 유튜브를 포함하여 트위치, 아프리카 TV, 네이버TV 등 다양한 플랫폼에서 서비스를 지원해주고 있다.

본고에서는 IP 기반의 미디어 제작에 사용되는 개방형 표준 기술에 대해 알아보고 ProAV 산업에서의 제작 기술 동향과 미디어 제작 전송 과정에서 사용되는 표준 기술, 클라우드 환경에서의 제작 기술 및 클라우드 기반 AI 제작 기술 동향에 대해 살펴본다.

Ⅱ. IP 미디어 제작 기술 동향

1. IP 기반 방송 제작 공개 표준

방송 장비들이 IP 기반의 장비로 전환되면서 IP 제작 기술도 세계 방송 장비 회사를 중심으로 발전 진화하였다. 제작사들은 각 사의 제품 경쟁력을 바탕으로 독자 기술이 가미된 솔루션을 개발하였고, 각종 연합체나 포럼 활동을 통해 비즈니스 중심의 기술을 발전시키고 보완해왔다. 장비 회사 중심의 독자 솔루션은 다른 장비와의 상호 운용성의 한계를 가질 수 있는데, 특정 제조사 장비와 플랫폼에 종속되지 않는 공통의 표준은 EBU(European Broadcasting Union), SMPTE(Society of Motion Picture and Television Engineers), AMWA(Advanced Media Workflow Association), VSF(Video Service Forum), AIMS(Alliance for IP Media Solutions), AES(Audio Engineering Society)와 같은 연합체 및 산업 단체를 중심으로 이루어졌다. IP 제작의 대표적인 공개 표준으로 전송 계층 표준인 SMPTE ST 2022와 ST 2110과 제어 및 관리 계층 표준인 NMOS가 있다.

가. SMPTE

SMPTE는 미디어 관련 협회이며 영화 및 텔레비전 전송 포맷과 관련 데이터 전송 인터페이스 관련된 표준화 단체로 600개 이상의 표준을 가지고 있다. SMPTE는 1989년에 표준으로 제정되어 사용되던 SDI 방식의 영상 전달 표준에서 IP로의 전환을 위한 표준으로 점진적으로 발전해 왔다. 그중 SMPTE ST 2110은 IP 네트워크에서 오디오, 비디오 및 데이터를 전송하기 위한 표준이다. ST 2110이 만들어지기 이전 2007년에 제정된 SMPTE ST 2022는 기존에 MPTEG-2 TS의 영상 및 데이터를 묶어서 SDI로 보내던 방식을 IP 네트워크로 전달하기 위한 표준이다. SMPTE ST 2110은 오디오, 비디오 및 데이터를 묶어서 보내는 것이 아니라 별도의 기본 스트림으로 분리하여 IP 네트워크로 전달하는 방식으로 ST 2022보다 유연한 워크플로우를 지원한다. IP 네트워크로의 전환과 함께 대용량, 범용성을 가지는 데이터 전송의 요구가 높아지면서 ST 2110에서는 3Gbps 또는 그 이상의 대역폭을 가지는 무압축 오디오, 비디오를 전송하는 것까지 포함하도록 확장되었다[3-9]. 또한, 해상도 및 네트워크에 독립적으로 동작할 수 있는 확장성을 가지며 여러 공급 업체 간의 원활한 상호 운용성을 지원하도록 설계되었다. SMPTE ST 2110 표준 구성은 표 1과 같이 시스템 타이밍, 압축/비압축 비디오/오디오, 부가 데이터 문서로 구성된다. 그리고 관련 문서로 ST-2110의 ST 2022-6 스트림과의 상호 운용성을 정의하는 ST 2122-8이 있다.

표 1 SMPTE ST 2110 표준 문서 구성

나. NMOS

장비 등록 및 관리, 장비 간 신호 자동 인식을 위한 표준인 NMOS(Networked Media Open Specifications)는 SMPTE ST 2110에서 제공하는 전송 계층 외에 제어 및 관리 계층을 위해 만들어진 IP 기반의 개방형 표준 기술이다. NMOS는 AMWA를 통해 개발되고 있는데, AMWA는 AES, EBU, SMPTE, VSF와 함께 IP 네트워크에서 자동화되고 가상화된 미디어 워크플로우를 만드는 데 중점을 둔 기관이다. NMOS가 SMPTE ST 2110과 통합되어 있지 않지만 장비 간 신호 자동 인식 및 호환을 유지하고 장치 제어에 대한 공통의 접근 방식을 지정하기 위해서는 필요하다. 특히 NMOS IS(Interface Specification)에서 IS-04는 장치 검색 및 등록, IS-05는 연결 관리, IS-06은 네트워크 리소스를 검색/승인하고 보호하는 방법을 다룬다. 현재 IS-11과 IS-12를 제외하고는 게재되었고 세부 사항 수정이 진행 중이다. NMOS IS 문서 구성과 상태는 표 2와 같다[10].

표 2 NMOS Interface Specifications

NMOS에서 진행 중인 또 다른 작업인 장치 모델링 프로젝트는 기기 제어에 대한 공통 작업을 수행할 수 있도록 API(Application Programming Interface)를 공통 방식으로 노출하여 확장 가능한 시스템을 개발하고 제어 관점에서 장치를 모델링하는 방법을 제공한다. 장치의 제어 및 상태에 대한 확장 가능한 표준과 방법론에 대해 문서화하여 네트워크에서 기기를 쉽게 통합하고 변경 사항을 구성할 수 있는 워크플로우 시스템을 다룬다.

2. ProAV 산업에서의 제작 기술 동향

가. JT-NM

SMPTE ST 2110과 NMOS가 IP 기반 방송 제작 표준으로 업계 전반에 걸쳐 채택되고 있는 것과 유사하게 ProAV 시장에서도 AVoIP를 위한 여러 제조 업체의 기술들이 상호 운용이 가능하고 확장 가능하도록 협력하고 있다. JT-NM(Joint Task Force on Networked Media)은 AMWA, EBU, SMPTE, VSF로 구성된 그룹으로 제조 업체, 방송사 및 업계 조직이 연합하여 전문 미디어를 생성, 저장, 전송 및 스트리밍함으로써 전문 미디어 산업을 위한 IP 네트워크 인프라 개발을 돕기 위해 만들어졌다. JT-NM은 네트워크로 연결된 미디어 시스템에서 상호 운용성을 촉진하기 위한 모델, 모범 사례 및 프레임워크 문서인 Reference Architecture v1.0를 2015년에 발표하였다[11]. 그리고 네트워크 미디어에 대한 기술 표준 로드맵을 발표한 이후 2021년에는 ProAV 기술에 대한 로드맵을 제시하였다[12]. ProAV 기술 로드맵에서는 기존의 방송 오디오/비디오 표준을 기반으로 ProAV 업계에서 널리 사용되기에 적합한 AV-over-IP 사양의 실용적인 세트를 정의하고 미디어 전송, 시스템 제어, 시간 서비스 및 디렉토리 서비스 영역을 다루고 있다.

나. IPMX

IPMX는 IP 미디어 솔루션 연합인 AIMS에 의해 만들어졌고, ProAV 시장을 위해 IP 네트워크를 통해 압축 및 비압축 오디오, 비디오 및 데이터를 전달할 수 있도록 제안된 개방형 표준 및 사양이다. IPMX는 SMPTE ST 2110 표준과 방송 업계에서 널리 사용되는 AMWA NMOS를 기반으로 ProAV 워크플로우를 위한 특정 기능이 추가된 표준이다. ProAV 환경은 개방형 표준 기반이 아닌 독점적인 AV-over-IP 솔루션이 다수를 차지할 수 있는데, IPMX는 제조 업체가 보다 표준화되고 상호 운용 가능한 단일 플랫폼 구축을 할 수 있기 위한 솔루션을 제공한다. 4:4:4 색상의 4K 60p를 포함한 압축 및 비압축 비디오 및 오디오를 저지연으로 전송하고 제어하도록 설계되었고, SD(Standard Definition) 해상도에서 8K 해상도까지 10G, 25G, 40G 및 100G 네트워크를 지원할 만큼 충분히 유연하게 설계되었다. 추가 기능으로 HDMI(High-Definition Multimedia Interface) 지원, HDCP(High-bandwidth Digital Content Protection)를 통한 디지털 복사 방지, NMOS 검색 및 등록, I/O 관리, 향상된 오디오 채널 맵핑, JPEG(Joint Photographic Experts Group) XS 비디오 코딩 시스템을 사용한 미디어 압축 등이 있다.

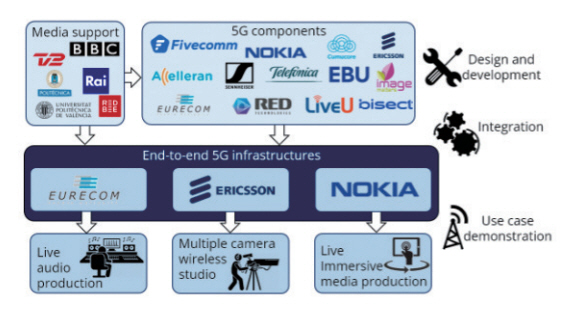

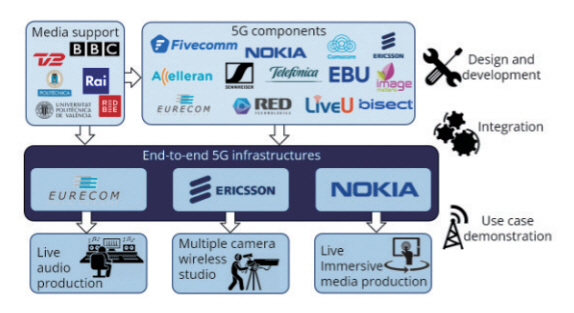

다. 5G-Records

5G-Records는 유럽 Horizon 2020 프로젝트 중 하나로 5G 기술이 ProAV 콘텐츠 제작 산업에서 인프라의 일부로 5G 구성 요소를 설계하고 개발, 통합, 검증 및 시연을 목표로 만들어진 컨소시엄이다. IT 기업, 방송사, 대학, 인프라 업체, 미디어 공급 업체 등 19개의 파트너사로 구성되어 있고 1) 라이브 오디오 프로덕션, 2) 다중 카메라 무선 스튜디오 프로덕션, 3) 라이브 몰입형 콘텐츠 프로덕션의 3가지 시나리오에 대해 NPN(Non-Public Networks)을 사용하여 미디어 서비스를 제공하는 방법에 대해 시험/검증한다(그림 1)[13]. 3가지 시나리오에는 데이터 품질, 속도, 지연 시간, 안전성, 장치 간 동기화 등의 요구사항을 포함하는 오디오, 비디오 처리도 포함된다. 전문 콘텐츠 제작 환경을 구성하기 위해 이용되는 5G 기술로는 5G NPN을 통한 유연성 및 다양한 배치 옵션, 네트워크 슬라이싱을 통한 효율적인 네트워크 용량 관리, 3GPP URLLC(Ultra Reliable Low Latency Communications) 및 QoS 기능을 통한 트래픽 분리 및 흐름 처리, 정확한 장치 시간 동기화, mmwave 안테나를 활용한 넓은 가용 대역폭, 에지 컴퓨팅 기술을 이용한 저지연 응답 기술들이 있다[14]. 2020년에 프로젝트가 시작된 이후 각각의 시나리오에 대하여 테스트 베드를 구성하고 통합 테스트를 하였고, 성능 향상과 상호 운용성을 위한 추가 기능 및 인프라 통합 검증 시험도 진행하였다. 참여 기관들은 3GPP, ITU-T, NMOS, VQEG(Video Quality Experts Group), SMPTE 및 MPEG의 표준화 활동도 함께 진행하였다.

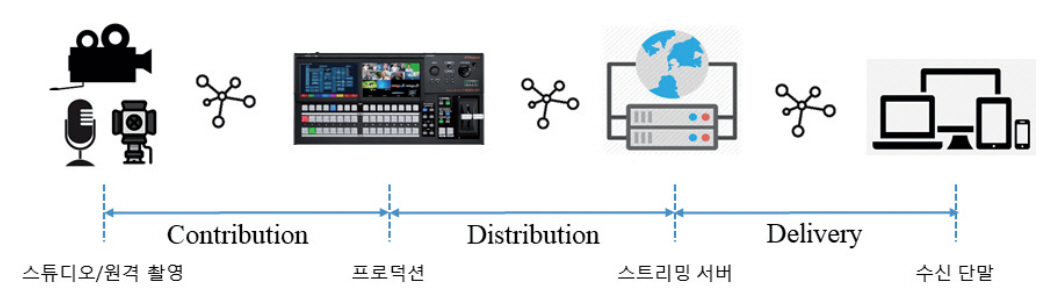

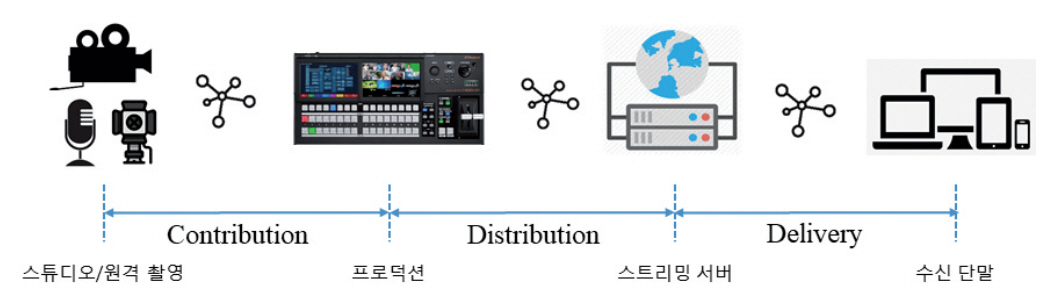

3. 미디어 제작 시스템 스트리밍 기술

카메라에서 촬영된 영상이 사용자 단말로 전달되기까지 미디어 제작 전송 과정은 크게 소스 영상에서 방송국 스테이션을 연결하는 Contribution, 미디어 편집 후 기지국으로 전달하기 위한 Distribution, 기지국에서 최종 시청자에게 전송하는 Delivery의 3개의 전송 단계로 나누어 볼 수 있다(그림 2). 각 전송 단계에서 사용되는 주요 프로토콜들은 다음과 같다.

가. Contribution

현장 리포터나 스포츠 중계차와 같은 카메라 영상 촬영 현장에서 편집/제작이 이루어지는 인제 스트실 또는 편집/제작 기기로 전송하는 단계를 말한다. 미디어의 고화질 전환과 증가하는 미디어 생산량은 Contribution 구간에서 충분한 대역폭을 요구한다. 방송 제작이 IP 네트워크로 전환되면서 주로 RTSP(Real Time Streaming Protocol)나 RTMP(Real-Time Messaging Protocol)가 주로 사용되었으나 방송 품질과 높은 신뢰도를 요구하는 전송 구간에서 전송 에러와 보안의 취약성과 같은 문제점 발생으로 SRT(Secure Reliable Transport) 프로토콜이 주로 사용되고 있다.

SRT는 Haivision이 만든 오픈소스 비디오 전송 프로토콜이다. RTMP는 TCP를 사용하기 때문에 장거리, 장시간 전송에는 취약하다. 이러한 단점을 보완하기 위하여 SRT는 UDP 프로토콜 위에 구축하여 전송 지연 문제를 해결하고 종단간 비디오 전송 보안을 보장하기 위해 AES(Advanced Encryption Standard) 암호화 지원 및 신뢰성 보장을 위해 FEC(Forward Error Correction)와 ARQ(Automatic Repeat Request)를 사용한다[15]. SRT는 예측하기 힘든 네트워크 환경에서도 비디오 전송의 품질을 높이고 저지연 특성을 유지하는 것에 중점을 두고 만들어져 공공망에서 나타나는 다양한 문제들인 패킷 손실, 지터, 지연, 대역폭 문제를 효과적으로 극복할 수 있다. 안정적인 스트림 전송을 위한 하드웨어 타입의 SRT 인코더 디코더도 출시되어 있으나 아직 종류가 많지는 않다. 그리고 재생과 관련한 제어 기능을 다양하게 지원하지 않아 미디어 스트리밍에서는 First Mile Contribution에서 사용하기에 적합하다.

나. Distribution

Distribution은 프로덕션에서 제작된 미디어를 서비스 사용자에게 전달하기 전 중간 단계인 기지국 또는 데이터 센터, 스트리밍 서버로 전송하는 단계이다. 미디어 배포를 위해 와우자(Wowza)와 같은 자체 독립 서버를 구축할 수도 있고 유튜브, 트위치, 아프리카TV와 같은 기존의 스트리밍 인프라를 사용할 수도 있는데, 이때 주로 사용되는 프로토콜은 SRT나 RTMP가 있다. 제작된 미디어 콘텐츠를 다양한 인터넷 서비스 플랫폼의 수신 단말에 전달하기 위해서 기지국은 사용자가 원하는 플랫폼에 적합한 프로토콜로 변환할 수 있어야 한다.

RTMP는 Adobe에서 만든 실시간 스트리밍 프로토콜로 전용 스트리밍 서버와 AV 플레이어 간 비디오, 오디오, 데이터 스트리밍을 위해 사용된다. 지연 시간이 짧은 장점이 있지만 플래시 플레이어를 이용해 스트림을 제공하여 HTML5 플레이어와 호환되지 않고 재생 안정성이 떨어져 대규모 시청 환경에 최적화되어 있지 않다. 그래서 대규모 시청 환경의 사용자들이 사용하는 비디오 스트리밍에 잘 사용되지 않고 어도비 플래시, 와우자와 같은 전용 미디어 서버나 CDN(Content Delivery Network) 서버들이 구축되어 있어야 하므로 복잡성과 비용이드는 단점이 있다. OBS, Livestream Studio, vMix, WireCast, Xsplit와 같은 많은 스트리밍 제작 소프트웨어들은 트위치, 유튜브, 페이스북, 네이버TV, VLive, 아프리카TV 등의 다양한 방송 플랫폼과 연결할 수 있도록 사용자 지정 RTMP(Custom RTMP) 기능을 제공한다.

다. Delivery

서비스를 이용하는 시청자를 위해 방송을 전송하는 단계로 Delivery에서는 다양한 형태의 수신 단말이 이용할 수 있어야 한다. 방송 형태가 TV를 포함하여 스마트폰, 태블릿과 같은 모바일 단말로 확대되면서 미디어 스트리밍을 위해 기업별로 독자적인 프로토콜을 선보였고 기기, 플랫폼별로 지원되는 스트리밍 프로토콜도 달랐다. 과거에는 주로 온라인 비디오를 RTMP로 전송하였지만 플래시 기반 표준으로 Flash 플러그인을 지원하는 장치가 점점 줄어들면서 Apple에서 만든 HLS(HTTP Live Streaming)와 MPEG-DASH가 주요 스트리밍 프로토콜로 자리 잡았고 가장 널리 사용된다. 이러한 프로토콜은 사용자의 네트워크, 사용 단말 성능 등 시청자의 환경에 따라 비디오 전송 품질을 구분하여 적응적으로 스트리밍한다. 그 밖에 HTTP 전송, DRM(Digital Rights Management), HDR(High Dynamic Range) 지원 등 여러 가지 기능을 지원한다.

Ⅲ. 클라우드-IP 기반 미디어 제작 기술

방송 제작 시스템이 SDI 전송에서 IP 네트워크로 전환되면서 방송 장비 또한 하드웨어에 종속되지 않는 소프트웨어 기반의 장비 전환이 빠르게 진행되고 있다. 공개 표준 기반의 제작 기술이 단계적으로 진행되고 네트워크, 프로세싱, 스토리지를 포함한 컴퓨팅 성능도 발전하면서 소프트웨어 기반의 클라우드 제작이 용이하게 되었다. 여기에 OTT(Over The Top) 미디어 시장이 확대되고 비대면 서비스 환경이 보편화되면서 소규모, 전문 제작의 라이브 영상 제작 환경과 실시간 미디어 원격 협업 제작 플랫폼의 필요성은 높아지고 있다. 클라우드 기반의 라이브 프로덕션의 장점은 전용 하드웨어에 구애받지 않고 클라우드 플랫폼에 미디어를 저장하여 언제 어디서나 액세스가 가능하여 편리하게 작업에 참여할 수 있다는 점이다. 클라우드상에서는 시스템 리소스를 유연하게 할당하고 회수할 수 있고, 제작 시스템의 각 기능 요소의 공통 활용이 가능하여 원격 제작이나 기기 관리, 협업이 용이하다. 전문 편집 장비를 이용할 필요 없이 클라우드상에서 저장, 편집, 가공에서 유통까지 콘텐츠 제작자가 적은 비용으로 쉽고 빠르게 제작에 참여할 수 있어서 유연하고 효율적인 제작 환경을 제공한다.

1. 클라우드-IP 제작 관련 기술

그림 3은 클라우드-IP 기반의 미디어 제작 플랫폼 개념도를 나타낸다. 다양한 원격지의 제작 사이트로부터 생성된 라이브 영상들은 IP 망을 통해 클라우드 제작 시스템으로 전달되고 클라우드상에서 미디어 처리, 원격 협업 연결 제어, 자원 관리 등이 이루어진다. 제작 편집이 끝난 최종 영상은 OTT 플랫폼으로 송출하여 사용자에게 전달된다. 클라우드-IP 기반 미디어 제작 시스템을 구성하기 위해서는 다양한 형태의 미디어 입력을 처리하고 원격의 기기와 상호 운용하기 위한 IP 기반의 미디어 게이트웨이가 필요하다. 미디어 게이트웨이는 영상 오디오 기기를 통해 SDI, HDMI, SMPTE 2110, NDI(Network Device Interface)와 같은 다양한 형태로 출력되는 미디어를 적절한 형식의 IP 데이터로 변환하여 클라우드 시스템으로 전달할 수 있다. 필요에 따라 저지연의 안정적인 전송을 위해 캡슐화되거나 해상도, 전송률에 따라 인코딩, 압축하여 IP 네트워크로 전달되기도 한다. 게이트웨이의 또 다른 기능으로는 클라우드 시스템을 통해 원격의 위치에서 조작되는 다양한 미디어 장치를 제어 및 관리하기 위한 클라이언트 기능을 가질 수 있다. 카메라와 조명 마이크와 같은 미디어 장치의 제어 및 관리를 위해 개방형 표준인 NMOS를 사용할 수 있고, LAN(Local Area Network) 또는 WAN(Wide Area Network) 환경에서 원격 연결을 통해 새로운 연결 장비 식별, 노드 간의 연결 관리, 이벤트 & 탈리 신호 전달 등 기기 제어와 관리를 위한 게이트웨이 역할을 한다. 클라우드 내에서는 원격의 미디어 장치를 제어하고 관리하기 위해 NMOS 기반의 등록 및 검색 서비스를 위한 서버 기능이 필요한데, 게이트웨이를 이용하여 A/V 장치들뿐만 아니라 조명 시스템, 프롬프터와 같은 미디어 제작 장치를 원격에서 제어할 수 있다.

비디오 스위처는 실시간 영상 제작 플랫폼의 중요한 구성 요소이다. 다양한 소스에서 들어오는 여러 비디오 또는 오디오 신호를 선택하고 해당 신호를 전환하거나 믹싱하거나 재구성하는 데 필요하다. 클라우드 플랫폼에서의 스위처는 IP 네트워크를 통해 여러 비디오 소스를 수신하고 의도된 프레임에서 정확한 스위칭 기술로 지연 없이 처리하는 것이 중요하다. 원격에서 접속한 제작자가 여러 비디오 데이터의 캡슐화와 압축을 해제한 후 실시간으로 모니터링하고 스위칭해야 하므로 웹 인터페이스의 지연 없는 멀티뷰 재생 기능을 이용한 미디어 제작 기술이 필요하다.

클라우드-IP 기반 미디어 제작 시스템의 또 다른 특징은 모바일 기기를 이용한 제작이 용이하다는 것이다. 클라우드 제작 시스템은 모바일 네트워크를 통하여 여러 위치의 사용자로부터 다양한 콘텐츠를 수집하고 원거리에서도 비용 효율적인 제작과 협업이 가능하다. 모바일 앱을 사용하여 지연 없이 멀티 카메라 프로그램을 만들 수도 있고 스마트 장치와 클라우드 내의 제작 서버 간 통신이 가능하여 원격에서 해상도, 프레임 속도, 줌 등의 제작 기능을 제어할 수도 있다. 또한, 개방형 표준을 따르는 모바일 기기 애플리케이션이라면 시스템 관리자 또는 제작자가 클라우드 시스템에 연결된 각 모바일 기기를 제어하고 관리할 수 있다.

2. 클라우드 기반 AI 제작 기술 동향

최근 들어 AI(Artificial Intelligence) 및 관련 하드웨어 기술의 발전으로 다양한 분야에 AI가 활용되고 있으며, 방송 미디어 분야에서도 AI를 활용한 제작, 전달, 그리고 소비자의 미디어 소비 패턴 분석 등 다양하게 시도되고 있다. 특히 AI를 활용한 미디어 제작, 편집 기술은 미디어의 제작 과정을 자동화함으로써 모든 제작 과정을 일일이 수작업으로 처리했던 기존 방식보다 인력 및 비용 절감을 가능하게 하고 있다.

AI를 활용한 제작 자동화 기술로 영국 BBC Research는 인공지능 기반 화면 인식 기술을 활용한 “Ed”를 소개한 바 있으며, 스튜디오에서 촬영한 멀티 카메라 영상을 AI를 활용하여 샷을 추출하고 컷 편집을 자동화하는 알고리즘을 소개하였다. 또한, 영국 에딘버러 축제와 같은 야외 이벤트에서는 하나의 와이드 샷 영상으로부터 다양한 이벤트 영상을 동시에 추출하여 스트리밍하는 AI 기술을 시연한 바 있다[16]. 국내의 경우 KBS에서는 K-POP과 같은 한 무대에 여러 명의 가수가 등장하는 콘텐츠에서 인물별 개별 영상을 자동으로 추출하는 AI 기반 알고리즘을 개발하여 시연하였다.

AI를 활용한 편집 자동화 및 비디오 클립 생성 기술도 활발히 연구되고 있다. 미국의 IBM Watson에서는 SF 영화 Morgan의 예고편 영상 및 윔블던 경기의 하이라이트 영상 생성에 AI 기술을 활용하였다. Ross Goodwin은 영화 제작사와 협업하여 인공지능 모델인 Benjamin을 활용한 영화 대본을 생성하고, 이를 토대로 Sunspring이란 영화를 제작하여 공개한 바 있다. 국내에서도 SBS와 같은 방송사, 플랫폼 기업 등에서 스포츠 영상의 하이라이트, 영화 및 드라마의 요약 클립 생성을 위한 AI 기술이 활발히 연구되고 있으며, 최근 ETRI에서는 사용자의 의도에 따라 인터랙티브 미디어를 창작할 수 있도록 시나리오 기반 플랫폼을 개발하였다[17].

Ⅳ. 결론

콘텐츠를 생성하고 제작, 편집, 배포 및 전달하는 방식은 빠르고 지속적인 변화가 있었다. 미디어 워크플로우는 이전과 비교하여 점점 IP로 이동하여 제작과 전달 방법에 있어서 유연성과 확장성, 다양성을 가지게 되었다. 미디어 산업이 IP 및 클라우드 기술로의 전환을 겪고 있지만 전환 경로는 다양하다. 앞서 살펴보았던 SMPTE ST 2110, NMOS, ProAV 산업 기술, 네트워크 스트리밍 기술 및 5G와 같은 기술도 IP 지원 워크플로우를 위한 많은 옵션 중 하나이며, 온프레미스와 클라우드 모두에서 서로 다른 기술을 혼합하여 사용할 수도 있다. IP 네트워크를 기반으로 클라우드, 모바일, LAN 및 WAN을 통해 비디오를 전송함으로써 유연성, 확장성, 비용 효율성을 가지고 고정 SDI 인프라에서는 사용할 수 없었던 새롭고 고유한 서비스를 생성할 수 있을 것이다. 진보된 IP 네트워크 기술과 컴퓨팅 기술 발전에 힘입어 클라우드-IP 기반의 제작 성능 향상이 기대되고, 자원 공유를 통한 미디어 인프라 가상화에 대한 관련 기술 개발은 활발히 이루어질 것으로 전망된다.

용어해설

클라우드-IP 기반 미디어 제작 시스템 카메라로부터 획득한 영상을 클라우드-IP 기술을 이용하여 전문 제작자 및 소규모/개인 창작자가 고품질, 실시간, 원격으로 미디어를 제작하여 서비스할 수 있는 시스템

ProAV(Professional Audiovisual) 넓은 의미로 시청각 제품 및 서비스의 제조업체, 딜러, 시스템 통합업체, 컨설턴트, 프로그래머, 프레젠테이션 전문가 및 기술 관리자로 구성된 산업 및 기술. 좁은 의미로 상업용으로 설치된 모든 오디오 및 영상 시스템

약어 정리

AES

Advanced Encryption Standard

AES

Audio Engineering Society

AI

Artificial Intelligence

AIMS

Alliance for IP Media Solutions

AMWA

Advanced Media Workflow Association

API

Application Programming Interface

ARQ

Automatic Repeat Request

CDN

Content Delivery Network

DASH

Dynamic Adaptive Streaming over HTTP

DRM

Digital Rights Management

EBU

European Broadcasting Union

FEC

Forward Error Correction

HDMI

High-Definition Multimedia Interface

HDR

High Dynamic Range

HLS

HTTP Live Streaming

HTTP

Hypertext Transfer Protocol

IPMX

IP Media Experience

IS

Interface Specification

ITU-T

International Telecommunication Union-Telecommunication

JPEG

Joint Photographic Experts Group

JT-NM

Joint Task Force on Networked Media

KVM

Kernel-based Virtual Machine

LAN

Local Area Network

MPEG

Moving Picture Experts Group

NDI

Network Device Interface

NMOS

Networked Media Open Specifications

NPN

Non-Public Network

OBS

Open Broadcaster Software

OTT

Over The Top

ProAV

Professional Audiovisual

PTZ

Pan-Tilt-Zoom

RTMP

Real Time Messaging Protocol

RTSP

Real Time Streaming Protocol

SDI

Serial Digital Interface

SDVoE

Software Defined Video over Ethernet

SMPTE

Society of Motion Picture and Television Engineers

SRT

Secure Reliable Transport

TCP

Transmission Control Protocol

UDP

User Datagram Protocol

URLLC

Ultra Reliable Low Latency Communications

VSF

Video Service Forum

VQEG

Video Quality Experts Group

WAN

Wide Area Network

D. Gomez-Barquero et al., "IEEE TRANSACTIONS ON BROADCASTING special issue on: 5G media production, contribution, and distribution," IEEE Trans. Broadcast., vol. 68, no. 2, 2022, pp. 415-421.

SMPTE ST 2110-10, Professional Media Over Managed IP Networks: System Timing and Definitions, 2017.

SMPTE ST 2110-21, Professional Media Over Managed IP Nnetworks: Traffic Shaping and Delivery Timing for Video, 2017.

SMPTE ST 2110-22, Professional Media Over Managed IP Networks: Constant Bit-Rate Compressed Video, 2017.

SMPTE ST 2110-31, Professional Media Over Managed IP Networks: AES3 Transparent Transport, 2017.

SMPTE ST 2110-40, Professional Media Over Managed IP Networks: SMPTE ST 291-1 Ancillary Data, 2017.

EBU/SMPTE/VSF JT-NM, Joint Task Force on Networked Media Phase 2 Report, Reference Architecturev1.0, Sept. 4, 2015.

D. Gomez-Barquero et al., "5G-RECORDS, 5G key technology enablers for emerging media content production services," 2021, https://www.5g-records.eu/EUCNC_2021/1570710919.pdf

SRT Alliance, "Secure Reliable Transport Protocol," 2018, https://github.com/Haivision/srt/files/2489142/SRT_Protocol_TechnicalOverview_DRAFT_2018-10-17.pdf

C. Wright et al., "AI in production: Video analysis and machine learning for expanded live events coverage," SMPTE Motion Imaging J., vol. 129, no. 2, pp. 36-45, March 2020.

표 1 SMPTE ST 2110 표준 문서 구성

표 2 NMOS Interface Specifications

출처 Reproduced from [10], CC BY-ND 4.0.

- Sign Up

- 전자통신동향분석 이메일 전자저널 구독을 원하시는 경우 정확한 이메일 주소를 입력하시기 바랍니다.