오세아니아 지역의 XR 기술 연구 동향

XR Technology Research Trends in Oceania

- 저자

-

양웅연지능형콘텐츠인식연구실 uyyang@etri.re.kr 이건남호주대학(UniSA) 인터랙티브&가상환경(IVE) 센터 gun.lee@unisa.edu.au

- 권호

- 40권 3호 (통권 214)

- 논문구분

- 일반논문

- 페이지

- 93-102

- 발행일자

- 2025.06.02

- DOI

- 10.22648/ETRI.2025.J.400310

본 저작물은 공공누리 제4유형: 출처표시 + 상업적이용금지 + 변경금지 조건에 따라 이용할 수 있습니다.

본 저작물은 공공누리 제4유형: 출처표시 + 상업적이용금지 + 변경금지 조건에 따라 이용할 수 있습니다.- 초록

- This report presents an in-depth analysis of extended reality (XR) technology research trends across Oceania, with a focus on Australia and New Zealand. XR includes virtual reality (VR), augmented reality (AR), and mixed reality (MR) thus integrating the real and virtual worlds to deliver immersive experiences and redefine sensory and cognitive interactions. The study highlights XR’s role as a fundamental platform for metaverse services, emphasizing its integration with advanced technologies such as artificial intelligence, 5G/6G networks, and cloud computing. These innovations are transforming industries, including entertainment, education, healthcare, manufacturing, defense, and tourism. Oceania has emerged as a global leader in XR research, supported by world-class university research centers, rich resources, and an open research ecosystem. Detailed case studies from the University of South Australia’s Center and its Empathic Computing Laboratory, alongside collaborative projects under the Australasian Researchers in Interactive Virtual Environments network, showcase advances in immersive VR therapy, AR-based safety systems, narrative visualization, and empathic computing. The findings offer critical insights for advancing domestic XR technologies and global metaverse development.

Share

Ⅰ. 서론

본고는 XR(VR, AR, MR) 기술을 중심으로 오세아니아, 특히 호주와 뉴질랜드의 최신 연구 동향을 심도 있게 분석한다. XR 기술은 단순한 디지털 상호작용을 넘어서, 실제와 가상을 융합하여 몰입형 경험을 창출하고 사용자 감각과 인지를 확장하는 혁신적 플랫폼이다. 보고서는 AI, 5G/6G, 클라우드 컴퓨팅 등 첨단 네트워크 기술과의 융합을 통해 XR 기술이 엔터테인먼트, 교육, 의료, 제조, 군사, 관광 등 다양한 산업 영역에서 어떻게 활용되고 있는지, 그리고 이를 통한 메타버스 플랫폼 구현 가능성을 다각도로 조명한다. 또한, 각 연구기관이 추구하는 구체적 문제 해결 방법과 그에 따른 연구 성과를 비교 분석하여 국내외 XR 기술 발전에 필요한 시사점을 도출하는 데 목적을 둔다.

오세아니아 지역은 세계적 수준의 대학 연구소와 개방적인 연구 생태계를 기반으로 XR 기술의 다양한 응용을 선도하고 있으며, 본고는 이들 기관의 혁신적 접근법과 성공 사례를 중심으로 최신 동향을 종합적으로 제시한다.

Ⅱ. UniSA IVE 연구 동향

남호주대학교(University of South Australia)의 Interactive and Virtual Environments(IVE) 센터1)는 2019년에 설립된 XR 연구의 핵심 기관이다. IVE는 컴퓨터과학, 공학, 신경과학, 산업 디자인, 건축, 예술 등 다양한 분야의 전문가들이, 각각 특화된 다음의 8개 연구실을 운영하며 실질적 문제 해결 및 신제품‧서비스 개발에 집중하고 있다.

• 건축 및 도시 정보학: 물리적 및 가상 공간에서의 설계와 시각화 기술 개발

• 인지 신경과학: 인간의 인지 메커니즘을 해석하고 XR 환경에서의 적용 가능성을 모색

• 창의적 컴퓨팅: 인터랙티브 디자인과 창의적 알고리즘을 통한 사용자 맞춤형 인터페이스 연구

• 건강 및 웰빙 디자인: VR 기반 치료 및 교육 프로그램을 통한 건강 증진 연구

• 공감 컴퓨팅: 사용자의 감정과 생체 데이터를 활용한 공감적 상호작용 인터페이스 개발

• 문화 놀이: 인터랙티브 기술을 통한 문화 콘텐츠 및 엔터테인먼트 응용

• 복합 인간 환경 디자인: 현실과 가상의 경계를 허무는 통합적 환경 설계 연구

• 착용형 컴퓨팅: 웨어러블 기술 기반 실시간 데이터 수집 및 사용자 인터페이스 개선

1. 최신 연구 및 기술 사업화 사례

IVE에서는 최근 5년간 다음과 같은 주요 연구 성과를 달성했다.

첫째, 몰입형 VR 치료 및 교육: 환자들의 임상 학습 효과 및 만성 통증 관리 개선을 목표로, 그림 1과 같이 ‘Hulk Smash’ 요법은 환자가 가상의 슈퍼히어로 아바타로 변신하여, VR 환경에서 통증 완화 및 운동 기능 개선을 유도하는 연구이다[1]. 12명의 만성 통증 환자를 대상으로 한 예비 실험에서 통증 감소 및 운동 기능 향상이 확인되었으며, 이 결과는 약물 치료의 부작용 없이 비용 효율적인 치료 방법임을 입증했다. 기술적 특징으로는 몰입형 환경에서의 인터랙션 설계와 사용자 피드백을 정밀하게 반영하여, 기존 치료 방식과 확연히 구분되는 새로운 치료 패러다임을 제시한 점이다.

그림 1

헐크 스매시! 만성 통증을 완화하는 새로운 VR ‘슈퍼히어로 테라피’

출처 Reprinted with permission from University of South Australia, “Hulk Smash! New VR ‘Superhero Therapy’ crushes chronic pain.” (Image source: https://www.eurekalert.org/news-releases/998216)

둘째, AR 기반 안전성 및 생산성 향상: 건설 및 제조 현장에서 실시간 위험 요소와 결함을 자동으로 감지하는 시스템 개발을 목표로, Sarah Constructions 회사와 협업으로 개발된 AR 시스템(그림 2)은 시선 추적과 AR 인터페이스를 결합하여 작업자가 현장의 결함과 위험 요소를 즉각 인지할 수 있도록 지원한다[2]. 이 시스템은 수작업 점검 프로세스를 자동화하여, 안전성과 효율성을 대폭 향상시키며, 제조 및 에너지 분야로의 확장이 기대된다. 기술적 특징으로는 기존 수작업 기반 안전 점검의 한계를 극복하고, 실시간 데이터 피드백을 통해 자동화된 위험 관리 시스템을 구현한 점이다.

그림 2

AR 환경 시선 추적 기반 건설 현장 결함 조기 식별

출처 Reprinted with permission from University of South Australia, “Revolutionising building inspections using Augmented Reality.” (Image source: https://unisa.edu.au/research/ive/research-impact/revolutionising-building-inspections/)

셋째, 내러티브 시각화 도구 개발: 복잡한 데이터 분석 결과를 시각적 스토리텔링 형태로 재구성하여 사용자 의사 결정 지원을 목표로, Andrew Cunningham 박사와 연구팀은 호주 연방 경찰의 사건 기록 및 제조 환경의 운영 이력을 이미지 기반 스토리로 요약하는 도구를 개발했다[3]. 이 도구는 데이터 해석 시간을 단축시키며, 비전문가도 쉽게 이해가 가능한 방식으로 정보를 제공한다. 기술적 특징으로는 인공지능, 통계, 그래픽 디자인 기법을 통합해, 데이터의 핵심 정보를 명확하게 시각화함으로써 의사 결정 과정의 효율성을 높인 점이다.

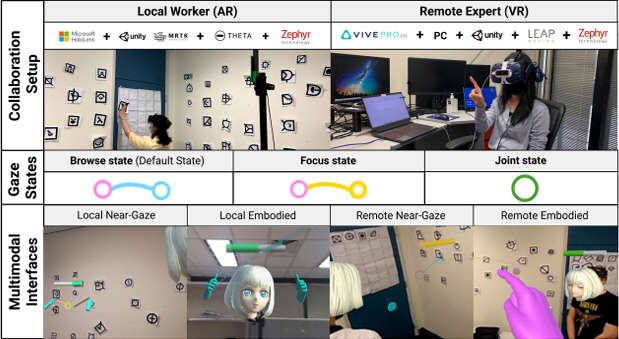

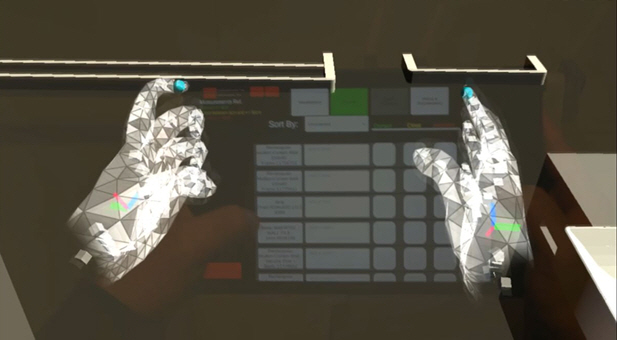

넷째, 공감적 컴퓨팅 및 원격 협업 기술: 그림 3[4]과 같이 AR/VR 환경에서 생체 신호와 정서 정보를 실시간으로 공유하여 원격 협업의 질을 개선하는 것을 목표로, ‘Empathy Glasses’는 사용자의 시선, 표정, 심박수 등 생체 데이터를 동기화하여, 원격 협업 상황에서도 비언어적 의사소통을 가능하게 하며, ‘Hyperscanning’ 기술은 VR 환경 내에서 사용자 간 신경 활동을 동기화하여 협업 효율을 극대화시켰다. 기술적 특징은 감정 인식과 생체 신호 분석을 기반으로 한 인터페이스 설계로 교육, 의료, 원격 근무 등 다양한 분야에 적용할 수 있는 실용적 기술을 제공한 점이다.

그림 3

AR/VR 기반 원격 협업에서 공감 수준 향상을 위한 시선 공유 연구 사례

출처 Reprinted from A. Jing et al., “Near-Gaze Visualisations of Empathic Communication Cues in Mixed Reality Collaboration,” in Proc. ACM SIGGRAPH Conf. Comput. Graph. Interact. Tech., (Vancouver BC, Canada), Aug. 2022.

IVE의 연구 결과가 산업계에 성공적으로 적용된 사례는 다음과 같다.

첫째, Treasury Wines Estate AR 프로젝트: MS HoloLens를 활용해 AR 애플리케이션을 개발, 와인 라벨링 작업의 속도와 정확도를 크게 개선했다. 실시간 정보 제공 및 작업자 훈련 자동화를 통해 작업 효율성이 증대되고 운영 비용이 절감되었으며, AR 기술의 몰입적 사용자 경험이 다양한 산업 분야에 응용될 수 있음을 입증했다.

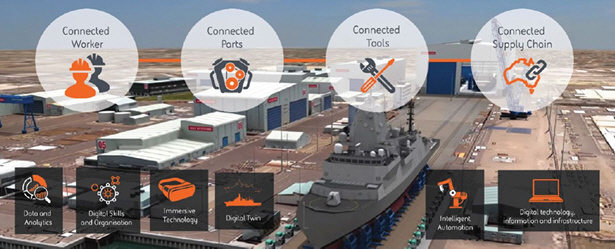

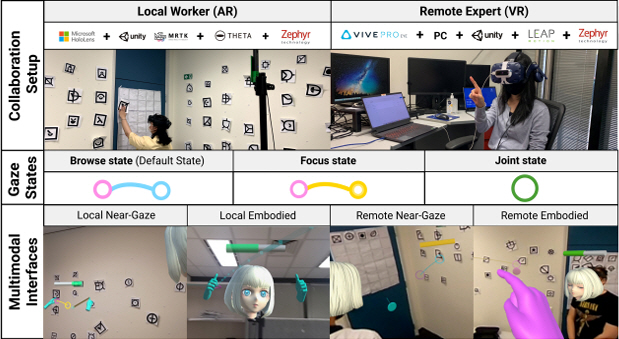

둘째, BAE Systems Australia 협력 프로젝트: Hunter Class Frigate Program을 위한 내러티브 시각화 및 빅데이터 처리 기술을 개발해 제조 공정의 문제점을 실시간으로 파악하고 개선할 수 있도록 지원했다. 그림 4와 같이 UniSA 연구진은 데이터 시각화와 AR/VR 기술을 결합해 3D 모델 기반의 제조 공정을 설계, 작업 계획 및 문제 해결 능력을 향상시켜 연간 약 300만 달러의 비용 절감을 달성하는 등, 방위 산업을 비롯한 다양한 제조 프로젝트에 적용 가능성을 보여주었다.

그림 4

데이터 시각화, VR/AR 기술을 활용하여 조선소 계획, 문제 해결 능력을 향상, 효율적인 의사 결정을 지원한 사례

출처 Reprinted with permission from University of South Australia, “Delivering world-class innovation to the Hunter Class Frigate Program.”(Image source: https://www.unisa.edu.au/research/ive/research-impact/delivering-world-class-innovation-to-the-hunter-class-frigate-program/)

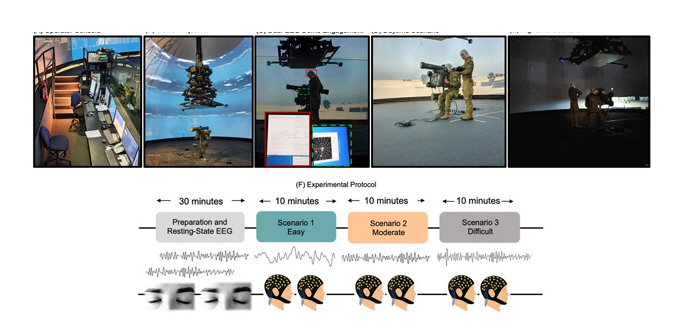

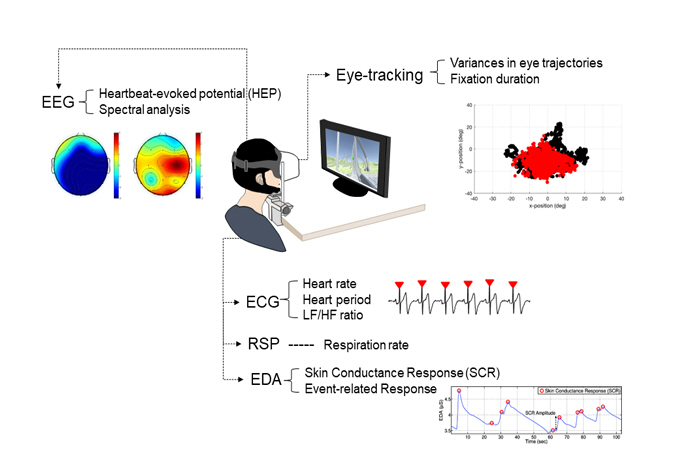

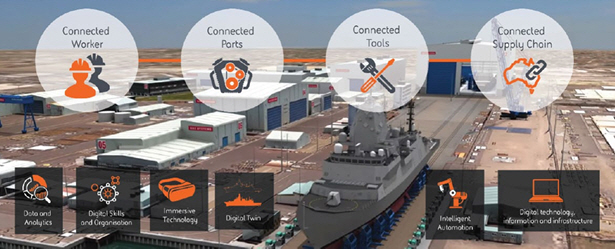

셋째, 인지 신경 과학 기반 군사 훈련 강화 프로젝트: 호주 육군 및 국방과학기술그룹(DSTG)과 협업하여, 그림 5와 같이 훈련생의 뇌 활동을 실시간으로 분석함으로써 개인별 맞춤형 훈련을 제공하는 시스템을 개발했다[5]. 휴식 상태의 뇌파만으로도 팀 및 개인의 성과를 예측할 수 있어, 이 기술이 군사 훈련뿐만 아니라 기업과 교육 기관의 훈련 프로그램 개선에도 활용될 수 있음을 시사한다.

2. IVE ECL의 최신 연구 동향

UniSA IVE에 소속된 ECL(Empathic Computing Laboratory)는 인간과 기술 간의 정서적 격차를 해소하기 위해 공감 컴퓨팅 기술을 연구하는 연구실이며, IVE센터에서 XR연구와 Ⅲ장에서 소개하는 ARIVE 연구협력 네트워크를 주도하고 있다[6]. 다음은 ECL의 주요 연구 분야이다.

첫째, 비동기식 협업 감정 시각화 기술: 동시 협업자가 없는 상황에서도 생체 신호(심박수, 피부 전도도, 안구 움직임)와 표정 데이터를 실시간 분석, 시각화하여 감정 상태를 전달함으로써 원격 협업 환경에서 비언어적 의사소통의 한계를 극복하고 팀워크 및 생산성을 향상시키는 기술을 개발한다. 이를 위해 HoloLens 2, Vive Pro Eye 등 AR/VR 기기와 Zephyr/Shimmer 센서를 활용, 혼합현실 인터페이스로 통합한 실험 시스템을 2022년부터 평가 중이다.

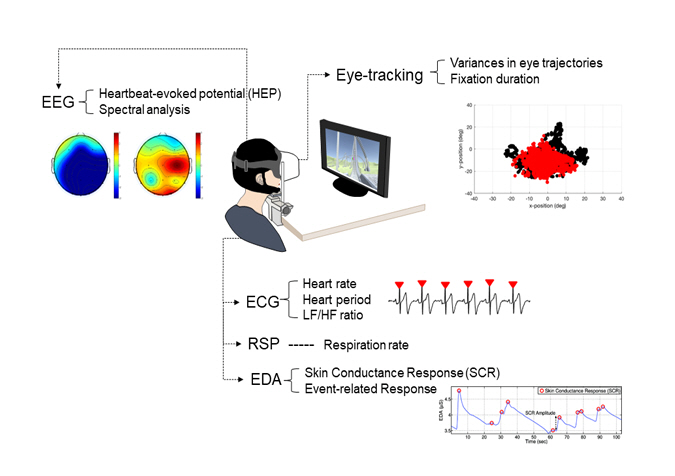

둘째, 착용형 디스플레이 사이버 멀미 완화 연구: 그림 6과 같이 VR/AR 기기 사용 시 발생하는 사이버 멀미를 줄이기 위해 사용자의 생체 정보를 실시간 측정‧분석하여 멀미 예측 및 완화 알고리즘을 개발한다. 특히, HMD 기반 VR 환경에서 시각-전정 불일치를 분석하고 이를 보완하는 콘텐츠 설계 전략을 제시해 몰입형 환경에서의 사용자 경험 최적화를 도모한다.

그림 6

다중 생체 신호 분석 기반 HMD 사용성 개선 연구 사례

출처 Reprinted with permission from Empathic Computing Lab, “Detecting of the Onset of Cybersickness using Physiological Cues.”(Image source: https://empathiccomputing.org/project/detecting-of-the-onset-of-cybersickness-using-physiological-cues/)

셋째, 시공간 시각화 기법을 활용한 기계 조립 및 협업 설계 지원: AR 기술로 복잡한 조립 과정을 3D 모델로 시각화하고 단계별 안내를 제공해 작업의 정확도와 속도를 개선하며, VR을 통한 동시/비동시 협업 환경을 구축하여 작업 유연성과 생산성을 증진하는 연구를 진행한다. 3D 기록 및 재생 기술로 과거 작업 과정을 재현해 조립 및 분해 작업의 정확도를 높이는 데 이바지한다[7].

Ⅲ. ARIVE 연구 동향

1. ARIVE 소개

ARIVE(Australasian Researchers in Interactive Virtual Environments)는 오스트레일리아와 뉴질랜드의 AR/VR 연구를 선도하는 학술 네트워크로, 2019년에 설립되어 8개 기관(2025년 3월 현재 7개 기관)과 250명 이상의 연구진이 참여하고 있으며, 연간 1천만 달러 이상의 연구비를 운용하고 있다. 이 네트워크는 AR/VR 관련 연구 수요에 대응하는 단일 창구 기능으로, 세계적인 규모로 여러 연구기관이 협력하여 연구를 진행하고 있다. 주요 연구 분야로는 상호작용 기법, 몰입형 분석, 교육 및 훈련, 공감 기술, 몰입형 게임 등 8개 핵심 주제가 있다.

2. ARIVE 참여 기관 연구 동향

다음은 ARIVE에 참여하고 있는 연구기관별 각각의 특징과 대표 연구자 및 최근에 수행된 주요 연구 논문을 소개한다.

가. 남호주대학교(UniSA) IVE

이 그룹은 SCOPUS 기준 AR 연구 논문 발표에서 선두를 차지하고 VR 관련 논문도 상위 10위 안에 포함된다. UniSA에서 개발된 주요 기술로는 최초의 야외 AR 게임, 야외 AR CAD 도구, SAR 기반 실내 설계, AR 시선 공유, VR 통증 관리 시스템, 하이브리드 AR/VR 협업 시스템 등이 있다.

주요 연구자 Mark Billinghurst는 XR 협업과 몰입형 환경에서의 디자인 작업을 연구하고 있으며, VR-AR 환경에서의 효율적인 의사소통 방법과 원격 협업을 위한 시스템 및 인터페이스를 개발하고 있다. Gun Lee는 AR, VR, MR 환경을 혼합한 교차 현실 협업 시스템 연구를 진행하고 있으며, VR을 활용한 교육과 훈련 시스템, 그리고 VR 환경에서 실시간으로 사용자의 요구에 맞게 포털 크기와 위치를 조정하는 적응형 포털 기술을 연구하고 있다.

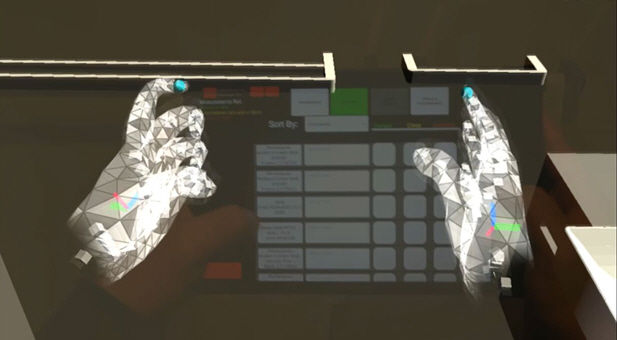

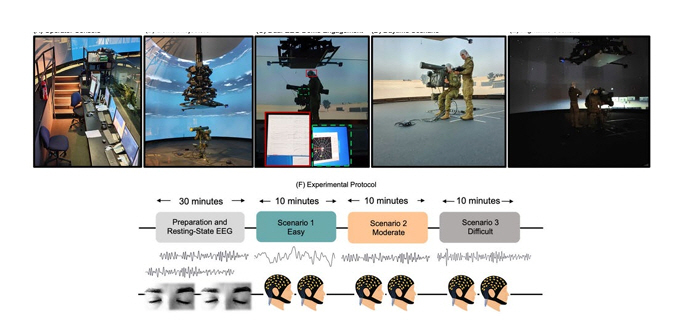

최근 연구 논문에서는 얼굴 인식을 사용하여 아동의 자폐증을 조기에 선별하는 시스템을 제시했으며[8], 그림 7과 같이 VR에서 다양한 도구 기반 비대칭 인터페이스를 사용해 빠르고 정확한 스케치 방법을 연구한 사례도 있다[9].

그림 7

VR 상호작용 성능 향상을 위한 비대칭 인터페이스 연구 사례

출처 Reprinted from Q. Zou et al., “Stylus and Gesture Asymmetric Interaction for Fast and Precise Sketching in Virtual Reality,” Int. J. Hum.-Comput. Interact., vol. 40, no. 23, 2024, pp. 8124-8141.

나. 모나쉬대학교(Monash University) 몰입형 분석 및 데이터 시각화 연구소

이 연구소는 2014년 “몰입형 분석(Immersive Analytics)” 이라는 개념을 제시하여, 이후 해당 분야의 선도자로 자리매김했다. 연구소는 데이터 분석과 의사 결정을 개선하기 위한 몰입형 디스플레이와 상호작용 기술의 잠재력을 탐구하며, 2018년 출간된 책 “Immersive Analytics”는 16,500회 이상 다운로드되며 그 명성을 확립했다.

주요 연구자 Tim Dwyer는 VR 환경에서 효율적인 원격 상호작용 기술과 시각적 분석 도구 개발을 연구하며, Gazealytics와 같은 시선 추적 데이터 분석 도구를 개발했다. 이 도구는 시선 분석 기능을 통합하여 다양한 분석 작업을 지원하며, 사용자에게 시공간적 탐색을 위한 맞춤형 뷰를 제공한다. 또한, 협업 마인드 매핑 시스템을 통해 VR과 데스크톱 환경에서 상호작용과 의사소통 메커니즘을 개선하고 있다. Kim Marriott는 VR과 AR을 활용한 몰입형 데이터 스토리텔링과 위치 기반 시각화를 연구하며, 실제 환경의 제약을 완화하는 방법을 모색하고 있다. 특히 맹인 및 저시력자들을 위한 데이터 시각화 기술 개발에 주력하며, 점자 디스플레이와 대화형 에이전트, 터치스크린 기술을 활용하여 데이터 접근성을 향상시키고 있다.

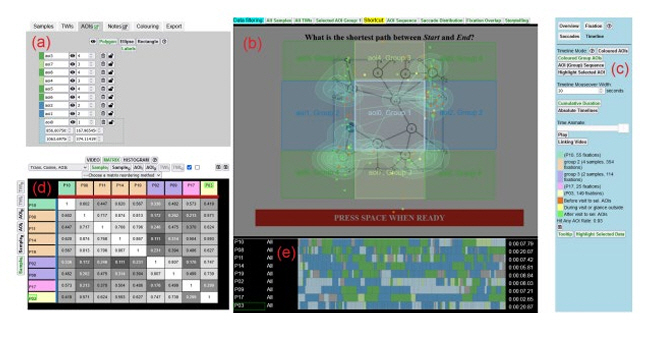

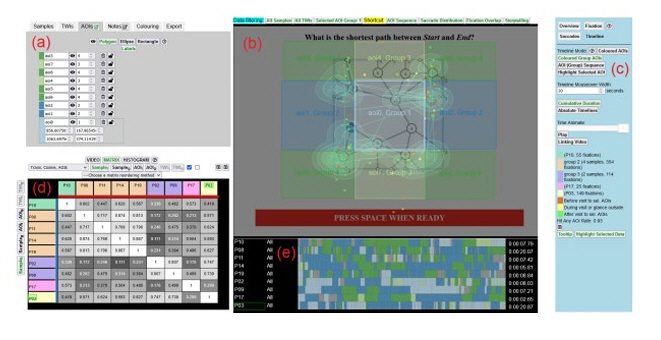

최근 연구로는 그림 8과 같이 “Gazealytics: A Unified and Flexible Visual Toolkit for Exploratory and Comparative Gaze Analysis”[10]에서 시선 추적 데이터를 시각적으로 분석하기 위한 통합 툴킷을 소개했다.

그림 8

Gazealytics 툴 활용 사례: (a) 데이터 관리 패널, (b) 공간 패널, (c) 매개변수 제어 패널, (d) 메트릭 패널, (e) 타임라인 패널

출처 Reprinted with permission from K.T. Chen et al., “Gazealytics: A Unified and Flexible Visual Toolkit for Exploratory and Comparative Gaze Analysis,” in Proc. Symp. Eye Track. Res. Appl., (New York, NY, USA), May. 2023, pp. 1-7.

다. 뉴사우스웨일즈대학교(NSW) 확장된 인식 및 상호작용 센터(EPICentre)

EPICentre는 UNSW 아트 및 디자인 캠퍼스에 위치한 고급 시각화 연구 센터로, 예술, 디자인, 의학, 공학 분야에서 시각화 연구를 진행하고 있다. 이 센터는 1억 2천만 픽셀의 해상도를 자랑하는 원통형 화면과 7미터 크기의 구형 돔, XR 실험실, 3X3 멀티 터치 iWall을 갖춘 CG 실험실을 보유하고 있다.

주요 연구자 Tomasz Bednarz는 ADHD 아동을 위한 시선 기반 인터페이스 연구, 대화형 시각화 도구 개발, VR 기반 감정 분석 프레임워크 구축 등의 연구를 진행하고 있다. ADHD 아동을 위한 시선 추적 기반 인터페이스는 주의 지속 시간을 늘리고 학습 성과를 향상시키는 데 효과적임을 입증했으며, 대화형 시각화 도구 ‘Gravity++’는 복잡한 데이터를 이해하고 탐색하는 데 도움을 주는 프레임워크로 개발되었다. 또한, VR 기반 감정 분석 시스템은 감정을 다각도로 분석하는 데 효과적임을 확인했다.

최근 연구 논문에서는 “Human-robot creative interactions”에서 소셜 로봇의 창의성을 탐구하며, 로봇의 움직임이 창의성 인식에 미치는 영향을 실험했다. “Gravity++: A graph-based framework for constructing interactive visualization narratives”[11]에서는 일관된 시각적 데이터 스토리를 위한 대화형 시각화 프레임워크를 제시하여, 데이터 탐색과 시각적 표현 변화의 모델링을 통해 청중에게 더 나은 전달을 가능하게 했다.

라. 퀸즐랜드대학교 확장 현실 및 퍼베이시브 컴퓨팅 연구소(EXRPC)

이 연구소는 사용자의 감정적 및 인지적 상태를 측정, 해석, 공유 및 조정할 수 있는 XR 인터페이스 개발에 집중하고 있으며, 사용자 중심 및 상호작용 기술 설계에 관한 연구를 수행하고 있다.

주요 연구자 Stephen Viller는 디지털 기술을 활용한 건강 증진, 난민 기업가들을 위한 지원 방안, 그리고 에너지 네트워크 운영을 위한 VR 기술 활용에 관한 연구를 진행하고 있다. 그는 디지털 기술이 신체 활동 부족 문제 해결에 어떻게 적용될 수 있는지, 난민 기업가들에게 필요한 지원 방안을 제시하며, VR을 이용해 에너지 네트워크의 상태를 분석하고 협력 및 정보 공유를 증진하는 방법을 연구한다.

최근 연구로는 “VR.net: A Real-world Dataset for Virtual Reality Motion Sickness Research”[12]에서 VR 멀미 연구를 위한 실제 데이터 세트인 VR.net을 소개했으며, 165시간의 게임 플레이 데이터를 기반으로 멀미 관련 레이블을 정확하게 할당하는 도구를 개발했다. “User-centred design of a grid health virtual reality tabletop for energy networks”[20]에서는 에너지 네트워크의 건강 상태를 이해하고 분석하는 VR 플랫폼인 Grid Health VR을 제시하여, 네트워크 운영자와 지역사회 간의 협력 증진 및 에너지 절약을 촉진할 수 있는 가능성을 보여주었다.

마. 오클랜드대학교 AR/VR 연구 그룹

이 연구 그룹은 스마트 기술의 발전에 따라 인간과 컴퓨터, 인간과 인간 간의 상호작용을 보다 자연스럽고 최적화된 방식으로 개선하는 연구를 수행한다. 공감 컴퓨팅 연구 그룹은 생리학적 센서와 EEG를 활용해 감정과 뇌 활동을 인식하고, 혼합 현실(MR)에서 사람의 주변 환경을 캡처하여 협업 환경에서 시선, 제스처, 비언어적 신호를 공유하는 기술을 개발하고 있다.

Suranga Nanayakkara와 Haimo Zhang을 중심으로 한 연구진은 VR 멀미를 유발할 가능성이 있는 경험을 식별하는 도구 ‘VRhook’을 개발했다. 이 도구는 VR 게임에서 레이블된 데이터를 자동으로 추출하며, 머신 러닝 기반 연구를 지원하는 데 중요한 역할을 할 수 있다. 또한, VR에서 생체 신호를 사용하여 감정적 자전적 기억 회상을 인식하는 연구에서는 높은 정확도로 감정적 기억을 식별할 수 있음을 입증했다. 그리고 AR/VR 기술을 이용해 학습 경험을 향상시키기 위한 연구도 진행 중이다. ‘Kiwrious AR’ 앱은 학생들이 모바일 AR과 전자 센서를 이용해 과학적 탐구 학습을 지원하며, 몰입감 있고 상호작용적인 교육 환경을 제공한다.

최근 연구 논문으로는 “Total VREcall”[13]에서 VR 환경에서 감정적 자전적 기억 회상의 유효성을 조사한 결과, 77.1%의 일반화된 정확도와 최대 95.1%의 개인별 정확도를 달성했다. “Implementation of Attention-Based Spatial Audio for 360° Environments”[14]에서는 360° 환경에서 주의 기반 공간 오디오를 통해 의사소통을 개선하는 연구를 발표했다.

바. 캔터버리대학교 휴먼 인터페이스 기술 연구소 뉴질랜드(HIT Lab NZ)

이 연구실은 지난 20여 년간 가상 현실(VR), 증강현실(AR), 인간-로봇 상호작용, 원격 협업, 응용 몰입형 게임 디자인 등을 활용하여 실제 문제를 해결하는 데 집중해 왔다. 뉴질랜드에서 규모가 가장 큰 인터랙션 연구소로, VR/AR/MR 기술을 사용하여 인간과 기술 간의 상호작용을 연구하고 있다. 특히 예술 교육에서 IT 기술 활용에 관한 연구를 선도하며, 유네스코 예술 교육 옵저버토리 설립에 참여하고, 뉴질랜드와 태평양 지역의 음악 교육에 중점을 두고 있다.

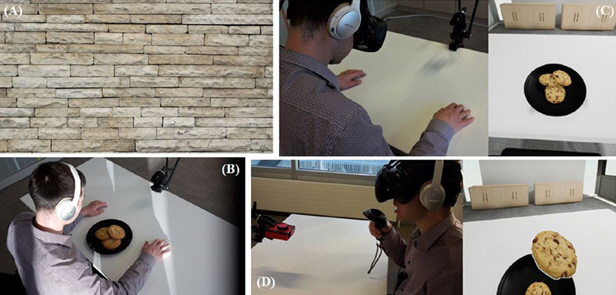

주요 연구자 Stephan Lukosch는 AR/VR 게임에서 시간 압박과 방해 요소의 영향을 연구한 결과, AR 게임에서 시간 압박과 방해 요소를 추가해도 사용자 경험에 큰 차이는 없지만, 비상 대피 경고에 대한 태도와 행동 의도가 향상된다는 것을 발견했다. 이는 AR 게임이 비상사태 대비 교육에 효과적인 도구가 될 수 있음을 보여줬다. 그리고, 공유 AR 환경에서의 신뢰 구축 연구에서는 아이템 교환과 같은 상호작용이 시스템과 대인 관계 신뢰도를 향상시키는 요소로 작용한다고 밝혔다. 증강 가상환경에서의 촉각적 인식 조작에 관한 연구에서는 재료의 시각적 외관 변화가 촉각적 인식에 영향을 미치며, 시각적 외관과 물리적 재료의 일치가 촉각적 인식의 향상에 중요한 역할을 한다고 밝혔다.

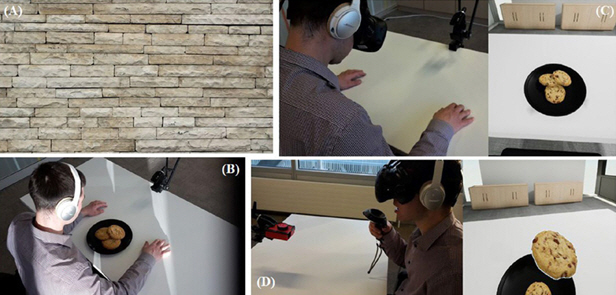

최근 연구로는 그림 9와 같이 “Eliciting real cravings with virtual food”[15]에서 VR 환경에서 음식 자극이 식욕에 미치는 영향을 탐구했다. 연구 결과, VR 환경은 타액 분비와 식욕 상태를 증가시키고, 합성 후각 단서를 추가하면 식욕을 더욱 증대시킬 수 있음을 확인했다. “Exploring the effects of time pressure and distracting elements in an Augmented Reality game for emergency preparedness”[16]에서는 AR 게임에서 시간 압박과 방해 요소가 비상 대피 의지에 미치는 영향을 연구한 결과, AR 게임이 비상사태 대비 교육에 효과적이라는 결론을 도출했다.

그림 9

VR 환경에서 가상 식용 자극 실험 사례

출처 Reprinted from N.M. Harris et al., “Eliciting real cravings with virtual food: Using immersive technologies to explore the effects of food stimuli in virtual reality,” Front. Psychol., vol. 14, 2023.

사. 오타고대학교

이 연구 그룹은 이론 연구부터 프로토타입 개발, 실시간 컴퓨터 비전 증강, 신경과학 기반 신체적 상호작용, 지속적 증강을 지원하는 인터페이스 개발 등 다양한 분야에서 연구를 수행하고 있다. 특히 컴퓨터 비전, 정보 시각화, 컴퓨터 그래픽 기술을 활용하여 VR/AR 응용 프로그램을 모델링하고 시각화하는 연구를 진행하고 있다. 주요 연구 프로젝트에는 라이브 스포츠 관중을 위한 AR, 문화유산의 3D 재구성, 실시간 의료 및 미디어 데이터 변환 등이 포함된다. 그리고, 다임러/메르세데스 벤츠, 퀄컴, Vuforia와 같은 기업들과 협력하여 특허를 출원하거나 AR 기반 뇌졸중 치료와 같은 실용적인 연구를 통해 실제 환경에서 적용 가능한 기술을 제공하고 있다.

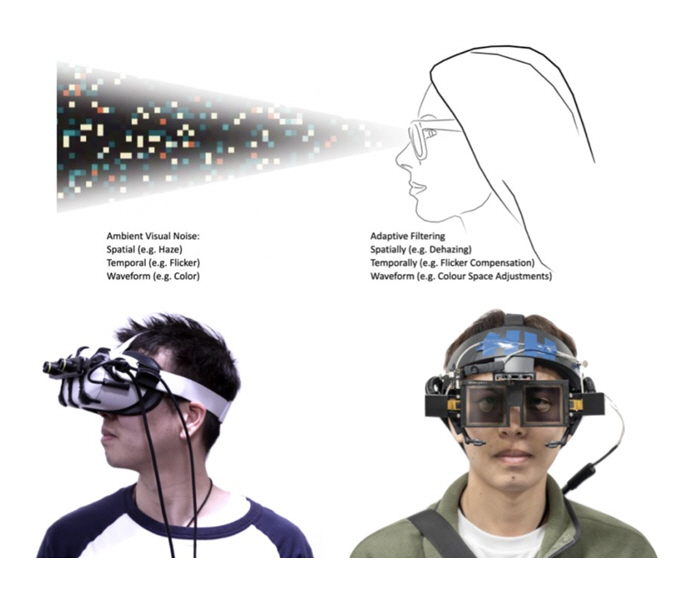

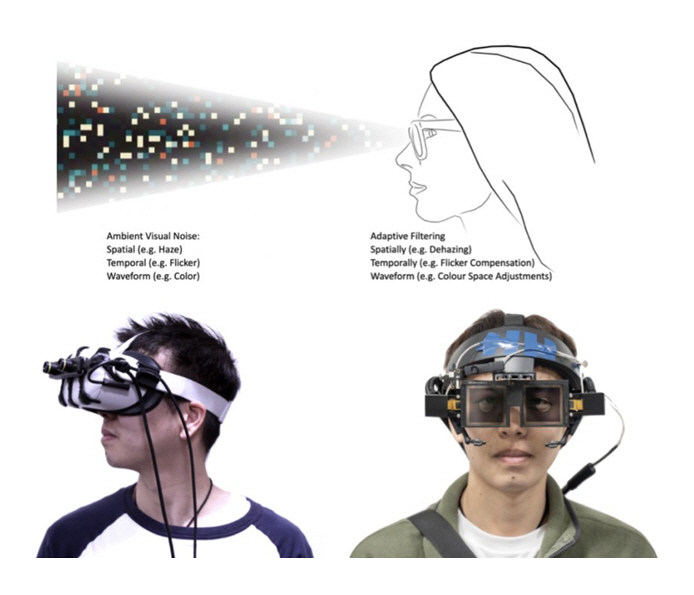

주요 연구자 Holger Regenbrecht는 시각 증강을 위한 새로운 디자인 공간과 대안 생성, 혼합 현실에서의 존재감 측정 및 평가, 시각적 불편함과 시각적 노이즈 제거를 연구하고 있다. 그는 시각 증강을 위한 디지털 안경 디자인, 혼합 현실의 존재감 정의, 시각적 노이즈를 제거하는 기술에 대해 연구하며, LCD 광 액추에이터를 사용한 웨어러블 장치를 개발하여 사용자 피드백을 통해 효과를 입증했다. Tobias는 AR을 사용한 실제 시각적 안내와 작업 전환을 지원하는 Spatial Gaze Markers(SGM) 기술, 시각적 노이즈 제거 및 시각 증강을 위한 기술을 연구했다. 그의 연구는 AR 안경을 활용한 깜빡임 기반 안내, AR 환경에서 시선 추적을 통한 작업 전환 개선, 시각적 노이즈 감소의 효과를 입증했다.

최근 연구로는 “VRVideos: A flexible pipeline for Virtual Reality Video Creation”[17]에서 VR 비디오 제작을 위한 유연한 파이프라인을 제시하였으며, 그림 10과 같이 “Exploring Visual Discomfort and Opportunities for Vision Augmentations”[18]에서는 시각적 불편함과 시각적 노이즈 제거를 위한 새로운 프로토타입을 개발해 시각 증강 환경에서의 개선을 제시했다.

그림 10

시각적 노이즈 제거(VNC)의 개념

출처 Reprinted with permission from J. Hong et al., “Exploring Visual Discomfort and Opportunities for Vision Augmentations: Visual Noise Cancellation and Head-worn LCD Light Actuators for Perception Modulation,” in Proc. Int. Conf. Mobile Human-Comput. Interact., (Melbourne VIC, Australia), Sep. 2024.

Ⅳ. 기타 기관의 XR 연구 동향

CSIRO Data61은 호주 연방 과학 산업 연구 기구(CSIRO)의 디지털 혁신 및 연구 부서로, 데이터 과학, 인공지능, 디지털 기술을 활용하여 산업과 사회에 실질적인 변화를 일으키는 연구를 수행하고 있다. 주요 연구 분야는 데이터 분석, 인공지능(AI), 자동화, 가상 및 증강 현실(VR/AR/XR), 사물인터넷(IoT) 등이며, 특히 디지털화와 자동화가 중요한 산업 분야에서의 기술 적용에 강점이 있다. XR 분야와 관련된 부서로 Immersive Environments Lab.은 몰입 환경에서의 감성적 상호작용과 사용자 경험 개선을 목표로 감정 반응을 활용한 가상 훈련 시뮬레이션을 연구하고 있다. Mixed Reality Lab.은 실제-가상 통합 환경에서 협업 및 상호작용을 강조하는 공간 인식, 사용자 맞춤형 환경 설계 연구를 수행하고 있다.

최근 연구로 “Dynamic Situational Awareness” 프로젝트[19]는 인간-로봇 협업 향상을 목표로, 동적 상황 인식 개발, 복잡한 환경 적용, 종합적 상태 고려를 통해 효과적인 협업 방법을 연구했다. 생체 신호 활용과 멀티모달 인터페이스 개발로 상황 인식을 개선해서 인간-로봇 협업의 효율성과 안전성을 크게 향상시킬 것으로 예상된다.

Ⅴ. 결론

오세아니아 지역의 XR 기술 연구는 메타버스와 몰입형 콘텐츠 서비스의 발전에 중요한 역할을 하고 있다. XR 기술의 진화는 AI, 5G/6G 통신 등 첨단 기술과의 융합을 통해 다양한 산업 분야에서 실용적인 솔루션을 제공할 것이며, 이는 글로벌 시장에서의 경쟁력 강화로 이어질 것이다. 향후 XR 기술의 확산과 상용화를 위해서는 오세아니아 지역의 연구 기관들과의 협력이 중요하며, 다양한 기술 산업화 경험의 공유도 가능할 것이다.

용어해설

Empathic Computing 사용자 감정과 생체 신호를 분석해 공감적 상호작용을 돕는 기술

약어 정리

D.S. Harvie et al., "Virtual Reality Body Image Training for Chronic Low Back Pain: A Single Case Report," Front. Virtual Real., vol. 1, 2020.

K.W. May et al., "Towards a Quantitative Approach for Monitoring and Evaluating Construction Defect Management Inspection Performance using Eye-tracking Technologies," in Proc. IEEE Int. Symp. Mixed Augment. Real. Adjunct (ISMAR-Adjunct), (Singapore, Singapore), Oct. 2022, pp. 776-781.

M. Cordeil et al., "IATK: An Immersive Analytics Toolkit," in Proc. IEEE Conf. Virtual Real. 3D User Interfaces (VR), (Osaka, Japan), Mar. 2019, pp. 200-209.

A. Jing et al., "Near-Gaze Visualisations of Empathic Communication Cues in Mixed Reality Collaboration," in Proc. ACM SIGGRAPH Conf. Comput. Graph. Interact. Tech., (Vancouver BC, Canada), Aug. 2022.

Z.R. Cross et al., "Task-related, intrinsic oscillatory and aperiodic neural activity predict performance in naturalistic team-based training scenarios," Sci. Rep., vol. 12, 2022.

T. Piumsomboon et al., "Empathic Mixed Reality: Sharing What You Feel and Interacting with What You See," in Proc. Int. Symp. Ubiquitous Virtual Reality, (Nara, Japan), Jun. 2017, pp. 38-41.

H.Y. Cho et al., "Time Travellers: An Asynchronous Cross Reality Collaborative System," in Proc. IEEE Int. Symp. Mixed Augment. Real. Adjunct (ISMAR-Adjunct), (Sydney, Australia), Oct. 2023, pp. 848-853.

Q. Wu et al., "Early Autism Screening in Children Using Facial Recognition," in Proc. Ext. Abstr. CHI Conf. Hum. Factors Comput. Syst., (Honolulu, HI, USA), May. 2024, pp. 1-7.

Q. Zou et al., "Stylus and Gesture Asymmetric Interaction for Fast and Precise Sketching in Virtual Reality," Int. J. Hum.-Comput. Interact., vol. 40, no. 23, 2024, pp. 8124-8141.

K.T. Chen et al., "Gazealytics: A Unified and Flexible Visual Toolkit for Exploratory and Comparative Gaze Analysis," in Proc. Symp. Eye Track. Res. Appl., (New York, NY, USA), May. 2023, pp. 1-7.

H.O. Obie et al., "Gravity++: A graph-based framework for constructing interactive visualization narratives," J. Comput. Lang., vol. 71, 2022.

E. Wen et al., "VR.net: A Real-world Dataset for Virtual Reality Motion Sickness Research," IEEE Trans. Vis. Comput. Graph., vol. 30, no. 5, 2024, pp. 2330-2336.

K. Gupta et al., "Total VREcall: Using Biosignals to Recognize Emotional Autobiographical Memory in Virtual Reality," in Proc. ACM Interact. Mob. Wearable Ubiquitous Technol., (New York, NY, USA), vol. 6, no. 2, Jun. 2022, pp. 1-21.

A. Nassani et al., "Implementation of Attention-Based Spatial Audio for 360° Environments," in Proc. IEEE Int. Symp. Mixed Augment. Real. Adjunct (ISMAR-Adjunct), (Singapore, Singapore), Oct. 2022, pp. 491-494.

N.M. Harris et al., "Eliciting real cravings with virtual food: Using immersive technologies to explore the effects of food stimuli in virtual reality," Front. Psychol., vol. 14, 2023.

M. Mirza et al., "Exploring the effects of time pressure and distracting elements in an Augmented Reality game for emergency preparedness," Int. J. Disaster Risk Reduct., vol. 114, 2024.

A. Dickson et al., "VRVideos: A flexible pipeline for Virtual Reality Video Creation," in Proc. IEEE Int. Conf. Artif. Intell. Virtual Real. (AIVR), Dec. 2022, pp. 199-202.

J. Hong et al., "Exploring Visual Discomfort and Opportunities for Vision Augmentations: Visual Noise Cancellation and Head-worn LCD Light Actuators for Perception Modulation," in Proc. Int. Conf. Mobile Human-Comput. Interact., (Melbourne VIC, Australia), Sep. 2024.

그림 1

헐크 스매시! 만성 통증을 완화하는 새로운 VR ‘슈퍼히어로 테라피’

출처 Reprinted with permission from University of South Australia, “Hulk Smash! New VR ‘Superhero Therapy’ crushes chronic pain.” (Image source: https://www.eurekalert.org/news-releases/998216)

그림 2

AR 환경 시선 추적 기반 건설 현장 결함 조기 식별

출처 Reprinted with permission from University of South Australia, “Revolutionising building inspections using Augmented Reality.” (Image source: https://unisa.edu.au/research/ive/research-impact/revolutionising-building-inspections/)

그림 3

AR/VR 기반 원격 협업에서 공감 수준 향상을 위한 시선 공유 연구 사례

출처 Reprinted from A. Jing et al., “Near-Gaze Visualisations of Empathic Communication Cues in Mixed Reality Collaboration,” in Proc. ACM SIGGRAPH Conf. Comput. Graph. Interact. Tech., (Vancouver BC, Canada), Aug. 2022.

그림 4

데이터 시각화, VR/AR 기술을 활용하여 조선소 계획, 문제 해결 능력을 향상, 효율적인 의사 결정을 지원한 사례

출처 Reprinted with permission from University of South Australia, “Delivering world-class innovation to the Hunter Class Frigate Program.”(Image source: https://www.unisa.edu.au/research/ive/research-impact/delivering-world-class-innovation-to-the-hunter-class-frigate-program/)

그림 5

인지 신경 과학 기반 군사 훈련 강화 프로젝트 사례

출처 Reprinted from Z.R. Cross et al., “Task-related, intrinsic oscillatory and aperiodic neural activity predict performance in naturalistic team-based training scenarios,” Sci. Rep., vol. 12, 2022.

그림 6

다중 생체 신호 분석 기반 HMD 사용성 개선 연구 사례

출처 Reprinted with permission from Empathic Computing Lab, “Detecting of the Onset of Cybersickness using Physiological Cues.”(Image source: https://empathiccomputing.org/project/detecting-of-the-onset-of-cybersickness-using-physiological-cues/)

그림 7

VR 상호작용 성능 향상을 위한 비대칭 인터페이스 연구 사례

출처 Reprinted from Q. Zou et al., “Stylus and Gesture Asymmetric Interaction for Fast and Precise Sketching in Virtual Reality,” Int. J. Hum.-Comput. Interact., vol. 40, no. 23, 2024, pp. 8124-8141.

그림 8

Gazealytics 툴 활용 사례: (a) 데이터 관리 패널, (b) 공간 패널, (c) 매개변수 제어 패널, (d) 메트릭 패널, (e) 타임라인 패널

출처 Reprinted with permission from K.T. Chen et al., “Gazealytics: A Unified and Flexible Visual Toolkit for Exploratory and Comparative Gaze Analysis,” in Proc. Symp. Eye Track. Res. Appl., (New York, NY, USA), May. 2023, pp. 1-7.

그림 9

VR 환경에서 가상 식용 자극 실험 사례

출처 Reprinted from N.M. Harris et al., “Eliciting real cravings with virtual food: Using immersive technologies to explore the effects of food stimuli in virtual reality,” Front. Psychol., vol. 14, 2023.

그림 10

시각적 노이즈 제거(VNC)의 개념

출처 Reprinted with permission from J. Hong et al., “Exploring Visual Discomfort and Opportunities for Vision Augmentations: Visual Noise Cancellation and Head-worn LCD Light Actuators for Perception Modulation,” in Proc. Int. Conf. Mobile Human-Comput. Interact., (Melbourne VIC, Australia), Sep. 2024.

- Sign Up

- 전자통신동향분석 이메일 전자저널 구독을 원하시는 경우 정확한 이메일 주소를 입력하시기 바랍니다.