MPEG의 3D Gaussian Splatting 압축 기술 표준화 동향

MPEG Standardization Trends for 3D Gaussian Splatting Compressionk

- 저자

-

정준영실감미디어연구실 jyj0120@etri.re.kr 이광순실감미디어연구실 gslee@etri.re.kr 오관정실감미디어연구실 kjoh@etri.re.kr 정원식실감미디어연구실 wscheong@etri.re.kr 추현곤실감미디어연구실 hyongonchoo@etri.re.kr

- 권호

- 41권 2호 (통권 219)

- 논문구분

- AI로 가속화되는 초실감 공간결합 기술

- 페이지

- 12-21

- 발행일자

- 2026.04.01

- DOI

- 10.22648/ETRI.2026.J.410202

본 저작물은 공공누리 제4유형: 출처표시 + 상업적이용금지 + 변경금지 조건에 따라 이용할 수 있습니다.

본 저작물은 공공누리 제4유형: 출처표시 + 상업적이용금지 + 변경금지 조건에 따라 이용할 수 있습니다.- 초록

- 3D Gaussian Splatting (3DGS) has emerged as a compelling representation for real-time novel view synthesis. However, its massive data size poses challenges for storage, transmission, and deployment in commercial services. In response, MPEG launched a dedicated standardization effort, termed Gaussian Splat Coding (GSC), aimed at enabling efficient compression and interoperable delivery of 3DGS data. This article provides an overview of the background and current status of MPEG GSC standardization, describing how 3DGS compression discussions have evolved across multiple MPEG working groups and how a step-by-step standardization strategy has been adopted. This strategy, begins with the INRIA 3DGS (I-3DGS) format, introduces a lightweight track for early industrial use, and extends existing MPEG standards through a Amendments to support practical deployment.

Share

I. 서론

방사장(Radiance Field)은 공간 내 임의 위치와 시선 방향에 따라 관측되는 빛의 세기를 연속 함수로 표현함으로써, 복잡한 기하 구조와 조명 효과를 자연스럽게 재현할 수 있는 3차원 장면 표현 방식이다. 이러한 개념은 2020년 NeRF(Neural Radiance Fields)의 등장을 계기로 본격적으로 주목받기 시작했으며[1], 소수의 입력 영상만으로도 고품질의 임의 시점 영상을 합성할 수 있다는 점에서 기존 메쉬 기반 표현이나 다시점 영상‧깊이맵 기반 합성 방식의 한계를 효과적으로 보완하였다. 그러나 신경망 기반의 암묵적(Implicit) 표현이라는 특성으로 인해 추론 과정에서 높은 계산 복잡도와 지연이 발생하며, 이에 따라 즉각적인 시점 변화가 요구되는 실시간 렌더링 서비스에 적용하기에는 구조적인 제약이 존재하였다.

이와 같은 실시간성 한계를 극복하기 위한 대안으로 제안된 3DGS(3D Gaussian Splatting)는 장면을 명시적인 가우시안 집합으로 표현함으로써, 복잡한 신경망 추론 없이도 고품질 렌더링을 실시간으로 수행할 수 있는 장점을 제공한다[2]. 각 가우시안에 기하, 색상 및 조명 정보를 부여한 뒤 이를 2D 영상 평면으로 투영하고, 픽셀 단위로 기여도를 누적하는 볼륨 렌더링(Volume Rendering) 방식은 GPU의 병렬 처리 구조와 잘 부합하며, 투영, 픽셀 처리, 블렌딩으로 구성된 기존 그래픽스 파이프라인을 그대로 활용할 수 있어 구현 측면에서도 유리하다. 이와 같은 구조적 특성으로 인해 3DGS는 가상시점 합성 분야에서 실용성 및 효율성을 동시에 만족하는 표현 방식으로 빠르게 부상하였다.

이러한 기술적 장점에 힘입어 산업계에서도 3DGS는 빠르게 확산되고 있다. 디지털 트윈, 실감형 콘텐츠 제작, 원격 협업 및 시각화 서비스 등 다양한 응용 분야에서 활용이 시도되고 있으며[3], 특히 실시간 상호작용이 요구되는 서비스 환경에서 기존 기술 대비 현실적인 대안으로 인식되고 있다. 또한, 상용 모바일 기기 및 범용 GPU 환경에서도 안정적인 렌더링이 가능하다는 점은 3DGS 기술의 산업적 확산을 가속하는 주요 요인으로 작용하고 있다.

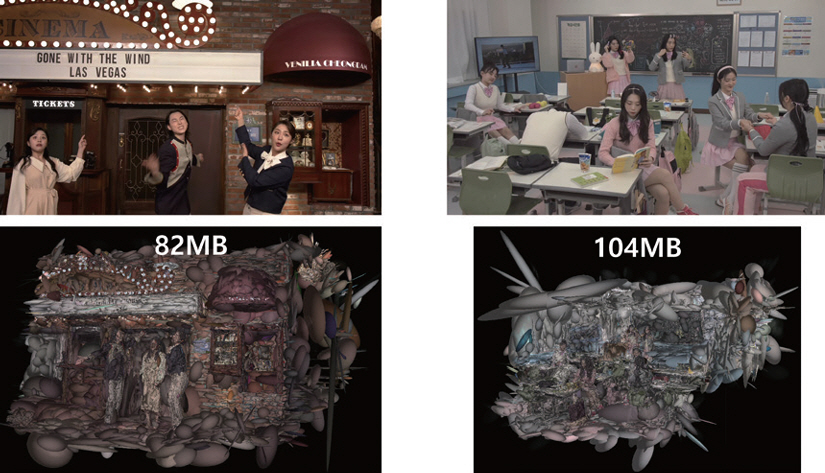

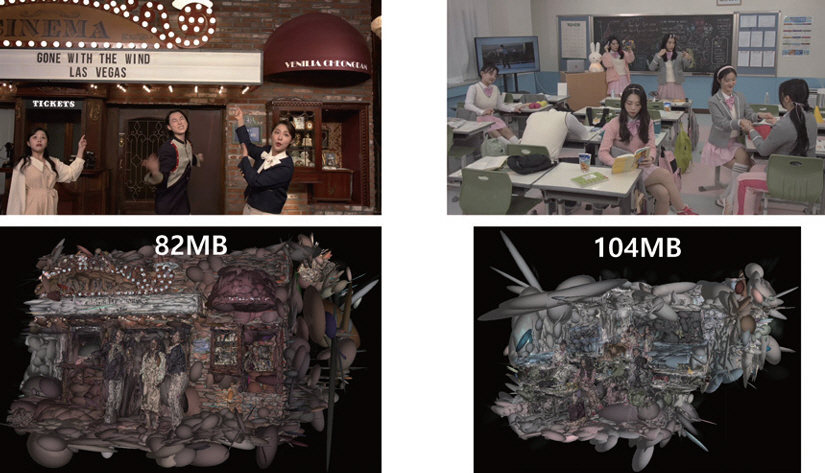

반면, 3DGS 표현 방식은 수십만에서 수백만 개에 이르는 가우시안과 그에 따른 다차원 속성 정보를 포함하므로, 원본 데이터의 용량이 매우 큰 구조적 한계가 있다(그림 1)[4]. 이는 저장 및 전송 비용 증가와 네트워크 대역폭 부담을 초래하고, 그 결과 스트리밍 지연과 경량 단말 적용의 어려움으로 이어져 상용서비스 확산을 위한 핵심 제약요인으로 작용한다. 이러한 배경에서 멀티미디어 압축 국제 표준화 기구인 MPEG를 중심으로, 3DGS 데이터를 효율적으로 표현 및 전송하기 위한 압축 기술 표준화가 2024년 10월부터 GSC(Gaussian Splat Coding)라는 프로젝트 이름으로 진행되고 있으며[5], 본고에서는 MPEG GSC 표준화의 추진 배경과 기술 범위, 그리고 최근 논의 동향을 중심으로 이를 정리한다.

II. GSC 표준화 진행사항 요약

MPEG 내에서 멀티뷰 영상과 딥러닝 모델 특징 맵 등 2D 비디오 데이터 압축과 함께 INVR(Implicit Neural Visual Representation) 프로젝트를 통해 NeRF 계열 데이터를 다뤄오던 WG4(Video Coding)에서 3DGS 데이터에 대한 논의가 본격적으로 제기되기 시작한 것은 2024년 1월 회의부터이다[6]. 이후 2024년 4월 회의까지 3DGS 데이터 압축 기술 표준화 논의는 WG4를 중심으로 진행됐으나, 3DGS 기술이 산‧학계에서 매우 빠른 속도로 발전함에 따라 압축 표준화의 대상으로 삼을 3DGS 데이터의 구체적인 형태와 범위에 대한 합의를 도출하는 데는 어려움이 있었다.

이러한 상황에서 2024년 7월부터 포인트 클라우드와 메쉬 등 3D 데이터 압축을 담당하는 MPEG WG7(3D Graphics Coding) 역시 3DGS 압축 이슈에 관심을 보이기 시작하였다[7]. 이는 3DGS가 다수의 가우시안으로 구성된 3차원 공간 정보를 포인트 클라우드 형태로 표현하는 동시에, 이를 실시간으로 렌더링하여 최종적으로 고품질의 2D 영상을 생성하는 데 활용되는 2D 및 3D 표현 특성이 결합된 복합적 성격을 가지기 때문이다. 그 결과, 표준화 범위가 상이한 두 그룹이 동시에 3DGS 압축 이슈에 관여하게 되었으며, 2024년 11월 회의까지 MPEG 내에서는 3DGS 압축 표준화를 어떤 구조와 체계로 추진할 것인지에 대한 논의가 집중적으로 이루어졌다.

이러한 논의를 바탕으로 WG4와 WG7은 2024년 11월 회의에서 3DGS 데이터 압축 표준화를 ‘GSC(Gaussian Splat Coding)’라는 명칭의 프로젝트로 공동 추진하기로 합의하였다. 이에 따라 프로젝트 의장은 WG4와 WG7에서 각각 2명씩 선임하고, 회의 진행과 기고서 관리는 정기 회의마다 번갈아 담당하는 공동 운영 구조를 채택하였다. 다만 학계 중심의 WG4와 달리, WG7에는 삼성, 소니, 노키아 등 표준의 실제 활용과 상용화에 직접적인 영향을 미치는 글로벌 주요 기업들이 다수 참여하고 있어, 표준화 논의 전반에 걸쳐 WG7의 관점이 더 적극적으로 반영되고 있다.

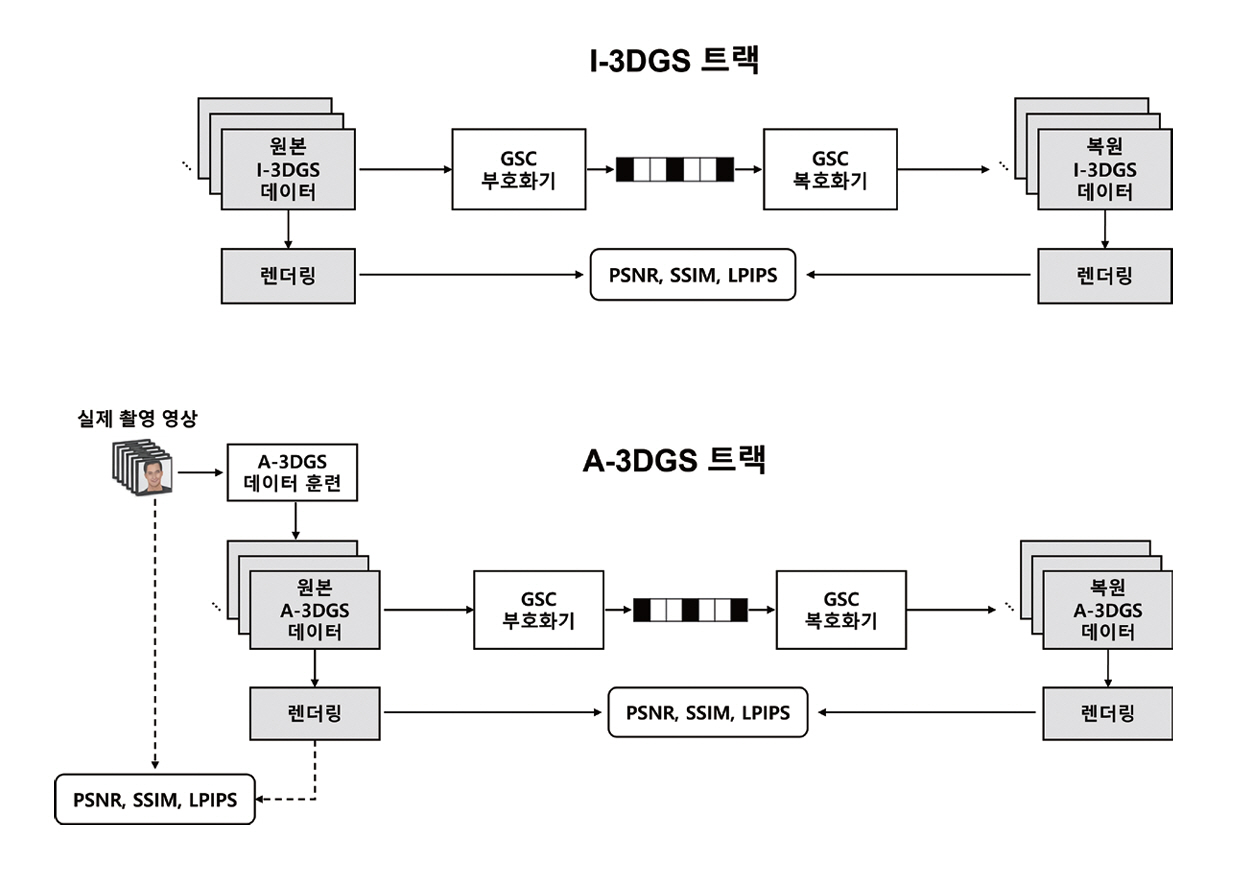

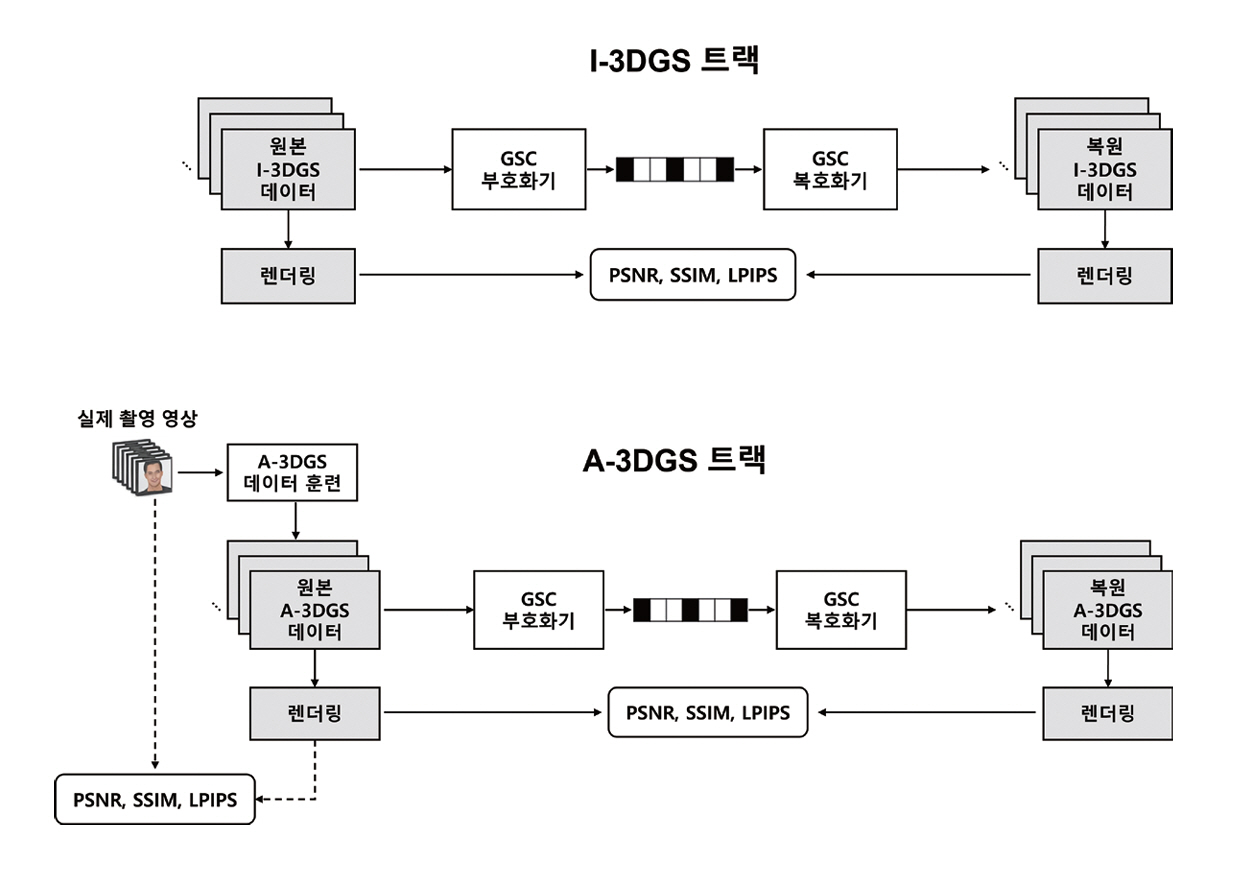

이후 2025년 1월 회의에서는 GSC 그룹의 표준화 목표가 한층 구체화 되었으며, 이에 따라 순차적인 두 단계로 구성된 표준화 방향성이 확정되었다(그림 2)[8]. 우선 1단계 표준화 대상으로는 INRIA가 2023년 SIGGRAPH에서 제안한 최초의 3DGS 데이터 형식을 I-3DGS(INRIA-3DGS)로 명명하고, 이를 1차 압축 대상으로 선정하였다. 동영상 콘텐츠의 경우에는 시간적 확장을 고려하여 프레임 단위 I-3DGS 데이터를 압축 대상으로 정의하였다. I-3DGS 데이터 형식의 세부 구조에 대해서는 Ⅲ장 1절에서 자세히 설명한다.

한편, 2단계 표준화 대상인 Alternative 3DGS(A-3DGS)는 아직 구체적인 추진 방향이 확정되지 않은 단계로, 다양한 GS 변형 기법들이 지속적으로 등장하고 있는 기술적 상황을 반영하여 압축에 적합한 GS 표현 방식을 선별하고, 이를 대상으로 한 압축 분석 실험을 I-3DGS 트랙과 병렬로 진행하기로 하였다. 이에 따라 A-3DGS 트랙은 훈련 및 표현 방식에 대한 제약을 최소화한 상태에서 다양한 GS 표현 기법의 특성과 압축 적합성을 분석하는 데 초점을 두며, 실제 촬영 영상을 입력으로 사용하는 방식을 채택한다. 반면, I-3DGS 트랙은 사전 훈련된 I-3DGS 모델을 출발점으로 하는 구조를 갖는다.

이러한 표준화 전략에 따라, 2025년 4월 회의에서는 표준화 범위와 목표가 명확한 I-3DGS 트랙을 중심으로 대기업 참여 기관들의 기고가 집중되었으며, A-3DGS 트랙에 대한 기고는 상대적으로 제한적인 수준에 그쳤다. 해당 시기에는 신규 기술 제안보다는 테스트 콘텐츠 확보, 기술 성능 평가 방법 정립, 표준화 유즈케이스 및 요구사항 정리 등 본격적인 표준화 착수를 위한 기반 환경을 마련하는 논의가 주를 이루었다[9].

또한, 산업계에서 정적 I-3DGS 데이터 압축 표준에 대한 조기 수요가 확인됨에 따라, 단일 프레임 압축을 우선 목표로 약 1년 내 표준화를 완료하는 Lightweight 트랙 추진이 결정되었다[10]. 이에 따라 신규 표준을 처음부터 개발하는 데 필요한 시간 부담을 고려하여, 기존 MPEG 국제표준과의 호환성을 유지하면서 기능 확장이 가능한 Amendment 방식이 채택되었으며, WG7의 V3C(Visual Volumetric Video-based Coding), V-PCC(Video-based Point Cloud Compression), G-PCC(Geometry-based Point Cloud Compression) 표준을 GSC 용도로 확장하는 방향이 제시되었다[9].

2025년 7월 및 10월 회의에서는 이러한 방향성을 바탕으로 상기 세 표준에 기반한 다수의 기술 기고가 제안되었으나, Lightweight 트랙의 구체적인 추진 방향에 대한 합의가 도출되지 못해 본격적인 기술 채택으로 이어지지는 못했다[11]. 다만, 10월 회의를 기점으로 대기업들의 지원을 받은 G-PCC와 V-PCC를 중심으로 확장 표준화 작업인 Amendment가 본격화되었으며, V3C는 상대적으로 제한적인 참여에 그쳐 표준화 대상에서 제외되었다.

이후 2026년 1월 회의에서는 I-3DGS를 대상으로 한 G-PCC 및 V-PCC 확장 기술이 각 표준에 여럿 채택되어 CDAM(Committee Draft Amendment) 단계가 발행되었다[12,13]. 아울러 V-PCC와 유사하게 I-3DGS 데이터를 2D 비디오 코덱으로 압축하되, 단말에서 복원에 필요한 메타데이터를 MPEG WG5(JVET: Join Video Experts Team)의 SEI(Supplemental Enhancement Information)를 통해 전달하는 새로운 접근 방식이 제시되었다[14].

JVET는 HEVC, VVC 등 비디오 주요 압축 표준을 개발해 온 조직이며, SEI는 이러한 비디오 비트스트림에 부가적으로 포함되는 복원 보조용 메타데이터를 의미한다. 2025년 10월 회의 당시에는 부정적인 의견도 제시되었으나, 이후 대기업을 중심으로 한 재기고를 통해 해당 GSC 표준화의 주요 추진 방향 중 하나로 채택되었다. 이에 따라 WG5 전문가 2명이 공동 의장으로 추가되었으며, GSC는 MPEG 내 세 그룹이 참여하는 대규모 표준화 프로젝트로 확대되었다[15].

III. GSC 표준화 기술적 현황

1. I-3DGS 데이터 형식

먼저 I-3DGS 트랙에서 압축 대상으로 선정된 I-3DGS 데이터 형식을 살펴본다. 본 형식은 일반적으로 수십만 개에 이르는 가우시안으로 장면을 구성하며, 각 가우시안은 대응 영역의 기하 구조와 색상 정보를 표현하기 위해 수식 (1)에 나타낸 바와 같이 위치, 크기, 방향 등 다양한 속성을 포함하는 총 59개의 파라미터로 정의된다.

(1)

구체적으로, 3차원 중심 좌표 벡터 (x, y, z)는 3차원 공간상에서 가우시안의 위치를 나타내고, 3차원 스케일링 회전 벡터 (s1, s2, s3)와 회전 벡터 (r1, r2, r3, r4)는 가우시안의 크기와 방향성을 표현한다. 또한, 불투명도 는 해당 가우시안이 색상 기여도를 조절하는 파라미터로 작용하며, 구면 조화(Spherical Harmonics) 계수로 표현되는 색상 정보와 함께 누적되어 픽셀 단위의 최종 색상을 결정한다. SH 계수는 시선 방향에 따라 변화하는 조명 성분을 근사하기 위한 표현 방식으로, 3차까지 사용하는 I-3DGS 형식에서는 총 48개의 실수 계수 (sh1,..., sh48)를 통해 시선 방향과 조명 변화에 따른 색상 변화를 연속적으로 표현한다. 이러한 파라미터들은 32비트 부동 소수점 형식으로 저장되며, 그 결과 파일 크기가 매우 커지고 처리해야 할 데이터 양이 급격히 증가하는 구조적 한계가 함께 수반된다.

2. 유즈케이스 및 요구사항

유즈케이스 및 요구사항은 표준이 지원하고자 하는 서비스 시나리오와 이를 구현하기 위한 기능적 및 성능적 요구사항을 정의함으로써, 표준의 적용 범위와 해결 대상 문제를 구체화하는 역할을 한다. 이는 표준화 초기 단계에서 설정되어 이후 표준화 과정 전반에 걸쳐 비교‧검토의 기준점으로 활용되며, 개발 중인 표준 기술이 초기 목표와 부합하는지를 판단하는 핵심 근거로 사용된다.

GSC 표준화에서는 실시간 원격 회의, 방송 및 스포츠 리플레이를 비롯하여 대규모 도심‧자연 공간을 대상으로 한 몰입형 체험 서비스, 의료‧제조‧군사 분야 가상훈련, 소셜 미디어 기반 3D 콘텐츠 공유, 디지털 트윈 등 다양한 응용 시나리오가 주요 유즈케이스로 고려되고 있다[16]. 이러한 유즈케이스는 장면의 정적‧동적 특성, 해상도, 콘텐츠 획득 방식, 장면 규모 등의 관점에서 분류되어, 요구사항 도출의 기초 자료로 활용된다.

이들 유즈케이스로부터 도출된 요구사항은 각 서비스 시나리오에서 공통으로 요구되는 기능과 성능을 정리한 것으로, GSC 표준 압축 기술이 충족해야 할 기준을 구체적으로 규정한다[17]. GSC 표준화 요구사항은 크게 압축 대상이 되는 GS 데이터의 구조적‧기능적 특성을 규정하는 표현 요구사항(Representation Requirements)과 표준 압축 기술이 만족해야 할 성능 및 기능을 규정하는 부호화 요구사항(Coding Requirements)으로 구분된다.

표현 요구사항에는 I-3DGS 데이터 형식에 대한 명확한 정의를 비롯하여, 동영상 확장을 위한 시간적 일관성이 보장된 프레임 단위 I-3DGS 표현 방식의 사용, 향후 A-3DGS 확장을 고려한 GS 데이터 표현 구조의 확장성, 그리고 방향 의존적 색상 및 조명 정보 지원 등이 포함된다. 한편, 부호화 요구사항에는 높은 압축 효율과 복원 품질 간의 균형, 다양한 비트레이트 및 해상도 환경에 대한 적응성, 실시간 또는 준실시간 렌더링 서비스를 고려한 처리 지연 제한, 그리고 부분 복호화 및 점진적 전송과 같은 서비스 친화적 기능 지원 등이 포함된다.

더불어, Lightweight 트랙에 대해서는 일반 GSC 요구사항과 구분되는 경량화 중심의 요구사항이 별도로 정의되어 있다[18]. 해당 요구사항은 단일 프레임 I-3DGS 데이터를 대상으로 모바일 기기나 HMD와 같은 저사양 환경에서도 실시간 또는 준실 시간 처리가 가능하게 하는 데 초점을 둔다. 이를 위해 기본적인 6자유도 렌더링 품질은 유지하되, 속성 정보의 컴팩트한 표현, 제한된 복호화 복잡도 및 메모리 사용량, 그리고 기존 비디오 복호화기 기반 하드웨어 가속 환경과의 호환성을 핵심 조건으로 설정하고 있다.

3. 테스트 콘텐츠

향후 다양한 기관에서 제안될 표준 기술을 상호 경쟁 환경에서 객관적으로 평가하기 위해서는 공통된 데이터셋을 기준으로 한 일관된 성능 비교 결과가 필수적이다. 이에 따라 GSC 표준화에서는 앞서 정의된 유즈케이스 및 요구사항을 반영하여 다양한 유형의 데이터셋을 수집하고 있으며, 2026년 2월 현재도 표준화 진행사항에 맞춰 데이터셋 확장 작업을 지속적으로 진행 중이다.

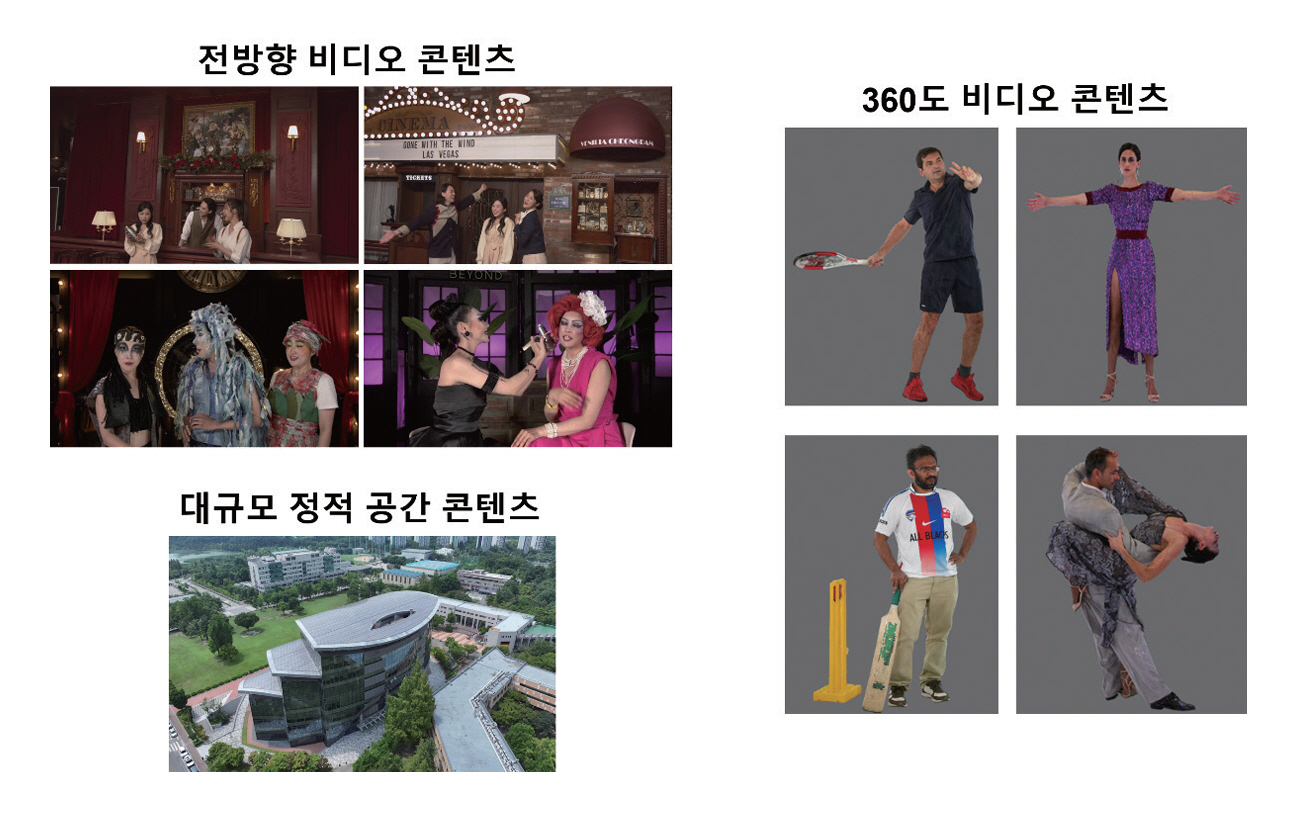

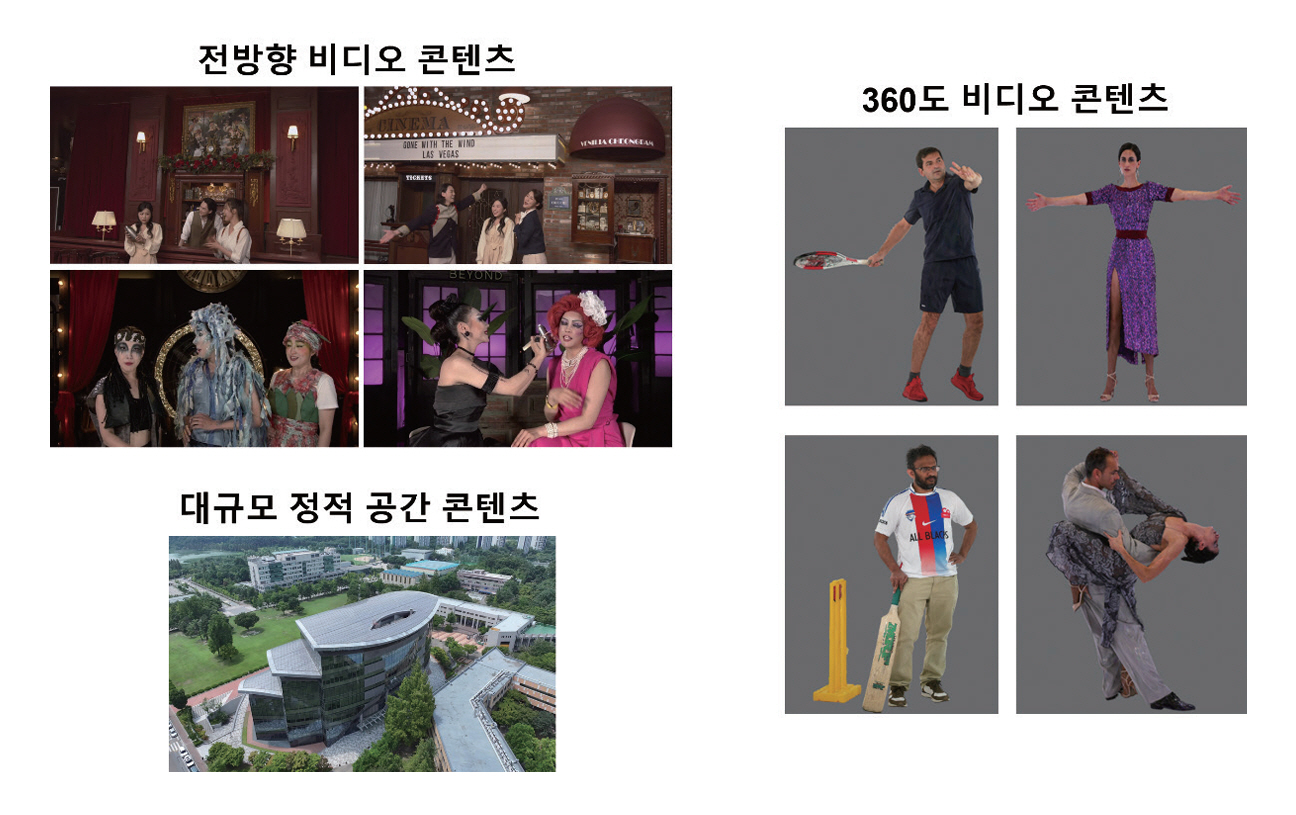

I-3DGS 트랙이 우선적으로 추진됨에 따라, 데이터셋 준비 역시 I-3DGS 형식 데이터셋 구축에 중점을 두고 이뤄지고 있다. 현재까지 확보된 테스트 콘텐츠는 세 가지 유형으로 구분된다(그림 3)[19]. 첫째, 정면을 바라보는 다시점 카메라로 중소형 장면의 동영상을 촬영한 전 방향 비디오 콘텐츠, 둘째, 다수의 수렴형 배치 카메라를 이용해 특정 객체를 촬영한 360도 비디오 콘텐츠, 셋째, 한두 대의 카메라를 이용해 넓은 공간의 정적 장면을 여러 시점에서 촬영한 대규모 정적 공간 콘텐츠이다. 이 중 첫째와 둘째 유형의 데이터셋은 비교적 충분히 확보된 반면, 셋째 유형은 촬영 난이도가 높아 상대적으로 확보가 제한된 상황이다.

한편, MPEG에서는 향후 표준 기술의 상용화를 고려하여, 라이센스 제약이 없는 Gsplat을 활용해 I-3DGS 데이터 훈련을 진행하고 있다[20]. 동영상 확장을 고려한 프레임 단위 I-3DGS 데이터셋의 경우, 프레임별로 독립적 훈련을 수행하면 심각한 시간적 비일관성 문제가 발생할 수 있다. 이의 완화를 위해, Gsplat을 수정보완하여 전체 프레임 정보를 내재한 기준(Canonical) 3DGS 모델을 생성한 뒤, 이를 각 프레임에 맞게 미세 조정하는 훈련 전략이 제안되었다[21]. 다만, GS 기반 표현 방식은 훈련 기반 최적화 특성상 원본 정보의 완전한 복원이 어렵고, 실제로 2026년 1월 회의에서 일부 콘텐츠에 대한 품질 저하 문제 및 평가 제외 여부가 논의되었다[22].

표준은 특정 훈련 방식에 종속되지 않고 최대한 다양한 방식으로 훈련된 I-3DGS 모델에 적용 가능하도록 개발되어야 한다. 그러나 현재까지도 다시점 영상으로부터 I-3DGS 모델 훈련 기능을 제공하는 오픈소스 구현이 제한적인 상황으로, 표준의 범용성 측면에서 우려가 존재한다. 이에 따라, 서로 다른 훈련 전략을 통해 생성된 I-3DGS 데이터셋의 추가 확보가 필요하며, 다양한 훈련 방식을 포괄적으로 반영한 I-3DGS 데이터셋 구축을 위해 향후 보다 폭넓은 참여와 협력이 요구된다.

4. 툴 개발 현황

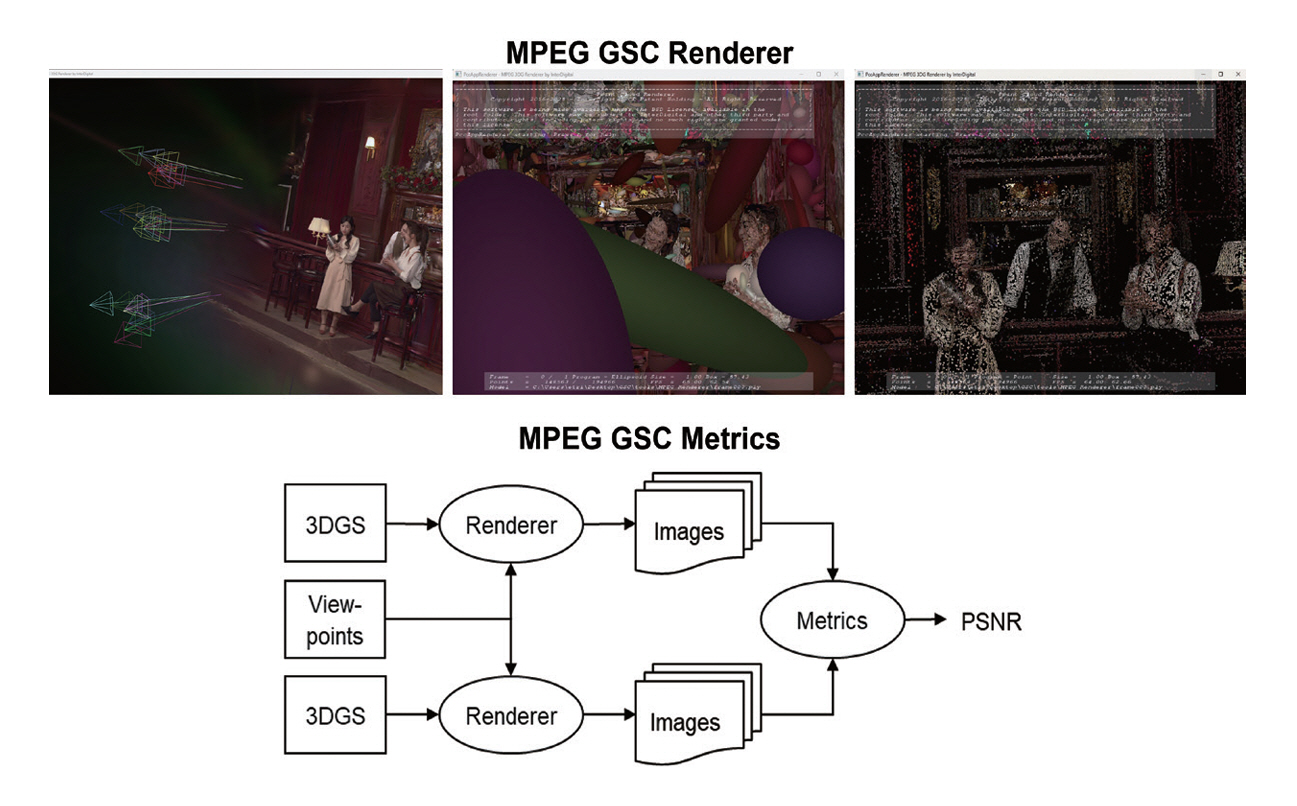

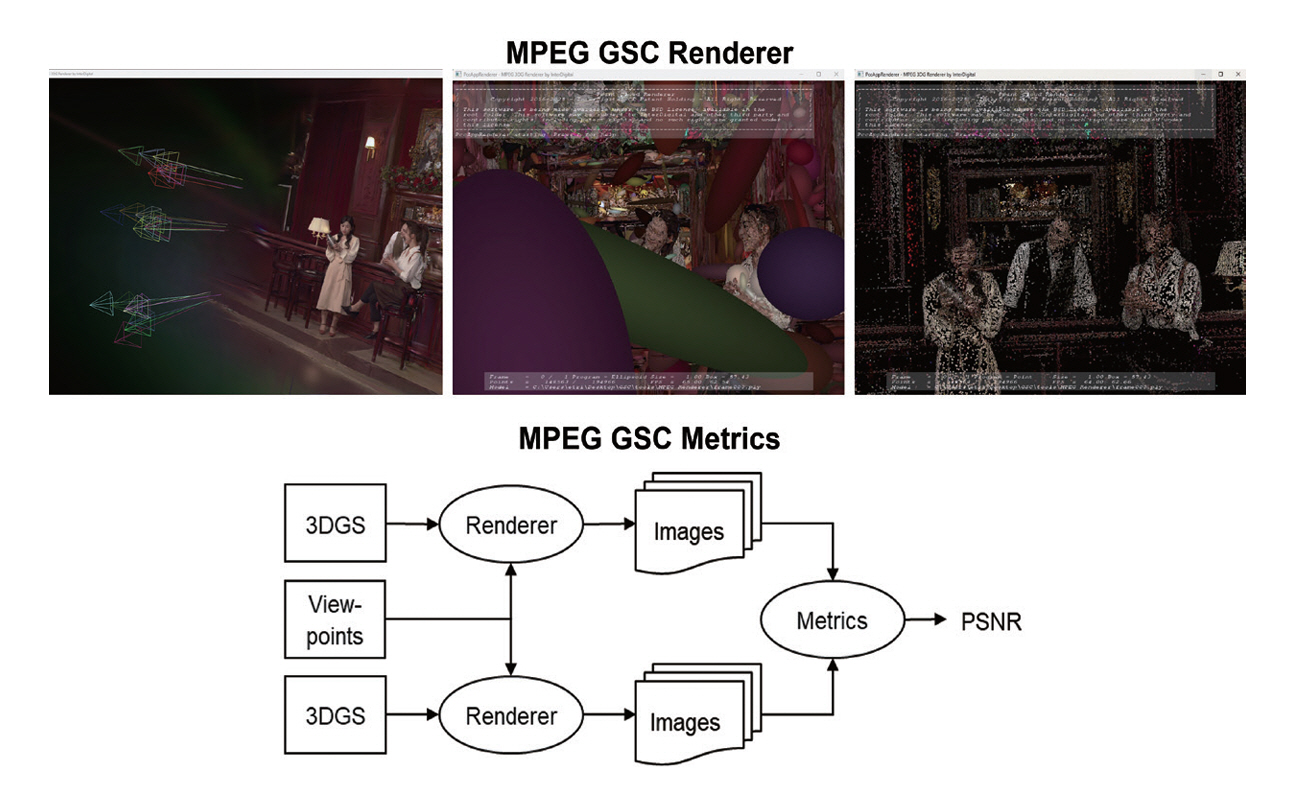

GSC 표준화 과정에서는 표준 기술 개발과 성능 평가를 지원하기 위한 다양한 툴이 병행하여 개발되고 있다(그림 4). MPEG GSC Renderer는 I-3DGS 데이터를 입력으로 받아 임의 시점의 영상을 실시간으로 렌더링하는 SW로, 사용자는 마우스를 통해 시점 위치를 자유롭게 조작할 수 있다[23]. 본 SW는 데이터셋 훈련 과정에서 I-3DGS 데이터의 복원 품질을 점검하거나, 부‧복호화 과정 이후 발생하는 화질 열화를 주관적으로 확인하는 데 활용된다. 또한, 단순한 렌더링 기능을 넘어 훈련 시점의 카메라 위치 정보, 가우시안의 공간적 분포, 포인트 클라우드에 대한 시각화 기능을 함께 제공한다.

한편, MPEG GSC Metrics는 객관적 품질 평가를 수행할 때 사용되는 툴로, 원본 I-3DGS 데이터와 부‧복호화 이후 복원된 I-3DGS 데이터, 그리고 평가 시점의 위치 및 방향 정보를 입력으로 받아 해당 시점에서의 영상을 생성‧비교함으로써 품질 지표를 산출한다[24]. PSNR, SSIM, IV-SSIM 등 다양한 지표를 지원하며, 객체 중심 콘텐츠의 경우에는 배경을 제외한 객체 영역에 한정하여 평가를 수행하도록 설계되어 있다.

5. Common Test Conditions

CTC(Common Test Conditions)는 표준화 과정에서 제안 기술의 성능을 객관적으로 평가하고, 표준 반영 여부를 결정하기 위한 기준이다. GSC 표준화에서도 CTC 구체화 작업이 진행 중이며, 표준화 단계에 맞춰 적용 범위를 점진적으로 확장하는 방향으로 정의되고 있다[19]. 현재는 Lightweight 트랙을 중심으로 단일 프레임 I-3DGS 데이터 압축 기술의 평가 기준 수립에 초점을 두고 있으나, 장기적으로는 다중 프레임 I-3DGS를 넘어 A-3DGS 데이터까지 포괄할 수 있도록 설계되고 있다.

CTC에는 테스트 콘텐츠에 대한 정보가 포함된다. 콘텐츠는 필수와 선택으로 구분되며, 필수 콘텐츠는 성능 결과 보고가 의무이고 선택 콘텐츠는 기술 제안자가 보고 여부를 결정할 수 있다. 콘텐츠별로 사용 프레임, 해상도, 시점 수 등 평가 조건이 명시되며, 동일한 입력 데이터 사용을 보장하기 위해 공식 다운로드 경로와 콘텐츠 동일성 확인을 위한 MD5 정보가 함께 제공된다.

객관적 성능 평가는 앵커(Anchor) 대비 성능 비교를 기본 원칙으로 한다. 예를 들어 V-PCC 및 G-PCC Amendment 표준화의 경우, 이전 회의에서 채택된 기술이 반영된 표준 기술로 생성된 결과물이 앵커로 사용된다. 평가는 네 개의 압축 강도(RP: Rate Point)에 대해 앵커와 제안 기술 간 객관적 품질 대비 비트레이트 증감률을 나타내는 BD-rate(Bjøntegaard Delta Rate)를 기준으로 수행되며[25], 객관적 품질 지표로는 RGB-PSNR, YUV-PSNR, YUVSSIM이 활용된다. 지표 계산에는 MPEG GSC Metrics 툴이 사용되며, 평가 결과의 일관된 정리를 위해 전용 엑셀 양식이 제공되어, 비트레이트와 품질 지표 값을 입력하면 앵커 대비 성능 차이가 자동으로 산출되도록 구성되어 있다.

한편, 주관적 성능 평가 방법도 병행하여 논의되고 있다. 현재 Lightweight 트랙 표준화는 신속한 진행을 위해 객관적 성능 평가를 우선 적용하고 있으나, 보다 완성도 높은 표준화를 대비하여 2026년 1월 회의를 기점으로 주관적 성능 평가 절차가 점진적으로 구체화되고 있다[22]. 주관적 평가는 시간에 따라 사전 정의된 가상 카메라 시점 경로인 포즈트레이스(Posetrace)를 따라 생성된 영상을 사용하는 것을 목표로 하며, 각 테스트 콘텐츠에 대해 동일한 시점 경로와 렌더링 조건을 적용함으로써 앵커와 제안 기술 간의 시각적 품질 차이를 일관되게 비교할 수 있도록 설계되고 있다.

6. V-PCC Amendment

3D 포인트 클라우드 정보를 2D 영상으로 투영한 뒤 비디오 코덱으로 압축하는 V-PCC 표준은, I-3DGS 데이터 역시 포인트 클라우드 기반 표현 방식을 사용한다는 점에서 비교적 단순 확장 적용이 가능하다. 이러한 배경에서 2025년 10월 회의에서 표준화 추진이 결정된 V-PCC Amendment는 1년 이내 표준 완료를 목표로, 2026년 1월 회의까지 약 2주 간격의 화상회의를 통해 기술 기고와 채택 절차가 집중적으로 진행되었다[14]. 그 결과 CDAM이 발행되었으며, CDAM 단계에 진입함에 따라 2026년 4월 회의부터는 현저한 성능 개선이 수반되지 않는 한 대규모 신규 기술 채택은 지양하고, 세부 기술 조정 중심의 마무리 단계로 전환될 것으로 예상된다.

CDAM에 반영된 기술들은 그 성격에 따라 크게 속성 정보 양자화, 회전 정보 변환, 그리고 SH 계수 변환 세 범주로 구분할 수 있다. 먼저 속성 정보 양자화 기법으로는 값의 분포 특성을 고려하여, 분포가 밀집된 구간에는 더욱 세밀한 양자화를 적용하고, 분포가 희소한 구간에는 상대적으로 낮은 정밀도의 양자화를 적용하는 방식이 제안되어 채택되었다[26]. 회전 정보 변환의 경우에는 회전 벡터가 갖는 중복성을 줄이기 위해 네 개 성분 중 절대값이 가장 큰 성분을 제거하고, 나머지 세 성분만을 전송하는 방식이 적용되었다[27]. 또한, SH 계수 변환에서는 SH 계수 간 높은 상관성을 활용하여 PCA(Principal Component Analysis) 변환을 적용하고, 에너지가 집중된 소수의 주성분만을 효율적으로 부호화함으로써 압축 효율을 향상시키는 접근이 채택되었다[28].

7. JVET SEI

V-PCC와 유사하게 I-3DGS 데이터가 갖는 다차원 속성 정보를 2D 영상으로 재구성한 뒤 비디오 코덱을 통해 압축하는 접근은 2025년 10월 회의를 기점으로 JVET에서도 본격적인 관심을 받기 시작하였다. 이는 HEVC, VVC 등 자체 표준인 기존 비디오 코덱을 그대로 활용하면서 적용 범위를 확장할 수 있는 방식으로, JVET 관점에서도 표준화를 검토할 가치가 있는 방향이다.

현재 JVET에서 검토 중인 방식은 비디오 코덱의 비트스트림 구조를 변경하지 않고 호환성을 유지한 채, 확장 정보 전달이 가능한 SEI를 통해 I-3DGS 복원에 필요한 메타데이터를 전달하는 방식이다. 즉, V-PCC가 메타데이터를 자체 표준구조로 전달하는 것과 달리, 해당 접근은 SEI를 활용한다는 점에서 차이를 갖는다. 2026년 1월 회의에서는 텐센트와 퀄컴이 SEI 기반으로 I-3DGS 모델의 부복호화 워크플로우를 구현한 SW인 TMCV(Test Model Candidate Video)를 제안하였으며, GSC CTC 환경에서 G-PCC 및 V-PCC Amendment와의 성능 비교 결과 경쟁력 있는 성능을 확인했다고 보고하였다[14]. 다만, 2026년 2월 현재, GSC 표준화 프로젝트에 WG5도 논의에 참여한다는 점 외에 구체적인 표준화 범위나 추진 방향은 아직 확정되지 않은 상태이다.

IV. 결론 및 표준화 전방

본고에서는 3DGS 기반 3차원 장면 표현의 확산과 함께 MPEG에서 추진 중인 GSC 표준화의 배경과 추진 구조, 그리고 최근 논의 동향을 살펴보았다. 3DGS는 실시간 렌더링이 가능한 고품질 시점 합성 표현으로 주목받고 있으나, 대규모 가우시안 집합과 다차원 속성 정보로 인한 데이터 규모 문제는 상용 서비스 적용에 있어 주요 제약 요인으로 작용해왔다. 이에 MPEG는 기존 비디오 및 3D 데이터 압축 표준의 경험을 바탕으로, 3DGS 데이터의 효율적 표현과 전송을 목표로 GSC 표준화를 본격적으로 추진하고 있다.

GSC 표준화는 WG4, WG7, 그리고 WG5가 단계적으로 참여하는 구조로 발전해 왔으며, 기술 성숙도와 산업적 요구를 함께 고려한 단계적 표준화 전략을 채택하고 있다는 점에서 특징적이다. 특히, I-3DGS를 1단계 표준화 대상으로 명확히 설정하고, 산업계의 조기 활용 수요를 반영한 Lightweight 트랙과 기존 MPEG 표준을 확장하는 Amendment 방식을 병행함으로써 표준의 안정성과 실용성을 동시에 확보하려는 접근이 이루어지고 있다.

현재 GSC 표준화는 I-3DGS를 중심으로 한 압축 기술 채택과 CTC, 데이터셋, 평가 툴 정비를 통해 기술적 기반을 점차 공고히 하고 있으며, V-PCC 및 G-PCC 확장과 더불어 SEI 기반 비디오 코덱 연계 방식 등 다양한 접근이 논의되고 있다. 향후에는 Lightweight 트랙의 조기 완료를 통해 초기 상용 적용 사례를 확보하는 한편, A-3DGS 및 동영상 확장을 포함한 더 일반적인 GS 표현을 수용하는 방향으로 단계적 확장이 이루어질 것으로 예상된다.

용어해설

3D Gaussian Splatting 수많은 3차원 가우시안을 이용해 장면을 표현하고, 이를 영상 평면에 투영·누적하여 시점을 합성하는 3차원 장면 표현 및 렌더링 기법

MPEG 영상·오디오 및 3차원 미디어 데이터의 압축, 저장, 전송을 위한 국제 표준을 개발하는 ISO/IEC 산하의 공식 표준화 기구

JVET MPEG과 ITU-T가 공동으로 구성한 비디오 코덱 표준화 그룹으로, HEVC(H.265), VVC(H.266) 등 차세대 비디오 압축 표준을 개발

B. Mildenhall et al., "Nerf: Representing scenes as neural radiance fields for view synthesis," Commun. ACM. vol. 65, no. 1, 2021, pp. 99-106.

B. Kerbl et al., "3D Gaussian splatting for real-time radiance field rendering," ACM Trans. Graph. vol. 42, no. 4, 2023, pp. 1–14.

J.C. Lee et al., "Compact 3d gaussian representation for radiance field," in Proc. IEEE/CVF Conf. Comput. Vis. Pattern Recognit., (Seattle WA, USA), June 2024, pp. 21719–21728.

J. Choi et al., "[INVR] 3D Gaussian Splatting for Visual Representation," document ISO/IEC JTC1/SC29/WG4, MPEG2024/M66420, Jan. 2024.

A. Zaghetto, et al., "[Informative] 3DGS Geometry Quantization," document ISO/IEC JTC 1/SC29/WG7, MPEG2024/M69034, Sapporo, Jul. 2024.

Common test conditions on Gaussian splat coding ISO/IEC JTC1/SC29/WG7. MPEG2025/N1138, Jan. 2025.

Y. Liao et al., "AhG on Gaussian Splat Coding," document ISO/IEC JTC1/SC29/WG7, MPEG2025/M71747, Jan. 2025.

G.V. der Auwera et al., "[GSC][JEE6.4-related] On the use case and requirements for lightweight GSC," document ISO/IEC JTC1/SC29/WG4, MPEG2025/M72430, Jan. 2025.

Y. Liao et al., "AhG on Gaussian Splat Coding," document ISO/IEC JTC1/SC29/WG7, MPEG2025/M72430, July 2025.

Text of ISO/IEC 23090-5 CDAM V-PCC for gaussian splats coding ISO/IEC JTC1/SC29/WG7 MPEG2026/N1360, Jan. 2026.

WD of ISO/IEC 23090-9 AMD 1 - Geometry-based Gaussian Splat Coding ISO/IEC JTC1/SC29/WG7 MPEG2026/N1361, Jan. 2026.

S. Wegner et al., "3D Gaussian Splats in VSEI," document ISO/IEC JTC1/SC29/WG7, MPEG2026/M75749, Jan. 2026.

Preliminary draft requirements for lightweight GSC, ISO/IEC JTC1/SC29/WG2 MPEG2025/N0486, Oct. 2025

Common test conditions for Gaussian splat coding, document ISO/IEC JTC1/SC29/WG7 MPEG2026/N1414, Jan. 2026.

V. Ye et al., "gsplat: An open-source library for Gaussian splatting," J. Mach. Learn. Res. vol. 26, no. 34, 2025, pp. 1-17.

J.Y. Jeong et al., "[GSC][JEE 6.1-related] Training Method for Generating Temporally Consistent Per-frame I-3DGS Dataset," ISO/IEC JTC1/SC29/WG4 MPEG2025/ m71763, Apr. 2025.

A. Trioux et al., "[GSC][JEE6.8] Guidance on pilot expert viewing and material pre-selection for subjective evaluation of Gaussian Splat Coding," ISO/IEC JTC1/SC29/WG7 MPEG2026/m75906, Jan. 2026.

J. Richard et al., "[GSC] Support for gaussian splats in mpeg-pcc-renderer software," ISO/IEC JTC1/SC29/WG07MPEG2025/m71137, Jan. 2025.

J. Richard et al., "[GSC] Image based 3D Gaussian splat metric software," ISO/IEC JTC1/SC29/WG07 MPEG2025/m71138, Jan. 2025.

N. Barman et al., "Bjøntegaard delta (bd): A tutorial overview of the metric, evolution, challenges, and recommendations," arXiv preprint, 2024. doi: 10.48550/arXiv.2401.04039

M. Budagavi et al., "[V-PCC][CE2.7] Gaussian splat spherical harmonics quantization for V-PCC Amd for Gaussian Splat," ISO/IEC JTC1/SC29/WG07 MPEG2026/M75025, Jan. 2026.

P.R. Alface et al., "[V-PCC][Amd1] Coding the quaternion attribute with a single video," ISO/IEC JTC1/SC29/WG07 MPEG2026/M75523,Jan. 2026.

- Sign Up

- 전자통신동향분석 이메일 전자저널 구독을 원하시는 경우 정확한 이메일 주소를 입력하시기 바랍니다.